深度学习神经网络图表模板:MLVisuals by dair.ai

下载需积分: 10 | PPTX格式 | 10.7MB |

更新于2024-07-15

| 48 浏览量 | 举报

"MLVisuals by dair.ai.pptx" 是一个深度学习神经网络的绘图模板,由dair.ai提供,可在GitHub上找到。这个模板主要用于帮助人们理解和展示机器学习(ML)模型,特别是神经网络架构。标签"Boris"可能指的是创建者或与模板相关的人。

内容概述:

1. 基本组件:

- Softmax:这是一个常用的激活函数,用于多分类问题,将神经网络最后一层的输出转换为概率分布。

- Convolve(卷积):卷积层是卷积神经网络(CNN)的核心,通过卷积核对输入图像进行扫描以提取特征。

- Sharpen:在神经网络中,"Sharpen"可能指的是一种使预测概率分布更尖锐的技术,以提高模型的确定性。

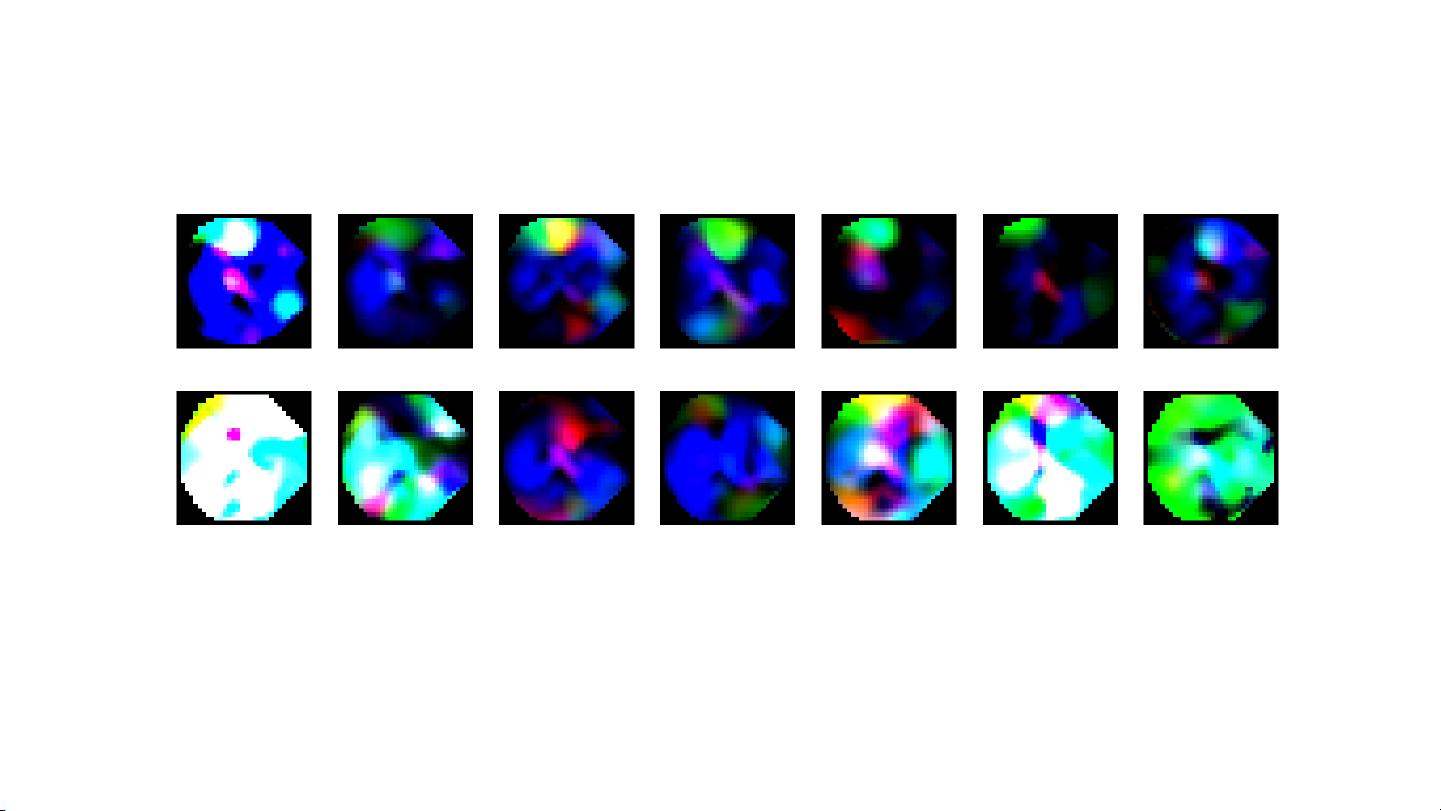

2. 神经网络架构:

- S2S(Sequence to Sequence):这是一种用于序列数据处理的模型,常用于机器翻译任务。

- Frame1-7:这些可能表示神经网络模型的不同阶段或层级。

- Level1-4:表示模型的不同层次,可能对应于不同的抽象级别或特征提取深度。

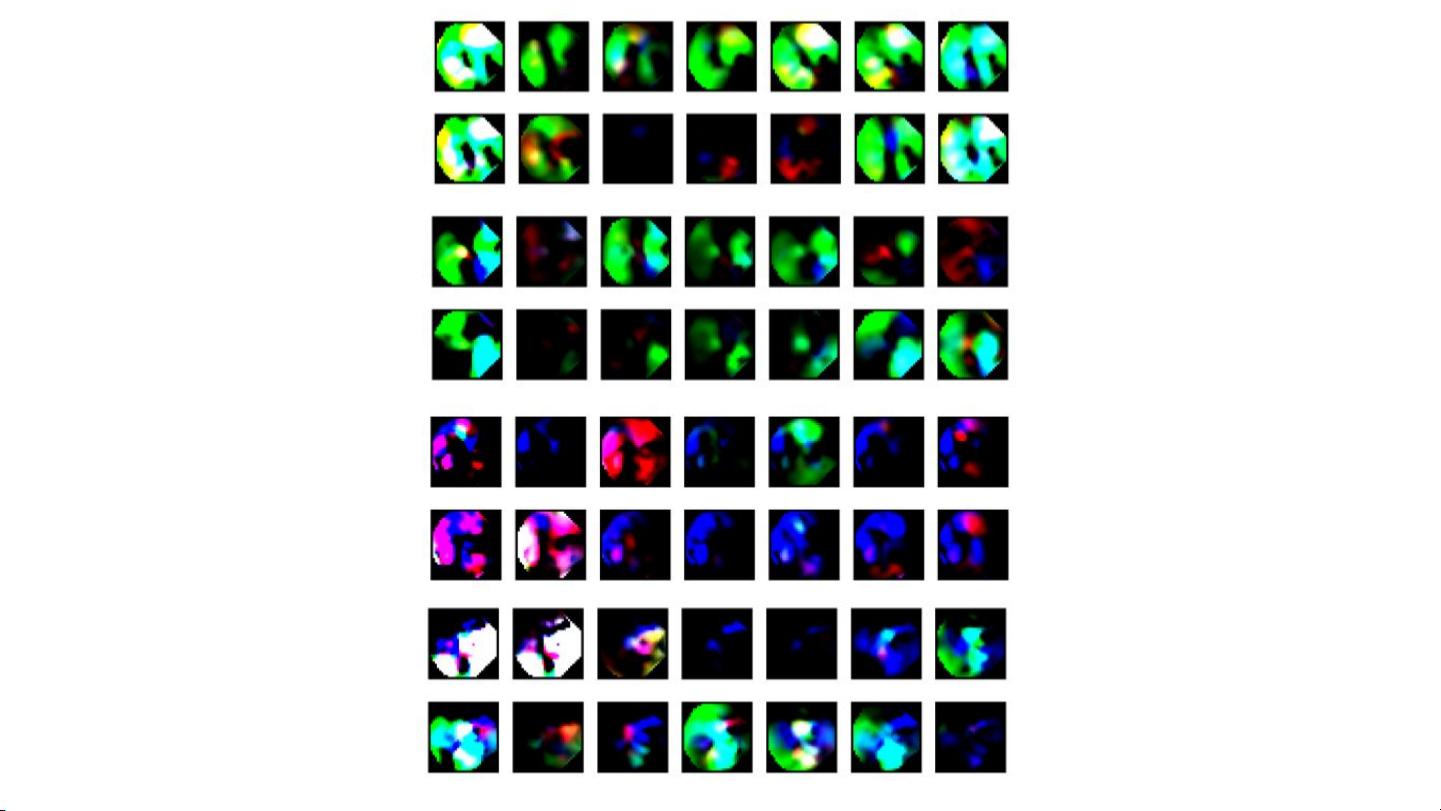

3. CNN层结构:

- CNN(卷积神经网络):包括多个卷积层、最大池化层和全连接层(FC)。

- Conv3-32 x 4, Conv3-64 x 2, Conv3-128 x 1:这些表示具有不同滤波器尺寸和数量的卷积层,如3x3卷积核,分别有32、64和128个滤波器,并且可能有不同的步长。

- Maxpool (2x2):最大池化层,通常用于减少维度并保持关键特征。

- FC-512:全连接层,有512个神经元,用于进一步的特征学习和分类。

- Feature Vector:最后的特征向量,用于模型的输出。

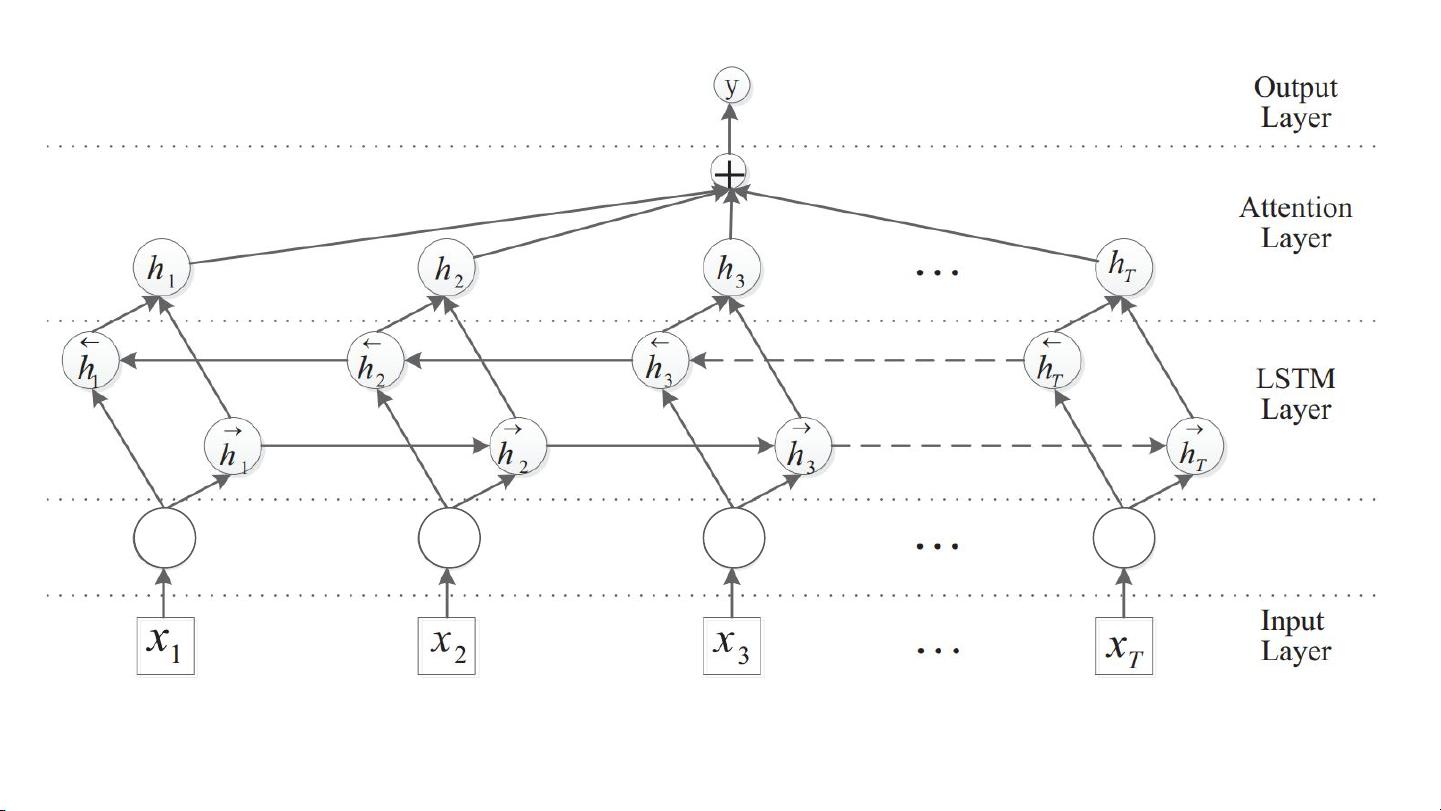

4. LSTM(长短时记忆网络)层:

- LSTM在网络中用于处理序列数据,保留长期依赖性。

- A) LSTM, B) Mixed LSTM/1DConv, C) Mixed BiLSTM/1DConv:不同的LSTM变体,混合了1D卷积,可能是为了增强模型对序列模式的捕捉能力。

5. Attention机制:

- 注意力层允许模型聚焦于输入序列的特定部分,提高理解和预测的准确性。

6. 模型结构:

- 输入层(Input Layer)、隐藏层(Hidden Layers)和输出层(Output Layer)构成了神经网络的基本结构。其中,隐藏层可能包括多层LSTM、CNN和注意力层,用于逐步处理和解析输入数据。

7. 示例输入和输出:

- 示例数据(如X=A[0], a[4], A[1], A[3], XŶ等)展示了模型如何处理和转换输入以产生输出。

总结,这个模板提供了丰富的视觉工具来描绘复杂的深度学习模型,包括CNN、LSTM以及注意力机制,对于教学、研究和模型解释非常有价值。通过这些图形化表示,用户可以更清晰地理解模型的工作原理和不同组件之间的交互。

相关推荐

libo-coder

- 粉丝: 1w+

最新资源

- 小学水墨风学校网站模板设计

- 深入理解线程池的实现原理与应用

- MSP430编程代码集锦:实用例程源码分享

- 绿色大图幻灯商务响应式企业网站开发源码包

- 深入理解CSS与Web标准的专业解决方案

- Qt/C++集成Google拼音输入法演示Demo

- Apache Hive 0.13.1 版本安装包详解

- 百度地图范围标注技术及应用

- 打造个性化的Windows 8锁屏体验

- Atlantis移动应用开发深度解析

- ASP.NET实验教程:源代码详细解析与实践

- 2012年工业观察杂志完整版

- 全国综合缴费营业厅系统11.5:一站式缴费与运营管理解决方案

- JAVA原生实现HTTP请求的简易指南

- 便携PDF浏览器:随时随地快速查看文档

- VTF格式图片编辑工具:深入起源引擎贴图修改