Spark运行架构详解与生态圈探索

Spark简介以及其生态圈深入讲解了Spark的运行架构、在不同集群环境下的部署方式以及常见问题解决方案。Spark是一个强大的分布式计算框架,其核心概念包括Application(用户编写的Spark应用程序)和Driver(运行应用程序的主进程)。Driver在启动时创建SparkContext,这个上下文提供了与集群交互的接口,为任务调度和数据处理设置基础。

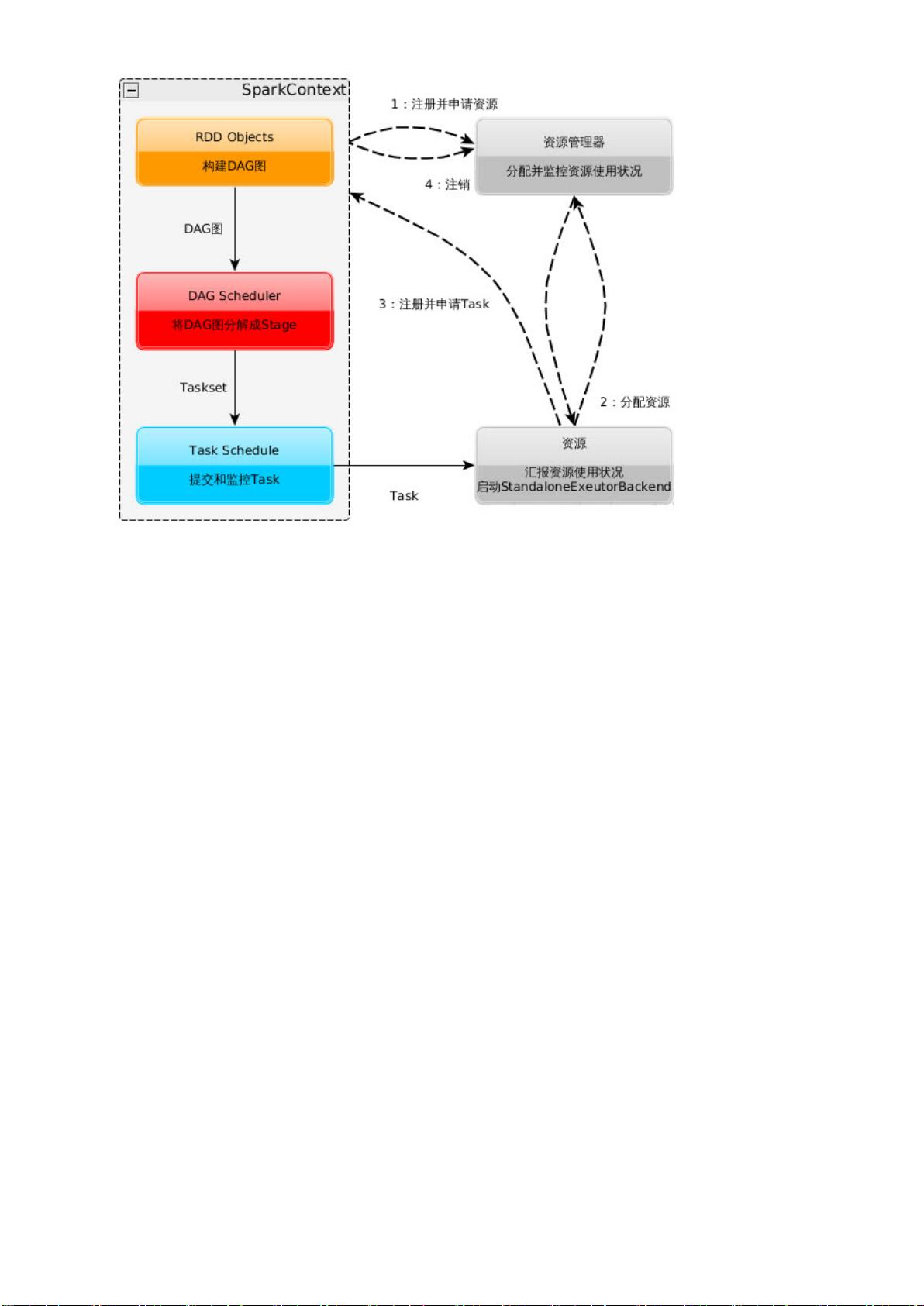

Spark运行架构分为以下几个关键部分:

1. **术语定义**:

- Application:与Hadoop MapReduce中的Job相似,是Spark用户编写的可执行程序,包含Driver(主进程)和Executor(工作进程)组件。

- Driver:负责执行用户提供的main()函数,并创建SparkContext,它负责初始化Spark的运行环境,管理任务的提交和监控。

2. **基本流程**:

- **DAGScheduler**:动态图调度器,根据应用程序逻辑构建有向无环图(DAG),将任务分解为可并行执行的任务块(TaskSet)。

- **TaskScheduler**:负责将DAG中的任务分发到Executor上执行,根据资源管理和负载均衡策略进行调度。

3. **运行原理**:

- **RDD(Resilient Distributed Datasets)**:Spark的核心数据结构,提供弹性、容错的数据集操作,允许用户在分布式环境下进行数据处理。

4. **集群部署**:

- **STANDALONE模式**:最简单的Spark集群模式,由一个Master节点和多个Worker节点组成,Master负责任务调度。

- **SPARK ON YARN**:运行在YARN之上,利用YARN的资源管理和调度能力,包括YARN-Client模式(客户端模式,直接与YARN交互)、YARN-Cluster模式(集群模式,通过YARN API调用)。

5. **运行演示**:

- **STANDALONE模式演示**:涉及启动Spark Shell,查看测试文件位置,执行任务并分析结果。

- **YARN模式演示**:分别展示了客户端和集群模式下的启动步骤、运行过程和结果分析。

6. **问题解决**:

- **YARN-CLIENT启动报错**:探讨了可能遇到的YARN-Client启动过程中常见的错误及其排查方法。

了解这些内容有助于快速理解和掌握Spark的运行机制,从而有效地在实际项目中应用Spark进行大数据处理和流式计算。

2021-01-07 上传

2021-01-07 上传

2018-06-04 上传

点击了解资源详情

2023-03-16 上传

2023-03-16 上传

Mr_JoLiang

- 粉丝: 0

- 资源: 8

最新资源

- 高清艺术文字图标资源,PNG和ICO格式免费下载

- mui框架HTML5应用界面组件使用示例教程

- Vue.js开发利器:chrome-vue-devtools插件解析

- 掌握ElectronBrowserJS:打造跨平台电子应用

- 前端导师教程:构建与部署社交证明页面

- Java多线程与线程安全在断点续传中的实现

- 免Root一键卸载安卓预装应用教程

- 易语言实现高级表格滚动条完美控制技巧

- 超声波测距尺的源码实现

- 数据可视化与交互:构建易用的数据界面

- 实现Discourse外聘回复自动标记的简易插件

- 链表的头插法与尾插法实现及长度计算

- Playwright与Typescript及Mocha集成:自动化UI测试实践指南

- 128x128像素线性工具图标下载集合

- 易语言安装包程序增强版:智能导入与重复库过滤

- 利用AJAX与Spotify API在Google地图中探索世界音乐排行榜