"随机森林算法优化及特征选择概述"

需积分: 9 134 浏览量

更新于2023-12-27

收藏 1.07MB PPTX 举报

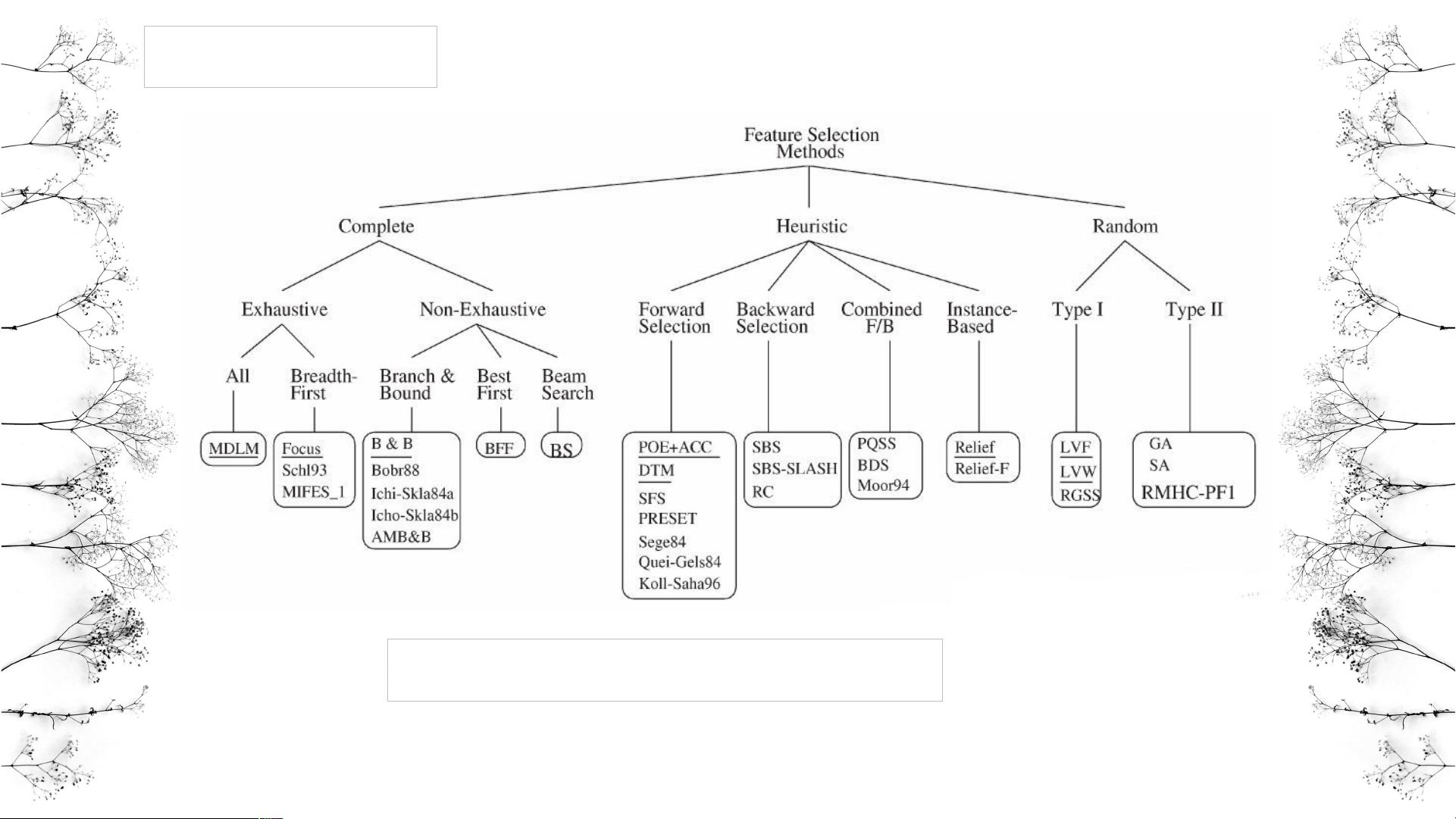

随机森林算法及优化是人工智能领域的重要内容,涉及到特征选择、基本原理和优化方法等多个方面。特征选择是指从众多特征中选择最优子特征集,以保证模型效果不下降并且尽可能接近真实类别分布,其主要包括生成、评价、停止和验证等四个过程。随机森林基本原理是由Leo Breiman于2001年提出,通过自助法(bootstrap)重采样技术生成新的训练样本集,然后根据自助样本集生成分类树组成随机森林,最终新数据的分类结果由分类树投票多少形成的分数来决定。在实践中,随机森林算法还可以通过优化方法来提高模型效果,这包括特征选择、参数调整等。

特征选择是在N个特征中选择M个子特征,并确保在M个子特征中,准则函数可以达到最优解的过程。其目的是选择尽可能少的子特征,使得模型效果不会显著下降,并且保证结果的类别分布尽可能接近真实的类别分布。特征选择主要包括生成候选特征子集、评价特征子集的好坏、决定停止条件和验证特征子集是否有效等四个过程。对于一个拥有N个特征的对象,可以产生2^N个特征子集,特征选择就是从这些子集中选出对于特定任务最好的子集。在实际应用中,特征选择算法需要考虑如何选择并加以实现,以满足具体任务需求。

随机森林的基本原理是通过自助法(bootstrap)重采样技术从原始训练样本集中重复随机抽取k个样本生成新的训练样本集合,然后根据自助样本集生成分类树,最终组成随机森林。随机森林是对决策树算法的一种改进,通过组合多个分类树的预测结果来提高整体模型的准确性和鲁棒性。新数据的分类结果由多个分类树投票多少形成的分数来决定。

在实践中,随机森林算法也需要进行优化以提高模型效果。其中特征选择是一项重要的优化方法,可以通过选择合适的特征子集来提高模型的预测性能。此外,随机森林的参数调整等也是优化的重要内容,通过调整模型的参数来达到更好的性能表现。

综上所述,随机森林算法及优化涉及到特征选择、基本原理、优化方法等多个方面。特征选择是从众多特征中选择最优子特征集以保证模型效果的主要手段,而随机森林的基本原理则是利用自助法生成分类树组成森林,通过多个分类树组合来提高整体模型性能。在实践中,随机森林算法还可以通过特征选择、参数调整等优化方法来进一步提高模型的准确性和鲁棒性。因此,对随机森林算法的深入理解和优化方法的熟练应用对于提高模型性能具有重要意义。

2022-10-18 上传

2023-10-21 上传

2023-10-22 上传

2021-09-23 上传

2024-06-03 上传

2024-05-26 上传

潘多拉丨魔盒

- 粉丝: 18

- 资源: 9

最新资源

- Python中快速友好的MessagePack序列化库msgspec

- 大学生社团管理系统设计与实现

- 基于Netbeans和JavaFX的宿舍管理系统开发与实践

- NodeJS打造Discord机器人:kazzcord功能全解析

- 小学教学与管理一体化:校务管理系统v***

- AppDeploy neXtGen:无需代理的Windows AD集成软件自动分发

- 基于SSM和JSP技术的网上商城系统开发

- 探索ANOIRA16的GitHub托管测试网站之路

- 语音性别识别:机器学习模型的精确度提升策略

- 利用MATLAB代码让古董486电脑焕发新生

- Erlang VM上的分布式生命游戏实现与Elixir设计

- 一键下载管理 - Go to Downloads-crx插件

- Java SSM框架开发的客户关系管理系统

- 使用SQL数据库和Django开发应用程序指南

- Spring Security实战指南:详细示例与应用

- Quarkus项目测试展示柜:Cucumber与FitNesse实践