神经网络优化:交叉熵代价函数的作用和公式推导

需积分: 0 46 浏览量

更新于2024-08-05

收藏 1.89MB PDF 举报

交叉熵代价函数的作用及公式推导

交叉熵代价函数(Cross-entropy cost function)是一种用于衡量人工神经网络(ANN)预测值与实际值的差异的方式。它与二次代价函数相比更有效地促进ANN的训练。

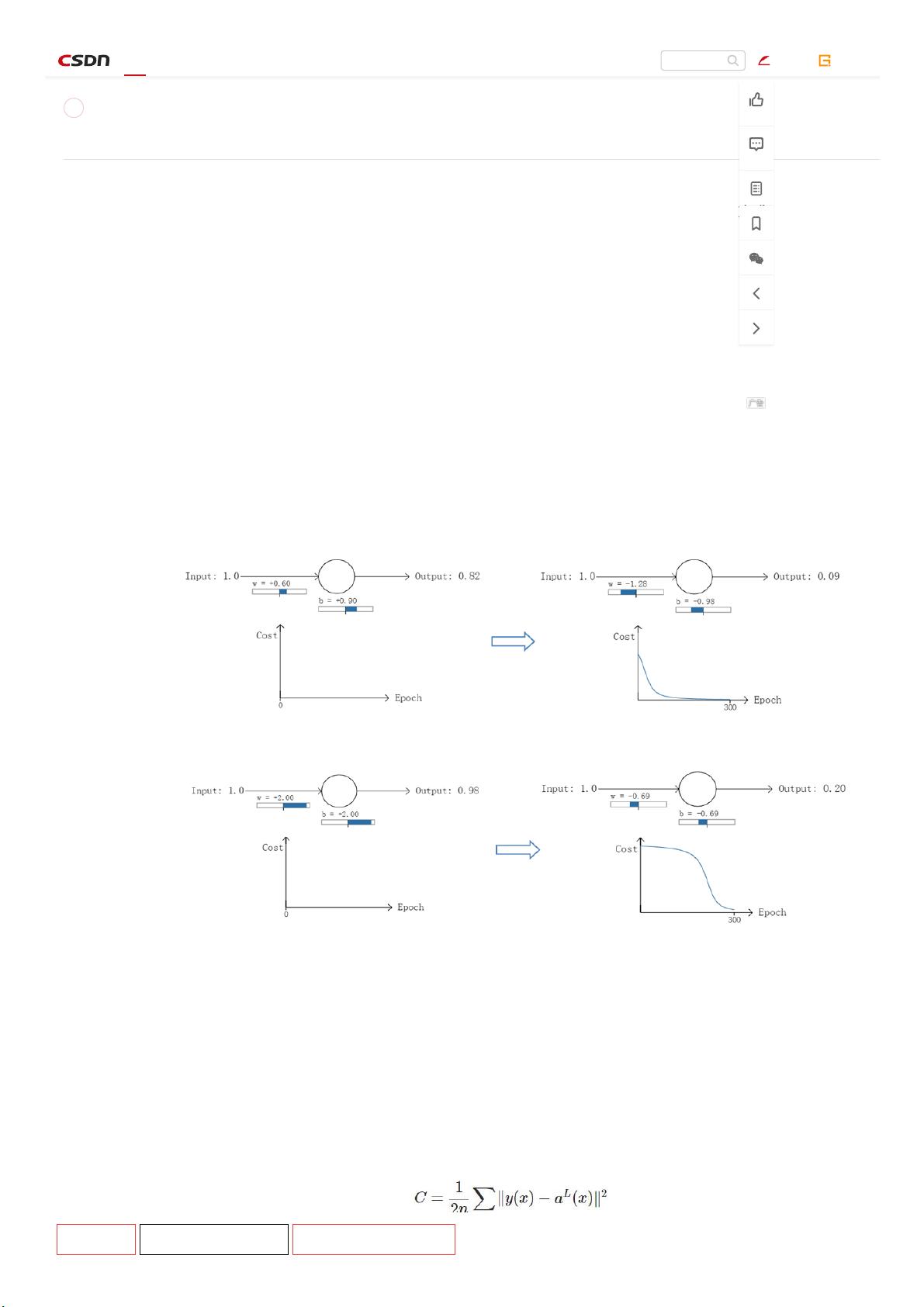

在介绍交叉熵代价函数之前,我们需要了解二次代价函数的不足之处。二次代价函数的设计目的是使机器可以像人一样学习知识。但是,在实际应用中,二次代价函数存在一些缺陷。例如,在二类分类训练中,如果预测值与实际值的误差越大,参数调整的幅度可能更小,训练更缓慢。

交叉熵代价函数的公式推导可以分为以下步骤:

1. 首先,我们需要定义交叉熵代价函数的公式:H(y, y') = -∑[y log(y') + (1-y) log(1-y')]

其中,y是实际值,y'是预测值。

2. 然后,我们需要推导交叉熵代价函数的梯度:∂H/∂y' = -y/y' + (1-y)/(1-y')

3. 最后,我们可以使用梯度下降算法来最小化交叉熵代价函数。

交叉熵代价函数的优点是,它可以更好地衡量预测值与实际值的差异,从而使ANN的训练更加快速和准确。例如,在二类分类训练中,交叉熵代价函数可以使参数调整的幅度更大,训练更快收敛。

在实际应用中,交叉熵代价函数广泛应用于机器学习领域,例如图像分类、语音识别、自然语言处理等。它是ANN训练的核心组件之一,能够使ANN模型更加准确和可靠。

交叉熵代价函数是一种非常重要的机器学习技术,广泛应用于各种领域。它可以使ANN模型更加准确和可靠,提高机器学习的效率和效果。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2021-03-16 上传

2021-05-23 上传

2020-02-12 上传

2015-09-22 上传

2021-04-30 上传

2022-04-06 上传

神康不是狗

- 粉丝: 39

- 资源: 336

最新资源

- sentry-ssdb-nodestore:Sentry的SSDB NodeStore后端

- 附近JavaScript:适用于JavaScript的ArcGIS API应用程序可查找附近的地点并路由到最近的位置

- aiap-field-guide:每周Aiap课程

- Ambit Components Collection-开源

- Glider Screen-crx插件

- PCB_FDTD.zip_matlab例程_C++_Builder_

- 快速收集视图的自定义蜂窝布局-Swift开发

- js-pwdgen-wannabe

- facebook-sdk:适用于Facebook Graph API的Python SDK

- markdown文档转pdf工具

- lucy:基于键值存储网络的聊天机器人

- Year Clock-crx插件

- goodmobileirisrecognition.rar_matlab例程_matlab_

- matlab人脸检测框脸代码-opencv4nodeJs-4.5.2:适用于Node.js的OpencvBuild

- CTI110:CTI110存储库

- L-one-crx插件