Python实现Hopfield网络:消除噪声的算法教程

158 浏览量

更新于2024-09-02

1

收藏 219KB PDF 举报

本文是一篇关于使用Python实现Hopfield网络的教程,主要介绍Hopfield网络的基本原理和应用,以及如何通过Python代码实现该算法。Hopfield网络是一种具有联想记忆功能的神经网络模型,能用于从失真的模式中恢复原始模式。

Hopfield网络是一种反馈型的人工神经网络,由John J. Hopfield在1982年提出。它的核心思想是通过网络中节点之间的相互连接权重来存储一系列稳定的状态,这些状态对应于网络的“记忆”。当网络接收到一个失真的输入模式时,它会通过迭代更新每个节点的状态,试图达到一个稳定状态,这个稳定状态通常与原始存储的模式相近。

在Python中实现Hopfield网络,我们需要以下关键元素:

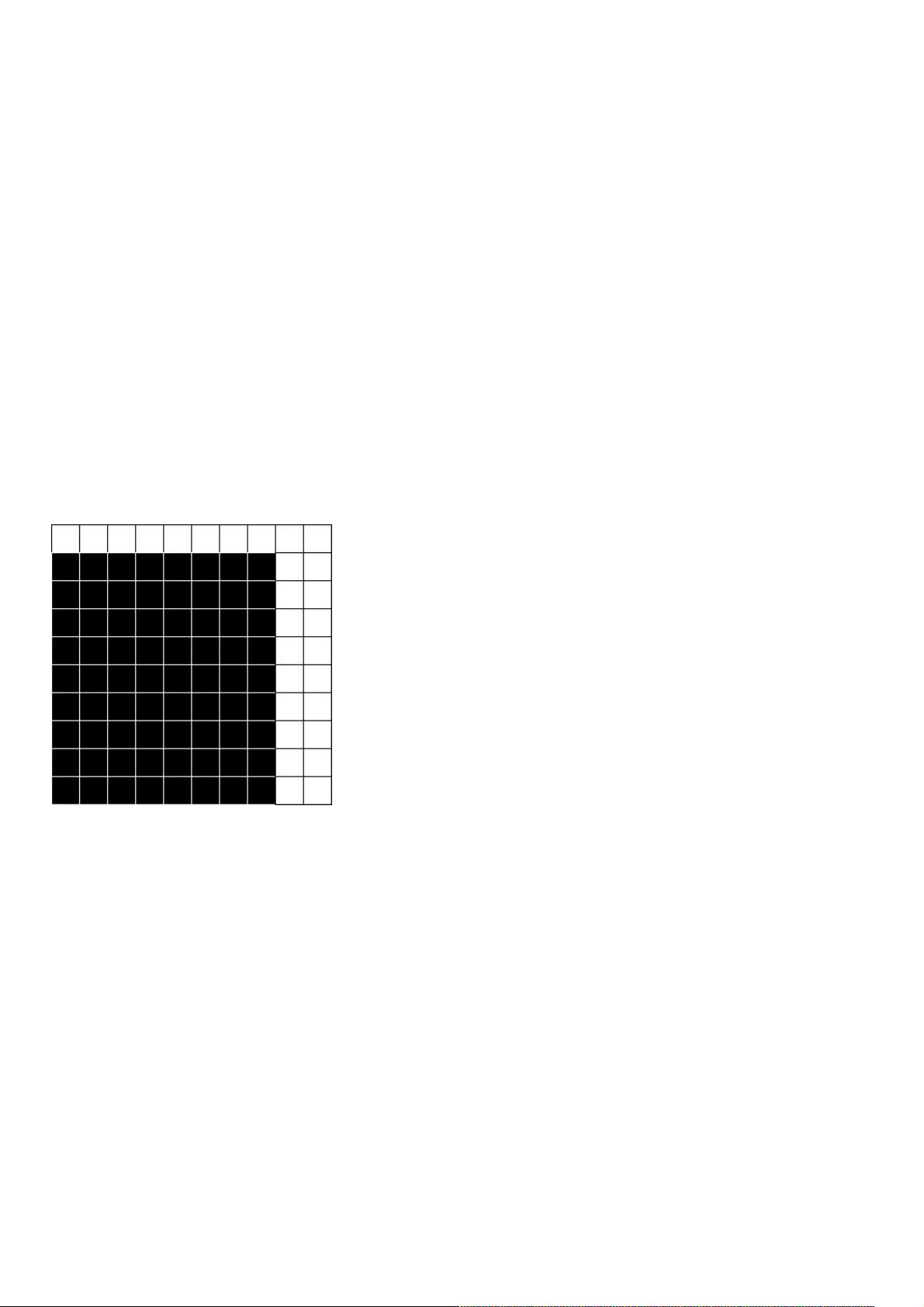

1. **模式数组**:网络需要一组二值模式(通常用-1和+1编码)作为训练样本。这些模式可以代表图像、数据点等。

2. **权重矩阵**:根据训练模式计算权重矩阵,权重通常通过Hebbian学习规则确定,即“共同激发的神经元互相增强连接”。

3. **更新规则**:Hopfield网络使用同步更新或异步更新规则。在同步更新中,所有节点同时更新状态;在异步更新中,每次只有一个随机选择的节点更新。

4. **能量函数**:网络的能量函数是衡量网络状态稳定性的指标,通常定义为节点状态与权重矩阵的内积。网络的目标是降低能量,直到达到一个局部最小值,即稳定状态。

在给定的Python实现`net.py`中,作者可能展示了如何初始化模式,计算权重矩阵,以及执行网络更新过程以从失真模式恢复原始模式。代码可能包含以下几个部分:

- **模式编码**:将图像或其他数据表示为列表,如清单1所示。

- **权重计算**:根据模式列表计算权重矩阵,通常使用Hebbian学习规则。

- **状态更新**:编写函数来更新网络中每个节点的状态。

- **迭代过程**:循环执行状态更新,直到网络达到稳定状态或达到预设的最大迭代次数。

Hopfield网络的优点在于其简单性和理论上的吸引力,但也有以下局限性:

- **记忆容量**:Hopfield网络能稳定存储的记忆数量有限,且随着存储模式的数量增加,网络容易陷入错误的稳定状态(又称陷阱或虚假记忆)。

- **噪声敏感性**:即使微小的输入噪声也可能导致恢复过程失败。

- **全局稳定性**:只有在理想条件下,Hopfield网络才能保证全局稳定地收敛到正确的记忆状态。

对于寻求解决计算问题的人来说,Hopfield网络可能是一个有趣的工具,特别是在处理模式识别、联想记忆或者数据恢复等问题时。然而,理解Hopfield网络的工作原理、其局限性以及在不同场景下的适用性至关重要。如果这个简化的实现不能满足需求,可能需要考虑更复杂的方法,如深度学习模型或者其他类型的神经网络。在决定是否深入研究Hopfield网络前,应当评估它是否适合特定问题的需求,并考虑可能的替代方案。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2021-09-29 上传

2020-01-02 上传

2022-06-22 上传

2021-04-21 上传

2021-02-04 上传

2015-10-23 上传

weixin_38664532

- 粉丝: 9

- 资源: 945

最新资源

- FTP文件传输协议(标准版)

- 《计算机系统结构-量化研究方法》

- 基于AHP和系统仿真的面向服务业务过程性能评价

- 使用Microsoft Agent的COM接口编程

- spring技术操作指南(完全中文版)

- The C Book

- 基于AHP模型的政府系统职能评价方法的研究

- 表面裂纹三维表面裂纹的应力强度因子

- C_C++指针经验总结

- 我的积累 aix语法

- 戏说面向对象程序设计C#版.pdf

- 。。。。。。。。。。。。。lingo入门教程。。。。。。。。。。。

- Java Web中的入侵检测及简单实现

- 设计之道(oop)--张逸著

- wincvsinstall.pdf

- Delphi+access仓库管理系统论文