K-MEANS聚类算法详解:原理、优缺点与应用

需积分: 0 49 浏览量

更新于2024-08-04

收藏 88KB DOCX 举报

"本文主要介绍了K-MeANS算法,一种常用的聚类方法,属于划分方法。K-MeANS算法流程包括随机选择K个对象作为初始质心,将其他对象分配到最近的质心对应的类簇,然后更新质心,直至满足停止条件。平方误差准则用于衡量聚类效果。算法优点在于能处理大规模数据,簇间分离度高,但也有其局限性,如需预设簇数和质心,易陷入局部最优,仅适用于数值型数据和凸形簇,对噪声和孤立点敏感。此外,K-MeANS算法蕴含EM(期望最大化)思想,常用于无监督学习任务,如将无标签数据进行分组。"

K-MeANS算法是一种广泛应用的聚类方法,主要在数据挖掘和机器学习领域。它属于划分方法,通过不断迭代将数据点分配到最近的类簇并更新类簇中心,直至达到某种收敛标准。K值是预设的类簇数量,初始质心通常是随机选取的样本。算法流程如下:

1. **初始化**:选择K个数据点作为初始质心 Ci。

2. **分配**:对于数据集中每个点 P,计算它到所有质心的距离,将其分配给最近的质心所属的类簇。

3. **更新**:重新计算每个类簇的质心,通常为该类簇所有点的几何中心。

4. **重复**:重复步骤2和3,直到质心不再显著移动(即达到收敛)或达到预设的最大迭代次数。

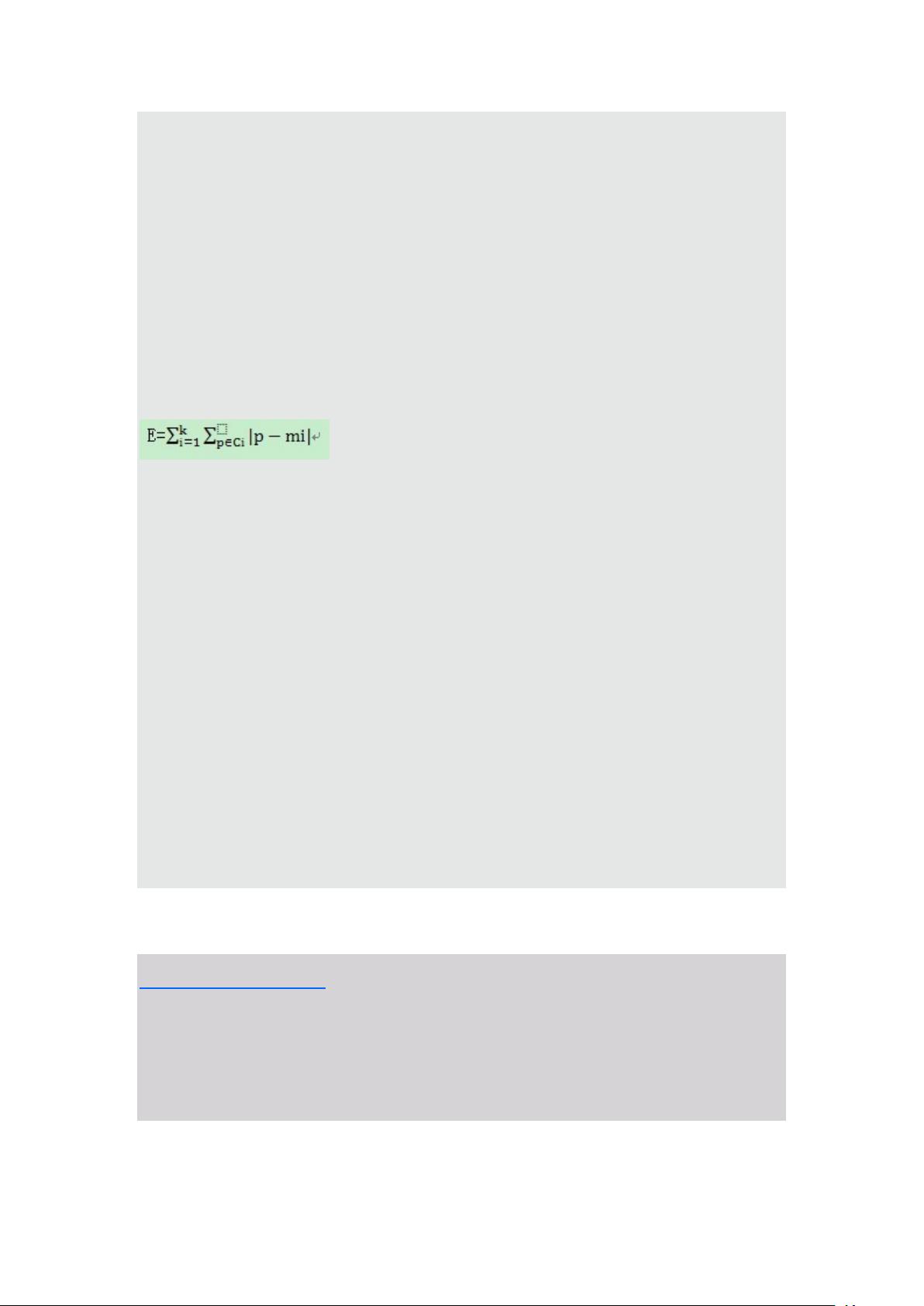

K-MeANS算法的核心是平方误差准则,它衡量的是所有对象到其所属类簇质心的平均距离平方,体现了类簇内部的紧凑性和类簇间的分离度。然而,该算法也存在若干问题:

- **预设簇数**:K值的设定很关键,如果预设错误,可能导致聚类效果不佳。

- **局部最优**:K-MeANS算法可能会陷入局部最优,而不是全局最优解。

- **数值型数据**:只适用于数值型数据,对类别型或混合类型数据处理能力有限。

- **凸形簇假设**:假设聚类结果是凸形的,对于非凸或不规则形状的类簇效果较差。

- **噪声和孤立点**:对噪声数据和孤立点敏感,可能对结果造成显著影响。

K-MeANS算法与EM(期望最大化)算法有一定的关联性,尽管K-MeANS本身并不直接使用概率模型,但它在寻找最优质心的过程中,可以看作是在期望和最大化步骤之间的交替。这种迭代优化过程在处理未知类别标签的无监督学习任务中非常有用,如对无标签数据集进行自动分组。

K-MeANS算法因其简单高效而被广泛使用,但在实际应用中需要谨慎对待其局限性,根据具体数据集的特点选择合适的聚类方法。同时,为了改善K-MeANS的性能,学者们提出了多种变种和改进算法,如K-MeANS++用于更合理的初始质心选择,以及针对非凸和大小差异大的簇的算法。

2024-05-30 上传

2022-07-13 上传

2024-08-01 上传

2024-07-27 上传

2021-10-27 上传

2021-05-18 上传

2021-05-30 上传

2024-10-03 上传

精准小天使

- 粉丝: 37

- 资源: 347

最新资源

- Smoker-Generator:给我照片,我帮你抽烟!

- 三菱包装-mt 高级运动_PLC_q173_三菱_包装机_运动

- Research-report-Classification-system:爬取东方财富的宏观研究的研报,基于LSTM进行情感分析,分类为正向,负向和中性三类

- Sichem:C到C#代码转换器

- 毕业设计&课设--大学毕业设计-校园小助手.zip

- gulp-starter:gulp-starter 项目

- 毕业设计&课设--仿知乎社区问答类App,吉林大学计算机科学与技术学院毕业设计.zip

- oceanhonki

- Excel模板客户登记表格式.zip

- yii2-system-info:有关服务器的信息

- notence:not受notion.so(Alpha:pushpin:)启发的开源个人笔记应用程序

- 对数音符

- protonmail-api::envelope:ProtonMail的Node.js API

- incubator_labview_TCP断线重连_tcp通信

- xiuxian:修仙之路 - 小游戏 玩法同2048

- MyAdGuardFilter:我的AdGuard过滤器