深度学习模型压缩、加速及移动端部署探究

需积分: 0 180 浏览量

更新于2023-11-28

收藏 3.51MB PDF 举报

第十七章 "模型压缩、加速及移动端部署"主要介绍了深度学习模型在移动端部署时所面临的挑战和解决方法。在该章节中,首先对模型压缩进行了理解,包括为什么需要模型压缩和加速,以及模型压缩的必要性及可行性。接着详细讨论了当前深度学习模型压缩方法,包括前端压缩和后端压缩的对比、网络剪枝、网络蒸馏、以及几种轻量化网络结构对比等。同时也介绍了深度学习模型优化加速方法,如TensorRT的加速原理、优化重构模型的方法、以及加速效果等。此外,还分析了影响神经网络速度的四个因素,并提出了如何选择压缩和加速方法以及改变网络结构设计实现模型压缩和加速的建议。

在探讨模型压缩的理论和方法时,本章指出了模型压缩在移动端部署中的重要性。由于移动设备的资源有限,包括计算能力、内存和功耗等方面的限制,因此需要对深度学习模型进行压缩和加速,以便在移动设备上高效地运行。模型压缩的目的是在尽可能少的信息损失的情况下减小模型的体积,增加运行速度并降低功耗。模型压缩的方法主要包括前端压缩和后端压缩,其中前端压缩是指在训练前对模型进行压缩,而后端压缩是指在训练后对模型进行压缩。常见的模型压缩方法包括网络剪枝和网络蒸馏等,这些方法通过减少模型参数和降低模型复杂度来达到模型压缩的效果。

对于深度学习模型的优化加速方法,本章重点介绍了TensorRT的加速原理和加速效果。TensorRT是英伟达推出的用于深度学习模型优化和部署的库,可以有效地减少模型的推理时间和内存占用。通过对模型进行优化重构,并利用GPU的并行计算能力,TensorRT可以显著提高模型的推理速度,特别适用于移动端部署。此外,本章还分析了影响神经网络速度的四个因素,包括模型的结构、硬件设备、数据输入和并行计算方式等。

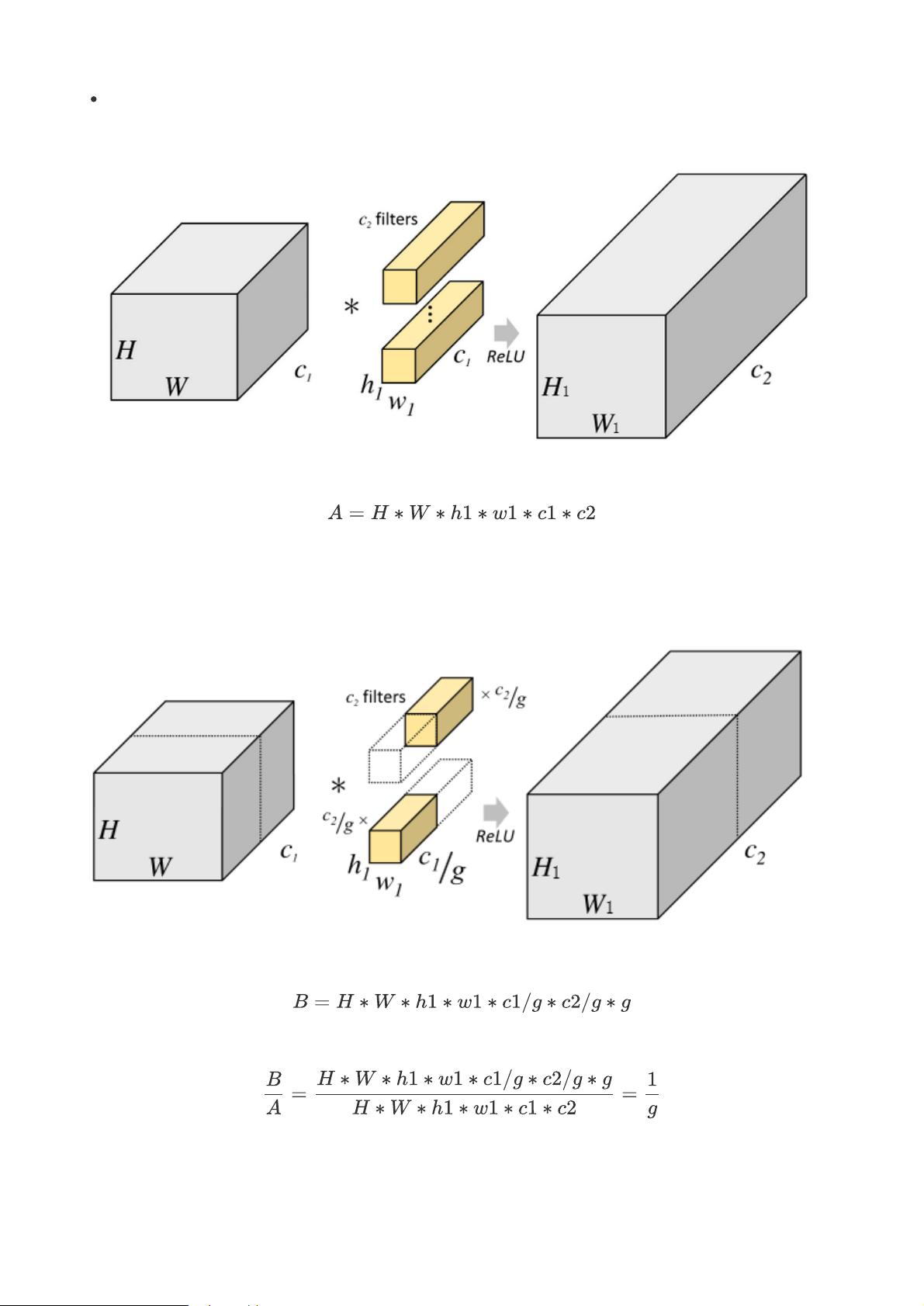

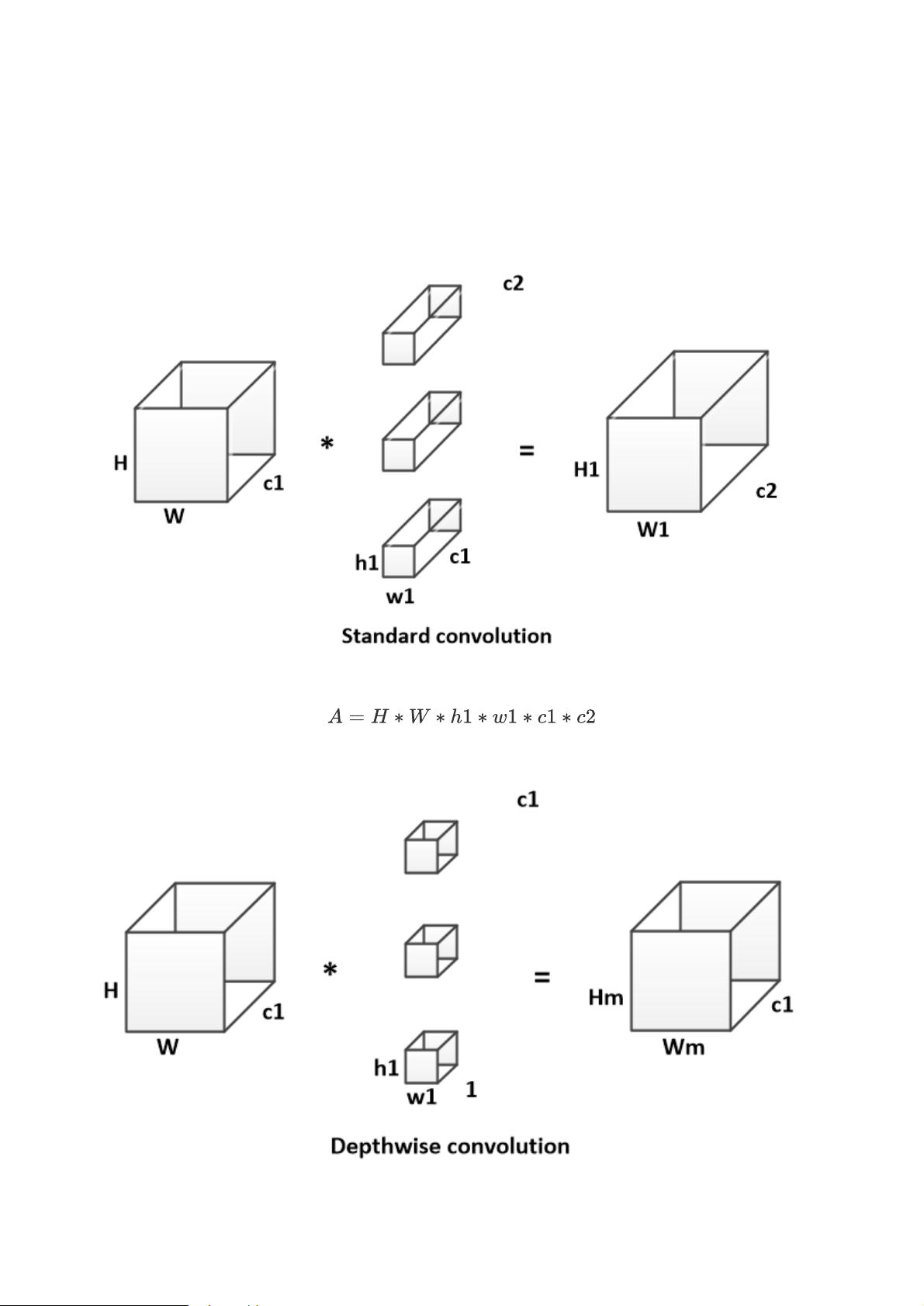

在选择压缩和加速方法以及改变网络结构设计实现模型压缩和加速时,本章给出了一些建议。例如可以通过改变网络结构设计来实现模型压缩和加速,包括使用Group convolution、Depthwise separable convolution等轻量化网络结构,以减少模型参数和计算量。同时,还可以通过减少网络碎片化程度、减少组卷积的数量等方法来改变网络结构,实现模型的压缩和加速。因此,选择合适的压缩和加速方法以及改变网络结构设计是实现模型在移动端部署中高效运行的关键。

总体来说,第十七章 "模型压缩、加速及移动端部署"全面地介绍了深度学习模型在移动端部署中所面临的挑战和解决方法,对模型压缩、加速和优化的理论和方法进行了详细的阐述,并给出了一些建议,对读者在移动端部署深度学习模型时具有一定的指导意义。

2022-08-03 上传

2020-07-27 上传

点击了解资源详情

点击了解资源详情

2023-08-23 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

黄浦江畔的夏先生

- 粉丝: 18

- 资源: 299

最新资源

- 全国江河水系图层shp文件包下载

- 点云二值化测试数据集的详细解读

- JDiskCat:跨平台开源磁盘目录工具

- 加密FS模块:实现动态文件加密的Node.js包

- 宠物小精灵记忆配对游戏:强化你的命名记忆

- React入门教程:创建React应用与脚本使用指南

- Linux和Unix文件标记解决方案:贝岭的matlab代码

- Unity射击游戏UI套件:支持C#与多种屏幕布局

- MapboxGL Draw自定义模式:高效切割多边形方法

- C语言课程设计:计算机程序编辑语言的应用与优势

- 吴恩达课程手写实现Python优化器和网络模型

- PFT_2019项目:ft_printf测试器的新版测试规范

- MySQL数据库备份Shell脚本使用指南

- Ohbug扩展实现屏幕录像功能

- Ember CLI 插件:ember-cli-i18n-lazy-lookup 实现高效国际化

- Wireshark网络调试工具:中文支持的网口发包与分析