深度解析Apache Spark Catalyst:优化框架与结构化数据的力量

需积分: 9 31 浏览量

更新于2024-07-17

收藏 3.1MB PDF 举报

"Apache Spark的Catalyst优化器深度解析"

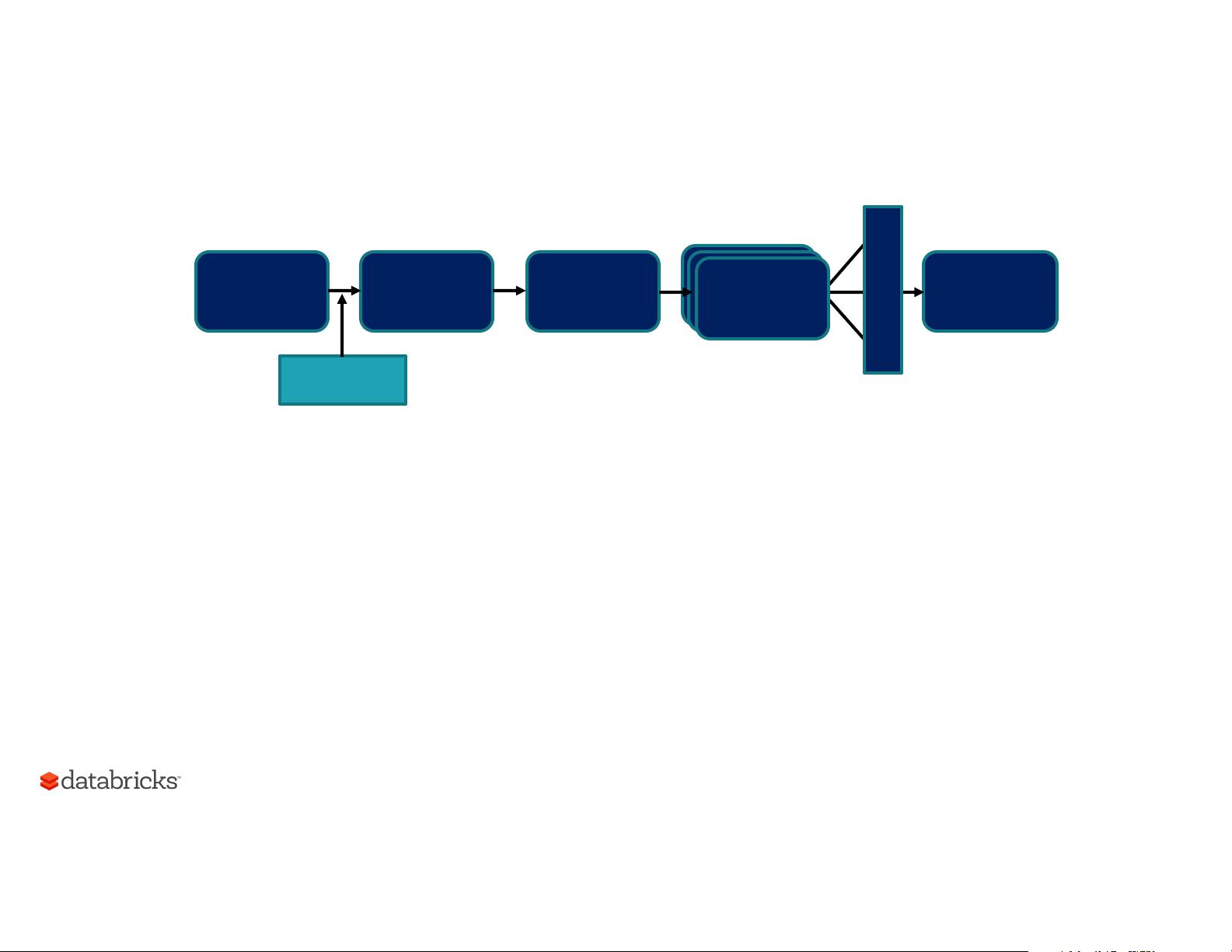

在Spark的世界里,Catalyst是其核心优化器,它扮演着将用户的抽象操作转化为底层执行计划的关键角色。Catalyst PPT是由Herman van Hövell在Spark Summit Europe 2016年布鲁塞尔会议上分享的,旨在为想要深入理解Spark背后的优化技术的学习者提供详尽的基础教学资料。

Spark是由Databricks创建的,这家公司对Spark的代码贡献超过了75%,致力于将Spark带入企业级环境,打造一个实时的数据平台。Databricks提供的是一种全面的解决方案,支持数据科学和工程团队在一个统一平台上协作,无论是使用Spark Core的Resilient Distributed Datasets (RDDs),还是更高级的数据处理工具如DataFrame、Dataset、SQL查询、机器学习(ML)管道、结构化流、JSON处理、JDBC接口等。

Catalyst的核心理念在于结构化数据的使用。虽然结构限制了某些表达的可能性,但实践上,大部分计算需求可以通过结构化的方式得以满足。通过限制操作空间,Catalyst能够进行更有效的优化,使得性能提升明显。例如,相比于使用RDD进行复杂的聚合操作(如map、reduceByKey和map后进一步进行除法计算),通过Spark SQL的语法,可以简洁地实现相同的功能,并且在运行时性能上,尤其是处理大规模数据(如1000万条记录)时,SQL查询通常更为高效。

数据帧(DataFrame)是Spark中的一个重要组件,它提供了基于列的编程方式,使得数据处理更加直观和易于理解。与RDD相比,DataFrame更易于进行数据清洗、转换和分析,同时Catalyst会自动推导出高效的执行计划,从而提高性能。

Catalyst PPT深入剖析了Spark如何通过优化器利用数据结构进行高效计算,包括从RDD到DataFrame的转变,以及如何通过SQL查询进行统一的、高性能的数据处理。学习这份PPT,不仅有助于理解Spark的内部工作原理,还能提升在实际项目中优化性能的能力。无论是数据科学家还是工程师,理解和掌握Catalyst都是提高Spark应用效能的关键一步。

2009-04-17 上传

2023-06-08 上传

2023-12-01 上传

2019-07-09 上传

2021-09-10 上传

2020-09-21 上传

2010-06-24 上传

Fayne_bupt

- 粉丝: 0

- 资源: 6

最新资源

- 高清艺术文字图标资源,PNG和ICO格式免费下载

- mui框架HTML5应用界面组件使用示例教程

- Vue.js开发利器:chrome-vue-devtools插件解析

- 掌握ElectronBrowserJS:打造跨平台电子应用

- 前端导师教程:构建与部署社交证明页面

- Java多线程与线程安全在断点续传中的实现

- 免Root一键卸载安卓预装应用教程

- 易语言实现高级表格滚动条完美控制技巧

- 超声波测距尺的源码实现

- 数据可视化与交互:构建易用的数据界面

- 实现Discourse外聘回复自动标记的简易插件

- 链表的头插法与尾插法实现及长度计算

- Playwright与Typescript及Mocha集成:自动化UI测试实践指南

- 128x128像素线性工具图标下载集合

- 易语言安装包程序增强版:智能导入与重复库过滤

- 利用AJAX与Spotify API在Google地图中探索世界音乐排行榜