支持向量机(SVM)深度解析:原理与特点

需积分: 17 154 浏览量

更新于2024-07-19

收藏 4.51MB PPT 举报

"本文主要介绍了支持向量机(SVM),一种基于统计学习理论的机器学习方法,用于分类和回归分析。SVM的核心是寻找一个最优超平面,以最大化类别之间的间隔,从而达到最佳的分类效果。"

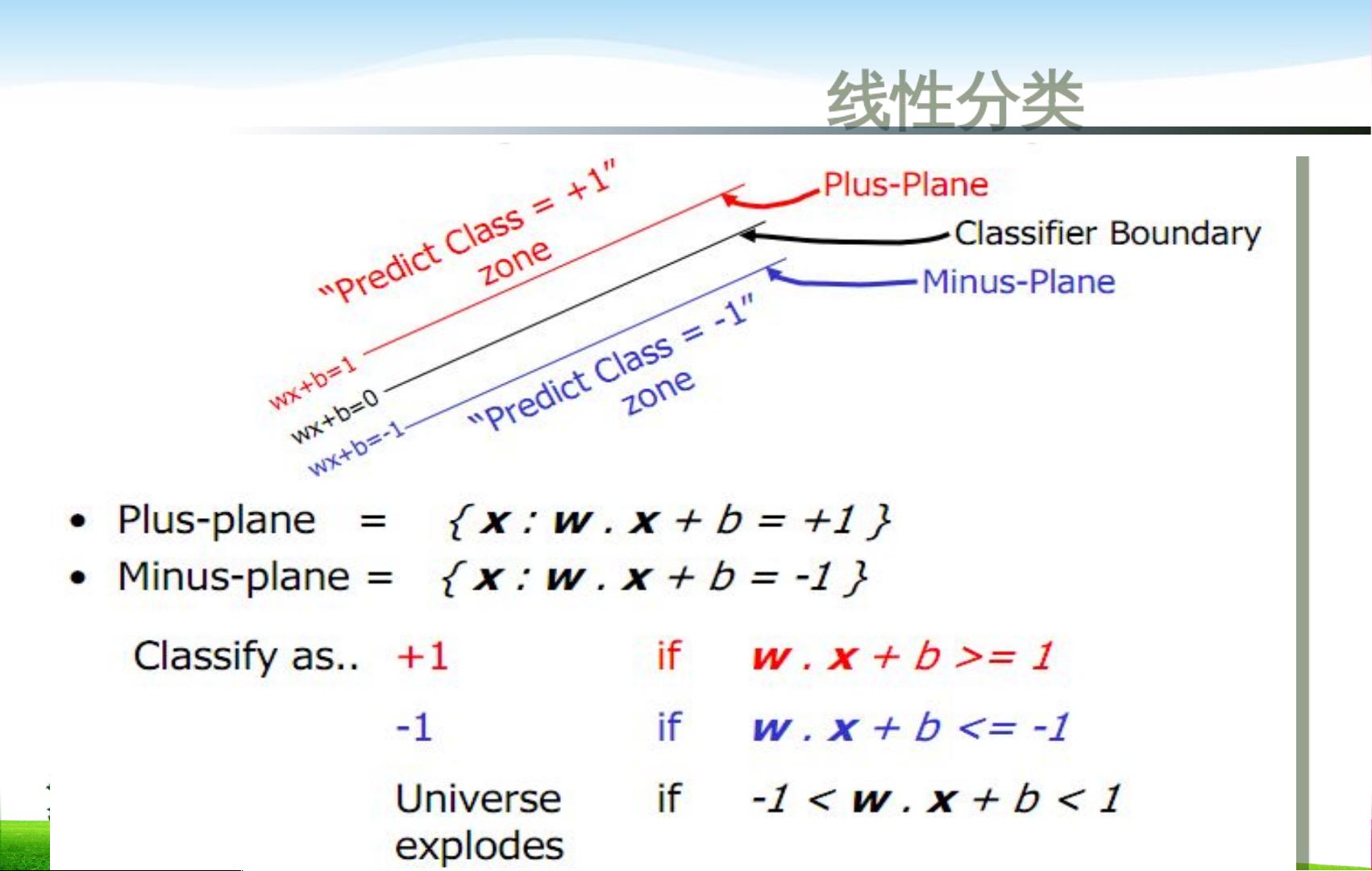

支持向量机(SVM)是一种强大的监督学习算法,全称为支持向量机,它的核心思想是通过找到一个最优超平面来分离不同类别的数据点。在这个过程中,"支持向量"是位于超平面最近的数据点,它们对于构建分类边界至关重要,因为它们决定了超平面的位置。

SVM的特点之一在于其使用了核函数,这是处理非线性分类问题的关键。核函数能够将原始数据映射到高维空间,使得在高维空间中原本难以区分的数据变得可以线性分离。常见的核函数有线性核、多项式核、高斯核(径向基函数,RBF)等,选择合适的核函数对于SVM的性能至关重要。

在寻找最优超平面时,SVM引入了松弛变量来处理可能存在的误分类情况,使得模型具有一定的鲁棒性。目标是找到最大化分类间隔的超平面,分类间隔是指两个类别之间的最短距离,这个距离越大,分类器的泛化能力通常越强。为了实现这一目标,SVM的优化问题转化为在满足所有样本点至少距离超平面1个单位的约束条件下,最小化超平面的范数(通常是L2范数)。

在实际操作中,SVM首先通过拉格朗日乘子法将约束条件纳入目标函数,形成一个凸优化问题,然后采用梯度下降法或更高级的优化算法如SMO(Sequential Minimal Optimization)来求解这个问题,找出最优的权重向量w和偏置项b。

SVM的应用广泛,不仅可以用于二分类问题,还可以通过一对多的方式扩展到多分类问题,并且在小样本、高维特征空间中表现优秀。此外,SVM还常用于文本分类、图像识别、生物信息学等领域。

SVM是一种高效且灵活的机器学习工具,它利用统计学习理论和优化技术解决了复杂数据集的分类问题,尤其在处理非线性数据时显示出强大的性能。然而,选择合适的核函数、调整参数以及处理大规模数据集时的计算效率都是使用SVM时需要考虑的关键因素。

2021-05-08 上传

2020-12-24 上传

2011-03-08 上传

2021-10-01 上传

小路不迷路

- 粉丝: 0

- 资源: 5

最新资源

- Aspose资源包:转PDF无水印学习工具

- Go语言控制台输入输出操作教程

- 红外遥控报警器原理及应用详解下载

- 控制卷筒纸侧面位置的先进装置技术解析

- 易语言加解密例程源码详解与实践

- SpringMVC客户管理系统:Hibernate与Bootstrap集成实践

- 深入理解JavaScript Set与WeakSet的使用

- 深入解析接收存储及发送装置的广播技术方法

- zyString模块1.0源码公开-易语言编程利器

- Android记分板UI设计:SimpleScoreboard的简洁与高效

- 量子网格列设置存储组件:开源解决方案

- 全面技术源码合集:CcVita Php Check v1.1

- 中军创易语言抢购软件:付款功能解析

- Python手动实现图像滤波教程

- MATLAB源代码实现基于DFT的量子传输分析

- 开源程序Hukoch.exe:简化食谱管理与导入功能