时空一致性视频框模板生成:解决视频对象分割的数据效率问题

PDF格式 | 1.05MB |

更新于2025-01-16

| 129 浏览量 | 举报

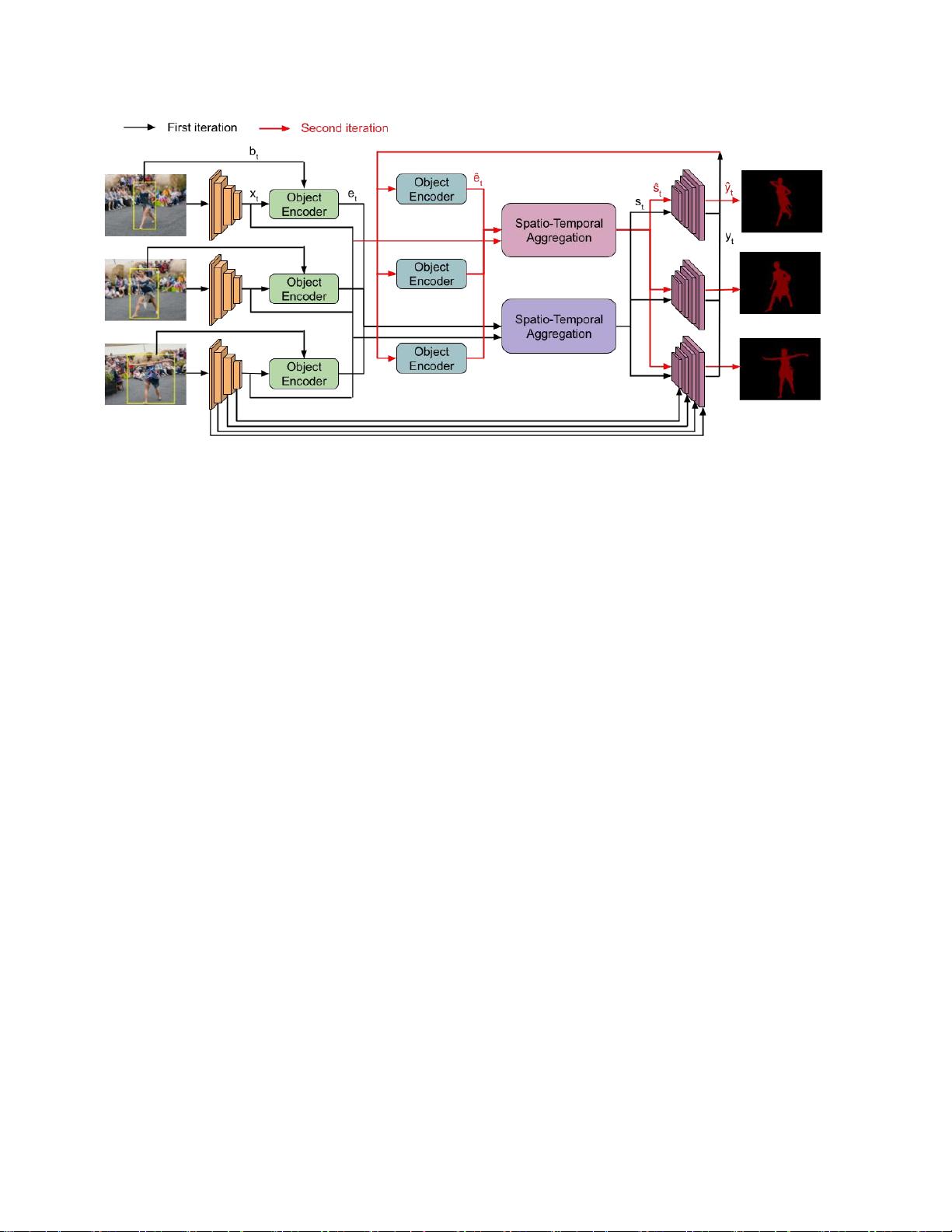

视频框模板生成:基于时空一致性的视频对象分割方法是一种先进的计算机视觉技术,它旨在解决视频对象分割中数据标注稀少的问题。传统的深度学习方法依赖于大规模的像素级分割标签,这在实际应用中极其耗时且昂贵。针对这一限制,该研究提出了一种创新的解决方案,即通过利用视频中的边界框注释来生成精确的分割掩模。

研究人员ZhaoBin等人来自苏黎世ETH计算机视觉实验室,他们开发了一种时空聚合模块,该模块能够在多帧之间捕捉和整合对象和背景的动态变化,从而增强对物体的识别和分割准确性。与仅依赖单帧的边界框预测相比,这种方法能够更好地处理复杂场景中对象的运动和遮挡问题,如图1所示,通过视频序列可以更准确地区分汽车和滑板车。

关键点包括:

1. 时空一致性:方法的核心在于跨帧的时空信息融合,确保对象在整个视频序列中的一致性,即使在不同帧间对象位置或姿态发生变化时也能保持正确分割。

2. 边界框注释:研究者利用对象绑定框作为训练数据,这些框提供了对目标区域的约束,相较于像素级注解,其标注成本低且速度快,对于大规模视频应用具有显著优势。

3. 视频对象分割网络(VOS):通过将准确的生成掩模应用于VOS网络的跟踪域,即使在仅使用手动框注释的情况下,也能训练出性能强大的模型。这种方法允许现有VOS技术跨越标注壁垒,提升其泛化能力和在新场景下的表现。

4. 实际应用:这项工作对自动驾驶、监控和视频编辑等领域的应用具有重要价值,有助于简化模型部署过程,使得现有方法能够利用较少的标注资源实现更高效的视频对象分割。

成果方面,研究团队提供的代码和模型已在国家最先进的跟踪基准上展示了优越的表现,证明了该方法的有效性和实用性。通过结合弱监督的边界框注释和时空一致性,视频框模板生成算法为解决视频对象分割的标注问题开辟了一条新的道路。

相关推荐

cpongm

- 粉丝: 6

最新资源

- MATLAB实现ART与SART算法在医学CT重建中的应用

- S2SH整合版:快速搭建Struts2+Spring+Hibernate开发环境

- 托奇卡项目团队成员介绍

- 提升外链发布效率的SEO推广神器——搜易达网络推广大师v2.035

- C#打造简易记事本应用详细教程

- 探索虚拟现实地图VR的奥秘

- iOS模拟器屏幕截图新工具

- 深入解析JavaScript在生活应用开发中的运用

- STM32F10x函数库3.5中文版详解与应用

- 猎豹浏览器v6.0.114.13396 r1:安全防护与网购敢赔

- 掌握JS for循环输出的最简洁代码技巧

- Java入门教程:TranslationFileGenerator快速指南

- OpenDDS3.9源码解析及最新文档指南

- JavaScript提示框插件:鼠标滑过显示文章摘要

- MaskRCNN气球数据集:优质图像识别资源

- Laravel日志查看器:实现Apache多站点日志统一管理