双流模型CVL:突破细粒度图像分类的局限

95 浏览量

更新于2025-01-16

收藏 1.65MB PDF 举报

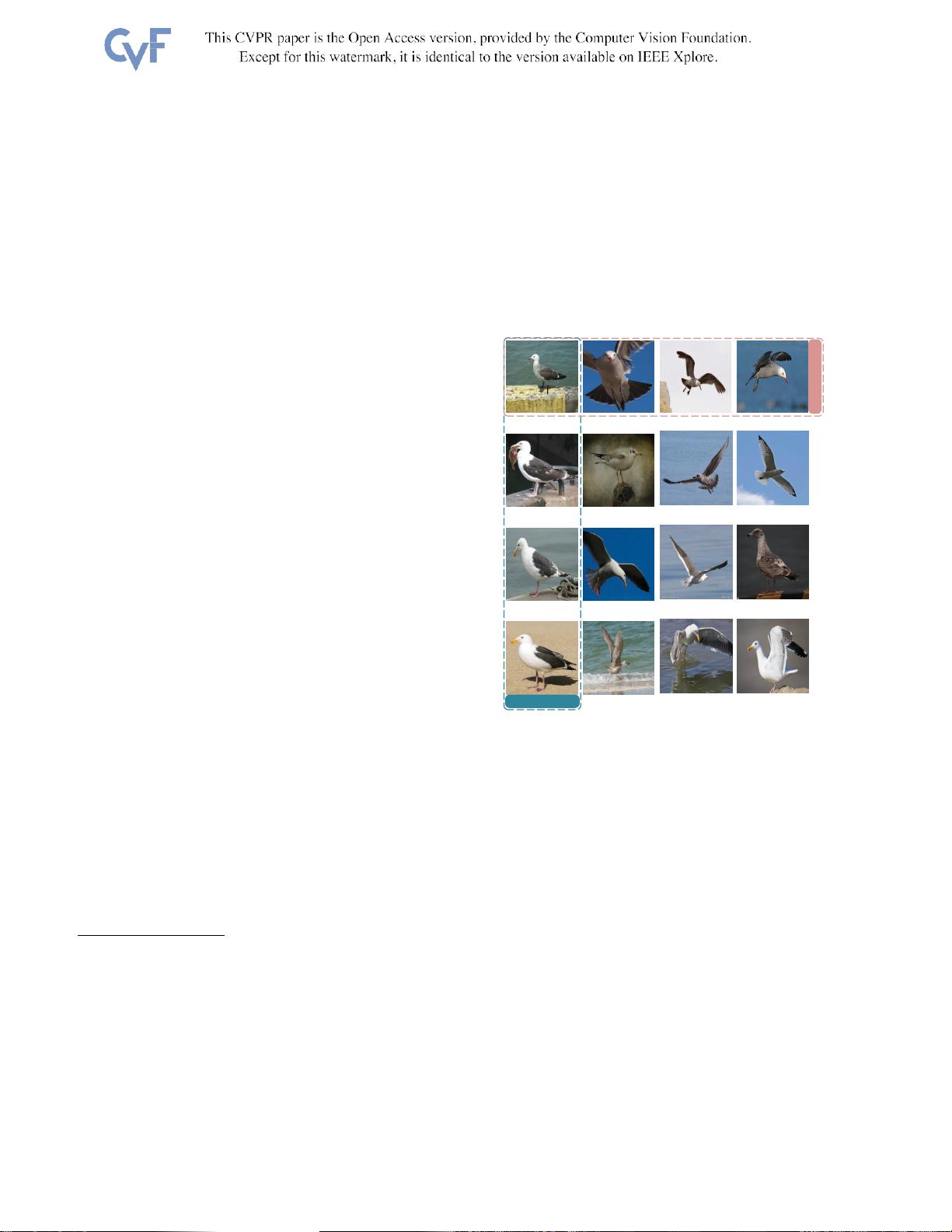

本文探讨了细粒度图像分类的挑战,主要关注类内方差大、类间方差小的问题,这是导致识别困难的关键因素。为了应对这一问题,研究者们通常采用部分检测模型来提高分类精度。然而,这种方法存在两个局限性:一是并非所有检测到的零件都对分类有帮助;二是仅依赖零件位置或属性注释无法提供足够的细粒度视觉描述。

针对这些局限性,文章提出了结合视觉和语言的双流模型(CVL)。CVL模型由两个核心组成部分构成:视觉流和语言流。视觉流通过深度卷积神经网络(CNN)从原始图像中学习深层特征,而语言流则利用自然语言描述来突出图像中的关键差异性部分或特征。这种语言描述提供了识别子类别所需的详细视觉信息,能够更准确地编码显著的视觉方面。

通过将这两个流结合,CVL模型能够捕获更丰富的信息,从而实现更高的分类精度。在CUB-200-2011数据集上的实验结果显示,CVL方法在与12种先进方法的比较中表现出最佳性能,验证了其有效性和优越性。

细粒度图像分类在实际应用中,例如鸟类识别、花卉分类或车辆型号识别等领域,有着重要的价值。随着深度学习技术的发展,模型的性能有望持续提升,为精细化的图像识别任务提供更强大的支持。CVL模型的创新在于它整合了视觉和语言两种信息源,为解决细粒度图像分类的挑战提供了新的思路。这种跨模态的学习方法不仅提高了分类准确性,也为未来的研究打开了新的可能性,比如在更多领域中融合多模态信息进行复杂任务的处理。

184 浏览量

2022-06-11 上传

140 浏览量

104 浏览量

2025-01-15 上传

272 浏览量

127 浏览量

150 浏览量

102 浏览量

cpongm

- 粉丝: 5

最新资源

- USB转串口驱动下载:简化连接操作

- Eglot-grammarly:Emacs中的Grammarly语法检查集成

- Element-UI官方组件库文档深度解析

- Goridge: 高性能PHP与Golang间RPC编码解码库

- Instagram标签数据分析:从抓取到生成Word2Vec和TF-IDF模型

- 掌握JavaScript:制作交互式简历的学习之旅

- Creo 3.0中文版工程图创建与编辑视频教程

- 掌握OpenCV+Python,第三版案例研究

- 优化后的Unity电子书插件支持快速异步加载图片

- JavaScript项目实践:js-temp-project探索

- timesince.js:让时间显示更友好,生成易读的时间描述

- Word2vec管道:自然语言处理的全栈实施指南

- PPT文字倒影特效模板下载

- Creo参数化齿轮设计视频教程下载

- 邮件服务器存档配置指南与mailserver-config

- monkeylearn包使用教程:R语言中的文本分析工具