边缘化潜在语义编码器:零次学习新方法

144 浏览量

更新于2025-01-16

收藏 1.67MB PDF 举报

"这篇论文提出了一种用于零次学习的边缘化潜在语义编码器(MLSE),旨在解决视觉识别中的零次学习问题,即在没有见过的新类别上进行识别。传统的有监督学习方法需要大量标注数据,而零次学习则试图通过已有的类别知识推断新类别。本文的核心贡献是设计了一个能够增强视觉语义函数泛化能力的框架,通过边缘化策略处理语义描述的不足和类别间的领域转移问题。

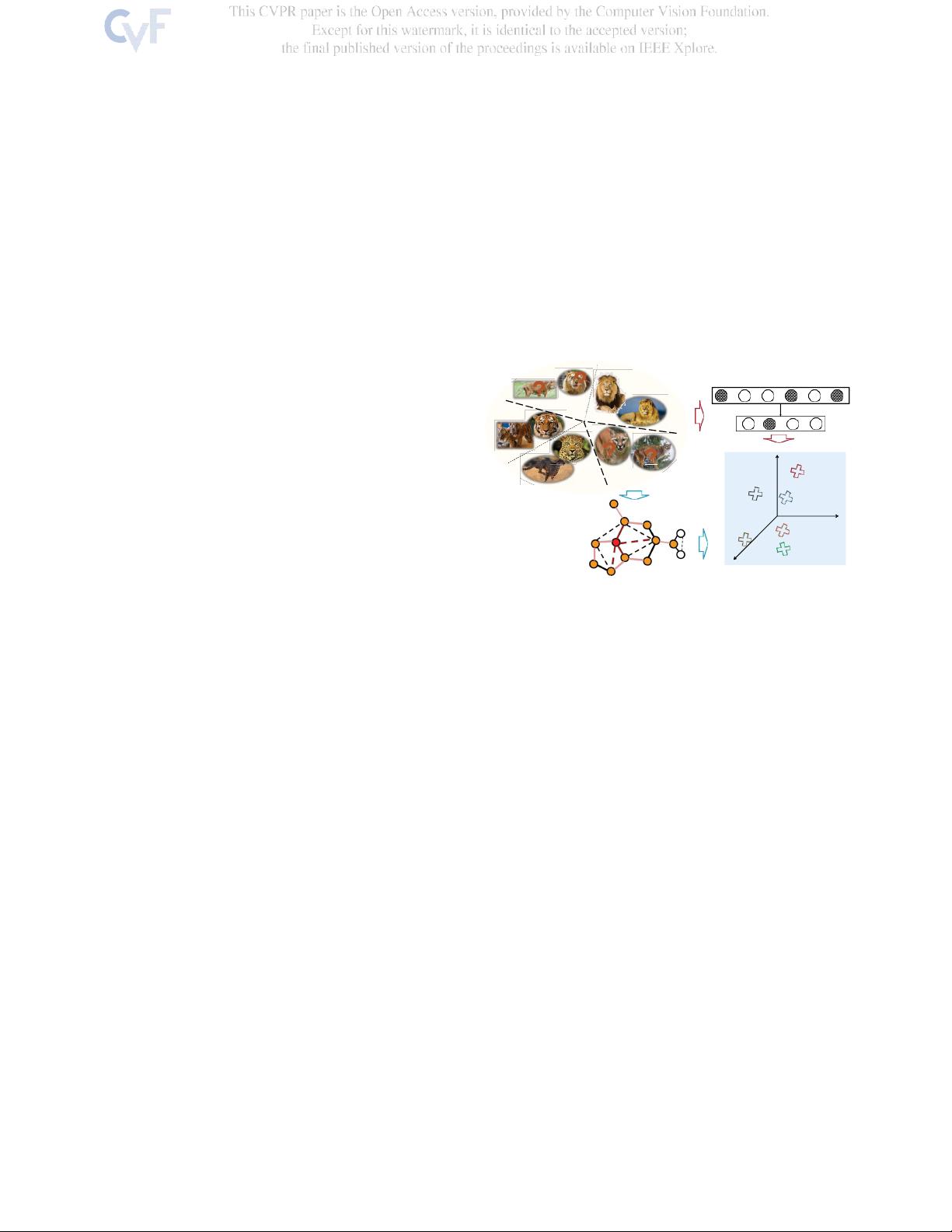

零次学习(Zero-shot learning,ZRL)的关键在于如何利用已知类别的语义信息去识别未知类别。通常,这需要将视觉特征与语义表示相结合。论文中提出的MLSE模型包含两个主要部分:1) 视觉特征的学习,这一步是从可见类别中提取丰富的特征;2) 潜在语义的边缘化,通过自适应图重建方案,利用提供的语义信息学习潜在的语义表示。这个过程增强了模型对未见过类别的泛化能力。

边缘化潜在语义编码器(MLSE)的工作机制是构建一个可以连接视觉特征和潜在语义的桥梁。在边缘化腐败的视觉特征(E(X))和潜在语义Z之间,通过语义编码器(WE(X))建立联系。同时,潜在语义Z是在给定的语义A上自适应地学习的。这一过程有助于克服语义描述的局限性,使得模型能从已知类别中学习到的特征迁移到未知类别。

论文中提到,人类的认知学习机制启发了这种学习算法的设计。通过发现并理解可见类别的内在视觉语义,然后将这些映射应用到未见类别,零次学习试图模拟这一过程。常见的方法是使用词嵌入或预定义的语义属性来连接视觉特征和语义空间。

尽管零次学习在理论上很有吸引力,但在实际应用中仍面临两大挑战:第一,人工标注的语义可能不足以全面描述视觉样本的复杂性;第二,已知类别和未知类别之间可能存在显著的领域差异。MLSE通过边缘化策略和自适应图重建解决了这些问题,提高了模型在零次学习场景下的性能。

实验部分展示了在标准的零次学习基准测试上的结果,证明了MLSE相对于其他先进的零次学习方法具有优越的表现。这些实验结果进一步验证了该模型的有效性和泛化能力,对于推动视觉识别领域的零次学习研究具有重要意义。

这篇论文提出的边缘化潜在语义编码器是一种创新的方法,它通过增强视觉特征学习和潜在语义表示的边缘化,提高了模型在面对新类别时的识别准确性和泛化性能,对解决零次学习问题提供了新的视角和解决方案。"

118 浏览量

107 浏览量

点击了解资源详情

点击了解资源详情

125 浏览量

点击了解资源详情

304 浏览量

299 浏览量

cpongm

- 粉丝: 6

最新资源

- VB通过Modbus协议控制三菱PLC通讯实操指南

- simfinapi:R语言中简化SimFin数据获取与分析的包

- LabVIEW温度控制上位机程序开发指南

- 西门子工业网络通信实例解析与CP243-1应用

- 清华紫光全能王V9.1软件深度体验与功能解析

- VB实现Access数据库数据同步操作指南

- VB实现MSChart绘制实时监控曲线

- VC6.0通过实例深入访问Excel文件技巧

- 自动机可视化工具:编程语言与正则表达式的图形化解释

- 赛义德·莫比尼:揭秘其开创性技术成果

- 微信小程序开发教程:如何实现模仿ofo共享单车应用

- TrueTable在Windows10 64位及CAD2007中的完美适配

- 图解Win7搭建IIS7+PHP+MySQL+phpMyAdmin教程

- C#与LabVIEW联合采集NI设备的电压电流信号并创建Excel文件

- LP1800-3最小系统官方资料压缩包

- Linksys WUSB54GG无线网卡驱动程序下载指南