大视差图像拼接:基于变形残差的鲁棒算法

67 浏览量

更新于2025-01-16

收藏 1.49MB PDF 举报

图像拼接是计算机视觉领域的一个关键技术,其目的是融合来自不同视角的图像,形成具有更宽视野的图片。传统的方法通常包括特征检测、匹配、图像扭曲模型估计以及最终的像素合成。这些步骤旨在将两个图像对齐,消除因视差造成的场景不一致性。

然而,当场景并非完全平面,特别是存在深度差异和大视角差的情况下,传统的单应性模型(基于平面场景的假设)就显得力不从心。大视差图像拼接面临着更大的挑战,因为物体在不同视图中的相对位置会发生显著变化,导致视差伪影的出现,这是当前图像拼接方法的主要瓶颈。

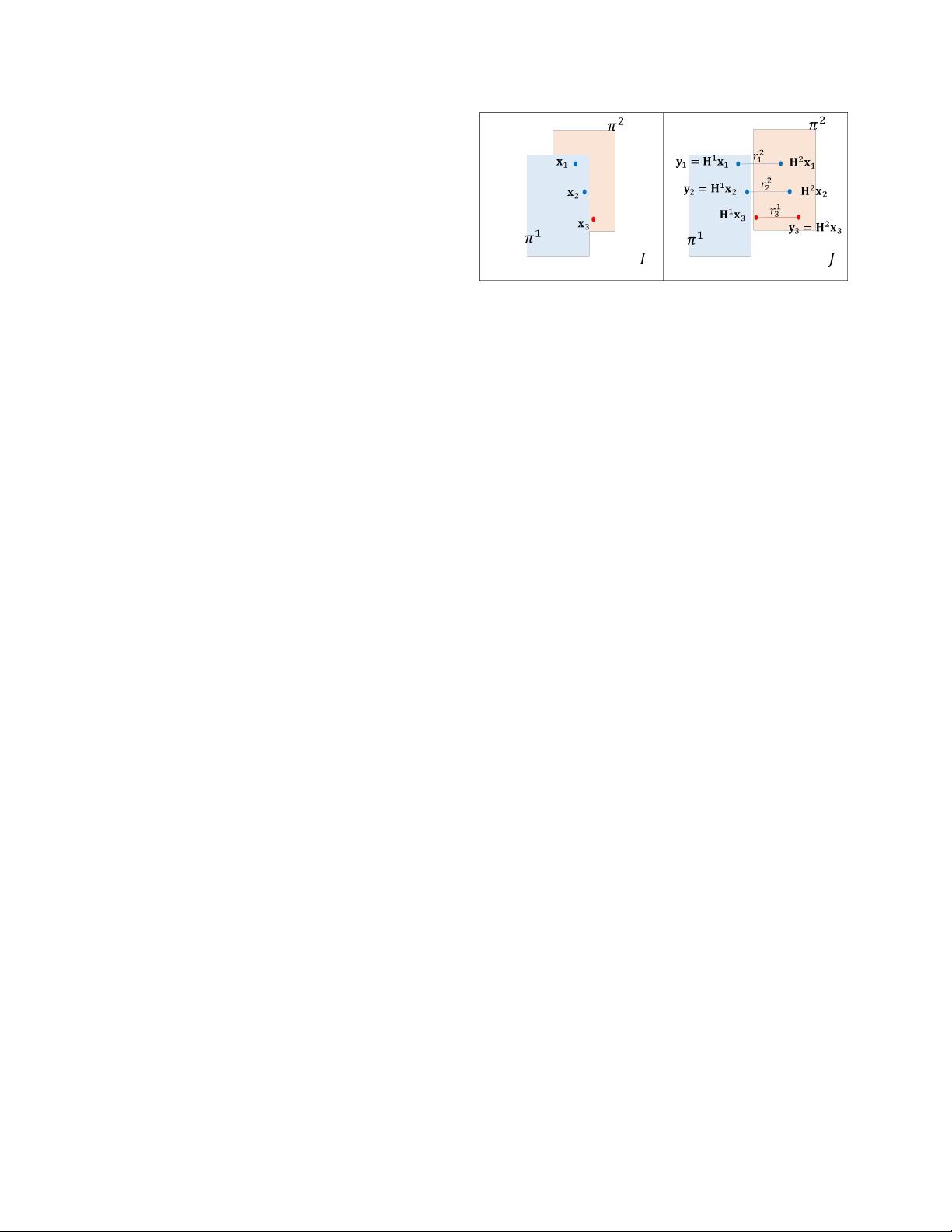

本文提出了一种创新的基于变形残差的大视差图像拼接方法,作者Kyuyul Lee和Jae-Young Sim来自韩国蔚山的电气和计算机工程学院。他们的研究重点在于解决大视差场景下的图像拼接问题。首先,他们通过检测并匹配特征点来估计多个单应性,这一步骤旨在找出最佳的局部对应关系。接着,引入了新的“扭曲残差”概念,用于评估每个特征匹配相对于不同单应性的变形程度。

为减轻视差伪影的影响,算法采用了超像素分割技术,将输入图像分解为较小的、具有相似纹理的区域。然后,针对每个超像素,通过寻找并最小化扭曲残差加权的特征匹配误差,计算出最优的自适应单应性。这种方法允许对图像进行更精细的变形调整,以更好地适应场景的复杂性。

实验结果显示,这个新算法在处理大视差图像时展现出更好的性能,无论是主观质量还是客观评价指标,都优于现有的拼接方法。这对于增强全景图像的生成质量、360°全景相机和环绕视图系统的应用,以及图像编辑软件如Adobe Photoshop和Autostitch中的图像合成都有着重要的实际价值。

总结来说,本文的工作不仅提升了图像拼接的鲁棒性,还引入了更为精细的处理策略,对于处理非平面场景和大视差条件下的图像融合具有重要意义。这一研究成果有望推动计算机视觉领域的进一步发展。

520 浏览量

198 浏览量

107 浏览量

186 浏览量

198 浏览量

828 浏览量

2021-09-19 上传

cpongm

- 粉丝: 6

最新资源

- Saber仿真下的简化Buck环路分析与TDsa扫频

- Spring框架下使用FreeMarker发邮件实例解析

- Cocos2d捕鱼达人路线编辑器开发指南

- 深入解析CSS Flex布局与特性的应用

- 小学生加减法题库自动生成软件介绍

- JS颜色选择器示例:跨浏览器兼容性

- ios-fingerprinter:自动化匹配iOS配置文件与.p12证书

- 掌握移动Web前端高效开发技术要点

- 解决VS中OpenGL程序缺失GL/glut.h文件问题

- 快速掌握POI技术,轻松编辑Excel文件

- 实用ASCII码转换工具:轻松实现数制转换与查询

- Oracle ODBC补丁解决数据源配置问题

- C#集成连接器的开发与应用

- 电子书制作教程:你的文档整理助手

- OpenStack计费监控:使用collectd插件收集统计信息

- 深入理解SQL Server 2008 Reporting Services