HWT:基于Transformer的风格化手写文本生成方法

PDF格式 | 1.7MB |

更新于2025-01-16

| 164 浏览量 | 举报

"本文介绍了一种名为‘手写变形金刚’(Handwriting Transformer, HWT)的新型基于Transformer的风格手写文本生成方法,旨在学习风格与内容的交织,并捕捉全局和局部的风格模式。HWT利用自注意力机制来处理长距离和短距离的关系,以编码全局和局部的风格特征。此方法是首次将Transformer架构应用于风格化手写文本生成,能生成逼真的手写文本图像,并在各种评估中表现优越。HWT可处理任意长度的文本和任何风格,即使在训练时未见过的单词和风格也能生成真实感的手写图像。项目代码可在GitHub上找到:https://github.com/ankanbhunia/Handwriting-Transformer"

1. 引言

手写文本生成是一个复杂的问题,特别是当涉及到风格和词汇的多样性时。这项技术对那些因身体障碍无法书写的人尤其有用,也可以用于生成额外的数据来训练深度学习的手写文本识别模型,或者将笔记和备忘录从一种语言转换为另一种语言。手写变形金刚关注的是生成具有任意长度和多种书法特征的无约束手写文本,同时模仿特定的写作风格。

2. 方法

HWT模型基于Transformer架构,它包含一个编码器和一个解码器,编码器通过自注意力机制捕获风格样本内的长距离和短距离关系,解码器则根据查询字符收集风格特征。这种设计使得HWT不仅能捕捉全局风格(如整体倾斜),还能模仿局部风格(如字符样式和连字),从而生成更逼真的手写文本图像。

3. 实验与评估

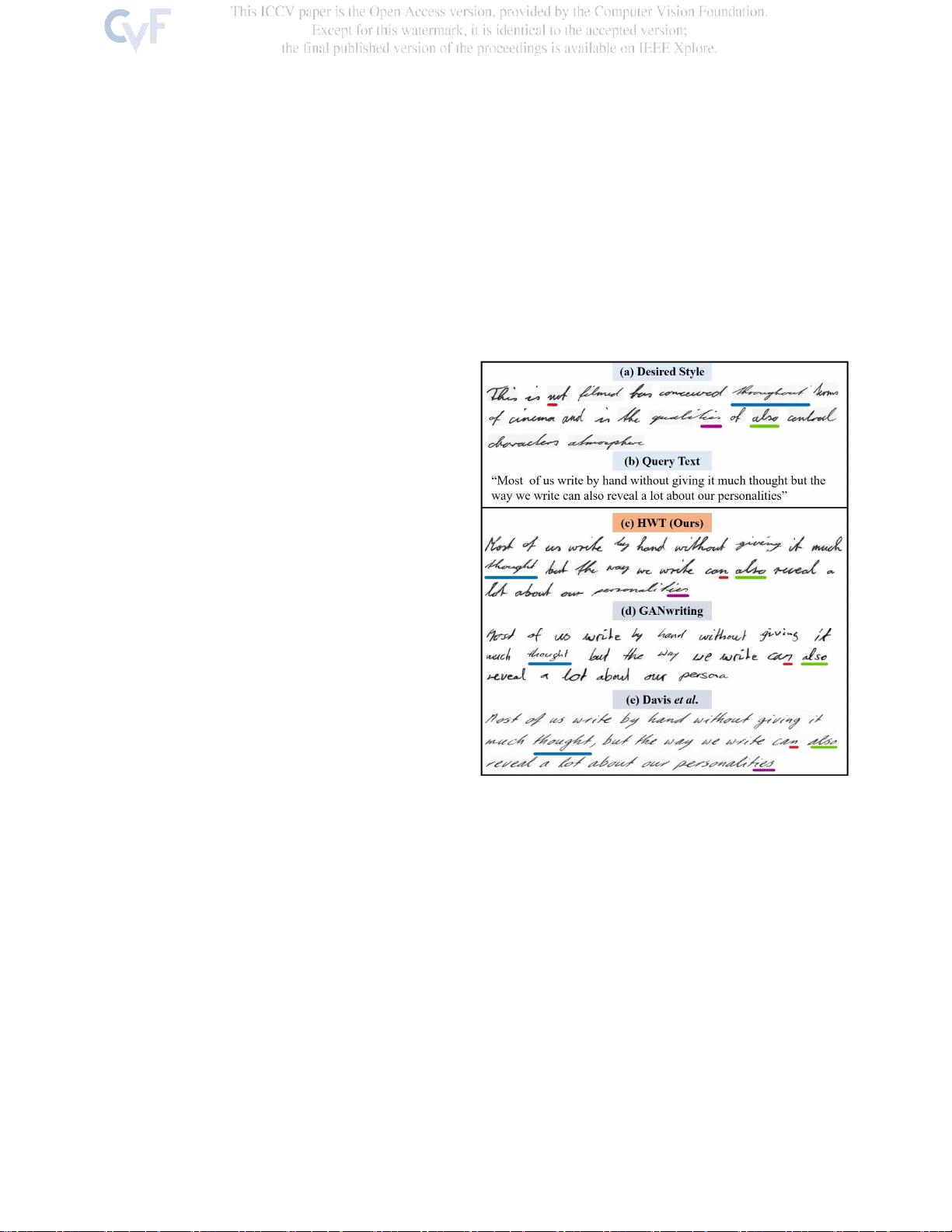

通过广泛的定性、定量和基于人类的评价,HWT显示出了优于现有先进方法的表现。在对比实验中,例如与GANwriting和Davis等方法的比较,HWT在模仿看不见的写作风格时,能够更好地同时复制全局和局部风格,生成更接近实际手写的图像。

4. 应用与局限

HWT的应用不仅限于辅助书写,还可以用于个性化字体设计、历史文档复原和手写识别模型的训练增强。然而,尽管HWT在概括未知风格和单词方面表现出色,但可能仍存在对于某些极端或复杂风格的局限性,这需要进一步的研究和优化。

5. 结论

手写变形金刚是风格化手写文本生成领域的创新尝试,其基于Transformer的设计使得它能够有效地处理风格与内容的复杂关系。未来的工作可能涉及提高模型的泛化能力,处理更多样化的写作风格,以及探索更多的应用场景。

6. 可视化示例

文中提供了HWT生成的手写文本图像与现有方法的对比,直观地展示了HWT在细节和真实性上的优势。

7. 讨论与展望

尽管HWT在生成逼真手写文本方面取得了进展,但如何确保生成文本的可读性和一致性,以及如何适应动态变化的书写风格仍然是需要解决的问题。未来的研究可能会探索如何结合其他深度学习技术,如条件随机场或递归神经网络,以进一步提升生成效果。

相关推荐

521 浏览量

469 浏览量

cpongm

- 粉丝: 6

最新资源

- 武汉大学数字图像处理课程课件精要

- 搭建个性化知识付费平台——Laravel开发MeEdu教程

- SSD7练习7完整解答指南

- Android中文API合集第三版:开发者必备指南

- Python测试自动化实践:深入理解更多测试案例

- 中国风室内装饰网站模板设计发布

- Android情景模式中音量定时控制与铃声设置技巧

- 温度城市的TypeScript实践应用

- 新版高通QPST刷机工具下载支持高通CPU

- C++实现24点问题求解的源代码

- 核电厂水处理系统的自动化控制解决方案

- 自定义进度条组件AMProgressView用于统计与下载进度展示

- 中国古典红木家具网页模板免费下载

- CSS定位技术之Position-master解析

- 复选框状态持久化及其日期同步技术

- Winform版HTML编辑器:强大功能与广泛适用性