深度学习驱动的姿势引导人体图像修复与再合成

PDF格式 | 1.34MB |

更新于2025-01-16

| 31 浏览量 | 举报

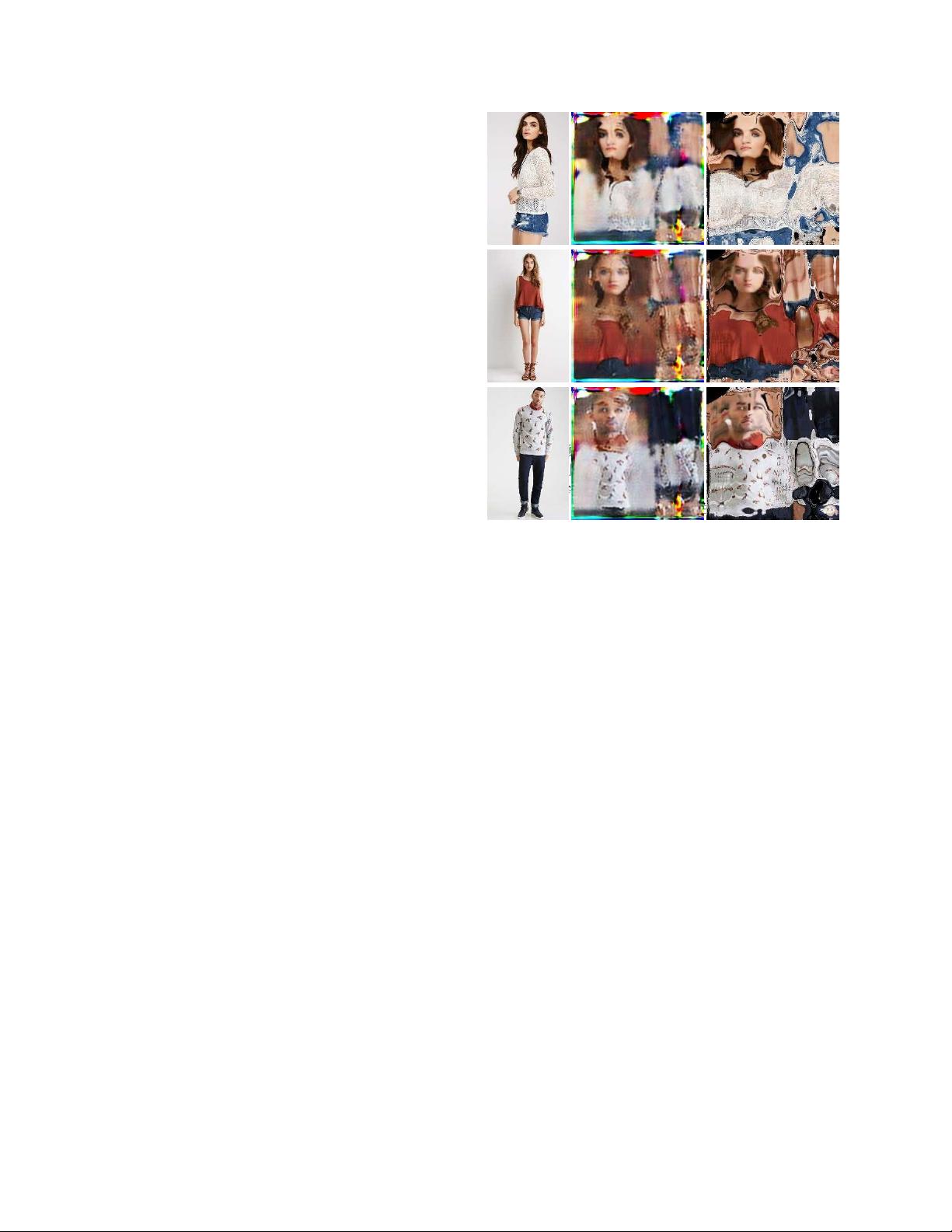

"这篇论文提出了一种新的深度学习方法,专注于姿态引导的人体图像纹理修复,用于人体照片再合成。该方法特别适用于处理因姿态变化而导致的图像修复问题,尤其在增强现实和零售领域有广泛应用前景。"

文章的核心是介绍了一种深度学习技术,它能以新的姿势和视角重新合成人体图像。此技术由两个深度生成的卷积神经网络(ConvNets)组成。第一个网络负责从输入图像中的一小部分纹理来估计整个身体表面的纹理,即纹理完成或修复。由于输入图像通常只能看到人体的一部分,因此需要一种方法来推断并填充未观察到的区域。

针对这一挑战,论文提出了一种新颖的纹理估计策略,利用了人体的自然对称性。传统的方法,如直接的图像到图像转换,往往在处理未知位置的颜色预测时产生模糊的纹理,因为颜色会在大量输入位置上被平均。为了解决这个问题,提出的修复网络并不直接处理纹理元素的颜色,而是估计输入图像与纹理之间的对应关系。这些对应关系随后会被扭曲到目标图像的坐标系中,以适应新的姿态,即使在大幅度的姿势变化下也能有效地建立源视图和目标视图之间的联系。

第二个卷积网络则利用这些建立的对应关系和其他可用信息来合成最终的输出图像。在这个过程中,采用了一种全卷积架构,并结合了可变形的跳跃连接,这些连接由估计的对应字段引导。这种方法有助于在合成过程中保持细节和一致性。

论文还展示了这种技术在姿态引导图像合成、服装转移以及姿势引导的人脸重新合成方面的最新成果,表明了该方法的有效性和广泛的应用潜力。通过对人体自然对称性的利用和对纹理元素对应关系的精确估计,这种方法能在姿态变化剧烈的情况下,提供高质量的图像重合和修复效果。

这项工作为姿态引导的图像处理提供了新的见解和技术,特别是在人体纹理恢复和图像合成方面,对于增强现实应用和虚拟试衣间等场景具有重大意义。通过深度学习和创新的网络设计,研究人员能够克服传统方法的局限,实现更加逼真和精确的图像再合成。

相关推荐

cpongm

- 粉丝: 5

最新资源

- 可视化显示本机IP地址的GUI工具

- 原型展示:角度与材料设计的导航菜单概念实现

- XX集团绩效考核方案设计讨论精华版

- C++ 课程项目COEN346_ASN3分析与实践

- 管理老年人社会参与的isis-chats应用程序开发

- React项目快速启动模板:TypeScript+TailwindCSS+Prettier

- Python常用工具类方法大全

- iPhone SDK中图片下载并保存为PNG或JPEG格式教程

- XX贸易公司销售助理职位说明书下载

- 3D展厅展位模型效果图:模型设计展示应用

- 2021秋招面经复盘:leetcode刷题与技术栈深度学习

- Android开发入门:掌握'hello world'项目实践

- bootd开源项目:网络引导服务器解决方案

- Python库gr-1.5.0安装与使用教程

- XX贸易公司货位卡:提高资源管理效率的实用工具

- 网站电子课程:深入CSS设计与应用