无监督像素到像素变换:引导超分辨率新方法

PDF格式 | 844KB |

更新于2025-01-16

| 69 浏览量 | 举报

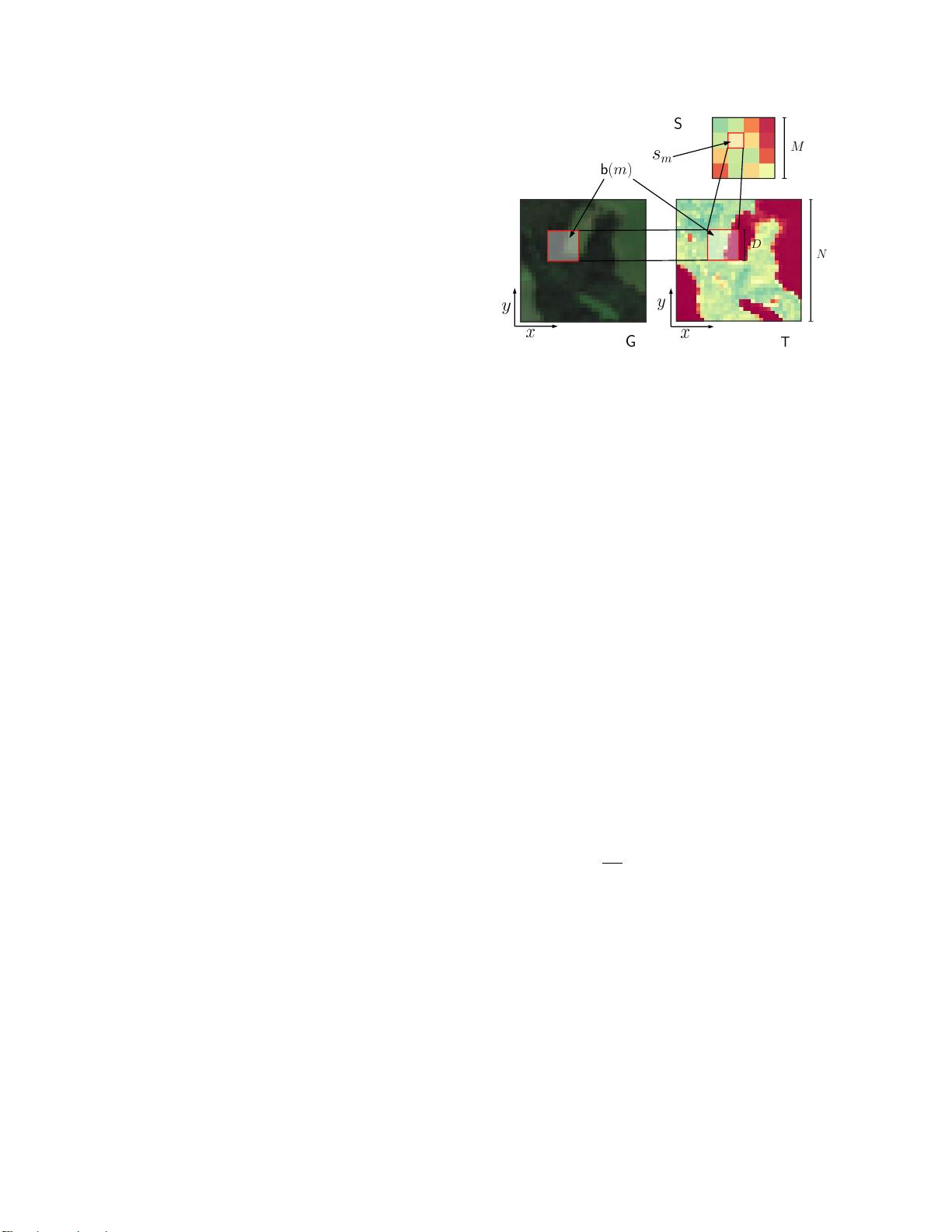

"这篇论文探讨了像素到像素变换在无监督引导超分辨率方法中的应用,这是一种用于提升计算机视觉任务中低分辨率图像质量的技术。通常,输入包括低分辨率的源图像和高分辨率的引导图像,目的是生成源图像的高分辨率版本。传统方法将此问题视为超分辨率任务,通过上采样源图像并利用引导图像恢复细节。本文提出了一种新的方法,通过参数化像素映射为多层感知器,并仅对映射函数进行正则化,以生成清晰、自然的图像。这种方法无需监督学习,仅依赖特定的源和引导图像进行自适应。在深度图和树高图的超分辨率任务中,该方法在定量和定性评估中均表现出色,优于近期的基准方法。"

在计算机视觉领域,引导超分辨率是一种重要的技术,它可以应用于多种任务,比如机器人导航中深度图的增强。文章指出,当设备如飞行时间相机获取的深度图分辨率较低时,可以通过引导图像(如常规相机的高分辨率图像)来提升深度信息的质量。这种方法不仅适用于环境测绘,提高诸如树高或生物量地图的测绘精度,还可以视作引导滤波的扩展,用于图像处理和分析。

传统上,引导超分辨率被看作是反问题,即源图像被视为目标图像的下采样结果。解决这一问题通常涉及恢复源图像中的高频细节。然而,文中提出的新策略是将像素到像素的映射表示为一个多层感知器,通过最小化源图像与下采样目标图像之间的差异来学习权重。重要的是,这种方法仅对映射函数进行正则化,避免对输出的直接正则化,从而防止图像失真,生成更加逼真的图像。

论文所述方法的无监督特性意味着它不依赖预先标注的数据,而是利用特定的源和引导图像对映射函数进行自我调整。这种方法在实际应用中具有灵活性和实用性。作者通过深度图和树高图的超分辨率任务进行了实验验证,结果表明,与现有的基线方法相比,该方法在量化指标和视觉效果上均有显著提升。

这项工作为无监督引导超分辨率提供了一个创新的框架,它不仅在理论上有价值,而且对于实际的计算机视觉应用具有很大的潜力,特别是在需要提升低分辨率图像质量的场景中。

相关推荐

cpongm

- 粉丝: 6

最新资源

- 支付宝订单监控免签工具:实时监控与信息通知

- 一键永久删除QQ空间说说的绿色软件

- Appleseeds训练营第4周JavaScript练习

- 免费HTML转CHM工具:将网页文档化简成章

- 奇热剧集站SEO优化模板下载

- Python xlrd库:实用指南与Excel文件读取

- Genegraph:通过GraphQL API使用Apache Jena展示RDF基因数据

- CRRedist2008与CRRedist2005压缩包文件对比分析

- SDB交流伺服驱动系统选型指南与性能解析

- Android平台简易PDF阅读器的实现与应用

- Mybatis实现数据库物理分页的插件源码解析

- Docker Swarm实例解析与操作指南

- iOS平台GTMBase64文件的使用及解密

- 实现jQuery自定义右键菜单的代码示例

- PDF处理必备:掌握pdfbox与fontbox jar包

- Java推箱子游戏完整源代码分享