深度学习与BP层融合:提升密集预测任务性能

34 浏览量

更新于2025-01-16

收藏 1.03MB PDF 举报

"信念传播重新加载:用于标记问题的BP层学习"这篇论文探讨了如何融合深度神经网络(DNN)与图形模型,特别是利用信念传播(BP)算法,以创建更为高效且具有更好正则化的复合模型。作者们针对计算机视觉中的密集预测任务,如语义分割、立体深度重建和光流,提出了创新性的BP层设计。

传统上,卷积神经网络(CNN)在这些任务上取得了显著进步,但它们对于长距离空间相互作用和结构约束的处理能力有限。条件随机场(CRF)在处理这类问题时表现出色,通过考虑全局信息来增强预测精度。然而,将CRF与CNN结合的训练过程通常涉及到复杂的推理步骤,这在随机梯度下降等常用优化算法中构成挑战。

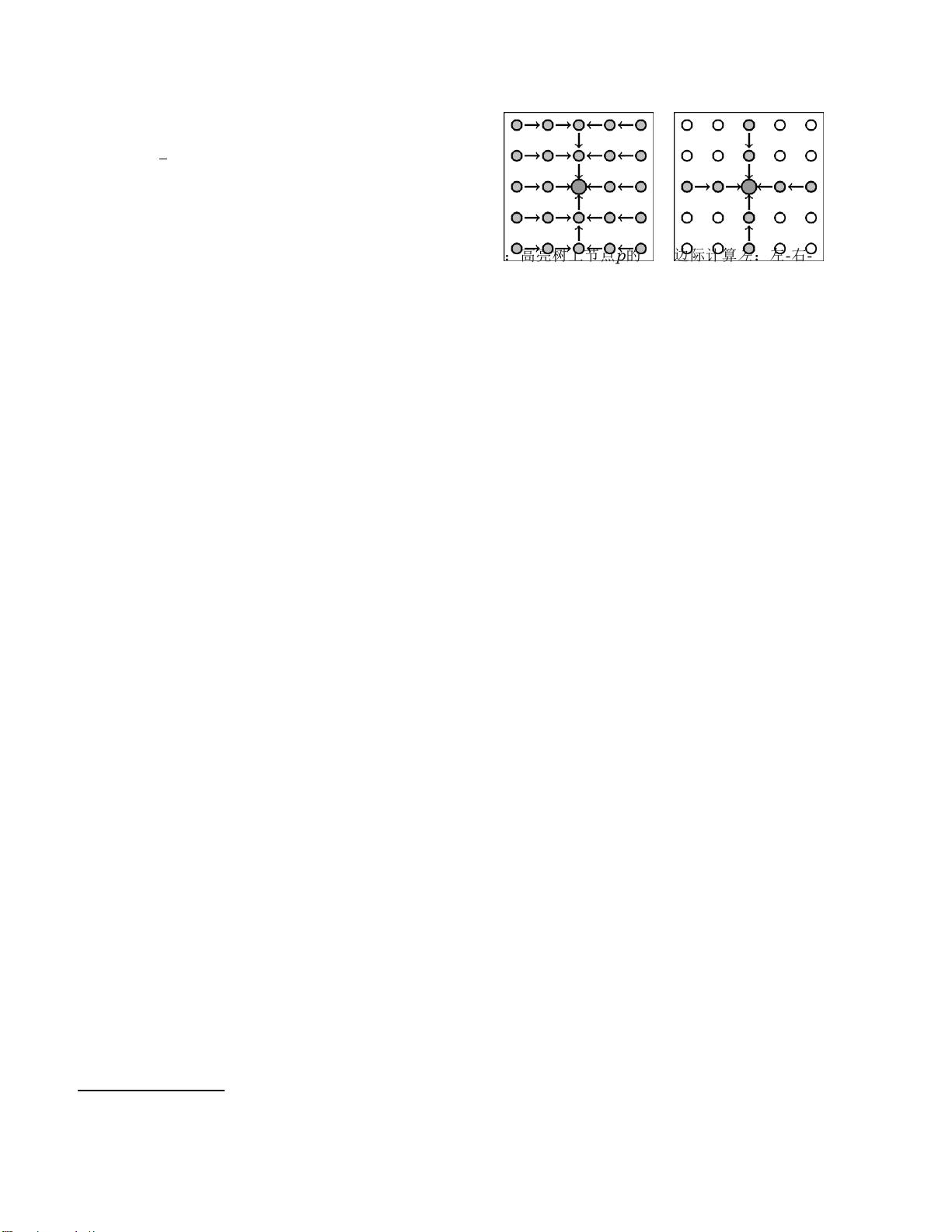

论文的核心贡献在于将截断的最大乘积置信传播(Truncated Max-Product BP,TMPBP)作为深度学习模型的组成部分。TMPBP被设计成一个BP层,它可以直接与CNN的边缘损失学习公式相集成,并支持反向传播更新。这样,BP层可以在CNN中作为一个中间或最终块,构建一个层次化的模型,其中包含了不同尺度的BP推理和CNN处理。

通过这种设计,论文提出了一种新颖的方法,能够在保持CNN的灵活性的同时,引入CRF的结构信息,从而提高模型的鲁棒性和准确性。在实验部分,作者展示了BP层模型在多个标准基准测试中的性能,如Kitti、Cityscapes和Sintel,证明了其在参数效率和模型稳定性方面的优势。

总结来说,这项工作解决了将CRF推理融入深度学习训练过程中的难题,通过BP层实现了高效且灵活的复合模型,为密集预测任务提供了更强大的工具。这不仅有助于解决现有挑战,也为未来的研究者探索更深层次的模型融合提供了新的思路。"

161 浏览量

1009 浏览量

160 浏览量

3243 浏览量

449 浏览量

点击了解资源详情

550 浏览量

115 浏览量

672 浏览量

cpongm

- 粉丝: 6

最新资源

- MATLAB实现ART与SART算法在医学CT重建中的应用

- S2SH整合版:快速搭建Struts2+Spring+Hibernate开发环境

- 托奇卡项目团队成员介绍

- 提升外链发布效率的SEO推广神器——搜易达网络推广大师v2.035

- C#打造简易记事本应用详细教程

- 探索虚拟现实地图VR的奥秘

- iOS模拟器屏幕截图新工具

- 深入解析JavaScript在生活应用开发中的运用

- STM32F10x函数库3.5中文版详解与应用

- 猎豹浏览器v6.0.114.13396 r1:安全防护与网购敢赔

- 掌握JS for循环输出的最简洁代码技巧

- Java入门教程:TranslationFileGenerator快速指南

- OpenDDS3.9源码解析及最新文档指南

- JavaScript提示框插件:鼠标滑过显示文章摘要

- MaskRCNN气球数据集:优质图像识别资源

- Laravel日志查看器:实现Apache多站点日志统一管理