LISA:全方位手部神经模型,精准捕捉手部形状与外观

111 浏览量

更新于2025-01-16

收藏 2.32MB PDF 举报

"LISA:内隐手形和手形的"

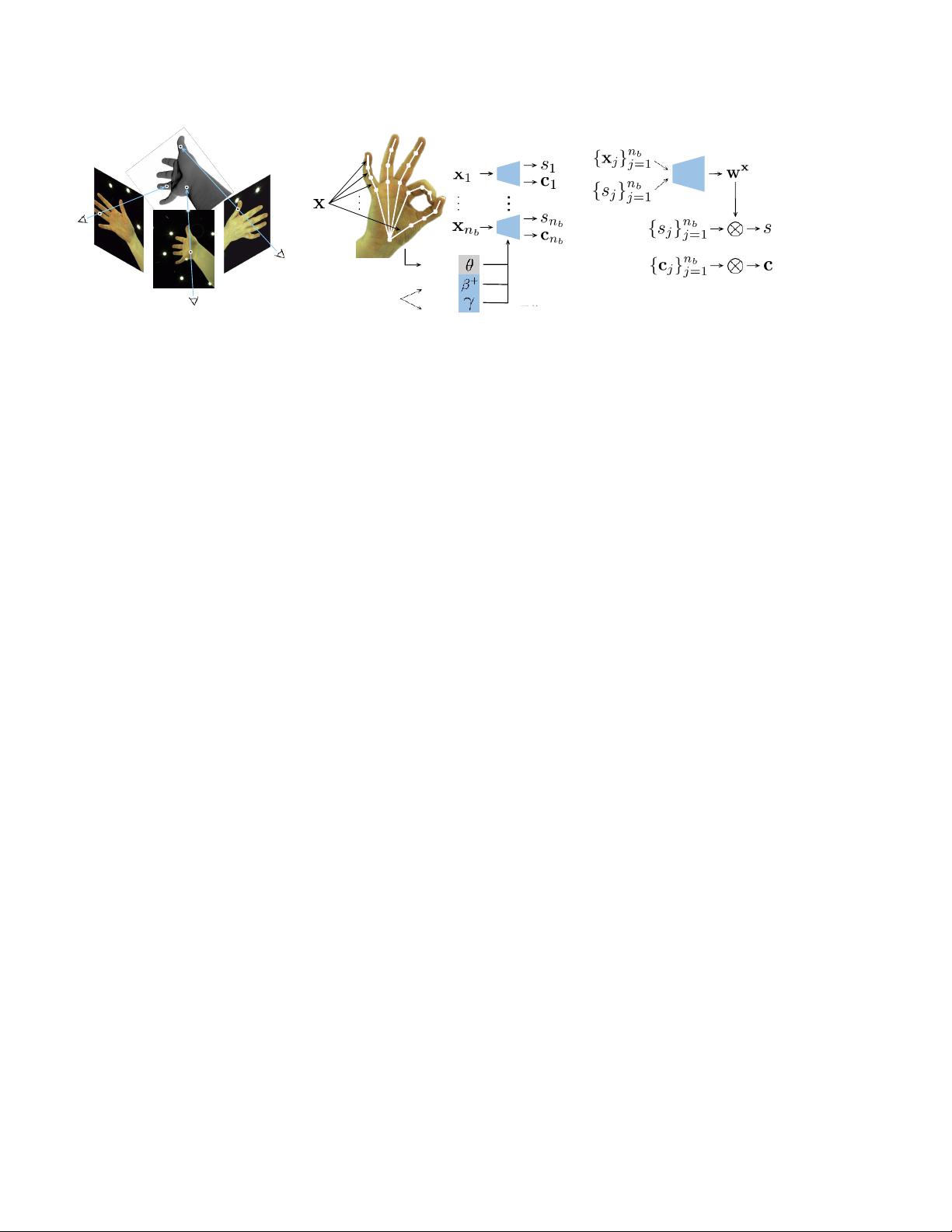

LISA,即无所不能的人手神经模型,是由Enric Corona等人提出的,旨在精准捕捉手部的形状和外观,并能推广到任意的手部子模型。这个模型利用多视图RGB视频数据集进行训练,其中包含了大致标注的3D手部姿势。LISA的独特之处在于它能够实现形状、颜色和姿态的分离表示,允许对特定手部参数进行精细控制。

LISA模型基于铰接式的隐式表示,它可以预测每个骨骼相对于局部手部坐标的3D颜色和有符号距离。这些预测通过预估的蒙皮权重进行组合,以生成完整的3D手部模型。蒙皮权重是显式预测的,这对于将不同骨骼的影响合并到最终的形状和外观重建中至关重要。通过这种方式,LISA能够从单目或多视图图像序列中重建动态手部,其形状和外观的重建质量显著优于现有的基线方法。

手部建模和跟踪在计算机视觉领域一直是一个重要的研究方向,因为手部是人类与环境交互的主要工具。传统的研究如MANO手部模型已经为这个领域打下了坚实的基础,但LISA模型的出现进一步提升了精度和鲁棒性,这对于人机交互、假肢设计以及虚拟和增强现实应用具有重大意义。

实验结果证明了LISA模型的有效性,它不仅能够准确地从单目或多个摄像头视角重建动态手部,而且在手的形状重建质量上表现出显著优势。这意味着LISA有可能成为未来手部追踪和建模技术的标准,为各种现实世界的应用提供更加精确和灵活的解决方案。项目页面提供了更多关于LISA模型的信息,包括源代码和进一步的研究成果。

276 浏览量

2021-06-06 上传

112 浏览量

131 浏览量

103 浏览量

2021-05-01 上传

2021-06-28 上传

2021-05-26 上传

158 浏览量

cpongm

- 粉丝: 6

最新资源

- 全面详实的大学生电工实习报告汇总

- 利用极光推送实现App间的消息传递

- 基于JavaScript的节点天气网站开发教程

- 三星贴片机1+1SMT制程方案详细介绍

- PCA与SVM结合的机器学习分类方法

- 钱能版C++课后习题完整答案解析

- 拼音检索ListView:实现快速拼音排序功能

- 手机mp3音量提升神器:mp3Trim使用指南

- 《自动控制原理第二版》习题答案解析

- 广西移动数据库脚本文件详解

- 谭浩强C语言与C++教材PDF版下载

- 汽车电器及电子技术实验操作手册下载

- 2008通信定额概预算教程:快速入门指南

- 流行的表情打分评论特效:实现QQ风格互动

- 使用Winform实现GDI+图像处理与鼠标交互

- Python环境配置教程:安装Tkinter和TTk