Text2Mesh:用文本创造3D网格样式

PDF格式 | 2.16MB |

更新于2025-01-16

| 68 浏览量 | 举报

"Mesh,可以将任意3D网格转换为与特定文本描述相匹配的风格化版本,而无需复杂的预训练模型或专用的3D数据集。这种方法的关键在于结合了CLIP(Contrastive Language-Image Pre-training)的强大力量,它能够理解和关联文本与图像的语义。CLIP的这种特性使得Text2Mesh能够理解输入的文本提示,从而在3D网格的颜色和几何细节上进行精确的风格化。

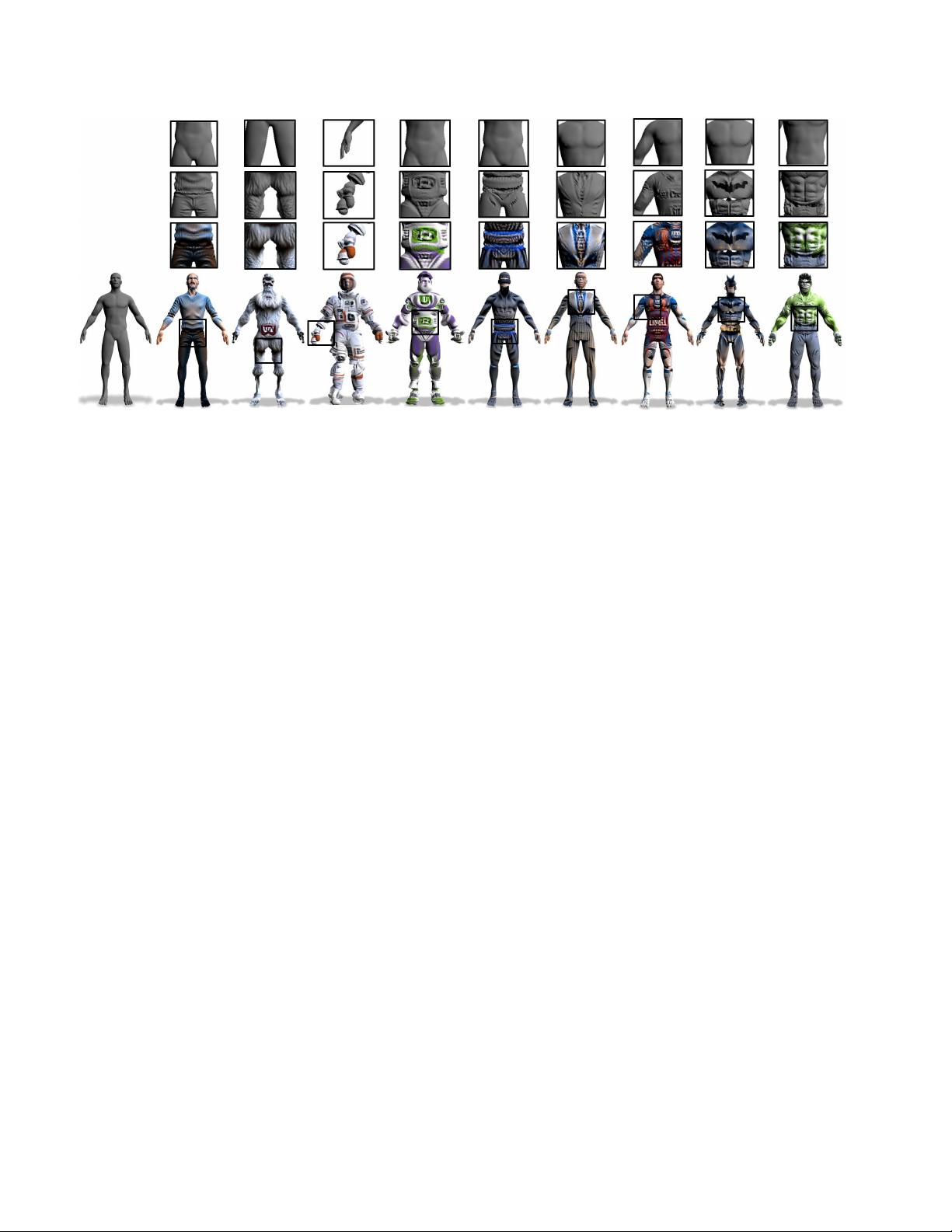

Text2Mesh的工作流程分为几个主要步骤。首先,输入的3D网格作为内容提供,其全局结构和形状被保留。然后,用户提供的目标文本提示定义了期望的风格。这个文本提示可以是任意的,比如“钢铁侠”、“彩色钩针”或者“宇航员”,Text2Mesh会尝试捕捉这些词语背后的视觉概念。

接下来,我们的框架利用了一个神经网络,即神经风格场(Neural Style Field, NSF),它能够在3D网格上生成颜色和局部几何细节。NSF网络通过优化过程调整,以确保生成的3D样式化网格与文本描述的风格一致。这个优化过程基于CLIP的嵌入,通过多个2D视图来评估和引导风格化网格与文本提示的匹配程度。

Text2Mesh的独特之处在于它能够处理各种质量的3D网格,包括非流形和有边界的网格,而且它不需要UV参数化。这意味着它可以应用于广泛的不同3D模型,即使模型的原始信息不完整或格式不规范。

在实际应用中,Text2Mesh展示了其在各种3D网格上的强大风格化能力,如图1所示,它能够将简单的几何形状转化为丰富多彩、细节丰富的3D艺术作品。从“钢铁侠”式的未来感设计到“彩色钩针”般的复古质感,甚至“宇航员”所体现的科幻元素,Text2Mesh都能够实现无缝融合,创造出视觉上连贯且具有独特风格的新颖3D模型。

我们的成果不仅体现在代码和结果的开放分享,还在于为3D内容创作提供了新的工具和可能性。通过Text2Mesh,设计师和艺术家可以利用自然语言来探索无限的创意空间,将抽象的文字概念转化为生动的3D视觉体验。这进一步推动了文本和3D图形的交互,为CGI(计算机生成图像)和VR/AR应用等领域开辟了新的创新路径。

Text2Mesh是一项创新的技术,它结合了深度学习和自然语言处理的力量,实现了3D网格的文本驱动神经样式化。这一突破性的方法简化了3D对象风格编辑的过程,提高了效率,并且拓展了艺术创作的边界。"

相关推荐

cpongm

- 粉丝: 6

最新资源

- 网狐工具:核心DLL和程序文件解析

- PortfolioCVphp - 展示JavaScript技能的个人作品集

- 手机归属地查询网站完整项目:HTML+PHP源码及数据集

- 昆仑通态MCGS通用版S7400父设备驱动包下载

- 手机QQ登录工具的压缩包内容解析

- Git基础学习仓库:掌握版本控制要点

- 3322动态域名更新器使用教程与下载

- iOS源码开发:温度转换应用简易教程

- 定制化用户登录页面模板设计指南

- SMAC电机在包装生产线应用的技术案例分析

- Silverlight 5实现COM组件调用无需OOB技术

- C#实现多功能画图板:画直线、矩形、圆等

- 深入探讨C#语言在WPF项目开发中的应用

- 新版2012109通用权限系统源码发布:多角色用户支持

- 计算机科学与工程系网站开发技术源码合集

- Java实现简易导出Excel工具的开发教程