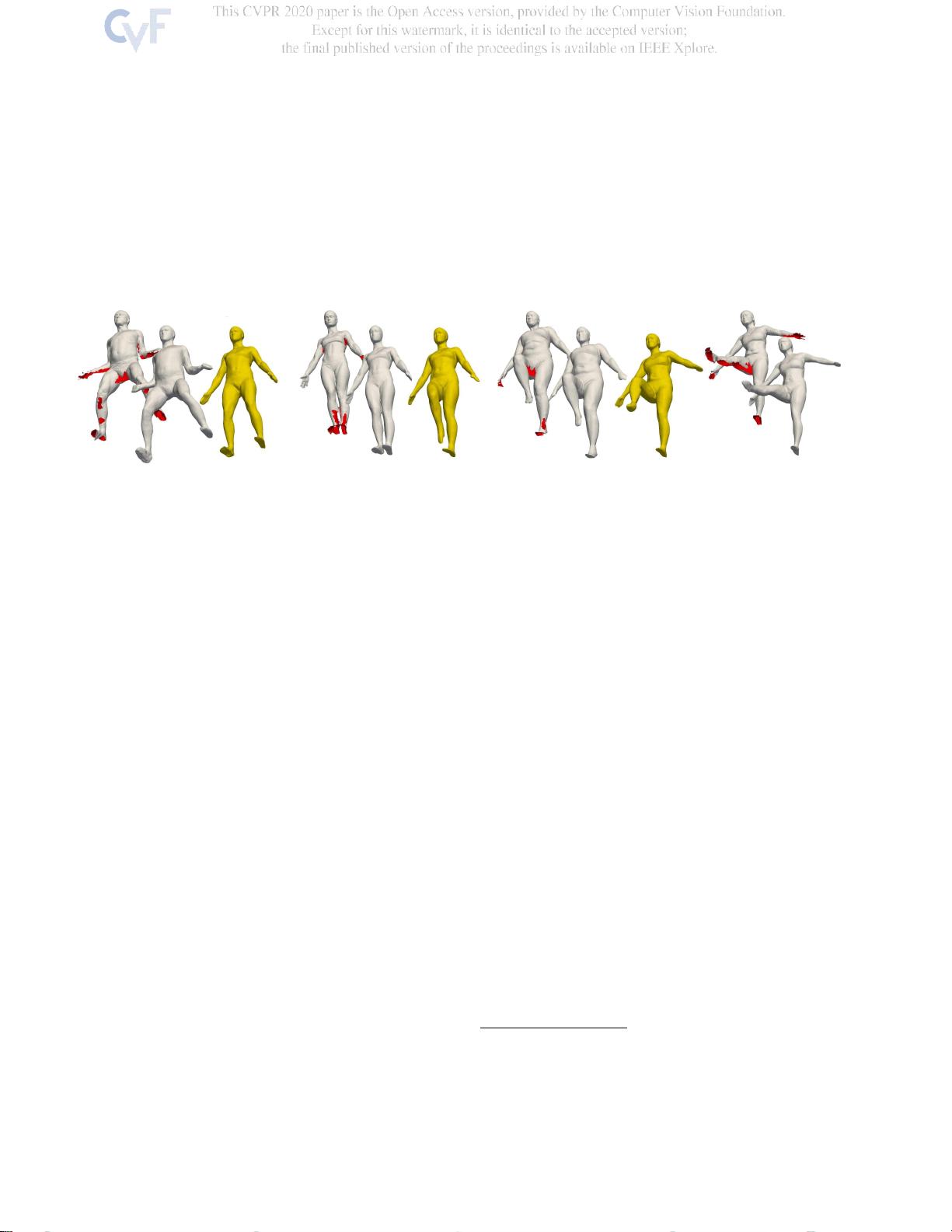

从原始的3D数据。图1描绘了一个示例,其中使用SAL

共同学习原始人类扫描的数据集克服了数据中的许多

缺陷和伪影(每个灰色对中的左侧),并提供了高质

量的表面重建(每个灰色对中的右侧)和形状空间

(潜在表示的插值是金色的)。

我们已经尝试了SAL从点云进行表面重建,以及从

D-Faust数据集的原始扫描中学习人体形状空间[7]。将

我们的结果与当前的方法和基线进行比较,我们发现

SAL是从原始数据学习形状的首选方法,并相信SAL

可以促进许多计算机视觉和计算机图形学形状学习应

用,使用户能够避免繁琐和未解决的预处理中的表面

重建问题。

2.

以前的工作

2.1.

基于神经网络的曲面学习

神经参数曲面。使用神经网络表示表面的一种方法是

参数化的,即作为参数化图表

f

:

R2R3

。Groueix等人

[19] 建 议 使 用 这 种 参 数 化 图 表 的 集 合 来 表 示 表 面

(

即

,atlas); Williams et al.[40]使用图表之间的适当

过渡函数优化地图集,并专注于单个表面的重建。辛

哈等人[32,33]使用几何图像作为全局参数化,而[27]

使用共形全局参数化来减少地图的自由度数量。参数

表示是明确的,但需要处理图表的覆盖、重叠和变

形。

神经隐式表面。另一种使用神经网络来表示曲面的方

法,也是本文所采用的方法,是使用隐式表示,即

f

:

R

3

R,并且曲面被定义为其零水平集,等式1。一些作

品在体积网格上编码

f

,例如体素网格[41]或八叉树

[36]。当隐函数

f

表示为神经网络时,可以实现模型自

由度的更大灵活性和潜在更有效的使用[12,30,28,

2,17]。在这些工作中,使用符号距离函数的回归损

失[30],占用函数[12,28]或通过粒子方法来训练隐

式,以直接控制神经元水平集[2]。排除需要对零水平

集进行采样的后者,所有基于回归的方法都需要地面

实况内部/外部信息来训练隐式

f

。在本文中,我们提

出了一个符号不可知的训练方法,即训练方法,可以

直接与原始(无符号)数据。

形状表征学习。学习形状集合是使用生成对抗网络

(GAN)[18],自动编码器和变分自动编码器[24]以及

自动解码器[8]完成的。 Wu等人[41]将GAN用于 体

素网格编码的形状,而本哈姆等人。[4]将GAN应用于

一组共形图。 Dai等人。[13]使用编码器-解码器架构

从体积网格上的部分输入学习到完整形状的有符号距

离函数。Stutz等人[34]使用可变自动编码器来学习使

用体积网格的汽车的隐式表面表示。Baqautdinov等人

[3]使用具有恒定网格的变分自动编码器来学习人脸形

状空间的Litany等人[25]使用变分自动编码器来学习模

板网格的身体形状嵌入Park等人。[30]使用自动解码器

来学习形状的隐式神经表示,即直接学习数据集中每

个形状的潜在向量。在我们的工作中,我们还使用了

变分自动编码器,但与以前的工作不同,学习是直接

从原始3D数据中完成的。

2.2.

表面重建。

带符号的曲面重建。许多表面重建方法需要法向或内/

外信息。 Carr等人[9]是最早提出使用参数模型通过计

算其隐式表示来重建表面的人之一;它们使用径向基函

数(RBFs),并在使用定向法线信息计算的内部和外

部点处进行回归。Kazhdan等人[22,23]在体积离散化

上求解泊松方程以将点和法线信息扩展到占用指示器

函 数。 Walder等 人 [38]使 用 径 向 基函 数 并 求解 变 分

Hermite问题(

即

,将隐式的梯度拟合到正态数据)以

避免平凡解。在一般情况下,我们的方法与非线性参

数化模型(MLP),因此不需要先验空间离散化,也

不与固定的线性基础,如径向基函数。

无符号曲面重建。与本文更相关的是处理无符号数据

(如点云和三角汤)的表面重建方法Zhao等人。[43]

使用水平集方法通过最小化表面到点云的损失惩罚距

离来将隐式表面拟合到无方向的点云,从而实现一种

最小面积表面插值点。Walder等人[37]制定了一个变分

问题拟合隐式径向基函数的无方向点云数据,同时最

小化 一个正则化项和最大化矩阵的范数;求解变分问

题等价于特征向量问题。Mullen等人[29]建议通过一个

多阶段算法将一个无符号距离函数标记到一个点云,

首先将问题分为近距离和远距离。