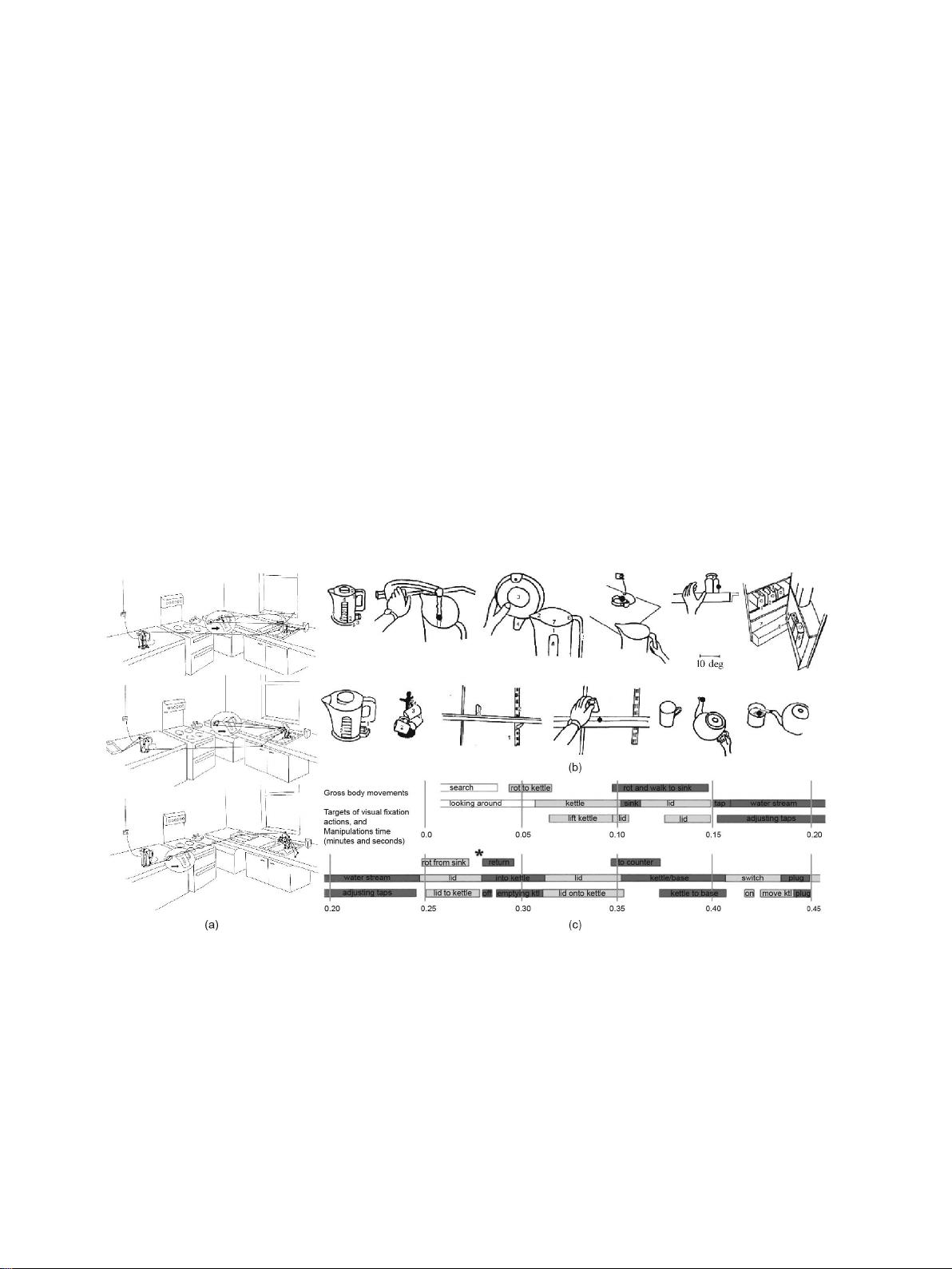

图三.人类背侧和腹侧通路对不可见物体的皮层反应。(a)刺激(工具和面孔)和实验程

序;(b)背侧和腹侧区域都对工具和面孔作出反应。当刺激被抑制的高对比度动态纹

理,背侧反应仍然响应工具,但不面对,而无论是工具或面孔引起太多的激活腹侧区。

BOLD:血氧水平依赖性。转载自参考文献[5],经Nature Publishing Group许可,

©2005

。

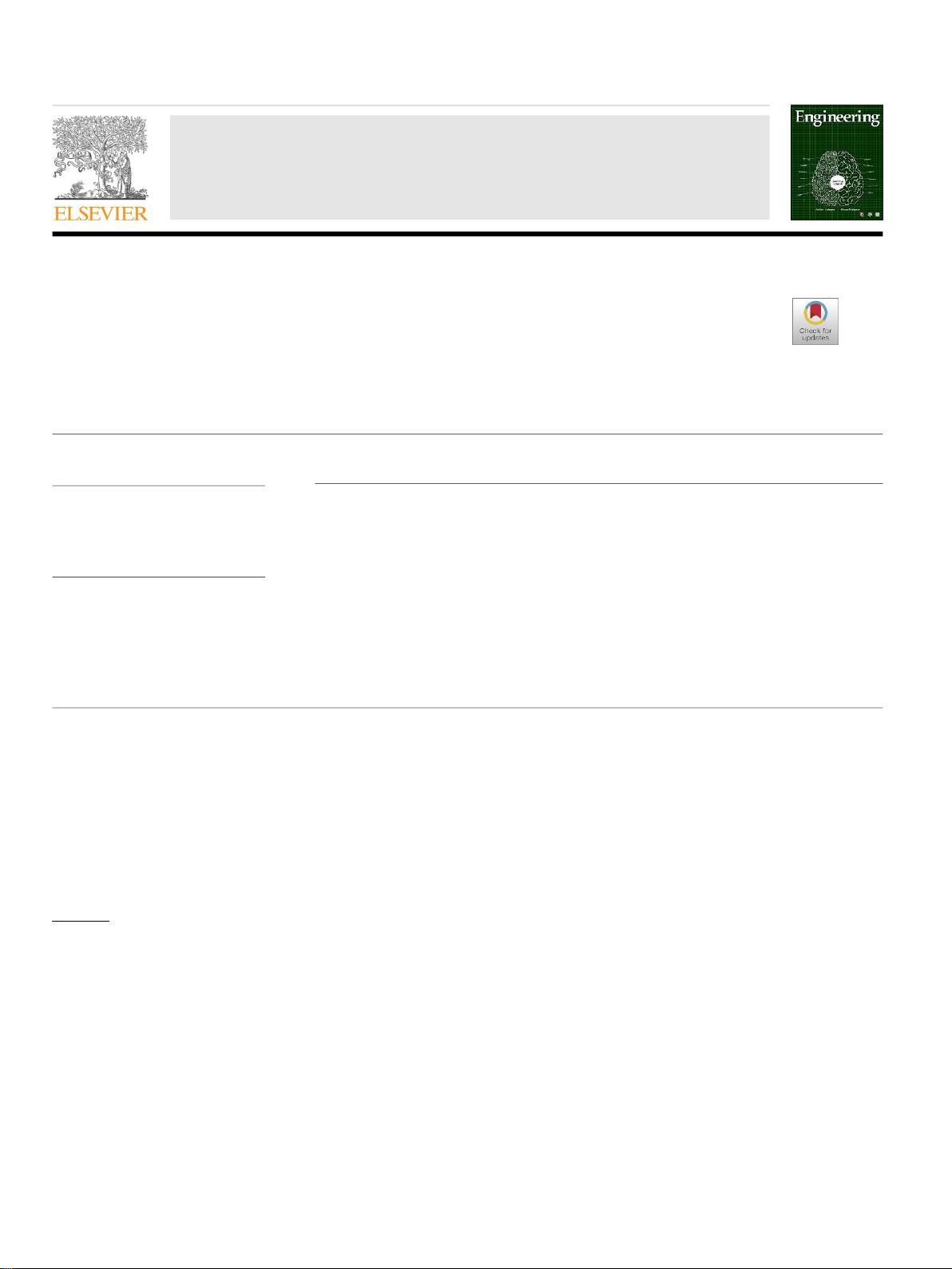

建筑学[16,17]。在过去的十年里,这种思想推动了计算机视觉和机器

学习中的图像分类研究,并取得了显着的进展,包括DNN最近的成功

[18

尽管这些方法在公开数据集中的识别准确性方面在场景分类方面

取得了良好的表现,但最近的一项大规模神经科学研究

[21]

表明,当

前

DNN

无法解释灵长类动物(人类和猴子)的图像级行为模式,这

引起了人们对灵长类动物物体视觉背后的神经机制的更精确解释的此

外,数据驱动的方法已经导致场景分类研究的焦点远离视觉信息的重

要决定因素

-分类任务本身[22,23]。同时,

这些方法还不清楚分类如

何与场景语义相互作用,使认知推理。心理学研究表明,人类视觉

在推理过程中组织表征,即使是对于

“

简单

”

的根据观众如参考文献

[24]

所示,场景分类和信息收集

过程受到这些分类任务的约束[25,26],表明视觉输入和观众的需求/任

务之间存在双向相互作用除了场景分类,在面部识别中也观察到类似的

现象[27]。

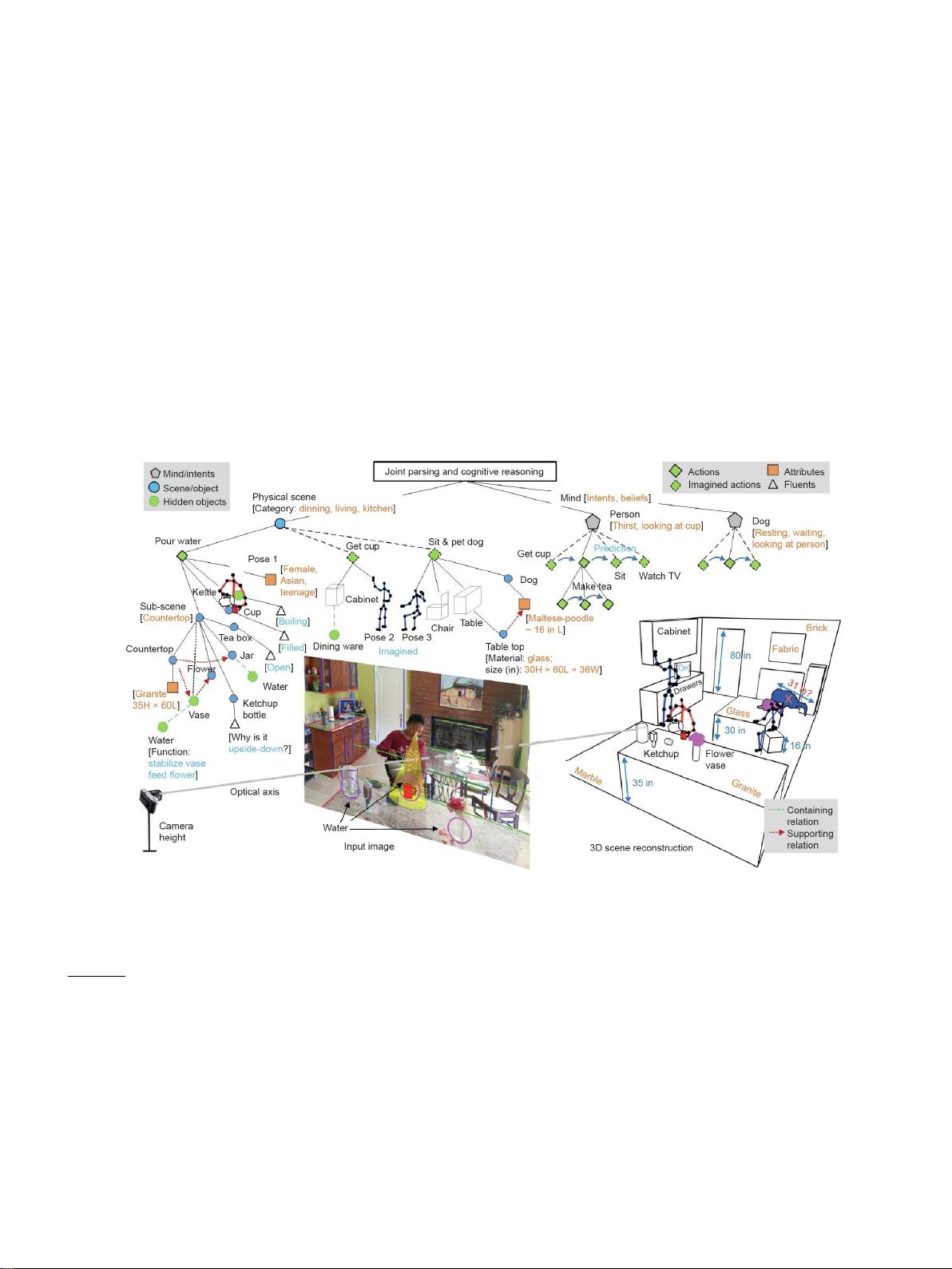

在早期的工作中,Ikeuchi和Hebert[28]受到机器人抓取文献的启

发,提出了一种以任务为中心的表示法。具体来说,在没有恢复详细的

3D模型的情况下,他们的分析表明,各种抓取策略需要物体提供不同的

功能能力;因此,同一物体的表示可以根据计划的任务而变化(图5)

[28]。举个例子,抓一个杯子可能会导致两种不同的抓握方式--圆柱形

的杯身和钩形的杯柄。这些发现还表明,视觉(在这种情况下,识别可

抓握的部分)在很大程度上是由任务驱动的;不同的任务导致不同的视觉

表征。

2.2.

‘‘Where

在文献中,

3D

机器视觉的方法假设目标是从相机

/

观察者的角度构

建场景的精确

3D

模型这些运动恢复结构(

SfM

)和同时定位和映射

(

SLAM

)方法

[29]

已经成为

3D

场景重建中的主流范例。特别是,

从单个二维(

2D

)图像的场景重建是一个众所周知的不适定问题

;

可

能存在无限数量的可能的

3D

配置与投影的

2D

观察图像匹配

[30]

。然

而,这里的目标不是精确匹配

3D

地面实况配置,而是通过在功能,

物理和对象关系方面生成最佳配置来使代理执行任务直到最近

[31-

38]

,这一系列的工作大多与识别和语义分开研究

;

见图。

6

[36]

举个例子。

将重建作为

“

认知地图

”

的想法有着悠久的然而,我们的生物视觉

系统并不依赖于对特征和变换的精确计算

;

现在有大量证据表明,人

类以一种从根本上不同于任何当前计算机视觉算法的方式来表示场景

的

3D

布局

[40

,

41]

。事实上,多项实验研究并不支持全局度量表示

[42-

在一个案例研究中,

Glennerster

等人

[53]

证明了观察者对执行

各种任务的移动观察者周围环境规模的巨大变化缺乏敏感性

在所有最近的证据中,网格细胞可能是最著名的发现,表明视觉

任务不需要精确的

3D

重建

[54

网格细胞编码欧几里得空间的认知表

征,这意味着感知和处理位置和方向的不同机制这一发现后来被授予

2014

年诺贝尔生理学或医学奖。令人惊讶的是,这种机制不仅存在

于人类

[57]

,而且在小鼠

[58

,

59]

,蝙蝠

[60]

和其他动物中也发现

了。

Gao et al.[61]

和

Xie et al.[62]

提出了一种网格单元的表示模

型,其中智能体的

2D

自位置由高维向量表示,智能体的

2D

自运动或

位移由变换向量的矩阵表示。这种基于矢量的模型能够学习网格单元

的六边形模式,具有误差校正、路径积分和路径规划。最近的一项研

究还表明,在某些人类导航任务中,基于视图的方法实际上比基于

3D

重建的方法更好

[63]

。

尽管有这些发现,我们如何在复杂的环境中航行,同时始终能够

返回到原始位置(即,归巢)仍然是生物学中的一个谜,