Go并发模型深度剖析:解锁goroutine和channel的秘密(2023年最新版)

发布时间: 2024-10-19 18:07:51 阅读量: 1 订阅数: 2

# 1. Go并发模型概述

在现代计算环境中,软件应用程序需要高效地处理并发任务,以实现最大的资源利用率和最佳的用户响应时间。Go语言通过其独特的并发模型,为开发者提供了一种既简单又强大的并发编程范式。Go并发模型的核心是基于CSP(通信顺序进程)理论,将并发编程的复杂性隐藏在语言层面。本章将为您介绍Go并发模型的基础知识,从而为深入理解和掌握goroutine以及channel的高级用法打下坚实基础。

## 1.1 并发与并行的区别

首先,理解并发(Concurrency)与并行(Parallelism)之间的区别是学习Go并发模型的起点。并发关注于同时处理多个任务的概念,而并行关注于同时执行多个计算。简而言之,并发是一种设计理念,可以让你的程序同时处理很多事情,而并行是实现并发的一种方式,通常是通过多线程或多核处理器来达成的。

## 1.2 Go并发模型的特点

Go语言的并发模型具有以下特点:

- **轻量级**:goroutine相比于线程来说,启动和管理成本更低,使得并发编程更加高效。

- **内置并发原语**:Go语言提供了channel等并发原语,使得goroutine之间的通信和同步变得简单直接。

- **内存安全**:在并发环境中,Go编译器和运行时共同确保内存访问的安全性,减少了许多并发程序中常见的错误。

## 1.3 并发在Go中的重要性

Go语言的设计哲学是:"并发不是一种编程范式,而是一种编程语言层面的功能"。因此,Go鼓励开发者使用并发来提高程序的性能,增强用户体验。它使得并行编程变得更简单,更自然,让开发者可以将精力集中在业务逻辑上,而不是并发机制的细节上。

通过本章的学习,我们初步了解了Go并发模型的基本概念和特点。接下来,我们将深入探索goroutine,这是Go语言实现并发的关键所在。

# 2. 深入理解goroutine

### goroutine的基本概念

#### goroutine的定义与启动

在Go语言中,`goroutine` 是一种轻量级线程,由Go运行时(runtime)管理。它是由Go语言运行时提供的核心并发机制,允许开发者在同一程序中同时执行成千上万个并发任务。与传统操作系统线程相比,`goroutine` 的创建和销毁的开销要小得多,启动一个 `goroutine` 的成本几乎可以忽略不计。

在Go中启动一个 `goroutine` 是非常简单的事情,只需在函数调用前加上 `go` 关键字:

```go

go func() {

// 这个匿名函数会在新的goroutine中执行

fmt.Println("Hello from a new goroutine!")

}()

```

`go` 关键字会在当前的调用栈中创建一个新函数的帧,并将控制权传递给Go的运行时系统。运行时系统随后会安排该函数在可用的逻辑处理器上异步执行。这样,主线程继续执行后面的代码,不会等待新 `goroutine` 完成。

#### goroutine与系统线程的关系

`goroutine` 并不是操作系统线程,而是运行在Go运行时管理的M:N调度器之上的一层抽象。该调度器负责将多个 `goroutine` 映射到少于 `goroutine` 数量的系统线程上执行。这种设计模式被称为M:N调度模型,它允许多个 `goroutine` 共享单个系统线程的执行资源,同时通过上下文切换实现并发执行。

一个系统线程可以执行多个 `goroutine`,而一个 `goroutine` 也可以在运行时被调度到不同的线程上执行。这就意味着当一个 `goroutine` 阻塞时(比如进行I/O操作),调度器可以将其他的 `goroutine` 迁移到该线程中继续执行,从而提高了程序的吞吐量和资源的使用效率。

### goroutine的调度机制

#### M:N调度模型

M:N调度模型是Go语言并发模型的核心,其中 `M` 代表操作系统线程(`Machien`),`N` 代表 `goroutine`。在这个模型中,Go的运行时调度器负责将多个 `goroutine` 绑定到数量较少的 `M` 线程上执行。这种设计的主要优点是能够有效地利用系统资源,并且相比1:1线程模型有更低的上下文切换开销。

一个关键的考虑点是,调度器需要处理多种情况,例如当一个 `goroutine` 需要进行I/O操作时,如果该 `goroutine` 的执行线程处于空闲状态,调度器会选择运行另一个准备就绪的 `goroutine`。这种智能调度保证了资源的有效利用,同时减少了因等待I/O操作完成而浪费的CPU周期。

#### 调度器的工作原理

Go的调度器工作原理非常复杂,但其核心目标是高效地执行多个 `goroutine`,同时最小化调度开销。调度器的运行主要包括以下几个步骤:

1. **Goroutine创建**:当`go` 关键字出现时,一个 `goroutine` 会被创建。

2. **任务分配**:调度器将 `goroutine` 分配给一个空闲的M线程,如果没有空闲的M,则创建一个新的线程(并非无限创建,通常有一个最大限制)。

3. **上下文切换**:在 `goroutine` 运行中,如果遇到阻塞操作(如I/O),调度器会进行上下文切换,保存当前 `goroutine` 的状态,并将另一个 `goroutine` 绑定到该线程上执行。

4. **线程复用**:如果一个 `goroutine` 完成或被阻塞,调度器会寻找其他的 `goroutine` 并将其分配给该线程。

#### 调度器的优化策略

Go语言运行时的调度器在设计上非常灵活,它包含多种优化策略来提高并发执行的效率:

1. **工作窃取(work stealing)**:当一个M线程上的 `goroutine` 队列为空时,该线程可以从其他有任务的线程窃取 `goroutine`。

2. **本地队列**:每个M线程有一个本地队列用于存放 `goroutine`。当本地队列为空时,M可以从全局队列中获取 `goroutine`。

3. **亲和调度(affinity scheduling)**:调度器会尽量将 `goroutine` 绑定到运行它的同一个M线程上,以利用缓存等局部性原理提高效率。

4. **限制窃取数量**:调度器会限制一个M窃取 `goroutine` 的数量,以防止饥饿现象。

### goroutine的同步与通信

#### 同步问题与解决方案

在并发编程中,`goroutine` 间的同步至关重要,因为它们可能会访问和修改共享资源。Go语言提供了多种同步机制,其中最常用的包括:

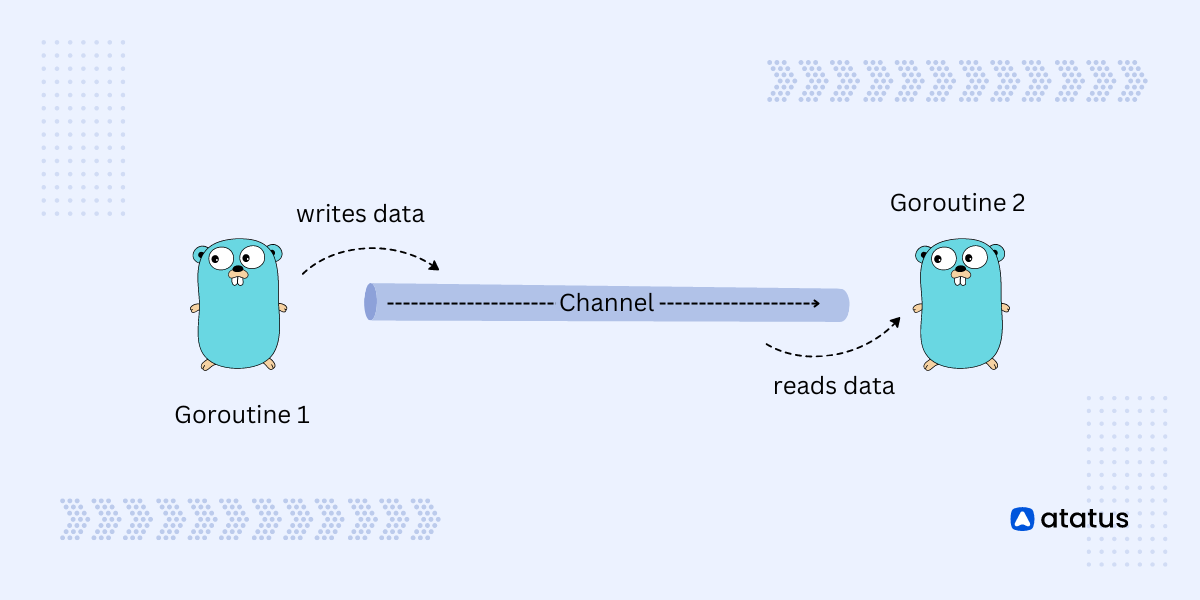

- `channel`:用于在 `goroutine` 之间传递数据,通过通道的发送和接收操作可以安全地同步多个 `goroutine`。

- `sync` 包:提供了`WaitGroup`、`Mutex`、`RWMutex`、`Once` 等同步原语。

- `context`:用于在 `goroutine` 树之间传递请求范围内的值、取消信号和截止时间。

以 `channel` 为例,它是Go中用于同步和通信的首选机制。`channel` 是一种特殊类型的类型,可以进行发送和接收操作,这些操作可以同步进行,保证数据的一致性。此外,`channel` 的容量可以是无缓冲的(容量为0)或者有缓冲的(容量大于0),其特性决定了不同的使用场景和性能特点。

#### 错误处理与异常捕获

在Go中,错误处理通常是通过返回错误类型的值来完成的。每个 `goroutine` 都需要负责自己产生的错误,这包括在执行过程中发生的异常。`defer` 语句是处理 `goroutine` 中的错误和清理资源的常用方法,它可以确保即使发生错误或 `goroutine` 退出,清理代码也能被执行。

为了在 `goroutine` 中捕获并处理异常,Go 提供了 `recover` 函数,它可以阻止 `panic` 引发的程序崩溃。`recover` 必须在 `defer` 函数中调用才能正常工作。一个典型的异常捕获机制示例如下:

```go

func process() {

defer func() {

if r := recover(); r != nil {

// 处理异常

fmt.Println("Recovered from panic:", r)

}

}()

// 这里可能会产生panic的代码

}

```

在实际应用中,需要对 `recover` 捕获的异常进行适当的处理,以确保程序的健壮性和稳定性。

# 3. 探索channel的奥秘

## 3.1 channel的核心原理

### 3.1.1 channel的数据结构

Go语言中的channel是用于goroutine之间进行通信和同步的机制。channel在底层实现上是一个基于环形队列结构的内存缓冲区,允许在不同的goroutine之间安全地传递数据。

```go

type hchan struct {

qcount uint // 队列中的数据数量

dataqsiz uint // 循环队列的大小

buf unsafe.Pointer // 指向队列的指针

elemsize uint16 // 每个元素的大小

closed uint32 // 标记channel是否已关闭

elemtype *_type // 元素类型

sendx uint // 发送操作的索引位置

recvx uint // 接收操作的索引位置

recvq waitq // 接收等待队列

sendq waitq // 发送等待队列

lock mutex // 互斥锁,用于保护整个结构体

}

```

channel的数据结构包含了多个关键字段,涵盖了缓冲区大小、数据类型、发送和接收的索引位置等重要信息。`waitq`类型的`recvq`和`sendq`分别保存着等待发送和接收数据的goroutine列表。

### 3.1.2 channel的操作原语

channel提供了几个基本的操作原语:`make`、`close`、`<-`、`cap`、`len`等,这些原语支持了goroutine之间的数据交换和同步。

```go

ch := make(chan int, 10) // 创建一个带有10个元素缓冲区的channel

close(ch) // 关闭channel

value := <-ch // 接收数据

ch <- value // 发送数据

```

- `make`用于创建一个新的channel。

- `close`用于关闭channel,发送数据到已关闭的channel将导致panic。

- `<-`操作符用于从channel接收数据或向channel发送数据。

- `cap`和`len`用于获取channel的容量和当前缓冲区的元素数量。

## 3.2 channel的类型与选择

### 3.2.1 缓冲型与非缓冲型channel

根据缓冲区的有无,channel分为非缓冲型和缓冲型。非缓冲型channel在发送数据时,必须有接收者立即准备接收,否则会阻塞发送操作;而缓冲型channel可以存储一定数量的数据,在缓冲区未满之前,发送操作不会被阻塞。

```go

// 非缓冲型channel

ch := make(chan int)

// 缓冲型channel,容量为10

chBuffered := make(chan int, 10)

```

### 3.2.2 channel的方向性

Go 1.18版本引入了泛型,通过泛型可以定义具有方向性的channel,即只能发送数据或只能接收数据的单向channel。

```go

// 只能发送的channel

sendOnlyChan := make(chan<- int)

// 只能接收的channel

receiveOnlyChan := make(<-chan int)

```

使用方向性channel可以提供更强的类型检查,增加代码的安全性。

## 3.3 channel的高级用法

### 3.3.1 select多路复用

`select`语句用于监听多个channel操作,当多个channel同时准备好操作时,会随机选择一个执行。

```go

select {

case v := <-ch1:

fmt.Println("Received from ch1:", v)

case v := <-ch2:

fmt.Println("Received from ch2:", v)

default:

fmt.Println("No channel ready")

}

```

`select`与`default`结合使用时,可以避免死等在channel上。

### 3.3.2 channel的关闭与遍历

正确关闭和遍历channel可以保证程序的稳定性和资源的正确释放。

```go

// 关闭channel

close(ch)

// 遍历channel

for v := range ch {

// 使用v进行操作

}

```

遍历channel时,当channel关闭后,会返回零值,遍历会结束。对已关闭的channel继续发送数据会导致panic,因此关闭channel时需要谨慎。

# 4. goroutine和channel的实践应用

在实际的Go语言编程实践中,理解并发模型的理论基础和工作原理只是第一步。为了构建高效、可靠的应用程序,开发人员需要掌握如何在具体场景中应用goroutine和channel,设计合适的并发模式,并且解决并发编程中可能遇到的问题。本章将深入探讨goroutine和channel在实际应用中的设计模式、常见问题及解决方案,以及性能优化的策略。

## 4.1 设计模式在并发中的应用

设计模式是软件工程中用于解决特定问题的一套成熟理论和经验总结。在并发编程中,一些设计模式可以帮助开发人员更好地组织并发代码,提高代码的可读性和可维护性。

### 4.1.1 生产者-消费者模式

生产者-消费者模式是一种经典的并发设计模式,它描述了在多线程环境下生产者线程生成数据并将其放入缓冲区,而消费者线程从缓冲区中取出数据进行处理的过程。

#### 缓冲型channel的应用

在Go中,channel可以作为生产者和消费者之间的缓冲区。通过使用缓冲型channel,可以避免生产者和消费者之间的直接竞争,从而减少同步开销。

```go

package main

import (

"fmt"

"time"

)

func producer(ch chan<- int) {

for i := 0; i < 10; i++ {

ch <- i // 生产数据

fmt.Println("Produced", i)

time.Sleep(time.Millisecond * 500)

}

close(ch) // 关闭channel表示生产结束

}

func consumer(ch <-chan int) {

for {

v, ok := <-ch // 从channel中消费数据

if !ok {

break // 若channel关闭,则退出消费

}

fmt.Println("Consumed", v)

time.Sleep(time.Millisecond * 1000)

}

}

func main() {

ch := make(chan int, 5) // 创建一个缓冲型channel

go producer(ch)

consumer(ch)

}

```

该例子中,缓冲型channel `ch` 有一个容量为5。如果生产者没有生产足够的数据来填满缓冲区,消费者会等待直到生产者放入新的数据。当缓冲区填满后,生产者将被阻塞,直到消费者消费了部分数据。

#### 实践注意事项

- 需要考虑缓冲区大小对程序性能的影响。缓冲区太小,可能导致生产者频繁等待;缓冲区太大,可能会导致内存使用过多。

- 在设计生产者和消费者时,应当考虑到错误处理机制,例如当生产者遇到错误时,应当通知消费者停止消费。

### 4.1.2 工作者模式

工作者模式是另一种并发设计模式,它使用一组工作者(worker)线程来处理多个独立的任务,通常用于任务分解和负载均衡。

#### 使用goroutine实现工作者模式

在Go中,工作者模式可以通过创建一组goroutine来实现,每个goroutine负责从任务队列中取任务执行。

```go

package main

import (

"fmt"

"math/rand"

"sync"

"time"

)

func worker(id int, jobs <-chan int, results chan<- int, wg *sync.WaitGroup) {

defer wg.Done()

for j := range jobs {

fmt.Printf("Worker %d started job %d\n", id, j)

time.Sleep(time.Duration(rand.Intn(1000)) * time.Millisecond)

fmt.Printf("Worker %d finished job %d\n", id, j)

results <- j * 2

}

}

func main() {

var wg sync.WaitGroup

jobs := make(chan int, 10)

results := make(chan int, 10)

// 开启3个工作者

for w := 1; w <= 3; w++ {

wg.Add(1)

go worker(w, jobs, results, &wg)

}

// 随机分配任务

for j := 1; j <= 5; j++ {

jobs <- j

}

close(jobs)

// 等待所有任务完成

wg.Wait()

close(results)

// 输出结果

for a := range results {

fmt.Println(a)

}

}

```

在这个例子中,`jobs` 是一个无缓冲channel,用于向工作者goroutine传递任务。`results` 是另一个无缓冲channel,用于接收任务完成后的结果。

#### 实践注意事项

- 在实现工作者模式时,合理控制goroutine数量非常关键。过多的goroutine可能导致资源竞争和上下文切换开销过大。

- 如果任务的产生比工作者处理速度快,应当适当减慢任务的产生速率或增加工作者数量。

## 4.2 并发编程中的常见问题与解决方案

并发编程虽然强大,但也带来了许多挑战。了解并发编程中的常见问题及其解决方案,有助于开发更加健壮的应用程序。

### 4.2.1 死锁的分析与避免

死锁是指两个或两个以上的进程在执行过程中,因争夺资源而造成的一种僵局。在并发编程中,死锁通常是由于多个goroutine在竞争互斥资源时形成的。

#### 死锁的原因

死锁通常由以下四个必要条件共同作用下产生:

1. **互斥条件**:一个资源每次只能被一个进程使用。

2. **请求与保持条件**:一个进程因请求资源而阻塞时,对已获得的资源保持不放。

3. **不剥夺条件**:进程已获得的资源,在未使用完之前,不能强行剥夺。

4. **循环等待条件**:发生死锁时,必然存在一个进程-资源的环形链。

#### 死锁的避免策略

为了避免死锁的发生,可以采取以下策略:

- **资源分配策略**:一次性分配所有资源或资源逐步分配,但需遵循特定顺序。

- **资源预分配**:进程开始执行前,一次性申请所有需要的资源。

- **资源持有锁顺序**:确保每个goroutine按照相同的顺序请求资源锁。

- **超时机制**:长时间等待资源时,放弃等待并进行重试。

### 4.2.2 内存竞争和原子操作

内存竞争发生在多个goroutine同时访问同一块内存区域时,且至少有一个是写操作。这可能导致不可预料的结果。

#### 内存竞争的示例

```go

package main

import (

"fmt"

"sync"

)

var counter int

var wg sync.WaitGroup

func main() {

const gs = 50

wg.Add(gs)

for i := 0; i < gs; i++ {

go func() {

defer wg.Done()

for j := 0; j < 1000; j++ {

counter++

}

}()

}

wg.Wait()

fmt.Println("Counter value:", counter)

}

```

上述代码中,尽管每个goroutine都试图增加`counter`变量,但是最终的结果通常不会是`50000`,这是因为多个goroutine之间发生了内存竞争。

#### 解决内存竞争的方法

- **互斥锁**:使用`sync.Mutex`来保证同一时刻只有一个goroutine能访问共享变量。

- **原子操作**:使用`sync/atomic`包提供的原子操作函数,如`AddInt32`,来代替简单的加法操作。

```go

import "sync/atomic"

func main() {

const gs = 50

var counter int64

wg.Add(gs)

for i := 0; i < gs; i++ {

go func() {

defer wg.Done()

for j := 0; j < 1000; j++ {

atomic.AddInt64(&counter, 1)

}

}()

}

wg.Wait()

fmt.Println("Counter value:", counter)

}

```

上述代码使用了`atomic.AddInt64`来安全地增加`counter`变量。

## 4.3 并发性能优化

并发程序的性能优化是一个复杂且持续的过程,涉及到多个层面,包括并发模型的选择、同步机制的应用以及并发工具的使用。

### 4.3.1 并发模型的性能考量

在选择并发模型时,需要考虑性能因素,如上下文切换开销、同步开销、资源利用率等。

#### 性能考量因素

- **上下文切换**:操作系统在多个goroutine之间切换所消耗的时间。

- **内存使用**:并发模型如何分配和管理内存资源。

- **资源争用**:并发组件间争夺共享资源的频率和效率。

- **吞吐量**:并发模型能够处理的最大任务量。

### 4.3.2 使用并发工具进行性能测试

为了客观评估并发模型和程序的性能,需要使用并发工具进行测试。

#### 性能测试的步骤

1. **基准测试(Benchmarking)**:利用Go语言的`testing`包编写基准测试,对比不同并发模型的性能。

2. **性能分析(Profiling)**:使用`runtime/pprof`或`net/http/pprof`包对程序进行性能分析,获取更详细的性能数据。

3. **压力测试(Load Testing)**:模拟高负载情况下的性能表现,以测试并发模型的稳定性和可扩展性。

```go

package main

import (

"fmt"

"runtime"

"testing"

)

func BenchmarkCounter(b *testing.B) {

var counter int64

b.RunParallel(func(pb *testing.PB) {

for pb.Next() {

counter++

}

})

fmt.Println("Counter value:", counter)

}

```

在这个基准测试示例中,`BenchmarkCounter`函数使用`b.RunParallel`来并发执行测试。

通过这样的测试,我们可以得到并发程序在不同并发级别下的性能数据,以便做出合理优化。

在本章节中,我们深入探讨了goroutine和channel在实际应用中的设计模式、常见问题及解决方案以及性能优化方法。在下一章节中,我们将继续探索Go并发模型的进阶话题,包括原子操作与锁的原理、Go内存模型与并发安全以及高级并发工具的探索。

# 5. Go并发模型的进阶话题

## 5.1 原子操作与锁的原理

在并发编程中,原子操作是完成一个任务而不会被其他线程打断的操作,它保证了代码块的原子性。在Go语言中,原子操作主要通过`sync/atomic`包来实现。原子操作是无锁的,并且通常比传统的互斥锁(mutex)有更低的开销。原子操作适用于那些对并发性能要求非常高的场景。

### 5.1.1 原子包的基本用法

`sync/atomic`包提供了原子操作的多种方法,包括加法、减法、交换、比较并交换(CAS)等。下面举例说明如何使用原子包来实现一个无锁的全局计数器:

```go

import "sync/atomic"

var counter int64

func increment() {

atomic.AddInt64(&counter, 1)

}

func getCounter() int64 {

return atomic.LoadInt64(&counter)

}

```

在上述代码中,`AddInt64`函数提供了一个原子加法操作,它确保了对`counter`变量的操作不会被其他操作打断,因此不需要额外的锁来保证线程安全。`LoadInt64`函数则用于安全地读取`counter`变量的值。

### 5.1.2 锁的类型与选择

虽然原子操作非常有用,但并不是所有的并发问题都可以用原子操作来解决。在这些情况下,我们需要使用锁来保证数据的一致性。Go语言中提供了多种锁的实现,包括互斥锁(Mutex)和读写锁(RWMutex)。

互斥锁是典型的排他性锁,它可以保护数据不被并发读写。一个简单的互斥锁使用示例如下:

```go

import "sync"

var mutex sync.Mutex

func lockedFunction() {

mutex.Lock()

defer mutex.Unlock()

// Critical section

}

```

`sync.Mutex`提供了`Lock()`和`Unlock()`方法来加锁和解锁。当一个goroutine在`Critical section`执行时,其他的goroutine将无法执行这一部分代码,直到锁被释放。

读写锁适用于读多写少的场景,它允许多个读操作并发执行,但写操作时会阻止其他读和写操作。使用`sync.RWMutex`可以实现读写锁:

```go

import "sync"

var rwmutex sync.RWMutex

func readFunction() {

rwmutex.RLock()

defer rwmutex.RUnlock()

// Read data

}

func writeFunction() {

rwmutex.Lock()

defer rwmutex.Unlock()

// Write data

}

```

在读操作中使用`RLock()`和`RUnlock()`方法,而在写操作中使用`Lock()`和`Unlock()`方法。这样可以有效地提高读取数据时的并发性。

## 5.2 Go内存模型与并发安全

### 5.2.1 内存模型概述

Go语言有一个非常清晰的内存模型,它定义了goroutine之间的内存可见性和顺序性规则。了解Go的内存模型对于编写正确的并发代码是至关重要的。Go内存模型通过Happens-before规则来描述事件之间的关系,保证了一些操作的顺序性,例如,如果一个goroutine对共享变量的写操作发生在读操作之前,那么读操作将能看到写操作的结果。

### 5.2.2 并发安全的最佳实践

为了保证并发时的数据安全,Go语言提供了一些并发安全的工具和模式。以下是一些基本的最佳实践:

1. 使用goroutine和channel进行线程安全的并发控制。

2. 优先使用原子操作处理简单的同步问题。

3. 在需要严格同步的场合使用互斥锁或读写锁。

4. 尽可能避免共享变量,或者对共享变量使用封装和局部化处理。

5. 使用`sync.Once`来确保某些操作只执行一次,例如初始化。

6. 通过`sync.WaitGroup`来同步多个goroutine的执行。

## 5.3 高级并发工具的探索

### 5.3.1 WaitGroup和Context的深入使用

`sync.WaitGroup`和`context.Context`是Go并发编程中不可或缺的两个工具。`WaitGroup`用于等待一组goroutine执行完成,而`Context`提供了控制goroutine生命周期的控制接口。

`WaitGroup`的典型用法如下:

```go

var wg sync.WaitGroup

func processItem(item int) {

defer wg.Done()

// Process the item

}

func main() {

items := []int{1, 2, 3, 4, 5}

for _, item := range items {

wg.Add(1)

go processItem(item)

}

wg.Wait()

}

```

在上述代码中,每个goroutine在开始时调用`wg.Add(1)`,在goroutine结束时调用`wg.Done()`。主线程使用`wg.Wait()`等待所有的goroutine执行完成。

`Context`则用于传递控制信号和截止时间等,它非常适合用于API请求处理、定时任务和并行函数的取消等场景。

```go

func main() {

ctx, cancel := context.WithCancel(context.Background())

go func(ctx context.Context) {

for {

select {

case <-ctx.Done():

return

default:

// Do some work

}

}

}(ctx)

// Do some work

cancel() // Closes the context, causing all the goroutines to return.

}

```

在这个例子中,创建了一个可以取消的`Context`,并且传递给了一个新的goroutine。如果在某个时刻调用了`cancel()`,则goroutine可以检测到context被关闭,并退出。

### 5.3.2 Go并发编程的未来方向

Go语言的并发模型非常简洁高效,但随着计算模型的发展,Go也在不断进化。随着Go 1.18引入的泛型,未来Go的并发工具也将更加多样化和强大。我们可以预见,Go未来将在并发编程方面提供更多高级抽象,例如更好的并发集合、更细粒度的并发控制结构等。同时,Go在并行计算方面也将继续优化,可能包括新的调度器改进、更优化的内存模型等。这将为Go的并发编程带来更多的可能性和挑战。

0

0