【urca包实战指南】:R语言中处理复杂经济指标的高级特性

发布时间: 2024-11-10 20:27:26 阅读量: 31 订阅数: 33

# 1. urca包简介与安装

## 1.1 urca包的背景介绍

在经济和金融研究中,时间序列分析是不可或缺的工具。为了简化这一过程,R语言中的urca包应运而生。urca代表Univariate and Multivariate Time Series Cointegration Analysis,其主要功能是进行单位根检验、协整检验和误差修正模型的建立。它是由Bernhard Pfaff开发的,旨在为用户提供一套全面的工具,以检验和分析经济数据中的长期关系和短期波动。

## 1.2 安装urca包

urca包是R语言中众多第三方包的一员,可以通过R的包管理器进行安装。要安装urca包,请按照以下步骤操作:

```R

# 打开R控制台或RStudio

install.packages("urca")

```

安装完毕后,可以通过加载urca包开始使用其功能:

```R

# 加载urca包

library(urca)

```

在接下来的章节中,我们将深入了解如何使用urca包进行时间序列的单位根检验以及协整分析,进一步深入到金融和经济数据分析的核心。

# 2. urca包的理论基础

### 2.1 时间序列分析基础

#### 时间序列的概念和特性

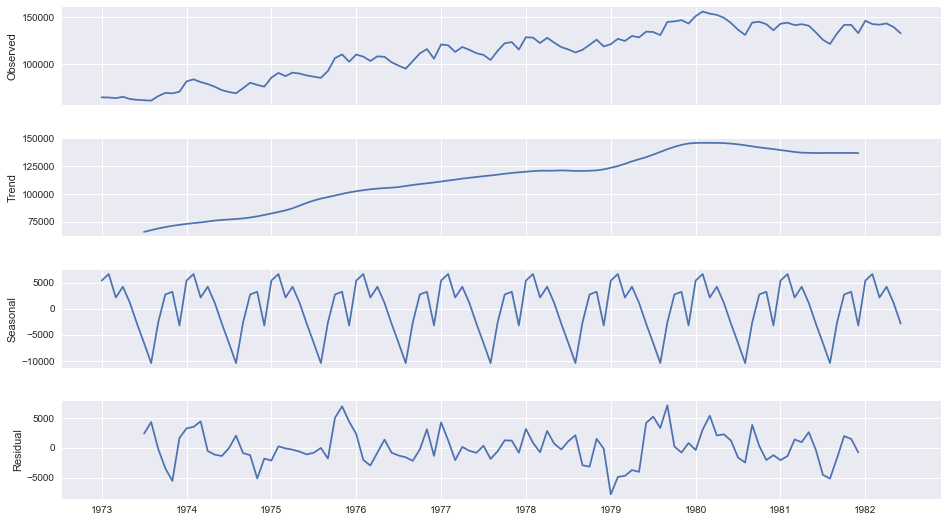

时间序列是按照时间顺序排列的一系列数据点,这些数据点通常在等间隔的时间上进行观测。在经济和金融领域,时间序列分析是研究经济指标、股票价格、货币汇率等随时间变化规律的重要工具。时间序列的数据点通常表现出一定的趋势和季节性成分,同时也可能受到随机干扰的影响。对时间序列进行分析,可以揭示数据的历史变动规律,并且可以用于预测未来的走势。

#### 经济指标的时间序列分析方法

经济指标的时间序列分析方法包括了多种技术,如移动平均、指数平滑、ARIMA模型等。移动平均法通过计算一定时间窗口内的平均值,来识别趋势和季节性变动。指数平滑技术则通过给予不同时间点的数据不同的权重,对未来的趋势做出预测。ARIMA模型是更为复杂的统计模型,能够分析和预测具有自回归和移动平均性质的时间序列数据。

### 2.2 单位根检验原理

#### 单位根检验的概念

单位根检验是时间序列分析中的一个重要环节,它用于判断一个时间序列是否是平稳的。如果一个时间序列含有单位根,那么它将表现为非平稳性,也就是说序列的统计特性(如均值和方差)会随时间变化。单位根检验的核心在于判断时间序列是否可以通过差分转换为平稳序列,从而使得序列数据适合于建模和预测。

#### 单位根检验的类型和选择

单位根检验主要分为两类:ADF检验(Augmented Dickey-Fuller检验)和PP检验(Phillips-Perron检验)。ADF检验通过在回归模型中加入因变量的滞后差分项来控制自相关性,而PP检验则通过非参数方法对残差进行修正。选择哪种检验方法通常取决于数据的特性,比如时间序列的自相关结构,以及是否需要考虑异方差性。

### 2.3 协整理论与误差修正模型

#### 协整的定义和经济意义

协整是指两个或多个非平稳时间序列的某种线性组合是平稳的。协整的存在表明了即使这些序列各自是非平稳的,它们之间可能存在一种长期的稳定关系。在经济分析中,协整关系能够说明两个或多个经济指标之间存在一种长期均衡,即使这些指标在短期内会偏离均衡状态。

#### 误差修正模型(Engle-Granger方法)

误差修正模型(ECM)是一种描述非平稳变量间协整关系并对其进行长期调整的模型。Engle-Granger方法是ECM的一个常见实现方式,它首先通过协整回归找到协整向量,然后构建误差修正项,并将其纳入差分形式的模型中。ECM模型能够解释序列间的短期动态,并能够在模型中包含序列间的长期均衡关系。

在本章节中,我们深入探讨了时间序列分析、单位根检验和协整理论的基础知识,并了解了它们在实际经济指标分析中的重要性和应用方法。这些概念和方法为理解urca包在时间序列分析中的应用提供了理论基础,也为下一章节中具体应用的介绍和操作步骤打下了坚实的基础。

# 3. urca包在时间序列分析中的应用

## 3.1 单位根检验的实践操作

### 3.1.1 使用urca包进行ADF检验

ADF检验(Augmented Dickey-Fuller检验)是一种常用的单位根检验方法,用于检验时间序列数据是否具有单位根,即该序列是否为非平稳序列。在R语言的urca包中,ADF检验可以通过`ur.df`函数来实现。以下是一个简单的例子,说明如何使用`ur.df`函数进行ADF检验:

```r

# 加载urca包

library(urca)

# 创建一个时间序列数据集

data_ts <- ts(c(1, 2, 3, 4, 5, 6, 7, 8, 9, 10), start = c(1990, 1), frequency = 1)

# 进行ADF检验

adf_test <- ur.df(data_ts, type = "drift", lags = 1)

# 查看检验结果

summary(adf_test)

```

在上述代码中,`type`参数指定了检验的类型,可以是"none"、"drift"或"trend"。参数`lags`决定了滞后期数,通常是根据信息准则自动选择的,但在某些情况下也可以指定特定的滞后期数。

### 3.1.2 检验结果的解释和应用

ADF检验的结果包括统计量、临界值和p值等关键信息。如果统计量小于临界值,或者p值小于显著性水平(如0.05),则拒绝原假设,即时间序列是平稳的。否则,我们不能拒绝原假设,说明时间序列可能是非平稳的。

在实际应用中,非平稳时间序列往往需要进行差分处理使其变为平稳序列,以便进行后续的分析和建模。差分可以通过`diff()`函数来实现。以下是差分处理的一个示例:

```r

# 对非平稳序列进行一次差分

differenced_ts <- diff(data_ts)

# 再次进行ADF检验以确认序列的平稳性

adf_test_differenced <- ur.df(differenced_ts, type = "none", lags = 0)

# 查看差分后的检验结果

summary(adf_test_differenced)

```

通过上述步骤,我们可以有效地将非平稳时间序列转换为平稳序列,进而开展进一步的统计分析和建模工作。

## 3.2 协整检验的实践操作

### 3.2.1 Johansen检验方法

Johansen检验是一种用于检验多个时间序列之间是否存在协整关系的方法。在urca包中,Johansen检验可以通过`ca.jo`函数实现。以下是一个使用`ca.jo`函数的简单例子:

```r

# 加载urca包

library(urca)

# 假设我们有两个时间序列数据集

y1 <- ts(c(100, 110, 115, 120, 130), start = c(1995, 1), frequency = 1)

y2 <- ts(c(120, 125, 135, 145, 160), start = c(1995, 1), frequency = 1)

# 创建一个时间序列矩阵

Y <- cbind(y1, y2)

# 使用Johansen检验方法进行协整检验

johan_test <- ca.jo(Y, type = "trace", K = 2, spec = "longrun")

# 查看Johansen检验结果

summary(johan_test)

```

在上述代码中,`type`参数用于指定检验类型,可为"trace"或"max", 分别对应迹检验和最大特征值检验。`K`参数指定了模型中的滞后数,`spec`参数指定了协整关系的假设类型。

### 3.2.2 协整关系的识别和经济指标分析

Johansen检验的结果通常包括特征值、迹统计量和最大特征值统计量等,通过与临界值比较,我们可以判断是否存在协整关系。如果存在协整关系,说明长期中这些时间序列之间有稳定的关联。

在识别了协整关系之后,我们可以进一步对经济指标进行分析。例如,可以构建向量误差修正模型(VECM),来分析变量之间在短期内的动态调整过程以及长期均衡关系。以下是一个VECM模型建立的示例:

```r

# 使用Johansen检验结果构建VECM模型

vecm_model <- cajorls

```

0

0