Python连接PostgreSQL批量数据处理优化:提升数据处理效率

发布时间: 2024-06-24 17:28:53 阅读量: 93 订阅数: 40

PostgreSQL性能优化

# 1. Python连接PostgreSQL基础

Python连接PostgreSQL数据库是数据分析和处理任务中的一项基本技能。本章将介绍建立Python与PostgreSQL数据库之间的连接所需的步骤,并涵盖连接参数的配置和连接对象的管理。

### 1.1 连接参数配置

要建立连接,需要指定连接参数,包括主机、端口、数据库名称、用户名和密码。这些参数可以通过psycopg2模块中的connect()函数传递:

```python

import psycopg2

# 连接参数

host = "localhost"

port = 5432

database = "my_database"

user = "my_user"

password = "my_password"

# 建立连接

conn = psycopg2.connect(

host=host,

port=port,

database=database,

user=user,

password=password,

)

```

### 1.2 连接对象的管理

连接对象提供了与数据库交互的方法,例如执行查询、插入数据和修改数据。连接对象可以通过with语句块进行管理,以确保在使用后自动关闭连接:

```python

with conn:

# 执行操作

cursor = conn.cursor()

cursor.execute("SELECT * FROM my_table")

results = cursor.fetchall()

```

# 2. Python连接PostgreSQL数据处理优化

### 2.1 批量数据处理技术

#### 2.1.1 psycopg2模块的批量插入和更新

**代码块:**

```python

import psycopg2

# 连接PostgreSQL数据库

conn = psycopg2.connect(

host="localhost",

port=5432,

database="test",

user="postgres",

password="my_password",

)

# 创建游标

cur = conn.cursor()

# 批量插入数据

data = [

(1, 'John Doe', 'johndoe@example.com'),

(2, 'Jane Doe', 'janedoe@example.com'),

(3, 'Peter Parker', 'peterparker@example.com'),

]

sql = """

INSERT INTO users (id, name, email)

VALUES (%s, %s, %s)

cur.executemany(sql, data)

# 批量更新数据

data = [

(1, 'John Doe', 'johndoe@example.com'),

(2, 'Jane Doe', 'jane.doe@example.com'),

(3, 'Peter Parker', 'peter.parker@example.com'),

]

sql = """

UPDATE users

SET name = %s, email = %s

WHERE id = %s

cur.executemany(sql, data)

# 提交更改

conn.commit()

# 关闭游标和连接

cur.close()

conn.close()

```

**逻辑分析:**

* 使用psycopg2模块的`executemany()`方法可以批量插入或更新数据。

* `executemany()`方法接受一个SQL语句和一个包含要插入或更新的数据的列表作为参数。

* 对于插入操作,数据列表中的每个元素是一个元组,包含要插入的列值。

* 对于更新操作,数据列表中的每个元素是一个元组,包含要更新的列值和要更新的行的ID。

* `executemany()`方法比逐行插入或更新数据更有效,因为它减少了与数据库的往返次数。

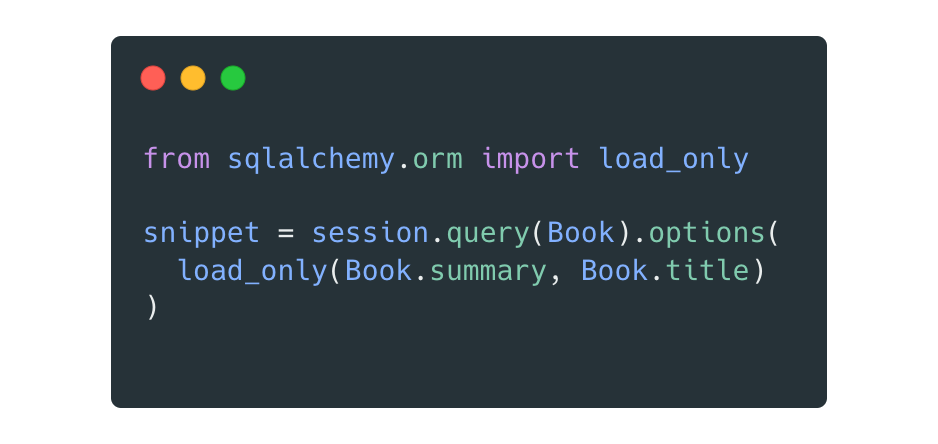

#### 2.1.2 SQLAlchemy的批量操作

**代码块:**

```python

from sqlalchemy import create_engine, Table, Column, Integer, String

from sqlalchemy.orm import sessionmaker

# 创建引擎

engine = create_engine(

"postgresql://postgres:my_password@localhost:5432/test"

)

# 创建会话

Session = sessionmaker(bind=engine)

session = Session()

# 创建表

users = Table(

'users',

engine,

Column('id', Integer, primary_key=True),

Column('name', String(255)),

Column('email', String(255)),

)

# 批量插入数据

data = [

{'name': 'John Doe', 'email': 'johndoe@example.com'},

{'name': 'Jane Doe', 'email': 'janedoe@example.com'},

{'name': 'Peter Parker', 'email': 'peterparker@example.com'},

]

session.execute(users.insert(), data)

# 批量更新数据

data = [

{'id': 1, 'name': 'John Doe', 'email': 'johndoe@example.com'},

{'id': 2, 'name': 'Jane Doe', 'email': 'jane.doe@example.com'},

{'id': 3, 'name': 'Peter Parker', 'email': 'peter.parker@example.com'},

]

session.execute(users.update().where(users.c.id == data[0]['id']), data)

# 提交更改

session.commit()

# 关闭会话

session.close()

```

**逻辑分析:**

* 使用SQLAlchemy的批量操作功能可以批量插入或更新数据。

* 批量插入操作使用`insert()`方法,批量更新操作使用`update()`方法。

* `insert()`和`update()`方法接受一个包含要插入或更新的数据的列表作为参数。

* 对于插入操作,数据列表中的每个元素是一个字典,包含要插入的列值。

* 对于更新操作,数据列表中的每个元素是一个字典,包含要更新的列值和要更新的行的ID。

* SQLAlchemy的批量操作功能比逐行插入或更新数据更有效,因为它减少了与数据库的往返次数。

### 2.2 性能优化策略

#### 2.2.1 连接池的使用

**代码块:**

```python

import psycopg2

# 创建连接池

pool = psycopg2.pool.SimpleConnectionPool(

1,

5,

host="localhost",

port=5432,

database="test",

user="postgres",

password="my_password",

)

# 获取连接

conn = pool.getconn()

# 使用连接

cur = conn.cursor()

cur.execute("SELECT * FROM users")

rows = cur.fetchall()

# 释放连接

pool.putconn(conn)

```

**逻辑分析:**

* 使用连接池可以提高应用程序的性能,因为它减少了创建和销毁连接的开销。

* 连接池维护一个预先配置数量的可用连接,应用程序可以根据需要获取和释放这些连接。

* 当应用程序需要一个连接时,它可以从连接池中获取一个可用的连接,而不用等待新的连接被创建。

* 当应用程序不再需要一个连接时,它可以将其释放回连接池,以便其他应用程序可以使用它。

#### 2.2.2 事务管理

**代码块:**

```python

import psycopg2

# 连接PostgreSQL数据库

conn = psyco

```

0

0