MATLAB模拟退火算法:复杂优化问题的解决方案

发布时间: 2024-08-30 10:08:35 阅读量: 353 订阅数: 52

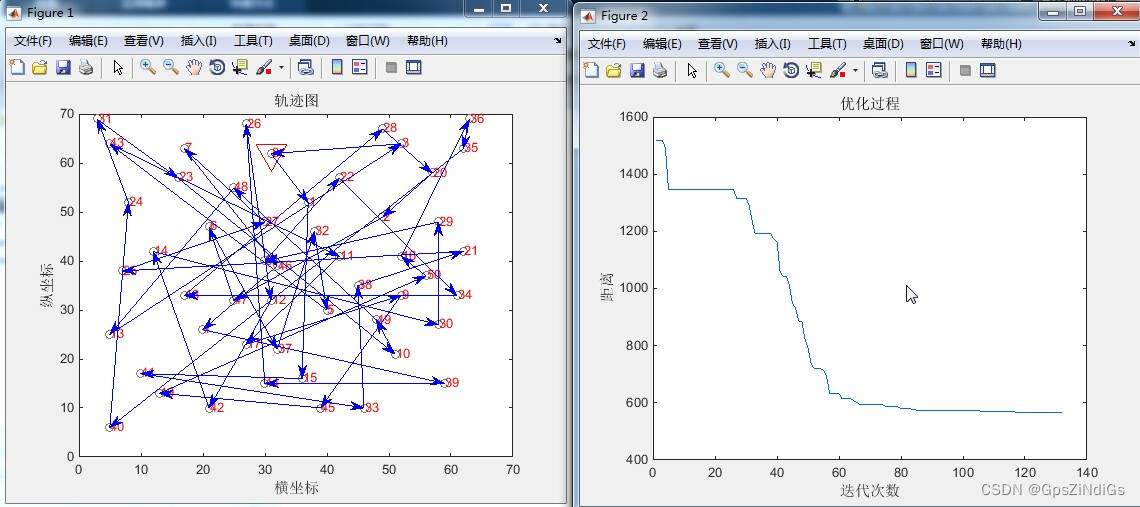

MATLAB模拟退火算法程序寻找最优路径规划

# 1. 模拟退火算法概述

在探索优化问题的解空间时,模拟退火算法(Simulated Annealing, SA)凭借其强大的全局搜索能力,已在众多领域证明了其价值。这一算法受到物理退火过程的启发,通过模拟固体物质加热后冷却结晶的过程,以概率性的方式来接受解决方案。SA能在解空间中跳出局部最优解,增加找到全局最优解的可能性。本章节我们将介绍模拟退火算法的基本概念、起源和在各种优化问题中的应用前景。通过理解这一算法,我们能够为解决复杂的工程优化问题提供新的视角和解决方案。

# 2. MATLAB中的模拟退火实现

## 2.1 MATLAB基础和数据结构

### 2.1.1 MATLAB环境介绍

MATLAB(Matrix Laboratory的缩写)是一个高性能的数值计算和可视化软件,由MathWorks公司开发。它广泛应用于工程计算、数据分析、算法开发和仿真等领域。MATLAB提供了一个交互式的环境,其中包含大量的内置函数和工具箱,这些工具箱涵盖了从信号处理、图像处理到深度学习等多个领域。

MATLAB的基本单位是矩阵,这使得它在处理线性代数和多维数据结构方面非常高效。用户可以通过简洁的命令和函数调用来执行复杂的数学运算和数据分析任务。MATLAB的脚本和函数文件以.m为扩展名,这些脚本和函数可以被组织成工程文件(.prj)或仿真模型(.slx)等更大的项目结构。

### 2.1.2 数据类型和矩阵操作

MATLAB支持多种数据类型,包括整数、浮点数、字符、字符串、逻辑值以及更复杂的结构体和单元数组。这些数据类型允许用户灵活地处理不同类型的数据和信息。矩阵是MATLAB中最核心的数据结构,几乎所有的运算都可以用矩阵运算来表示,这大大简化了代码的编写。

MATLAB中的矩阵操作非常直观。例如,创建矩阵可以通过方括号定义,矩阵的运算遵循线性代数的规则。此外,MATLAB还提供了众多内置函数来处理矩阵,包括但不限于矩阵乘法(`*`)、矩阵除法(`\`)、转置(`'`)、逆(`inv`)、行列式(`det`)以及求特征值和特征向量(`eig`)等。

## 2.2 模拟退火算法原理

### 2.2.1 算法的基本概念

模拟退火(Simulated Annealing, SA)算法是一种随机搜索算法,用于在给定的大搜索空间中寻找问题的最优解。其灵感来源于固体退火过程,即固体加热后再慢慢冷却的过程。在这个过程中,固体内的原子会随着温度的降低逐渐达到最低能量状态,也就是最稳定的结构。

在算法中,系统被模拟为能量状态,而搜索过程则尝试寻找能量最小(即成本最低)的状态。算法开始时设置一个较高的“温度”参数,通过随机扰动(即接受新解的概率)来探索解空间。随着温度的逐渐降低,接受新解的概率也逐渐降低,从而使得系统逐渐趋向稳定状态,即局部最小值或全局最小值。

### 2.2.2 温度调度策略

温度调度策略是模拟退火算法中最关键的部分之一,它决定了算法的性能和收敛速度。温度调度通常包括初始温度的设定、冷却速率以及终止温度的确定。

初始温度必须足够高,以确保系统能够在一开始跳出局部最小值,探索到足够大的解空间。冷却速率决定了温度下降的速度,过快可能导致算法过早收敛至局部最小值,而过慢则会增加算法的运行时间。终止温度通常设置为一个很小的正数,当温度低于这个值时,算法终止。

### 2.2.3 接受准则

接受准则定义了在当前解不是最优解时,是否接受新的解作为当前解的规则。在模拟退火算法中,最常用的接受准则是Metropolis准则,其表达式为:

\[ P(\Delta E, T) =

\begin{cases}

1 & \text{if } \Delta E < 0 \\

e^{\frac{-\Delta E}{T}} & \text{if } \Delta E \geq 0

\end{cases}

\]

其中,\(\Delta E\) 是新解与当前解能量差(成本差),\(T\) 是当前的温度参数。根据Metropolis准则,只有当新解的能量更低(即成本更低)时,新解才会被无条件接受。而当新解的能量更高(即成本更高)时,新解以一定的概率被接受,这个概率随温度的增加而增加。

## 2.3 MATLAB中的算法实现

### 2.3.1 MATLAB代码框架

在MATLAB中实现模拟退火算法通常涉及编写一个主要的函数,该函数包含模拟退火算法的核心步骤。以下是一个简化的MATLAB代码框架,展示了算法的基本结构:

```matlab

function [best_solution, best_cost] = simulated_annealing(initial_solution)

% 初始化参数

current_solution = initial_solution;

best_solution = current_solution;

current_cost = cost_function(current_solution);

best_cost = current_cost;

% 设置初始温度和冷却率

T = initial_temperature;

cooling_rate = ...;

% 开始模拟退火过程

while T > final_temperature

% 生成新的候选解

new_solution = perturb(current_solution);

new_cost = cost_function(new_solution);

% 根据接受准则决定是否接受新的解

if accept_new_solution(new_cost, current_cost, T)

current_solution = new_solution;

current_cost = new_cost;

% 更新最佳解

if new_cost < best_cost

best_solution = new_solution;

best_cost = new_cost;

end

end

% 降低温度

T = T * (1 - cooling_rate);

end

end

```

在这个框架中,`cost_function`是用于计算解的成本的函数,`perturb`用于生成邻域解,而`accept_new_solution`则实现了接受准则。这个框架可以针对具体问题进行扩展和修改,以适应不同类型的优化问题。

### 2.3.2 参数配置和优化

为了有效地应用模拟退火算法,需要对算法的参数进行仔细配置和优化。其中包括初始温度、冷却率、终止温度、扰动策略、接受准则等。在MATLAB中实现时,这些参数可以被定义为函数的输入参数,从而允许用户根据问题的不同进行调整。

参数配置通常依赖于具体问题和经验,可以采用试错法(trial and error)来确定最佳参数配置。此外,也可以利用自适应的方法来动态调整参数,例如根据当前的搜索状态来调整温度或冷却率,这样可以使算法更加灵活和有效。

在这个过程中,可以使用MATLAB的绘图功能来监控算法的性能,例如绘制成本与迭代次数的关系图,或者成本与温度的关系图。这样的可视化可以帮助用户更好地理解算法的收敛行为,从而调整参数以获得更好的结果。

```matlab

% 绘制成本变化图

figure;

plot(cost_history);

xlabel('Iteration');

ylabel('Cost');

title('Cost vs. Iteration');

```

这段代码将绘制出成本随迭代次数变化的趋势图,从而帮助用户评估算法性能和进行参数调整。通过适当的参数配置和优化,MATLAB中的模拟退火算法能够有效地解决各种复杂的优化问题。

# 3. 模拟退火算法在优化问题中的应用

## 3.1 函数优化

### 3.1.1 单峰和多峰函数优化

函数优化是模拟退火算法中最基本的应用之一,主要涉及单峰函数和多峰函数的最优化问题。单峰函数只有一个局部最优解,而多峰函数则具有多个局部最优解。模拟退火算法在寻找全局最优解的过程中,通过控制“温度”参数来减少陷入局部最优解的风险。

在单峰函数优化中,模拟退火算法能够快速地收敛到全局最优解,因为解空间中的路径相对简单。然而,在多峰函数优化中,如何避免陷入局部最优解,并探索到全局最优解,是算法需要解决的关键问题。

### 3.1.2 MATLAB中的函数优化实例

以下是使用MATLAB实现单峰和多峰函数优化的示例代码:

```matlab

% 单峰函数优化示例:Rosenbrock函数

x0 = [0, 0]; % 初始点

options = optimoptions('simulannealbnd','PlotFcns',@saplotbestx);

[x,fval] = simulannealbnd(@rosen,x0,options);

% 多峰函数优化示例:Ackley函数

x0 = [rand, rand]; % 随机初始点

options = optimoptions('simulannealbnd','PlotFcns',@saplotbest

```

0

0