实时目标检测系统构建全攻略:边缘计算与模型压缩

发布时间: 2024-11-21 22:34:36 阅读量: 27 订阅数: 35

java+sql server项目之科帮网计算机配件报价系统源代码.zip

# 1. 实时目标检测系统概述

实时目标检测系统是一种具备快速、准确识别和定位图像中一个或多个目标的技术。这些系统广泛应用于视频监控、自动驾驶、智能零售等多个领域,要求在保证检测精度的同时,尽可能缩短检测时延。本章将阐述实时目标检测系统的基本原理、关键技术以及应用场景。

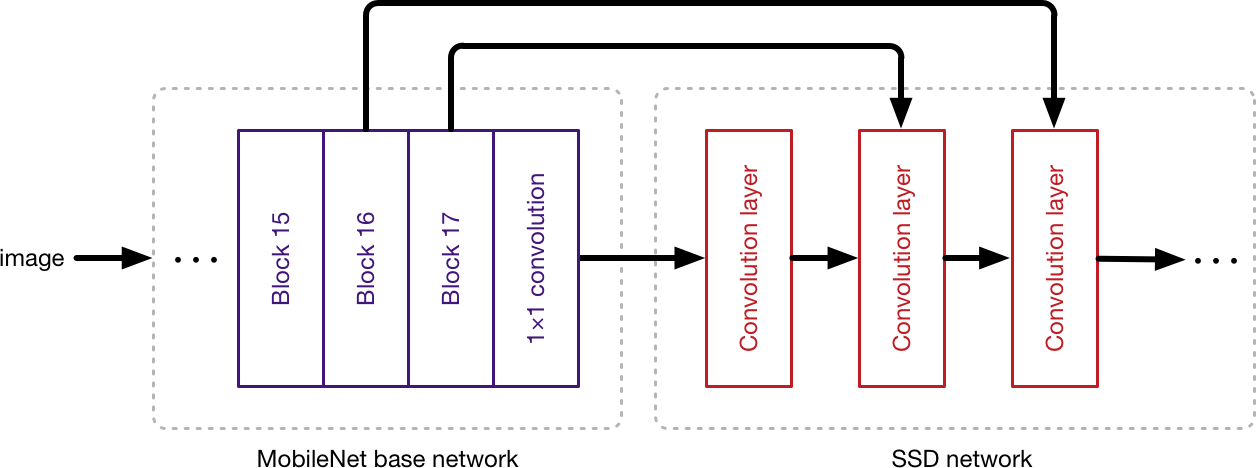

实时目标检测涉及的算法通常依赖于深度学习技术,特别是卷积神经网络(CNN)。这些模型在大量带标签的数据集上进行训练,以学习如何识别和分类图像中的不同物体。随着技术的发展,实时目标检测系统不仅仅要快速响应,还需适应边缘设备有限的计算资源。

我们将首先探讨实时目标检测系统的组成部分和工作流程,然后逐步深入了解边缘计算如何为这些系统带来革命性的变革,包括但不限于边缘计算的基础知识、边缘计算在目标检测中的应用,以及面临的挑战和优化策略。接下来,我们会聚焦模型压缩技术,它们对于边缘设备至关重要,并探讨如何在保持准确性的同时减少模型尺寸。最后,我们会深入实时目标检测系统的设计、实现、优化以及未来发展的方向。

# 2. 边缘计算基础与优势

边缘计算是一种分布式计算架构,旨在将数据的处理、分析和存储更靠近数据产生的地点,即网络边缘。这种模式有助于减少数据传输到云端或中心处理单元时产生的延迟,并提高数据处理的实时性和效率。本章将深入探讨边缘计算的定义、架构,它在目标检测领域的应用,以及面临的技术挑战和优化策略。

## 2.1 边缘计算的定义和架构

### 2.1.1 边缘计算的起源与定义

边缘计算的概念起源于对云计算延迟问题的关注。云计算模式下,大量数据需要被传输到遥远的数据中心进行处理,这在处理实时数据流时会导致不可接受的延迟。为了克服这一局限性,边缘计算将数据处理任务分布在设备的边缘,即靠近数据源的位置。

边缘计算可以定义为在数据源附近(如传感器、移动设备、网络边缘节点)进行数据处理的计算范式。它允许在本地进行数据处理和分析,同时仍然能够与云数据中心进行通信,从而实现数据传输的高效性和实时性。

### 2.1.2 边缘计算的基本架构模型

边缘计算的基本架构由三层组成:感知层、边缘层和云层。感知层负责收集原始数据,边缘层则对这些数据进行初步的处理和分析,而云层负责全局的数据存储、管理和长期的数据分析任务。

在边缘层,数据通常通过边缘节点进行处理,这些节点可能包括智能网关、边缘服务器等。这些边缘节点具备数据处理能力,可以运行轻量级的算法,执行任务如数据过滤、聚合和分析。它们是边缘计算架构的核心,负责维护系统的实时性能和低延迟。

## 2.2 边缘计算在目标检测中的应用

### 2.2.1 实时性与数据隐私的保障

在实时目标检测系统中,边缘计算扮演着至关重要的角色。它可以确保数据处理的实时性,这是因为边缘设备能够快速响应数据,无需等待云服务器的反馈。这对于需要即时反应的应用场景,如自动驾驶车辆、监控系统和工业自动化等,至关重要。

此外,边缘计算通过将数据处理限制在本地设备或边缘节点,大大增强了数据隐私的保护。敏感数据无需被发送到云端处理,从而降低了数据泄露的风险。

### 2.2.2 边缘计算与中心云计算的协同

边缘计算并非要取代云计算,而是与之形成互补。在边缘层进行数据的初步处理后,重要信息会被发送到云端进行进一步的分析和存储。这种方式可以利用云计算的强大处理能力和大规模数据管理的优势,同时保持边缘设备的高效率和低延迟。

在目标检测系统中,边缘计算可以处理那些需要快速响应的任务,而云计算则可以承担更复杂的任务,如历史数据的深度学习分析,或是进行大规模数据的长期存储和备份。

## 2.3 边缘计算技术的挑战与优化

### 2.3.1 资源限制下的性能优化

边缘计算设备通常资源有限,如处理能力、存储和能源供应。为了在这种环境下实现有效的计算任务,必须对算法和应用进行优化以适应边缘设备的限制。性能优化方法包括:

- 使用轻量级模型和算法,减少计算需求;

- 利用模型压缩技术,减小模型的存储和内存占用;

- 实施任务调度和负载均衡,优化资源使用。

### 2.3.2 安全性与可扩展性问题的解决方案

安全性是边缘计算中另一个需要重视的问题。边缘设备可能暴露在安全威胁下,因此需要实现强大的安全策略,如:

- 加密数据传输,防止数据在传输过程中被截获;

- 实施访问控制机制,确保只有授权用户和设备可以访问系统;

- 定期更新安全补丁和固件,以防御已知的安全漏洞。

此外,随着更多设备的接入,边缘计算系统需要具备良好的可扩展性。为此,可以采取如下措施:

- 使用模块化设计,允许系统根据需求动态扩展;

- 利用容器化技术,使应用部署更加灵活;

- 采用微服务架构,让系统能够在不同组件之间进行独立扩展。

通过本章节的介绍,我们可以看到边缘计算在实时目标检测系统中发挥的关键作用,以及为达到实时性和隐私性所采取的技术策略。同时,我们也认识到了边缘计算在资源受限条件下的性能优化问题,以及安全性与可扩展性方面的挑战,及其解决方案。在接下来的章节中,我们将继续探索模型压缩技术在实时目标检测系统中的应用,以及系统设计、测试与优化的更多细节。

# 3. 模型压缩技术与策略

模型压缩技术是当前深度学习领域的一项重要技术,它能够有效减小深度神经网络模型的大小,降低计算需求,提高运行效率,这对于在边缘设备上部署实时目标检测系统来说至关重要。本章将深入探讨模型压缩的概念、重要性、深度学习模型压缩技术以及模型压缩实践应用案例。

## 3.1 模型压缩的概念与重要性

### 3.1.1 模型压缩的目标和方法

模型压缩的目标是减少深度学习模型在运行时所需的存储空间和计算资源,从而降低延迟和提高响应速度。这在边缘计算场景

0

0