【数据分析探秘】:R语言探索性分析,解锁数据背后的故事

发布时间: 2024-11-08 06:22:52 阅读量: 28 订阅数: 41

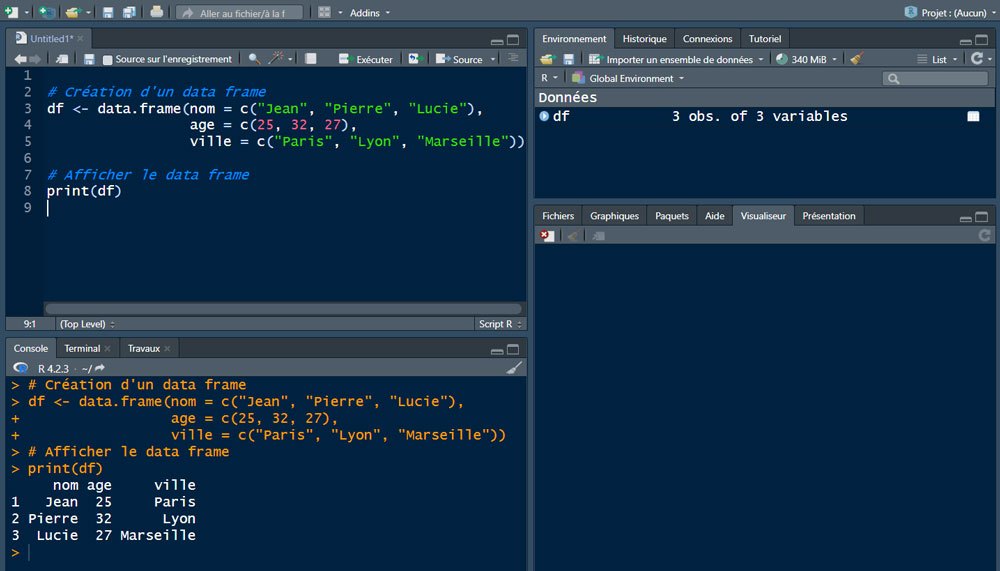

# 1. R语言数据分析基础

数据分析作为一门科学,目的是从大量信息中抽取有用的知识和见解。R语言,作为统计和数据分析领域中广泛使用的开源语言,以其强大的数据处理和分析能力受到了大量数据科学家和统计学家的青睐。本章我们将介绍R语言的基础概念,并带你了解其在数据分析中的基本应用。

## R语言简介

R是一种用于统计分析、图形表示和报告的语言和环境。它被全球范围内的研究人员、分析师和数据科学家广泛使用。R语言的开源性质意味着它拥有丰富的社区支持和扩展包,使得它能够应对从简单的统计计算到复杂的机器学习算法的所有问题。

## R语言的优势

- **易学易用**:R语言具有非常直观的语法结构,易于学习和上手。

- **强大的社区资源**:得益于其开源属性,R社区提供了大量的包和工具来扩展R的功能。

- **多样的数据处理能力**:R提供了多种数据结构如向量、列表、矩阵和数据框等,支持从基础到高级的数据处理需求。

- **高效的统计分析能力**:R具有丰富的统计分析和图形表示功能,使得数据探索和建模变得简单高效。

- **灵活的绘图系统**:R的图形能力非常强大,无论是简单的条形图还是复杂的生存分析图都可以轻松实现。

通过本章的学习,你将能够掌握R语言的核心概念,并为后续的深入学习打下坚实的基础。接下来的章节将详细介绍如何使用R语言进行数据预处理、探索性分析以及数据可视化等。

# 2. 数据预处理技巧

在数据科学中,数据预处理是至关重要的一步。良好的数据预处理能够为后续的分析提供准确可靠的输入,从而提高分析结果的质量和准确性。本章将详细介绍数据预处理中的关键技巧,包括数据清洗与准备、数据转换与重构、以及数据集的合并与连接。

### 2.1 数据清洗与准备

数据清洗与准备是数据预处理的首要任务。在这一阶段,主要关注的是识别并处理数据集中的缺失值和异常值。

#### 2.1.1 缺失值的处理

在现实世界的数据集中,缺失值是常见的问题。处理缺失值的方法很多,包括删除含有缺失值的行或列、填充缺失值、或者使用预测模型来估算缺失值。

在R语言中,我们常用`is.na()`函数来检测数据中的缺失值。`na.omit()`函数可以删除含有缺失值的行,而`mean()`、`median()`、`mode()`等函数则可以用来填充缺失值。此外,`mice`包提供的`mice()`函数可以用来对缺失值进行多重插补。

```r

# 示例代码:处理缺失值

# 假设有一个数据框df,含有缺失值

df <- data.frame(

x = c(1, NA, 3),

y = c(4, 5, NA)

)

# 删除含有缺失值的行

df_clean <- na.omit(df)

# 用列的均值填充缺失值

df_filled <- df

for (i in 1:ncol(df_filled)) {

df_filled[ , i] <- ifelse(is.na(df_filled[ , i]), mean(df_filled[ , i], na.rm = TRUE), df_filled[ , i])

}

# 使用mice包进行多重插补

library(mice)

df_mice <- mice(df, m=1, method='pmm') # 使用预测均值匹配方法

completedata <- complete(df_mice)

```

#### 2.1.2 异常值的识别与处理

异常值是指那些与其它观测值显著不同的数据点。处理异常值前,我们需要先识别它们。一个常用的方法是使用箱线图的四分位范围(IQR),来识别超出正常范围的值。

```r

# 示例代码:识别异常值

# 使用IQR方法识别异常值

df <- data.frame(values = c(10, 12, 12, 13, 12, 11, 300, 12, 11, 14, 13))

# 计算IQR

IQR_value <- IQR(df$values)

# 计算异常值范围

lower_bound <- quantile(df$values, 0.25) - (1.5 * IQR_value)

upper_bound <- quantile(df$values, 0.75) + (1.5 * IQR_value)

# 标记异常值

df$Outlier <- ifelse(df$values < lower_bound | df$values > upper_bound, 'Yes', 'No')

# 可视化结果

boxplot(df$values, main="Boxplot of Data with Outlier Identification", col='lightblue', ylab="Values")

text(y = df$values, labels = df$Outlier, pos = 3, col = c("red", "black")[unclass(df$Outlier)])

```

识别异常值后,根据具体情境决定处理策略,例如删除、修正或保留异常值。在R中,可以根据逻辑条件删除异常值所在的行,或使用替换值进行修正。

### 2.2 数据转换与重构

数据转换与重构是将原始数据转换成适合分析的格式。这可能包括变量变换和数据的重塑与聚合。

#### 2.2.1 变量变换

变量变换是对数据进行数学转换,以满足特定的分析需要或改善数据分布。常见的变换包括取对数、指数、平方根等。

```r

# 示例代码:变量变换

df <- data.frame(

original_data = c(1, 2, 3, 4, 5)

)

# 对原始数据取对数变换

df$log_data <- log(df$original_data)

# 对原始数据进行平方根变换

df$sqrt_data <- sqrt(df$original_data)

# 对原始数据进行平方变换

df$squared_data <- df$original_data^2

```

变量变换后的数据可能会更符合某些统计模型的假设,如正态分布假设。这在后续进行统计检验和建模时非常有帮助。

#### 2.2.2 数据重塑和聚合

数据重塑和聚合是处理数据集中数据结构的过程。重塑数据通常使用`reshape2`包或`tidyr`包中的函数,如`melt()`和`dcast()`;而聚合操作则可以使用`aggregate()`函数或`dplyr`包中的函数。

```r

# 示例代码:数据重塑和聚合

# 使用reshape2包进行数据重塑

library(reshape2)

df <- data.frame(

id = c(1, 2, 3),

value1 = c(10, 20, 30),

value2 = c(100, 200, 300)

)

# 将宽格式数据转换为长格式数据

df_long <- melt(df, id.vars="id")

# 聚合数据

# 使用aggregate函数根据id进行求和

df_summarized <- aggregate(value ~ id, df, sum)

# 使用dplyr包进行聚合

library(dplyr)

df_dplyr <- df %>%

group_by(id) %>%

summarize(total = sum(value1 + value2))

```

### 2.3 数据集的合并与连接

数据集的合并与连接是将两个或多个数据集根据某些共同的键值连接起来,创建一个包含所需所有信息的新数据集。

#### 2.3.1 基于键值的合并

在R中,可以使用`merge()`函数或`dplyr`包中的`left_join()`、`right_join()`、`inner_join()`和`full_join()`函数来合并数据集。合并操作基于一个或多个键值进行。

```r

# 示例代码:基于键值的合并

df1 <- data.frame(

id = c(1, 2, 3),

value1 = c(10, 20, 30)

)

df2 <- data.frame(

id = c(2, 3, 4),

value2 = c(100, 200, 300)

)

# 使用merge函数合并数据集

df_merged <- merge(df1, df2, by="id")

# 使用dplyr包进行合并

library(dplyr)

df_dplyr_merged <- left_join(df1, df2, by="id")

```

#### 2.3.2 处理不同数据源的连接问题

合并来自不同数据源的数据集时,经常会遇到键值不匹配的问题。在这种情况下,需要进行数据清洗或键值转换,以便能够正确合并。

```r

# 示例代码:处理不同数据源的连接问题

# 为合并准备两个不同的数据源

df1 <- data.frame(

id = c("A", "B", "C"),

value1 = c(10, 20,

```

0

0