Linux系统监控:性能监控与故障诊断,保障系统安全运行

发布时间: 2024-09-27 00:16:42 阅读量: 160 订阅数: 57

果壳处理器研究小组(Topic基于RISCV64果核处理器的卷积神经网络加速器研究)详细文档+全部资料+优秀项目+源码.zip

# 1. Linux系统监控概述

Linux作为目前主流的操作系统之一,在服务器、嵌入式设备、云计算等多个领域都有广泛的应用。为了确保系统的稳定性和安全性,进行有效的系统监控就显得尤为重要。

## 1.1 监控的重要性与目的

监控是IT运维管理中的核心环节,它可以实时跟踪系统运行状态,预防故障的发生,并在问题发生时快速定位和解决。监控的主要目的是为了:

- **提高系统稳定性**:通过持续监控关键指标,预防和迅速响应可能的系统问题。

- **确保服务可用性**:监控服务的运行情况,确保服务不中断。

- **性能优化**:通过收集性能数据,分析系统瓶颈,优化系统配置和性能。

- **安全性管理**:检测和响应安全威胁,保护系统不受攻击。

## 1.2 Linux监控工具概览

Linux环境下有许多成熟的监控工具,它们各有特点,适用于不同的监控场景。这些工具包括但不限于:

- **top命令**:动态查看系统进程和资源使用情况。

- **htop命令**:提供交互式的系统监控界面。

- **vmstat**:监控系统资源的统计信息和性能指标。

- **iostat**:分析CPU和磁盘I/O的使用情况。

- **nmon**:监控系统的多种资源使用情况,包括CPU、内存、网络、文件系统等。

## 1.3 监控与故障诊断的工作流程

为了有效进行系统监控和故障诊断,需要有一套标准的工作流程。通常包括以下步骤:

1. **定义监控目标**:明确监控系统要达成的目标,比如是性能监控、安全监控还是综合监控。

2. **选择合适的工具**:根据监控目标和需求选择合适的监控工具,并进行配置。

3. **实施监控策略**:制定监控任务和时间表,确保关键指标的持续跟踪。

4. **数据收集与分析**:收集监控数据并进行分析,寻找潜在的问题和性能瓶颈。

5. **故障诊断与处理**:一旦发现异常,立即进行故障诊断,确定问题的根源。

6. **优化与改进**:根据监控结果进行系统优化,并持续改进监控策略。

监控与故障诊断是一个持续的循环过程,需要不断地收集信息、分析数据和优化系统,才能确保Linux系统的高效稳定运行。接下来,我们将深入探讨Linux系统监控的各个方面,帮助读者建立起系统的监控与故障诊断知识体系。

# 2. Linux性能监控理论与实践

## 2.1 系统性能指标解析

性能监控是评估系统健康状况和资源使用情况的重要手段。在Linux系统中,性能指标通常包括CPU使用率和负载、内存使用情况、磁盘I/O性能和网络流量监控。

### 2.1.1 CPU使用率和负载

CPU是系统最重要的资源之一,其使用率和负载是衡量系统性能的关键指标。

**CPU使用率**:

- 使用率代表CPU在一段时间内工作的百分比。

- 使用率高意味着CPU正在忙于执行任务。

**CPU负载**:

- 负载是相对于系统能够处理的能力来说的,通常表示为1分钟、5分钟和15分钟的平均值。

- 这些值衡量的是系统在特定时间间隔内队列中的平均进程数。

```

# 查看CPU使用率和负载

top

```

top命令显示了系统中各个进程的CPU使用情况和系统的整体负载情况。输出的前三行包含了系统负载的平均值,而第四行及以下则展示了各个进程的CPU使用率。

### 2.1.2 内存使用情况

内存使用情况是系统性能的另一个重要指标。

- 物理内存(RAM)的使用率应保持在合理的水平。

- 虚拟内存(swap空间)的频繁使用可能表明物理内存不足。

```

# 查看内存使用情况

free -m

```

free命令的输出显示了总内存、已用内存、空闲内存、缓冲区和缓存使用的总量。这有助于理解当前内存的使用情况和系统如何使用swap空间。

### 2.1.3 磁盘I/O性能

磁盘I/O性能对于系统的整体性能有重要影响。

- 磁盘I/O性能指标包括读写速度、IOPS(每秒输入输出操作次数)和I/O等待时间。

- 高I/O延迟可能表明磁盘性能不佳或磁盘繁忙。

```

# 查看磁盘I/O性能

iostat -x

```

iostat命令提供了磁盘I/O性能的详细报告,包括每个设备的读写统计信息、IOPS以及I/O等待时间。这对于识别磁盘瓶颈非常有用。

### 2.1.4 网络流量监控

网络流量监控对于理解网络负载和潜在的网络问题至关重要。

- 网络流量监控可以帮助管理员识别数据传输异常、网络拥塞和网络攻击行为。

- 网络接口的接收和发送数据量是监控的重点。

```

# 查看网络接口状态

iftop -i eth0

```

iftop命令可以实时显示指定网络接口的流量情况,包括进出流量的速率和总量。这对于网络流量分析和问题定位非常有帮助。

## 2.2 实时性能监控工具应用

本节将详细介绍一些常用的实时性能监控工具及其应用技巧。

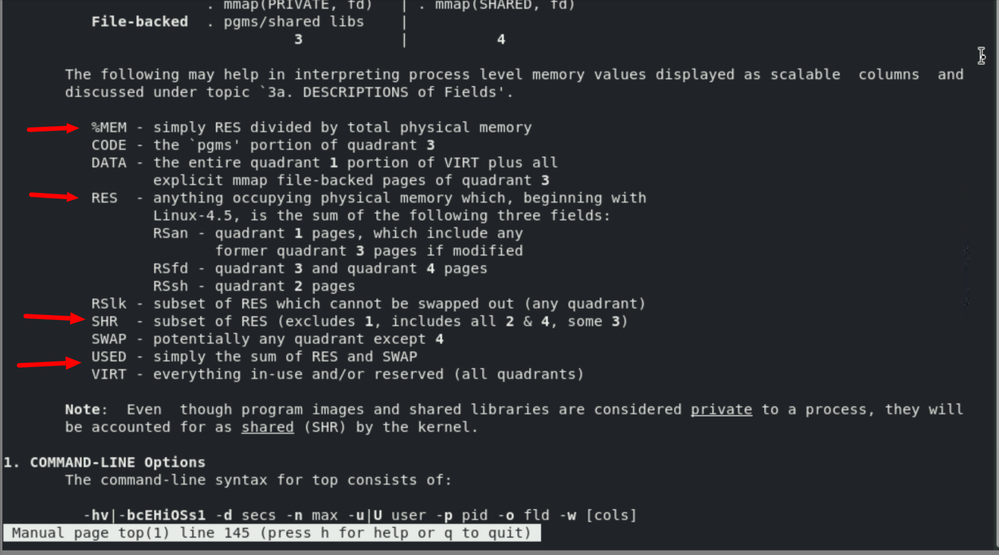

### 2.2.1 top命令详解

top命令是一个功能强大的实时监控工具,它提供了一个动态更新的系统进程视图。

- top命令通过不同选项可以显示不同的性能指标。

- 默认情况下,top显示最耗资源的进程在前。

```

# top命令的交互式功能

top

```

按下`M`键可以根据内存使用情况对进程排序,而`P`键可以按照CPU使用率排序。top命令支持许多交互式命令,允许用户根据需要过滤和排序显示的数据。

### 2.2.2 vmstat的使用技巧

vmstat命令提供了关于系统内存、进程、CPU、I/O等的简要报告。

- vmstat报告通常包含一个初始的活动报告和随后的间隔性采样报告。

- vmstat可以用来检查CPU、内存、磁盘、系统进程等的性能。

```

# 使用vmstat监控系统状态

vmstat 2 5

```

上面的命令将以2秒间隔采样5次,输出包括了系统活动的快照。这对于识别系统的动态变化非常有用。

### 2.2.3 iostat与网络监控工具

iostat和网络监控工具对于跟踪I/O和网络流量状况至关重要。

- iostat命令专门用来显示磁盘I/O统计信息。

- sar、iftop、nethogs等工具可以用来监控网络性能和流量。

```

# 使用sar监控系统活动报告

sar -u 1 5

sar -n DEV 1 5

```

第一个sar命令显示每秒一次的CPU使用率报告,持续5秒。第二个sar命令则提供网络设备的流量统计,同样以秒为间隔,显示5次。

## 2.3 性能数据收集与分析

性能数据的收集与分析是性能监控的重要组成部分,下面将介绍这一过程中的关键点。

### 2.3.1 日志文件的监控和分析

日志文件是系统性能监控的关键数据源,它们记录了系统的各种活动和事件。

- 日志文件通常包含有关进程状态、系统错误和安全事件的信息。

- 使用命令行工具如grep、awk或专门的日志分析工具如ELK栈可以帮助分析日志数据。

```

# 使用awk分析日志文件

awk '/error/ {print $1}' /var/log/syslog

```

上面的awk命令将输出所有包含“error”关键字的行的第一列,这有助于快速定位错误信息。

### 2.3.2 性能数据的长期存储与趋势分析

长期存储性能数据可以为趋势分析提供依据,这通常涉及到将数据收集到数据库中。

- 可以使用rrdtool、Prometheus等工具将性能数据收集并存储。

- 长期存储的数据可以用来识别系统性能的趋势和模式。

```

# 使用rrdtool创建数据存储并绘图

rrdtool create perfdata.rrd --step 300 \

DS:load:GAUGE:600:U:U \

RRA:AVERAGE:0.5:1:1200 \

RRA:AVERAGE:0.5:12:1400

rrdtool graph example.png --title "System Load" \

DEF:load=perfdata.rrd:load:AVERAGE \

LINE2:load#FF0000

```

上述示例使用rrdtool创建了一个存储300秒采样数据的RRD文件,并生成了一个图表,显示了系统负载的平均值。

### 2.3.3 性能

0

0