【Go并发I_O】:os包实现高效多线程文件处理的5大技巧

发布时间: 2024-10-20 16:22:17 阅读量: 22 订阅数: 27

go_basic:go语言的基础包

# 1. Go并发和I/O基础知识

Go语言通过其强大的并发支持和简洁的I/O操作接口,为构建高效的系统提供了良好的基础。在这一章中,我们将探索Go的并发模型和I/O操作的基本概念,为后续的深入学习打下坚实的基础。

## 1.1 Go并发模型概述

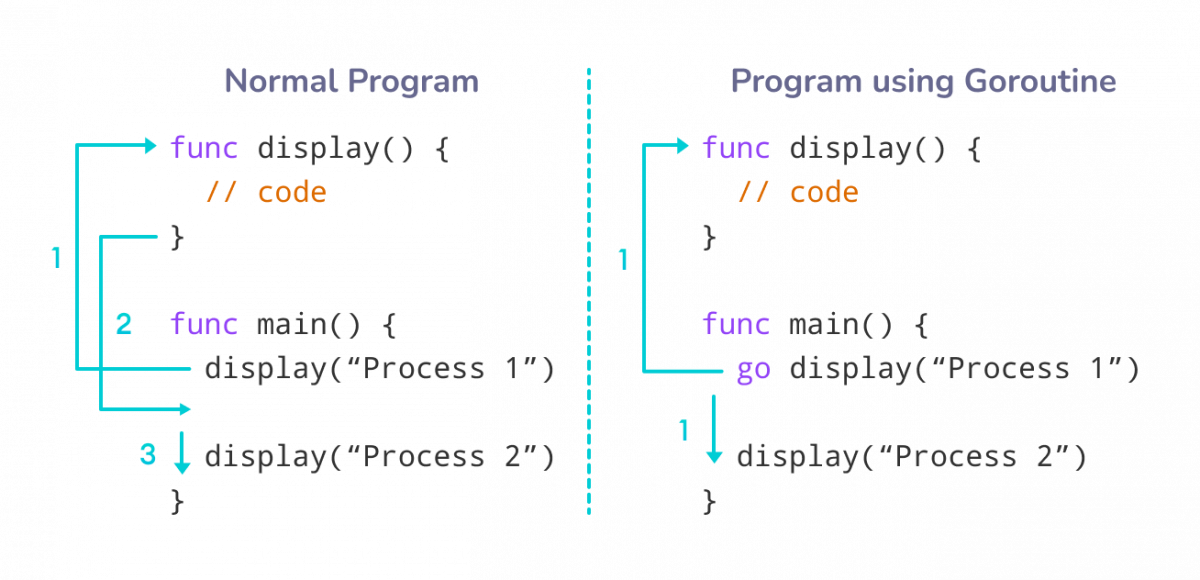

Go语言的并发模型基于`Goroutine`,这是Go运行时提供的轻量级线程。与传统操作系统线程相比,Goroutine的创建和销毁成本更低,更适合处理并发任务。通过`通道(Channels)`,Go实现了轻量级、高效的线程间通信机制,能够在不需要显式锁的情况下,安全地在多个Goroutine间共享数据。

```go

go func() {

// Goroutine的代码逻辑

}()

```

并发控制方面,Go提供了`sync`包中的同步原语,比如互斥锁`Mutex`、读写锁`RWMutex`、条件变量`Cond`等,以实现对共享资源的保护,防止并发中的数据竞争问题。

```go

var counter int

var mutex sync.Mutex

func Increment() {

mutex.Lock()

defer mutex.Unlock()

counter++

}

```

Go的并发模型为开发者提供了编写高效并发程序的工具和方法论。在下一章中,我们将深入了解`os`包,它是Go标准库中用于处理文件I/O操作的基石。

# 2. os包与并发文件操作基础

在现代软件开发中,文件操作是不可或缺的一部分。Go语言的`os`包提供了一系列处理操作系统文件的方法,而其并发模型为文件操作提供了强大的支持。本章将深入探讨`os`包的基础使用,以及如何在文件操作中应用Go的并发特性。

## 2.1 Go并发模型概述

在深入`os`包的文件操作之前,我们首先需要了解Go语言的并发模型。Go语言通过Goroutine实现了轻量级线程,而通道(channel)则是Goroutine间通信的机制。Goroutine允许开发者以极低的资源消耗并发地执行多个任务。通道则是用于在Goroutine间传递数据的安全方式。

### 2.1.1 Goroutine和通道的工作原理

在Go中启动一个Goroutine非常简单,只需要在函数调用前加上关键字`go`即可。这会使得该函数在一个新的Goroutine中异步运行。

```go

go function()

```

通道则是通过`make`函数创建,类型要和通过通道传递的数据类型匹配。例如,创建一个整型通道:

```go

ch := make(chan int)

```

向通道发送数据使用`<-`操作符:

```go

ch <- 1

```

从通道接收数据同样使用`<-`操作符,放在变量左侧表示读取,放在右侧表示向通道发送数据:

```go

value := <-ch

```

### 2.1.2 同步和并发控制机制

为了实现更精细的并发控制,Go语言提供了`sync`包,其中的`WaitGroup`和`Mutex`是最常用的同步机制之一。

`WaitGroup`用于等待一组Goroutine完成,它允许一个主Goroutine等待一组由`WaitGroup.Add`方法添加的Goroutine执行完成。使用`Done`方法告知`WaitGroup`一个Goroutine已经完成执行。

```go

var wg sync.WaitGroup

func someGoroutine() {

defer wg.Done()

// Goroutine的工作

}

wg.Add(1) // 通知WaitGroup有一个Goroutine需要等待

go someGoroutine()

wg.Wait() // 等待所有Goroutine完成

```

`Mutex`则是Go语言中的一种互斥锁,可以用来避免多个Goroutine在同一时间对同一资源进行读写操作,从而引发竞态条件。

```go

var mu sync.Mutex

func someFunction() {

mu.Lock() // 加锁

defer mu.Unlock() // 确保解锁

// 访问或修改共享资源

}

```

## 2.2 os包的基本使用

在了解了Go的并发机制后,现在我们来看看如何使用`os`包进行基本的文件操作。`os`包提供了丰富的API来对文件和目录进行操作,包括文件的打开、读写、关闭以及目录的创建、删除和遍历等。

### 2.2.1 文件读写操作

使用`os.Open`函数可以打开一个文件,进行读取操作。该函数返回两个值,一个是文件对象,另一个是可能发生的错误。

```go

file, err := os.Open("example.txt")

if err != nil {

log.Fatal(err)

}

defer file.Close() // 关闭文件

```

写入文件则可以使用`os.Create`或者`os.OpenFile`,`os.Create`在文件不存在时会创建文件,如果文件已存在则会被截断为零长度。

```go

newFile, err := os.Create("newfile.txt")

if err != nil {

log.Fatal(err)

}

defer newFile.Close() // 关闭文件

```

读取和写入文件内容可以使用`io`包中的`Read`和`Write`方法:

```go

func (file *File) Read(b []byte) (n int, err error)

func (file *File) Write(b []byte) (n int, err error)

```

### 2.2.2 目录管理和文件信息获取

创建目录可以使用`os.Mkdir`函数,该函数需要传入目录名和权限模式。

```go

err = os.Mkdir("newdir", 0777)

if err != nil {

log.Fatal(err)

}

```

如果需要创建多级目录,`MkdirAll`函数则更为合适。

```go

err = os.MkdirAll("path/to/dir", 0777)

if err != nil {

log.Fatal(err)

}

```

获取文件信息可以使用`os.Stat`函数,它返回一个`FileInfo`对象,可以用来获取文件大小、修改时间和文件类型等信息。

```go

info, err := os.Stat("example.txt")

if err != nil {

log.Fatal(err)

}

fmt.Println("File size:", info.Size())

```

通过这些基础的`os`包用法,我们可以进行文件的读写和目录管理。但是,为了在文件操作中充分利用Go的并发特性,还需要进一步了解如何结合Goroutine和通道进行优化处理。在下一章节中,我们将深入探讨os包并发I/O优化技巧。

# 3. os包并发I/O优化技巧

## 3.1 高效读写大文件

### 3.1.1 利用缓冲区优化文件读写

处理大文件时,直接使用系统调用进行读写可能会导致性能瓶颈。因此,通常会通过在用户空间中引入缓冲区来缓解这一问题。缓冲区的使用可以减少系统调用的次数,从而提高效率。

在Go中,可以使用标准库`io`包提供的`Buffered`接口来为文件操作添加缓冲。例如,可以使用`bufio`包中的`bufio.Writer`和`bufio.Reader`来处理大文件的读写。

下面是一个使用`bufio`包进行文件读写的示例代码:

```go

package main

import (

"bufio"

"os"

)

func main() {

// 创建或打开文件

file, err := os.Create("largefile.txt")

if err != nil {

panic(err)

}

defer file.Close()

// 创建一个缓冲写入器

bufferedWriter := bufio.NewWriter(file)

// 将数据写入缓冲区

for i := 0; i < 10000; i++ {

// 假设每个字符串有50个字节

data := []byte("some random string")

_, err := bufferedWriter.Write(data)

if err != nil {

panic(err)

}

}

// 刷新缓冲区,确保所有内容都写入文件

err = bufferedWriter.Flush()

if err != nil {

panic(err)

}

// 读取操作时也可以用到bufio.Reader

bufferedReader := bufio.NewReader(file)

buf := make([]byte, 50)

for {

n, err := bufferedReader.Read(buf)

if err != nil {

if err != io.EOF {

panic(err)

}

break

}

// 处理读取到的数据

// ...

}

}

```

在这段代码中,我们创建了一个文件,并用`bufio.Writer`来写入大量数据,然后用`bufio.Reader`来读取它们。`bufio.Writer`会在内部维护一个缓冲区,当缓冲区填满后,会自动将缓冲区中的数据批量写入文件,减少了实际的磁盘I/O操作次数。

### 3.1.2 文件分割与并发合并策略

处理大文件时,分割成多个小文件然后并发处理每个小文件,最后再进行合并是一种常见的优化策略。这种方式可以让多个gorouti

0

0