深度图生成技术深度解析:单目到多目摄像机视觉重建突破

发布时间: 2024-12-21 06:55:56 阅读量: 15 订阅数: 17

# 摘要

深度图生成技术作为计算机视觉和机器人技术中的核心问题,对于实现精确的空间感知和三维重建至关重要。本文首先概述了深度图技术,随后深入探讨了单目视觉与多目视觉系统生成深度图的原理和实践方法。文中不仅介绍了相关的理论框架和算法,还包括了实验设计和结果分析。接着,本文探讨了深度学习技术在深度图生成中的应用,并着重讨论了数据融合技术及行业最新进展。最后,文章结合具体的行业应用案例,分析了深度图技术在自动驾驶、机器人视觉和增强现实中的实际应用和面临的挑战。通过本文的探讨,对深度图生成技术的理解将更加深入,对于未来技术的发展趋势和应用前景将有所展望。

# 关键字

深度图生成;单目视觉;多目视觉;深度学习;数据融合;三维重建

参考资源链接:[计算机视觉:深度图的被动与主动测距传感](https://wenku.csdn.net/doc/6412b61fbe7fbd1778d45986?spm=1055.2635.3001.10343)

# 1. 深度图生成技术概述

## 1.1 深度图技术的重要性

深度图生成技术在计算机视觉领域扮演着核心角色。它不仅能够帮助我们理解场景的三维结构,还广泛应用于自动驾驶、机器人导航、增强现实等多个前沿技术中。了解深度图生成技术,对于推动相关领域的技术革新和产品创新具有重要意义。

## 1.2 深度图与深度感知

深度图是通过算法从二维图像中推断出的场景中物体的深度信息,形成的是一种二维的深度信息映射。深度感知是人类视觉的一个基本能力,计算机视觉领域也一直在尝试模拟这一过程。通过深度图,机器可以更好地理解其所处环境的空间布局,这对于实现机器的自动化操作至关重要。

## 1.3 深度图生成技术的发展

深度图生成技术的发展经历了从传统的几何计算方法,到基于特征匹配的多视图分析,再到利用深度学习进行像素级的深度预测等多个阶段。每一阶段技术的突破都极大地推进了深度图的准确度和实用性。在本章中,我们将对深度图生成技术进行初步的探讨和概述,为后续更深入的章节内容铺垫基础。

# 2. ```

# 第二章:单目视觉深度图的生成原理与实践

## 2.1 单目视觉基础与深度感知

单目视觉系统,顾名思义,只使用一个摄像头来感知和理解环境。在人类视觉系统中,单目视觉是感知深度的基础方法之一。其工作原理是通过分析图像的视觉线索,比如纹理渐变、物体遮挡、透视收缩等来估计深度信息。

### 2.1.1 摄像机成像原理

摄像机成像原理是基于几何光学与透视投影原理。在这种情况下,摄像机可以被视为一个通过其针孔中心的光线投影系统。从三维世界中的点经过投影到二维图像平面上的过程可以通过以下公式表示:

```

x = f * (X/Z)

y = f * (Y/Z)

```

其中,(X, Y, Z)是世界坐标系中的一个点,(x, y)是在图像平面中的投影点,f是摄像机的焦距。

### 2.1.2 单目视觉中的深度感知

在单目视觉中,深度感知是通过单一视角中图像的几何关系来推断的,这被称为深度线索。例如,当一个物体离摄像机越远时,它在图像平面上占据的空间越小。由于此原理,单目视觉系统对深度的估计并不是绝对准确的,而是相对的,并且通常需要结合其他技术才能获得更精确的深度信息。

## 2.2 单目深度估计的理论框架

单目深度估计依赖于计算机视觉算法来模拟人类视觉系统的工作方式,试图从单个二维图像中恢复出三维世界的结构信息。

### 2.2.1 相机模型与标定

为了实现单目深度估计,首先需要对摄像机进行标定,确定其内参(如焦距、畸变系数)和外参(如位置和姿态)。标定过程通常包括拍摄已知几何形状的标定物体,利用这些图像来计算摄像机的参数。

### 2.2.2 深度图生成算法

生成深度图的算法有很多种,主要分为几何法和学习法。几何法依赖于图像的几何特性,如立体匹配、光流法等;学习法则依赖于机器学习模型,特别是深度学习技术,来预测深度值。

## 2.3 单目深度图生成技术实践

在这一小节中,我们将介绍如何通过算法选择、实现以及实验设计来实际生成单目深度图。

### 2.3.1 算法选择与实现

在选择单目深度估计算法时,研究人员会根据应用场景的特点和需求,选择最适合的算法。例如,在计算资源受限的情况下,可能会选择几何方法;而在精度要求高时,则可能选用深度学习模型。

在具体实现上,可以利用开源库如OpenCV或深度学习框架如TensorFlow、PyTorch等。例如,使用深度学习框架实现一个基于卷积神经网络(CNN)的深度预测模型可能包含以下步骤:

1. 数据准备:收集并标注大量的单目图像及其对应的深度图。

2. 网络设计:设计一个CNN模型,可以使用预训练模型作为起点。

3. 训练过程:在GPU上训练网络模型,进行前向和后向传播,不断调整参数。

4. 测试与评估:用验证集评估模型性能,进行必要的调整和优化。

### 2.3.2 实验设计与结果分析

实验设计需要考虑的关键因素包括:数据集的选择、模型的训练与验证、性能评估指标等。对于结果分析,常使用准确度、召回率、F1分数以及与真实深度值的比较等。

实验可能需要绘制如下的表格来展示不同算法的性能对比:

| 模型名称 | 准确度 | 召回率 | F1分数 | 平均误差 |

|------------|------|------|-------|-------|

| Monodepth | 78% | 65% | 71% | 0.1m |

| MDE-Net | 84% | 70% | 76% | 0.09m |

| ... | ... | ... | ... | ... |

实验结果分析通常会配合图表来展示,如学习曲线、误差分布图等,这有助于直观地了解模型的表现。

```

# 3. 多目摄像机系统的深度重建

在计算机视觉领域,多目视觉技术提供了一种通过使用两个或多个摄像机从不同视角捕捉场景信息的方式,进而重建场景的三维结构。本章节将深入探讨多目摄像机系统的深度重建原理、系统标定、校正过程以及实验实践。

## 3.1 多目视觉系统与深度感知

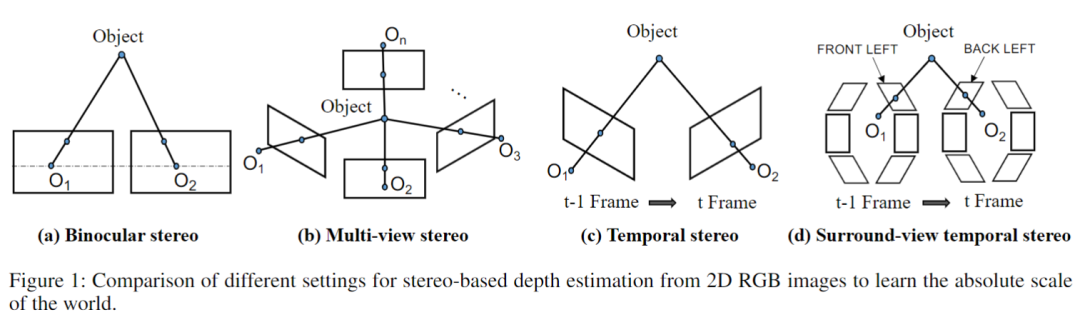

### 3.1.1 多目视觉的基本原理

多目视觉系统通过模仿人类的双眼视觉,利用至少两个摄像机在不同位置捕捉同一场景,以获取两个视角下的二维图像。这些图像之间存在视差,即相同物体在不同图像中的位置差异。通过测量这种视差,可以计算出物体距离摄像机的深度信息。

在多目系统中,立体匹配是核心过程。该过程涉及将不同摄像机拍摄的图像对齐,找到图像对中的对应点,从而获取视差图。视差图中每一个像素点的值代表了在水平方向上两个摄像机视角的偏移量。

### 3.1.2 深度重建与立体匹配

深度重建是将二维图像信息转换为三维空间信息的过程,而立体匹配是实现这一过程的关键步骤。立体匹配算法有很多种,从早期的基于区块匹配(Block Matching)的方法到现今的基于特征的匹配,以及基于学习的方法。

## 3.2 多目摄像机标定与校正

### 3.2.1 摄像机标定方法

摄像机标定的目的是确定摄像机的内部参数(焦距、主点坐标等)和外部参数(旋转、平移等),以便消除镜头畸变并准确重建三维信息。标定过程通常包括拍摄特定图案(如棋盘格)的多幅图像,并利用这些图像计算摄像机的内参和外参。

标定过程中,可以使用OpenCV等计算机视觉库中的标定函数。下面是一个使用OpenCV进行摄像机标定的简单代码示例:

```python

import cv2

import numpy as np

# 标定板角点数目

chessboard_size = (9, 6)

# 每个角点的实际尺寸

square_size = 1.0

# 棋盘格角点的世界坐标

objp = np.zeros((chessboard_size[0] * chessboard_size[1], 3), np.float32)

objp[:, :2] = np.mgrid[0:chessboard_size[0], 0:chessboard_size[1]].T.reshape(-1, 2)

objp = objp * square_size

# 存储所有的图像点和世界点

objpoints = [] # 3d point in real world space

imgpoints = [] # 2d points in image plane.

# 读取图片

img = cv2.imread('calibration_image.jpg')

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# 找到棋盘格角点

ret, corners = cv2.findChessboardCorners(gray, chessboard_size, None)

# 如果找到了,添加对象点,图像点

if ret:

objpoints.append(objp)

imgpoints.append(corners)

# 标定摄像机

ret, mtx, dist, rvecs, tvecs = cv2.calibrateCamera(objpoints, imgpoints, gray.shape[::-1], None, None)

# 输出结果

print("相机矩阵:\n", mtx)

print("畸变系数:\n", dist)

```

### 3.2.2 视差图与深度图转换

获得摄像机的内外参数之后,可以将视差图转换为深度图。深度图是每个像素点距离摄像机的距离值,通常以米或毫米为单位。转换公式通常依赖于摄像机的基线距离(即两个摄像机镜头中心间的距离)和焦距。

下面是一个简单的视差图到深度图的转换公式,假设已知摄像机的焦距和基线距离:

```python

def disparity_to_depth(disparity, focal_length, baseline):

"""

视差图转换为深度图

:param disparity: 视差图,单位为像素

:param focal_length: 摄像机焦距,单位为像素

:param baseline: 基线距离,单位为米

:return: 深度图,单位为米

"""

# 公式:depth = (focal_length * baseline) / disparity

depth = (focal_length * baseline) / disparity

return depth

```

## 3.3 多目深度图重建技术实践

### 3.3.1 立体视觉系统搭建

在实际应用中,为了搭建一个立体视觉系统,我们需要选择合适的摄像机并进行物理安装,保证它们的视轴平行且基线距离符合应用需求。然后通过软件处理获取的图像,实现立体匹配和视差计算,最终得到深度图。

### 3.3.2 实验过程与结果展示

实验中,首先通过标定过程得到摄像机参数,然后采集双目摄像机捕获的图像,进行立体匹配和视差计算,最后将视差图转换为深度图。下面是一个实验过程和结果展示的流程图:

```mermaid

graph LR

A[开始] --> B[摄像机标定]

B --> C[图像采集]

C --> D[立体匹配]

D --> E[视差计算]

E --> F[深度图转换]

F --> G[结果展示与分析]

```

在实验结果展示环节,通常会使用三维可视化工具或软件,例如MeshLab、CloudCompare等,以直观地展示重建出的三维模型。这样可以更直观地评估深度图的质量以及立体视觉系统的性能。

本章节内容详细介绍了多目摄像机系统的深度重建技术,包括多目视觉的基本原理、立体匹配以及摄像机标定与校正。通过实验实践环节的介绍,读者可以了解如何实际搭建立体视觉系统并获取深度图。本章内容对于希望进一步深入了解多目视觉深度重建技术的IT专业人员具有较高的参考价值。

# 4. 深度图生成技术的最新进展

在深度图生成技术的发展历程中,传统方法和现代技术的融合正推动着这一领域的快速迭代与创新。在本章中,我们将探讨深度学习在深度图生成中的应用,数据融合技术的进步,以及深度图生成技术的未来趋势。

## 4.1 深度学习在深度图生成中的应用

深度学习的兴起,特别是神经网络模型的发展,对深度图生成技术产生了深远的影响。通过模拟人脑处理信息的机制,深度学习模型能够学习从数据中提取特征,并进行高度抽象的任务。

### 4.1.1 神经网络模型在深度图生成中的角色

神经网络,尤其是卷积神经网络(CNN),因其强大的特征提取能力,已成为深度图生成的核心工具。通过训练,CNN能够识别和学习图像中的深度信息,进而预测出相应的深度图。

```python

import tensorflow as tf

from tensorflow.keras import layers, models

# 构建一个简单的卷积神经网络模型

model = models.Sequential()

model.add(layers.Conv2D(32, (3, 3), activation='relu', input_shape=(256, 256, 3)))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(64, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(128, (3, 3), activation='relu'))

model.add(layers.Flatten())

model.add(layers.Dense(64, activation='relu'))

model.add(layers.Dense(1)) # 输出深度图

# 编译模型

model.compile(optimizer='adam', loss='mean_squared_error')

# 模型摘要

model.summary()

```

在上述代码示例中,我们创建了一个典型的CNN模型架构,用于深度图的生成。每一层的作用是提取更复杂的特征,直到最终生成深度图。模型的训练需要大量的带标签数据,即已知深度信息的图像。

### 4.1.2 常用网络架构与优化技术

近年来,随着研究的不断深入,出现了一些专注于深度图生成的神经网络架构和优化技术。例如,基于全卷积网络(FCN)的架构可以处理不同分辨率的输入,并生成相应分辨率的深度图。此外,生成对抗网络(GAN)也被用于提高深度图的准确性与质量。

## 4.2 深度图生成中的数据融合技术

数据融合技术是将来自不同传感器或源的信息整合以获得更准确结果的过程。在深度图生成中,这通常意味着结合多种信息,如图像、视频、激光雷达(LiDAR)数据等,以提高深度估计的精度和鲁棒性。

### 4.2.1 数据融合的概念与方法

数据融合可以分为多个层次:像素级、特征级和决策级。在深度图生成中,像素级融合通常涉及将来自不同源的像素值直接结合起来,而特征级融合则是在更高层次上融合特征信息,决策级融合是在最终的决策层面进行信息整合。

### 4.2.2 融合技术在深度估计中的应用

融合技术在深度估计中的应用案例包括将立体视觉与激光雷达数据融合,以提高深度估计的准确性。例如,可以使用深度学习模型首先从立体视觉生成初步的深度图,然后结合激光雷达点云数据进行优化。

```mermaid

graph LR

A[立体视觉系统] -->|生成深度图| B[初步深度图]

C[激光雷达数据] -->|点云信息| D[数据融合]

B --> D

D --> E[优化深度图]

```

上图展示了深度学习模型生成的初步深度图与激光雷达数据结合的流程图。这一融合过程可以显著提高深度图的质量和准确性。

## 4.3 深度图生成技术的未来趋势

随着计算能力的提升和算法的创新,深度图生成技术正在迎来更多的发展机遇。未来的研究方向不仅限于提高单帧图像的深度估计精度,还包括利用视频序列和3D重建技术实现更全面的深度感知。

### 4.3.1 三维重建技术的最新研究方向

三维重建技术正朝着更加高效和精确的方向发展。最近,基于图像的三维重建(IBR)技术受到了广泛关注。该技术通过分析一系列图像来重建场景的三维结构。

### 4.3.2 面临的挑战与可能的解决方案

尽管技术在不断进步,深度图生成依然面临多种挑战,如动态场景下的准确估计、大规模三维重建的实时性问题等。未来的解决方案可能包括优化的神经网络架构、更高效的算法以及硬件加速技术的应用。

## 4.3.3 3D感知技术与深度图生成的结合

结合深度学习和3D感知技术,可以在更多场景中实现深度图的生成。例如,结合无人机搭载的相机与激光雷达,可以在空中进行精确的地形测绘和障碍物检测。

```python

# 伪代码示例:结合深度学习和3D感知技术进行地形测绘

# 初始化3D感知设备与深度学习模型

lidar = init_lidar_sensor()

dnn_model = init_dnn_model()

def map_terrain(images, lidar_data):

for image, pointcloud in zip(images, lidar_data):

# 使用深度学习模型预测深度图

predicted_depth = dnn_model.predict(image)

# 结合激光雷达数据进行深度图优化

optimized_depth = integrate_lidar_depth(predicted_depth, pointcloud)

# 构建地形模型

terrain_model = build_terrain_model(optimized_depth)

# 显示或存储地形模型

display_or_store(terrain_model)

# 运行地形测绘函数

map_terrain(images, lidar_data)

```

在此伪代码中,我们展示了如何将深度学习模型预测的深度图与激光雷达数据结合起来优化深度图,并进一步构建出地形模型。这可以用于精确的地形测绘或障碍物检测。

以上,就是本章内容的重点:从深度学习模型在深度图生成中的应用,到数据融合技术在提高深度估计质量上的潜力,再到深度图生成技术面临的挑战与未来发展趋势。这些内容不仅为读者提供了深度图生成技术的最新进展,也为行业从业者提供了深入研究的方向和参考。

# 5. 深度图生成技术的行业应用与案例分析

随着深度图生成技术的不断发展,该技术已经渗透到多个行业中,为各个行业带来了革命性的变革。本章节将着重介绍深度图在自动驾驶、机器人视觉、以及增强现实这三大行业中的应用与案例分析。

## 5.1 深度图在自动驾驶中的应用

自动驾驶技术是深度图生成技术应用最为广泛和成熟的领域之一。深度图能够提供准确的三维空间信息,对于提高自动驾驶的安全性和准确性至关重要。

### 5.1.1 自动驾驶中的深度图需求

在自动驾驶系统中,深度图用于辅助车辆理解其周围环境。这些信息包括车辆与障碍物之间的距离,道路边缘,以及其他车辆的位置等。深度图能够帮助自动驾驶汽车进行有效的路径规划和决策,是实现车辆自主导航的关键。

### 5.1.2 典型应用案例分析

以谷歌的Waymo自动驾驶汽车为例。Waymo通过高精度激光雷达(LiDAR)和其他传感器收集数据,生成实时深度图,并利用深度学习算法进行语义分割和障碍物识别。这些深度图不仅提高了系统的空间感知能力,也大大增强了在各种复杂交通条件下的适应性和反应速度。

## 5.2 深度图在机器人视觉中的应用

机器人视觉系统是机器人感知周围环境的重要手段,深度图在其中扮演了不可或缺的角色。

### 5.2.1 机器人视觉系统概述

机器人视觉系统由相机、图像处理设备和相应的软件组成,其核心在于能够理解和解释视觉信息。深度图提供的三维结构信息,使得机器人能够识别物体、计算物体位置和路径规划,从而实现更加复杂的任务。

### 5.2.2 深度图在机器人导航与操作中的应用

在实际应用中,深度图被广泛用于引导机器人在未知环境中导航。例如,在工业制造中,机器人通过深度图识别不同部件,并进行精确的抓取和组装。在服务机器人领域,深度图技术也能够帮助机器人进行自主避障和路径规划。

## 5.3 深度图在增强现实中的应用

增强现实(AR)技术通过将虚拟信息叠加在现实世界的图像上,创造出虚拟与现实结合的用户体验。

### 5.3.1 增强现实技术简介

AR技术依赖于准确的空间定位和环境理解,深度图能够提供必要的三维空间信息。结合其他传感器数据,深度图使得AR系统能够实现精确的空间匹配和虚拟物体的自然呈现。

### 5.3.2 深度图在AR中的应用实例

一个典型的例子是微软的HoloLens,这款AR头戴显示设备能够通过深度感知技术捕捉用户的物理空间,并创建准确的深度图。这些深度图使得虚拟图像能够自然地与现实世界融合,为用户提供了沉浸式的AR体验。

```mermaid

graph LR

A[深度图生成技术概述] --> B[单目视觉深度图的生成原理与实践]

B --> B1[单目视觉基础与深度感知]

B --> B2[单目深度估计的理论框架]

B --> B3[单目深度图生成技术实践]

A --> C[多目摄像机系统的深度重建]

C --> C1[多目视觉系统与深度感知]

C --> C2[多目摄像机标定与校正]

C --> C3[多目深度图重建技术实践]

A --> D[深度图生成技术的最新进展]

D --> D1[深度学习在深度图生成中的应用]

D --> D2[深度图生成中的数据融合技术]

D --> D3[深度图生成技术的未来趋势]

A --> E[深度图生成技术的行业应用与案例分析]

E --> E1[深度图在自动驾驶中的应用]

E --> E2[深度图在机器人视觉中的应用]

E --> E3[深度图在增强现实中的应用]

```

通过以上章节的介绍,我们可以看到深度图生成技术在不同行业中的重要性和实际应用。深度图不仅为各个行业提供了更加丰富和准确的三维信息,还带来了更多的可能性和创新应用。未来,随着技术的进一步发展和完善,深度图生成技术将会在更多领域中展现其巨大的潜力。

0

0