OpenCV图像处理:水果识别的核心技术,揭秘图像识别算法

发布时间: 2024-08-06 09:26:49 阅读量: 68 订阅数: 23

基于纯verilogFPGA的双线性差值视频缩放 功能:利用双线性差值算法,pc端HDMI输入视频缩小或放大,然后再通过HDMI输出显示,可以任意缩放 缩放模块仅含有ddr ip,手写了 ram,f

# 1. OpenCV图像处理概述

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉库,广泛用于图像处理、视频分析和计算机视觉领域。它提供了丰富的函数和算法,使开发人员能够轻松地实现各种图像处理任务。

在水果识别中,OpenCV图像处理技术扮演着至关重要的角色。通过图像预处理、特征提取和机器学习算法的应用,OpenCV能够帮助我们从水果图像中提取有价值的信息,从而实现准确的水果识别。

# 2. 图像预处理技术

图像预处理是图像处理中的重要步骤,它可以提高图像的质量,为后续的图像分析和识别任务做好准备。图像预处理技术包括图像灰度化、二值化、降噪和增强。

### 2.1 图像灰度化和二值化

#### 2.1.1 灰度化算法

灰度化是将彩色图像转换为灰度图像的过程。灰度图像中的每个像素都只有一个值,表示图像中该像素的亮度。灰度化的算法有很多,其中最常用的算法是平均法和加权平均法。

**平均法**:将图像中每个像素的三个颜色分量(R、G、B)的平均值作为灰度值。

```python

import cv2

# 读取彩色图像

image = cv2.imread('image.jpg')

# 将彩色图像转换为灰度图像

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 显示灰度图像

cv2.imshow('Gray Image', gray_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

**加权平均法**:将图像中每个像素的三个颜色分量按照一定的权重进行加权平均,得到灰度值。权重通常为:R:0.299、G:0.587、B:0.114。

```python

import cv2

# 读取彩色图像

image = cv2.imread('image.jpg')

# 将彩色图像转换为灰度图像

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 显示灰度图像

cv2.imshow('Gray Image', gray_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

#### 2.1.2 二值化算法

二值化是将灰度图像转换为二值图像的过程。二值图像中的每个像素只有两个值:0(黑色)和 255(白色)。二值化的算法有很多,其中最常用的算法是阈值法。

**阈值法**:将灰度图像中大于或等于某个阈值的所有像素设置为 255,小于阈值的所有像素设置为 0。

```python

import cv2

# 读取灰度图像

gray_image = cv2.imread('gray_image.jpg', cv2.IMREAD_GRAYSCALE)

# 设置阈值

threshold = 127

# 将灰度图像转换为二值图像

binary_image = cv2.threshold(gray_image, threshold, 255, cv2.THRESH_BINARY)[1]

# 显示二值图像

cv2.imshow('Binary Image', binary_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

### 2.2 图像降噪和增强

#### 2.2.1 降噪算法

图像降噪是去除图像中不需要的噪声的过程。噪声通常是由图像采集过程中的随机干扰造成的。降噪算法有很多,其中最常用的算法是中值滤波和高斯滤波。

**中值滤波**:将图像中每个像素周围的像素值按从小到大排序,然后取中间值作为该像素的新值。

```python

import cv2

# 读取图像

image = cv2.imread('noisy_image.jpg')

# 应用中值滤波

denoised_image = cv2.medianBlur(image, 5)

# 显示降噪后的图像

cv2.imshow('Denoised Image', denoised_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

**高斯滤波**:将图像中每个像素周围的像素值按照高斯分布进行加权平均,得到该像素的新值。

```python

import cv2

# 读取图像

image = cv2.imread('noisy_image.jpg')

# 应用高斯滤波

denoised_image = cv2.GaussianBlur(image, (5, 5), 0)

# 显示降噪后的图像

cv2.imshow('Denoised Image', denoised_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

#### 2.2.2 图像增强算法

图像增强是提高图像质量和可视性的过程。图像增强算法有很多,其中最常用的算法是直方图均衡化和对比度拉伸。

**直方图均衡化**:将图像的直方图拉伸到整个灰度范围,从而提高图像的对比度和亮度。

```python

import cv2

# 读取图像

image = cv2.imread('low_contrast_image.jpg')

# 应用直方图均衡化

enhanced_image = cv2.equalizeHist(image)

# 显示增强后的图像

cv2.imshow('Enhanced Image', enhanced_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

**对比度拉伸**:将图像的像素值映射到新的灰度范围,从而提高图像的对比度。

```python

import cv2

# 读取图像

image = cv2.imread('low_contrast_image.jpg')

# 应用对比度拉伸

enhanced_image = cv2.convertScaleAbs(image, alpha=1.5, beta=0)

# 显示增强后的图像

cv2.imshow('Enhanced Image', enhanced_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

# 3.1 形状特征提取

#### 3.1.1 轮廓提取

轮廓提取是提取图像中物体边缘的一种技术。它可以帮助我们识别物体的形状和大小。OpenCV提供了多种轮廓提取算法,包括:

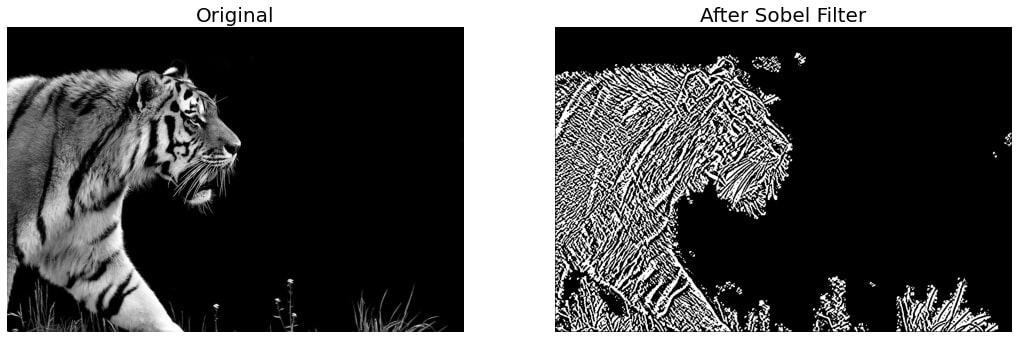

- **Canny边缘检测:** Canny边缘检测是一种广泛使用的边缘检测算法,它使用高斯滤波器平滑图像,然后使用Sobel算子计算图像梯度。通过阈值化梯度图像,我们可以获得图像的边缘。

- **Sobel边缘检测:** Sobel边缘检测是一种使用Sobel算子计算图像梯度的边缘检测算法。Sobel算子是一个3x3卷积核,它通过计算图像中每个像素与其相邻像素之间的梯度来检测边缘。

- **Laplacian边缘检测:** Laplacian边缘检测是一种使用Laplacian算子计算图像二阶导数的边缘检测算法。Laplacian算子是一个3x3卷积核,它通过计算图像中每个像素与其相邻像素之间的二阶导数来检测边缘。

#### 3.1.2 矩特征

矩特征是描述图像形状的另一种方法。矩特征包括:

- **面积:** 图像中白色像素的总数。

- **质心:** 图像中白色像素的平均位置。

- **惯性矩:** 描述图像中白色像素围绕质心的分布。

- **方向:** 图像中白色像素分布的主要方向。

这些矩特征可以用来识别不同形状的物体。例如,面积可以用来区分不同大小的物体,而质心可以用来确定物体的中心位置。

# 4. 机器学习算法应用

### 4.1 监督学习算法

#### 4.1.1 支持向量机(SVM)

**简介:**

支持向量机是一种二分类算法,它通过在特征空间中找到一个超平面来将数据点分隔开。该超平面最大化了数据点到超平面的距离,从而获得最佳的分离效果。

**参数:**

* **核函数:**用于将数据点映射到更高维度的特征空间,常见的有线性核、多项式核、径向基核等。

* **惩罚系数:**控制模型对误分类的容忍度,值越大,模型越严格,可能导致过拟合。

* **核参数:**取决于核函数的选择,如多项式核的阶数、径向基核的宽度等。

**代码示例:**

```python

from sklearn.svm import SVC

# 训练 SVM 模型

model = SVC(kernel='rbf', C=1.0, gamma=0.1)

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

```

**逻辑分析:**

* `SVC()` 函数用于创建 SVM 模型,并指定核函数为径向基核(`kernel='rbf'`)。

* `C` 参数控制惩罚系数,设置为 1.0。

* `gamma` 参数控制径向基核的宽度,设置为 0.1。

* `fit()` 方法用于训练模型,使用训练数据 `X_train` 和标签 `y_train`。

* `predict()` 方法用于预测测试数据 `X_test` 的标签,并存储在 `y_pred` 中。

#### 4.1.2 决策树

**简介:**

决策树是一种非参数监督学习算法,它通过一系列规则将数据点递归地划分到不同的叶节点中。每个叶节点代表一个类标签。

**参数:**

* **最大深度:**限制决策树的深度,防止过拟合。

* **最小样本分割:**控制每个叶节点中最小样本数,防止过拟合。

* **信息增益:**用于选择最佳的特征来划分数据,值越大,特征区分度越好。

**代码示例:**

```python

from sklearn.tree import DecisionTreeClassifier

# 训练决策树模型

model = DecisionTreeClassifier(max_depth=5, min_samples_split=2, criterion='entropy')

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

```

**逻辑分析:**

* `DecisionTreeClassifier()` 函数用于创建决策树模型,并指定最大深度为 5(`max_depth=5`)。

* `min_samples_split` 参数控制最小样本分割,设置为 2。

* `criterion='entropy'` 指定使用信息增益作为特征选择准则。

* `fit()` 方法用于训练模型,使用训练数据 `X_train` 和标签 `y_train`。

* `predict()` 方法用于预测测试数据 `X_test` 的标签,并存储在 `y_pred` 中。

### 4.2 无监督学习算法

#### 4.2.1 K均值聚类

**简介:**

K均值聚类是一种无监督学习算法,它将数据点划分为 K 个簇,使得每个簇内的点尽可能相似,而不同簇之间的点尽可能不同。

**参数:**

* **簇数:**指定要划分的簇数。

* **最大迭代次数:**限制算法的迭代次数,防止陷入局部最优。

* **距离度量:**用于计算数据点之间的距离,常见的有欧氏距离、曼哈顿距离等。

**代码示例:**

```python

from sklearn.cluster import KMeans

# 训练 KMeans 模型

model = KMeans(n_clusters=3, max_iter=100, metric='euclidean')

model.fit(X)

# 获取聚类标签

labels = model.labels_

```

**逻辑分析:**

* `KMeans()` 函数用于创建 KMeans 模型,并指定簇数为 3(`n_clusters=3`)。

* `max_iter` 参数控制最大迭代次数,设置为 100。

* `metric='euclidean'` 指定使用欧氏距离作为距离度量。

* `fit()` 方法用于训练模型,使用数据 `X`。

* `labels_` 属性包含每个数据点的聚类标签。

#### 4.2.2 层次聚类

**简介:**

层次聚类是一种无监督学习算法,它通过逐步合并或分割数据点来构建一个层次结构。该结构可以可视化为一个树状图,称为树状图。

**参数:**

* **链接方式:**指定合并或分割簇的方式,常见的有单链接、完全链接、平均链接等。

* **距离度量:**用于计算数据点之间的距离,常见的有欧氏距离、曼哈顿距离等。

* **截断距离:**用于确定树状图中要截断的层次,从而获得最终的簇。

**代码示例:**

```python

import scipy.cluster.hierarchy as sch

# 计算距离矩阵

distance_matrix = sch.distance.pdist(X, metric='euclidean')

# 构建层次聚类模型

model = sch.linkage(distance_matrix, method='single')

# 获取聚类标签

labels = sch.fcluster(model, t=0.5, criterion='distance')

```

**逻辑分析:**

* `sch.distance.pdist()` 函数用于计算数据点之间的距离矩阵。

* `sch.linkage()` 函数用于构建层次聚类模型,并指定链接方式为单链接(`method='single'`)。

* `sch.fcluster()` 函数用于获取聚类标签,并指定截断距离为 0.5(`t=0.5`)、截断准则为距离(`criterion='distance'`)。

# 5. 水果识别实践

### 5.1 数据集获取和预处理

#### 5.1.1 数据集来源

水果识别的数据集可以从各种来源获取,例如:

- Kaggle:提供各种水果图像数据集,如水果360数据集。

- Google Images:可以手动下载或使用爬虫工具获取水果图像。

- 自定义收集:收集自己的水果图像,以满足特定应用需求。

#### 5.1.2 数据预处理流程

获取数据集后,需要进行预处理以使其适合训练模型。预处理流程通常包括:

1. **图像大小调整:**将所有图像调整为统一的大小,以确保模型输入的一致性。

2. **图像归一化:**将图像像素值归一化到[0, 1]范围内,以减少数据分布的影响。

3. **数据增强:**通过翻转、旋转、裁剪等技术对图像进行增强,以增加数据集的多样性。

4. **数据分割:**将数据集分割为训练集、验证集和测试集,以评估模型性能。

### 5.2 模型训练和评估

#### 5.2.1 模型选择和参数优化

水果识别模型的选择取决于数据集和应用需求。常用的模型包括:

- **支持向量机(SVM):**一种监督学习算法,用于分类问题。

- **决策树:**一种监督学习算法,用于分类和回归问题。

- **卷积神经网络(CNN):**一种深度学习算法,专门用于图像处理。

模型的参数需要通过超参数优化技术进行优化,以获得最佳性能。常用的优化方法包括网格搜索、贝叶斯优化和进化算法。

#### 5.2.2 模型评估指标

模型评估指标用于衡量模型的性能。水果识别中常用的指标包括:

- **准确率:**正确分类图像的比例。

- **召回率:**正确识别正例的比例。

- **F1-score:**准确率和召回率的调和平均值。

- **混淆矩阵:**显示模型预测与实际标签之间的关系。

通过评估指标,可以比较不同模型的性能并选择最佳模型。

# 6. OpenCV图像处理在水果识别中的应用展望

### 6.1 技术趋势和发展方向

#### 6.1.1 深度学习在水果识别中的应用

深度学习作为人工智能领域的一项突破性技术,在图像识别领域取得了显著的成就。深度学习模型能够从大量数据中自动学习特征,并对复杂图像进行准确分类。在水果识别领域,深度学习模型可以有效提取水果的形状、颜色、纹理等特征,从而实现高精度的识别。

#### 6.1.2 边缘计算在水果识别中的应用

边缘计算是一种分布式计算范式,将计算任务从云端转移到靠近数据源的边缘设备上。在水果识别领域,边缘计算可以实现实时水果识别,无需将图像数据上传到云端进行处理。边缘设备可以配备轻量级的深度学习模型,在本地快速识别水果,满足农业生产和食品加工中的实时需求。

### 6.2 应用场景和商业价值

#### 6.2.1 农业生产中的应用

OpenCV图像处理技术在农业生产中具有广泛的应用场景:

- **果实分级和质量检测:**利用图像处理技术,可以根据水果的大小、形状、颜色等特征进行分级,并检测果实的缺陷和损伤,实现自动化质检,提高分级效率和准确性。

- **病虫害识别:**通过图像分析,可以识别水果上的病虫害,并对病害程度进行评估,为病虫害防治提供依据,减少农药使用,保障果品安全。

- **产量预测:**利用图像处理技术,可以估算果树上的果实数量和成熟度,为产量预测提供数据支撑,辅助农业决策。

#### 6.2.2 食品加工中的应用

在食品加工行业,OpenCV图像处理技术也发挥着重要作用:

- **果蔬清洗分拣:**利用图像处理技术,可以根据水果的颜色、形状、大小等特征进行分拣,实现自动化清洗和分拣,提高加工效率和产品质量。

- **果蔬包装检测:**通过图像分析,可以检测果蔬包装的完整性、标签准确性等,确保产品包装符合质量标准,提升品牌形象。

- **果蔬保鲜监控:**利用图像处理技术,可以监测果蔬保鲜库内的温度、湿度等环境参数,并对果蔬的腐烂程度进行评估,为保鲜管理提供数据支持,延长果蔬保质期。

0

0