【YOLOv8技术融合实战】:与Faster R-CNN、SSD等技术的协同工作

发布时间: 2024-12-11 17:24:42 阅读量: 5 订阅数: 20

海思平台上实现目标检测与识别车辆信息-MindSpore框架.zip

# 1. YOLOv8概述与技术框架

## 简介

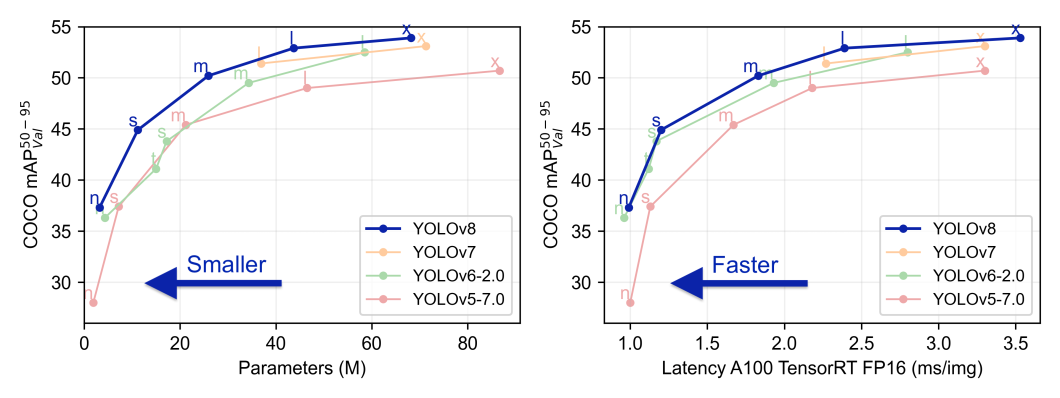

YOLOv8是“你只看一次”系列最新版本的实时目标检测系统,它的出现标志着计算机视觉领域在速度和精度之间权衡的一大步。YOLOv8采用端到端的训练与预测流程,相较于前几代有了显著的改进,特别是在小目标检测和高精度需求场景中表现尤为突出。

## 技术框架

YOLOv8的核心是其轻量级的网络架构,它由以下部分组成:

- **输入层**:负责接收原始图像数据。

- **特征提取器**:使用一系列卷积层来提取图像特征。

- **检测头**:负责在不同尺度上预测物体的位置与类别。

- **后处理**:对预测结果进行非极大值抑制(NMS)等操作以提高准确性。

YOLOv8的一个关键创新在于其在网络的每一层都融入了路径聚合网络(PANet),这有助于提高特征的传递效率,并且更好地关联不同尺度的特征图。此外,YOLOv8还引入了多尺度预测和注意力机制以进一步提升检测性能。

## 发展

YOLOv8的设计理念强调模型速度和准确度的双向优化。在模型优化方面,YOLOv8使用了大量数据增强技术,并且对损失函数进行了改进。这使得模型在保持快速响应的同时,也具备了较高的检测精度。

# 2. YOLOv8与Faster R-CNN的对比与融合

## 2.1 YOLOv8与Faster R-CNN的基本原理

### 2.1.1 YOLOv8的工作流程

YOLOv8(You Only Look Once Version 8)是一个单阶段目标检测模型,它通过在图像中划分网格格子并直接在每个格子中预测目标边界框和类别概率。YOLOv8的核心是其轻量级的卷积神经网络结构,允许它以较高的速度运行,同时保持相对准确的目标检测性能。

1. **图像划分**:YOLOv8将输入图像划分为许多格子,每个格子负责预测中心点落在该格子内的目标。这确保了每个目标都被至少一个格子所覆盖。

2. **边界框预测**:每个格子预测多个边界框,每个边界框包含坐标信息(x, y, w, h),置信度得分(confidence score)和类别概率(class probabilities)。置信度得分表示框内是否含有目标以及预测框的准确度。

3. **锚点框(Anchor Boxes)**:YOLOv8使用预定义的锚点框来简化预测过程,锚点框是根据大量数据集统计得到的典型目标尺寸。

4. **特征提取**:使用深度卷积神经网络(如Darknet-53)来提取图像特征,这些特征随后用于预测。

5. **非极大值抑制(NMS)**:通过非极大值抑制算法去除重叠的边界框,只保留最有可能的预测结果。

6. **损失函数**:损失函数结合了预测框位置准确性、置信度得分准确性和类别预测准确性来训练整个网络。

### 2.1.2 Faster R-CNN的核心组件

Faster R-CNN是一个经典的两阶段目标检测模型,它在第一个阶段先生成候选区域(Region Proposals),在第二个阶段再对这些候选区域进行分类和精细化检测框。

1. **特征提取**:使用卷积神经网络(如VGG或ResNet)提取输入图像的特征。

2. **区域建议网络(RPN)**:在特征图上滑动窗口,对每个窗口生成一系列预定义尺寸的锚点框,并预测它们是否包含目标和对它们的位置进行调整。

3. **RoI Pooling**:从特征图中选择与每个锚点框相关联的区域,并将这些区域转换为固定大小的特征表示。

4. **分类与边界框回归**:对每个区域提案进行分类,预测目标类别,并对边界框的位置进行微调。

5. **后处理**:使用NMS去除重叠的检测结果。

## 2.2 模型性能对比分析

### 2.2.1 速度与精度的权衡

YOLOv8和Faster R-CNN在速度和精度上呈现出显著的差异,这也是选择这两种模型时需要考虑的关键因素。

**YOLOv8的优势**:

- 速度:YOLOv8的架构设计使得它能够以极高的帧率运行,通常达到实时检测,这在监控视频、自动驾驶等需要快速响应的应用场景中非常有用。

**Faster R-CNN的优势**:

- 精度:由于Faster R-CNN通过区域建议网络和RoI Pooling来处理候选区域,这使得模型在处理具有复杂背景和小目标的图像时具有更高的检测精度。

### 2.2.2 不同应用场景下的表现

对于不同的应用场景,YOLOv8和Faster R-CNN的优劣可能会有所不同。

**实时性要求高的场景**:如视频监控、智能驾驶,YOLOv8能提供实时的目标检测,满足快速响应的需求。

**对检测精度要求较高的场景**:如医学影像分析、卫星图像分析等,Faster R-CNN能够提供更为精细的检测结果。

## 2.3 融合技术的实现路径

### 2.3.1 融合架构的设计思想

模型融合是指将不同的模型或其组件结合起来,以期望在速度和精度上取得更好的平衡。YOLOv8与Faster R-CNN融合的技术路径通常涉及以下设计思想:

1. **互补性原则**:选取YOLOv8的快速性与Faster R-CNN的高精度特性,构建一个在速度和准确率上都表现良好的混合模型。

2. **阶段融合**:在两阶段模型的任一阶段引入YOLOv8的特性,例如,在RPN阶段使用YOLOv8的快速预测能力来生成区域建议。

3. **特征融合**:将YOLOv8的轻量级特征提取能力与Faster R-CNN的深度特征融合,以期得到更全面的特征信息。

### 2.3.2 实际应用中的数据融合策略

数据融合策略关注如何有效地整合来自不同模型的数据,提高整体模型的泛化能力。

1. **决策层融合**:分别使用YOLOv8和Faster R-CNN进行独立检测,并将检测结果进行整合。例如,通过投票机制、置信度加权等方法将两者的结果结合。

2. **特征级融合**:在特征提取阶段将YOLOv8和Faster R-CNN提取的特征进行融合,采用拼接、求和或深度融合网络结构等方法。

3. **注意力机制**:利用注意力机制对来自不同模型的特征进行加权,以突出对目标检测更重要的特征。

```python

# 示例代码:YOLOv8特征提取网络与Faster R-CNN特征融合的伪代码

import torch

import torch.nn as nn

import torch.nn.functional as F

class YOLOv8_FeatureExtractor(nn.Module):

# YOLOv8特征提取网络的简化实现

def __init__(self):

super(YOLOv8_FeatureExtractor, self).__init__()

# ...定义网络结构...

def forward(self, x):

# ...前向传播逻辑...

return yolo_fea

```

0

0