【性能优化基石】:如何利用Java 8 Stream API高效处理大数据

发布时间: 2024-10-19 03:57:02 阅读量: 103 订阅数: 36

java代码-大数据1,39李升耀,p26【2-4】

# 1. Java 8 Stream API概述

Java 8引入的Stream API为集合操作带来了革命性的变化。通过一系列流畅的API,开发者可以更加直观和简洁地进行数据处理和操作。Stream API不仅仅是一个数据处理框架,它还是一种全新的编程范式——函数式编程。

Stream API的关键优势在于其声明式的方法和高阶函数的使用,这允许开发者以一种更接近业务逻辑的方式来编写代码。它支持两种类型的操作:中间操作和终止操作。中间操作如`filter`和`map`用于生成新的Stream,而终止操作如`forEach`和`reduce`用于返回最终结果。

在本章节中,我们将初步探索Stream API的基本概念和结构,为后续深入学习Stream API在大数据处理、性能优化和高级特性应用等方面打好基础。

# 2. Stream API的基础理论和实践

在了解Java 8 Stream API之前,我们需要熟悉几个核心概念:Stream(流),Collection(集合),以及它们之间的区别。本章节将深入探讨Stream API的理论基础,并通过实践示例来解释其工作机制。

## 2.1 Stream API的基本概念

### 2.1.1 Stream的定义和特点

Stream代表了数据元素的序列,并支持聚合操作。在Java 8中,Stream不存储数据,而是按需计算。它们可以是顺序的也可以是并行的,并且支持顺序操作和并行操作。

Stream的一些核心特点包括:

- **延迟计算**:只在需要结果的时候才计算。

- **函数式编程**:支持声明式操作,通过函数式接口与Lambda表达式实现。

- **可变状态**:一旦创建,状态不可更改。

Stream的生成通常来自集合,数组,或者I/O channel等。

### 2.1.2 Stream与Collection的区别

虽然Stream和Collection都用于处理数据集,但它们在概念和用途上有显著不同:

- **数据存储方式**:Collection是数据的集合,存储元素;Stream是计算的表示,不存储数据。

- **使用时机**:Collection适用于随机访问和存储,Stream适用于一次性计算。

- **性能优化**:Stream API允许延迟执行(使用时才计算),并提供了并行处理的能力。

接下来,我们将详细讨论Stream API的操作类型,包括中间操作和终止操作。

## 2.2 Stream API的操作类型

### 2.2.1 中间操作(Intermediate Operations)

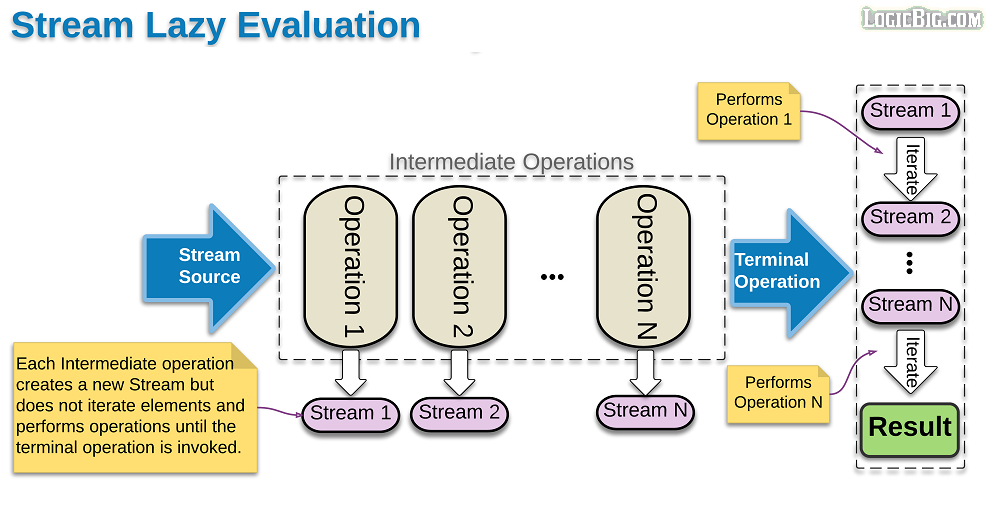

中间操作是返回一个新***m的操作,它们是惰性的,意味着在没有触发终止操作前,中间操作不会被执行。

常见的中间操作包括:

- `filter(Predicate)`:根据条件过滤元素。

- `map(Function)`:对流中的每个元素应用函数并返回结果。

- `sorted(Comparator)`:对流中的元素进行排序。

### 2.2.2 终止操作(Terminal Operations)

终止操作会触发整个流处理的执行,产生一个非Stream的结果,如List、int或void等。

常见的终止操作包括:

- `collect(Collector)`:将流中的元素收集到一个集合中。

- `forEach(Consumer)`:对流中的每个元素执行操作。

- `reduce`:归约操作,如求和、最大值等。

### 2.3 Stream API的性能优势

Stream API是Java 8为了更好地利用多核处理器提供的新的抽象。其性能优势主要体现在两个方面:延迟执行机制和并行流的实现原理。

#### 2.3.1 Stream API的延迟执行机制

延迟执行是Stream API的一个重要特性,允许在不生成中间结果的情况下进行链式调用,从而避免不必要的内存消耗。只有在遇到终止操作时,中间操作才会被实际执行。

#### 2.3.2 并行流(Parallel Streams)的实现原理

并行流利用了Java 7引入的Fork/Join框架,将任务分解为更小的子任务,并在不同的线程上执行。当所有子任务完成时,它们的结果会合并回一个单一的结果。

并行流特别适用于处理大量数据时,能够显著提高性能。其使用方式简单,只需在流上使用`parallel()`方法。

为了更深入理解这些概念,我们将通过实际代码示例来演示Stream API的使用和性能优势。请注意,每个示例后都会提供代码的逐行逻辑分析和参数说明。

# 3. Stream API在大数据处理中的实践应用

## 3.1 数据过滤和转换

### 3.1.1 使用filter进行数据筛选

在Java 8 Stream API中,`filter`是中间操作中的一个核心方法,它允许我们根据提供的谓词来筛选出符合特定条件的元素。数据筛选是大数据处理中最常见的操作之一,比如在处理日志文件或数据流时,通常只需要分析符合特定模式或特征的记录。

**代码示例**:

```java

List<String> strings = Arrays.asList("abc", "", "bc", "efg", "abcd", "", "jkl");

List<String> filtered = strings.stream()

.filter(string -> !string.isEmpty())

.collect(Collectors.toList());

```

**代码逻辑分析**:

1. `Arrays.asList(...)`创建了一个包含若干字符串的列表。

2. `.stream()`将列表转换为流。

3. `.filter(string -> !string.isEmpty())`应用了`filter`方法,其中使用了lambda表达式`string -> !string.isEmpty()`来筛选出非空字符串。

4. `.collect(Collectors.toList())`将筛选后的流收集到新的列表中。

5. 执行完毕后,`filtered`将包含所有非空字符串。

### 3.1.2 使用map进行数据转换

`map`是另一个常用的中间操作,它允许你将流中的每个元素转换成另一种形式。转换可以是任何类型,这取决于你需要进行的特定处理。

**代码示例**:

```java

List<Integer> numbers = Arrays.asList(1, 2, 3, 4, 5);

List<Integer> squares = numbers.stream()

.map(n -> n * n)

.collect(Collectors.toList());

```

**代码逻辑分析**:

1. `Arrays.asList(...)`创建了一个包含数字的列表。

2. `.stream()`将列表转换为流。

3. `.map(n -> n * n)`通过`map`方法将每个数字转换为它的平方。这里使用了lambda表达式`n -> n * n`作为转换函数。

4. `.collect(Collectors.toList())`将流中的结果收集到新的列表中。

5. 执行完毕后,`squares`将包含原始数字的平方值。

## 3.2 数据分组和聚合

### 3.2.1 分组操作(groupingBy和partitioningBy)

分组和分区是流API中的高级操作,它们允许你根据某个属性或条件将集合中的元素分配到不同的容器中。

**代码示例**:

```java

Map<Boolean, List<Integer>> partitionedMap = numbers.stream()

.collect(Collectors.partitioningBy(n -> n % 2 == 0));

Map<String, List<Integer>> groupedMap = numbers.stream()

.collect(Collectors.groupingBy(n -> n % 3 == 0 ? "multiple of 3" : "not multiple of 3"));

```

**代码逻辑分析**:

1. `.stream()`将列表转换为流。

2. `.collect(Collectors.partitioningBy(...))`是一个收集器,它基于一个谓词(`n -> n % 2 == 0`)将数字分为偶数和奇数两个列表。

3. `.collect(Collectors.groupingBy(...))`用于将数字根据它们对3的模数结果分组,并将结果存储在映射中,键为字符串("multiple of 3" 或 "not multiple of 3"),值为对应的数字列表。

### 3.2.2 聚合操作(reducing和collectingAndThen)

聚合操作通常用于对流中的元素执行汇总计算,如求和、最大值、最小值等。

**代码示例**:

```java

Optional<Integer> sum = numbers.stream()

.collect(Collectors.reducing((a, b) -> a + b));

int sumValue = sum.orElse(0);

```

**代码逻辑分析**:

1. `.stream()`将列表转换为流。

2. `.collect(Collectors.reducing(...))`利用提供的二元操作(`(a, b) -> a + b`)进行归约操作,最终返回总和。

3. `.orElse(0)`处理可能返回的空`Optional`值。

## 3.3 大数据处理的案例分析

### 3.3.1 实时数据流处理

处理实时数据流是一个复杂的过程,它涉及到事件的捕获、处理和转发。Java Stream API提供的延迟执行特性非常适合实时数据处理,因为可以将处理逻辑封装为流操作。

### 3.3.2 分布式数据处理

分布式数据处理是在多个节点上分割数据并进行并行处理。在Java中,这通常可以通过将流转化为并行流来实现。并行流利用Java虚拟机中的多个处理器核心,提高处理大规模数据集的效率。

## 表格展示

下面是Java 8 Stream API中常见的中间操作和终止操作的表格比较:

| 操作类型 | 说明 | 示例方法 |

|-----------|------|---------|

| 中间操作 | 可以连续调用,形成流水线 | filter, map, sorted |

| 终止操作 | 触发流的计算并产生结果 | forEach, collect, reduce |

## 流程图展示

下图展示了Java Stream API处理数据流的流程:

```mermaid

graph LR

A[开始] --> B[创建流]

B --> C{是否中间操作}

C -->|是| D[中间操作]

D --> C

C -->|否| E{是否终止操作}

E -->|是| F[终止操作]

F --> G[结束]

E -->|否| H[无操作]

H --> G

```

以上章节内容展示了Java 8 Stream API在数据过滤和转换、数据分组和聚合以及大数据处理案例分析中的应用。这些概念和代码示例能够为处理大数据提供有力的工具和方法,让开发者可以更加灵活地应对大规模数据集的处理需求。

# 4. Stream API高级特性及其性能优化

Java 8 Stream API不仅仅提供了简单易用的数据处理能力,其高级特性还允许开发者执行复杂的操作并进行性能优化。本章将深入探讨Stream API的高级用法,包括flatMap和peek方法的高级场景,性能优化的策略,并介绍如何测量和比较Stream API的性能。

## 4.1 高级流操作

### 4.1.1 flatMap的使用场景和效果

flatMap是Stream API中一个重要的中间操作,它可以将流中的每个元素通过某种函数转换成新的元素,并将结果展平为一个新的流。这个操作在处理那些需要将集合中的集合结构扁平化的场景中非常有用。

```java

List<String> combinedList = list1.stream()

.flatMap(l1 -> list2.stream()

.map(l2 -> l1 + " - " + l2))

.collect(Collectors.toList());

```

在上述代码中,我们通过flatMap操作将两个列表中的字符串按照" - "连接,生成一个新的列表。这里的map操作处理的是两个列表中的元素,生成了一个新的元素,而flatMap则是将这些新生成的元素展平,形成一个单一的流。

flatMap在处理嵌套集合时尤其有效,比如在处理JSON数据,将多个列表合并为一个列表,或者在数据库操作中将多表联结的结果扁平化。

### 4.1.2 peek方法的监控和调试作用

peek方法提供了一个观察点,在数据流的中间处理阶段插入一个操作,用于监控流的状态而不改变流的内容。它主要用于调试目的。

```java

list.stream()

.filter(x -> x % 2 == 0)

.peek(x -> System.out.println("Filtered value: " + x))

.map(x -> x * x)

.peek(x -> System.out.println("Squared value: " + x))

.collect(Collectors.toList());

```

在这个例子中,我们在过滤和映射操作之间插入了两个peek操作来打印处理过程中的数据。这有助于开发者追踪数据在流中的处理状态,尤其是在复杂的链式调用中。

## 4.2 Stream API的性能优化技巧

### 4.2.1 避免中间操作的性能陷阱

在使用Stream API时,一些中间操作可能会导致性能问题,特别是在处理大量数据时。例如,对于每个元素都执行昂贵的计算可能会导致性能下降。

```java

// 不推荐的做法:为每个元素创建新的Optional对象

List<String> filteredList = list.stream()

.map(element -> {

Optional<String> processed = computeExpensively(element);

return processed.orElse(null);

})

.collect(Collectors.toList());

```

在上面的代码中,我们通过map操作创建了一个新的Optional对象,这不仅增加了内存消耗,还可能影响性能。优化的方法是尽量减少每次操作的计算量,或者使用更高效的数据结构。

### 4.2.2 懒加载和短路操作的最佳实践

Stream API支持懒加载,这意味着只有在真正需要结果时,操作才会执行。短路操作如`anyMatch`、`allMatch`或`findAny`可以在找到第一个结果后立即停止处理,这在处理大量数据时可以显著提高性能。

```java

// 使用短路操作找到第一个符合条件的元素

Optional<String> firstMatch = list.stream()

.filter(element -> element.contains("特定字符串"))

.findAny();

```

使用短路操作时,一旦找到匹配项,就不会继续处理剩余的元素,这降低了不必要的计算。

## 4.3 测量和比较Stream API性能

### 4.3.1 使用JMH进行基准测试

Java Microbenchmark Harness (JMH) 是一个用于性能微基准测试的框架,可以帮助开发者精确地测量Stream API与传统循环之间的性能差异。

```java

@BenchmarkMode(Mode.AverageTime)

@OutputTimeUnit(TimeUnit.NANOSECONDS)

public class StreamBenchmark {

@Benchmark

public long testStream(List<Integer> list) {

return list.stream().filter(x -> x % 2 == 0).mapToLong(x -> x).sum();

}

@Benchmark

public long testLoop(List<Integer> list) {

long sum = 0;

for (int x : list) {

if (x % 2 == 0) {

sum += x;

}

}

return sum;

}

}

```

这个基准测试定义了两个方法,一个使用Stream API,另一个使用传统循环。JMH将帮助我们比较这两种方法的执行时间,以了解哪种方法更优。

### 4.3.2 Stream API与传统循环性能对比分析

在基准测试后,我们可以得出一些结论。通常情况下,对于简单的操作,传统循环可能更高效。然而,对于复杂的数据操作链,Stream API的清晰性和表达性可能使其成为更好的选择。

```mermaid

graph LR

A[简单操作] --> B{Stream vs. 循环}

B --> |Stream更快| C[复杂操作链]

B --> |循环更快| D[简单循环逻辑]

```

当数据集非常大或者数据处理流程较复杂时,Stream API的优势就显现出来了。Stream API能够有效利用延迟执行和并行流,这在大规模数据处理中至关重要。

通过对Stream API高级特性的学习和性能优化技巧的应用,开发者可以更有效地使用Java 8带来的流式编程能力,进一步提升代码质量与性能。在接下来的章节中,我们将探讨流式处理如何在大数据架构中发挥作用,以及Java Stream API在未来的可能改进方向。

# 5. 流式编程模式在大数据架构中的应用

## 5.1 流式处理与微服务架构

### 5.1.1 微服务架构中的数据流

随着微服务架构在企业级应用中的广泛应用,数据流的处理方式也相应地发生了变化。在微服务架构中,每个服务通常负责处理特定的业务功能,并维护自己的数据存储。这就导致了数据在不同的服务之间流动,形成了复杂的数据流。传统的方式可能需要将数据从一个服务传递到另一个服务,并在每个服务中进行处理,但这种方式效率低下,并且难以维护。

流式处理提供了一种更加灵活和高效的数据处理方式。通过使用消息队列(如Kafka)等中间件,微服务可以异步地处理数据流,从而保持系统的解耦和高可用性。这不仅可以提高数据处理的实时性,还能够使得服务更加专注于处理业务逻辑,而不是数据传输和同步。

### 5.1.2 流处理在微服务中的作用

在微服务架构中,流处理的作用可以从以下几个方面来理解:

- **实时数据处理**:流处理能够对实时产生的数据进行快速响应和处理,这对于需要即时处理的业务场景尤为重要。

- **状态管理**:流处理可以维护和管理应用状态,这对于保证数据一致性和服务的可靠性至关重要。

- **异步通信**:微服务架构中的服务间通信往往采用异步方式,流处理天然支持异步操作,有助于减少服务间的耦合度。

- **弹性伸缩**:流处理框架通常能够很好地支持分布式和水平扩展,这使得微服务能够根据负载情况动态地调整资源使用。

## 5.2 流式处理与大数据技术栈

### 5.2.1 与Apache Kafka的集成

Apache Kafka是一个高吞吐量的分布式消息系统,被广泛用于构建实时数据管道和流式应用。它的设计思想是将数据流视为连续的记录流,为流处理提供了强大的支持。

在微服务架构中,Kafka可以作为服务间通信的中间件,通过发布和订阅模式传递数据流。Kafka与Java Stream API集成后,可以实现复杂的数据处理逻辑。例如,一个服务可以发布事件到Kafka,另一个服务订阅这些事件并利用Stream API进行处理。

代码示例:

```java

// 生产者发送消息到Kafka

Properties props = new Properties();

props.put("bootstrap.servers", "localhost:9092");

props.put("key.serializer", "***mon.serialization.StringSerializer");

props.put("value.serializer", "***mon.serialization.StringSerializer");

Producer<String, String> producer = new KafkaProducer<>(props);

producer.send(new ProducerRecord<>("events", "key", "value"));

// 消费者从Kafka读取数据并进行流式处理

Properties consumerProperties = new Properties();

consumerProperties.put("bootstrap.servers", "localhost:9092");

consumerProperties.put("key.deserializer", "***mon.serialization.StringDeserializer");

consumerProperties.put("value.deserializer", "***mon.serialization.StringDeserializer");

KafkaConsumer<String, String> consumer = new KafkaConsumer<>(consumerProperties);

consumer.subscribe(Arrays.asList("events"));

while (true) {

ConsumerRecords<String, String> records = consumer.poll(100);

records.forEach(record -> {

// 使用Java Stream API处理每条记录

Stream.of(record.value())

.map(/* 数据转换逻辑 */)

.filter(/* 数据过滤逻辑 */)

// ...

.forEach(/* 处理结果 */);

});

}

```

### 5.2.2 与Apache Flink的对比

Apache Flink是一个开源的流处理框架,专门用于处理无界和有界数据流。它不仅支持流处理,还支持批量处理。与Java Stream API相比,Flink提供了更丰富的流处理功能和更高级的抽象,特别适合于需要处理大规模数据流的场景。

- **性能对比**:Flink优化了数据流的处理速度,它可以在同一时刻处理大量的数据,并且能够有效地进行资源调度和状态管理。

- **功能对比**:Flink提供了更全面的流处理能力,例如窗口函数、容错机制、事件时间处理等,而Java Stream API虽然提供了基本的流处理操作,但在处理大规模数据流方面能力有限。

- **集成对比**:Flink与Kafka等大数据技术栈的集成更加紧密,提供了更好的支持和优化。

在选择流处理工具时,需要根据具体的应用场景和需求来决定使用Java Stream API还是Flink等流处理框架。对于大多数Java应用而言,Java Stream API足以处理常见的数据流问题。但对于复杂的大数据处理任务,Flink提供的高级功能和性能优势可能更加合适。

# 6. 案例研究与未来展望

## 6.1 大数据处理案例研究

### 6.1.1 实时数据分析系统

实时数据分析系统是现代数据密集型应用中的关键组件,它们能够即时处理和分析数据流,为企业提供快速的决策支持。使用Java Stream API,可以有效地构建出这样的系统。

例如,考虑一个在线广告平台,它需要实时分析用户行为以提供个性化广告。系统需要对接收到的用户点击流数据进行实时处理,包括数据清洗、用户分组、广告点击率统计等。

```java

import java.util.stream.Stream;

import java.util.stream.Collectors;

import java.util.*;

import java.util.function.Function;

import java.util.stream.IntStream;

// 示例代码,模拟实时数据分析系统中的用户点击流处理

public class RealTimeAnalyticsExample {

public static void main(String[] args) {

// 模拟实时流数据

Stream<ClickEvent> clickStream = Stream.generate(ClickEvent::new);

// 选择一个时间段进行处理,例如最近10个事件

List<ClickEvent> recentClicks = clickStream.limit(10).collect(Collectors.toList());

// 聚合数据,比如点击次数最多的广告

Map<Integer, Long> adClicksCount = recentClicks.stream()

.collect(Collectors.groupingBy(ClickEvent::getAdId, Collectors.counting()));

// 找出点击次数最多和最少的广告

Optional<Map.Entry<Integer, Long>> mostClickedAd = adClicksCount.entrySet().stream()

.max(***paringByValue());

Optional<Map.Entry<Integer, Long>> leastClickedAd = adClicksCount.entrySet().stream()

.min(***paringByValue());

// 输出结果

mostClickedAd.ifPresent(entry -> System.out.println("Most clicked ad ID: " + entry.getKey() + " (" + entry.getValue() + " clicks)"));

leastClickedAd.ifPresent(entry -> System.out.println("Least clicked ad ID: " + entry.getKey() + " (" + entry.getValue() + " clicks)"));

}

static class ClickEvent {

private int userId;

private int adId;

public ClickEvent() {

// 在实际应用中,这里应该是从数据源中获取数据

this.userId = (int) (Math.random() * 100);

this.adId = (int) (Math.random() * 10);

}

public int getAdId() {

return adId;

}

}

}

```

在上面的代码示例中,我们通过`Stream.generate`创建了一个无限的点击事件流。然后,我们使用`limit`方法来模拟我们只关注最近10个事件。接着,我们使用`collect`方法结合`groupingBy`来对点击事件进行分组,并统计每个广告的点击次数。最后,我们找出并输出点击次数最多和最少的广告。

### 6.1.2 大规模日志分析应用

在大规模日志分析应用中,日志数据通常以流的形式产生。利用Java Stream API,可以轻松地对这些流数据进行各种处理。

例如,假设一个服务每天产生数百万条日志,需要进行实时分析以监控系统状态。这可能包括错误日志的统计、用户行为模式的识别或安全事件的检测。

下面的代码示例展示了如何使用Java Stream API来处理和分析日志流,以识别高频率出现的错误日志条目。

```java

import java.util.stream.Stream;

import java.util.function.Predicate;

import java.util.stream.Collectors;

// 示例代码,模拟大规模日志分析应用

public class LogAnalysisExample {

public static void main(String[] args) {

// 模拟日志数据流

Stream<LogEntry> logStream = Stream.generate(LogEntry::new);

// 分析日志,找出最常出现的错误

Predicate<LogEntry> isError = logEntry -> logEntry.getType().equals("ERROR");

Map<String, Long> errorCounts = logStream.limit(1000) // 假设我们只分析最新的1000条日志

.filter(isError)

.collect(Collectors.groupingBy(LogEntry::getMessage, Collectors.counting()));

// 输出最常见的错误信息

errorCounts.entrySet().stream()

.max(***paringByValue())

.ifPresent(entry -> System.out.println("Most frequent error: " + entry.getKey() + " with " + entry.getValue() + " occurrences"));

}

static class LogEntry {

private String type; // 日志类型,如"INFO", "ERROR", "WARNING"

private String message; // 日志消息内容

public LogEntry() {

// 在实际应用中,这里应该是从数据源中获取数据

this.type = Math.random() < 0.1 ? "ERROR" : (Math.random() < 0.5 ? "WARNING" : "INFO");

this.message = "Test log message " + new Date().toString();

}

public String getType() {

return type;

}

public String getMessage() {

return message;

}

}

}

```

在这个例子中,我们定义了一个`LogEntry`类来模拟日志条目。我们创建了一个日志条目的流,并使用`limit`方法来处理最新的1000条日志。接着,我们通过`filter`方法筛选出错误日志条目,并使用`groupingBy`对这些错误条目按消息内容进行分组,计算每种错误消息的出现次数。最后,我们找出并输出出现频率最高的错误信息。

## 6.2 Java Stream API的未来发展

### 6.2.1 Java Stream API的改进方向

Java Stream API自Java 8引入以来,已成为处理集合数据的强大工具。随着Java语言的演进,Stream API也在不断改进,以适应新的编程范式和满足开发者的需求。

未来,我们可以预见Stream API将会增强对并行处理的支持,简化API的设计,以及扩展对新数据类型的处理能力。此外,可能会引入更多的低层次操作,允许开发者更细致地控制流的处理过程。

例如,对于并行处理的改进可能会包括更智能的线程池管理,以及更细粒度的任务划分。这将使得开发者在处理大型数据集时能够更有效地利用多核处理器的性能。

### 6.2.2 对大数据处理领域的影响预测

随着大数据处理技术的不断发展,Java Stream API在这一领域中扮演的角色可能会进一步增强。基于流的处理模式提供了天然的并行性和延迟执行优势,这与大数据处理的需求高度契合。

在未来,我们可以预测Java Stream API将越来越多地被集成到大数据处理框架中,成为连接不同系统和数据源的桥梁。流式处理模型将进一步促进微服务架构中服务间的解耦,提高系统的灵活性和可扩展性。

此外,随着机器学习和人工智能在大数据处理中的应用增加,Java Stream API可能会引入新的操作和方法,以更好地支持复杂的数据分析任务,如特征提取、数据集切分等。这些改进将有助于Java开发者在构建复杂的数据处理和分析应用时获得更大的灵活性和表达力。

0

0