bs4与其他Python库的集成:requests和lxml的高效结合

发布时间: 2024-10-14 20:21:10 阅读量: 2 订阅数: 6

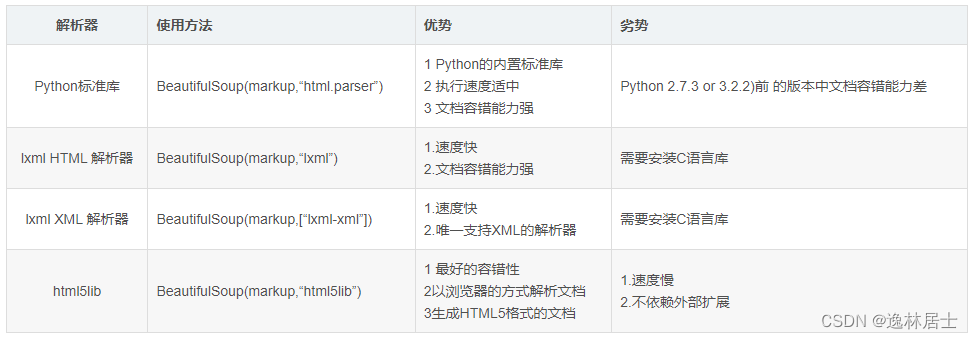

# 1. bs4库的基本使用和功能概述

Python的BeautifulSoup库,简称bs4,是一个强大的库,用于解析HTML和XML文档。它提供简单的方法来导航、搜索和修改解析树。这使得它在数据抓取和文本分析等任务中非常有用。在本章中,我们将介绍bs4库的基本概念,包括它的安装、基本使用方法以及如何与Python其他库协同工作。

## 1.1 安装bs4库

首先,我们需要安装bs4库,它可以通过pip包管理器轻松安装。打开命令行工具,输入以下命令:

```shell

pip install beautifulsoup4

```

此命令将从Python包索引(PyPI)下载并安装最新版本的bs4及其依赖。

## 1.2 解析HTML/XML文档

一旦安装完成,我们可以开始解析HTML或XML文档。以下是一个简单的例子,展示如何使用bs4来解析HTML文档:

```python

from bs4 import BeautifulSoup

# 假设我们有一个简单的HTML文档

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p class="title"><b>The Dormouse's story</b></p>

<p class="story">Once upon a time there were three little sisters; and their names were

<a href="***" class="sister" id="link1">Elsie</a>,

<a href="***" class="sister" id="link2">Lacie</a> and

<a href="***" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</p>

# 创建BeautifulSoup对象

soup = BeautifulSoup(html_doc, 'html.parser')

# 访问文档的title标签

print(soup.title)

```

在上面的代码中,我们首先导入了BeautifulSoup类,并创建了一个实例来解析我们的HTML文档。我们可以通过标签名称访问特定元素,并打印出它的内容。

## 1.3 生成HTML/XML文档

除了解析文档,bs4还可以用来生成新的HTML或XML文档。下面是一个示例,展示了如何创建一个简单的HTML文档:

```python

from bs4 import BeautifulSoup

# 创建一个BeautifulSoup对象

soup = BeautifulSoup()

# 添加一个基础HTML结构

soup.append("<p>这是一个段落。</p>")

soup.append("<p>这是另一个段落。</p>")

# 输出生成的HTML文档

print(soup.prettify())

```

在这段代码中,我们没有预先提供HTML文档,而是让BeautifulSoup自己创建了一个新的HTML结构,然后添加了两个段落元素。最后,我们使用`prettify()`方法输出格式化的HTML文档。

通过本章的学习,我们将掌握bs4库的基本使用方法,为进一步学习其高级功能打下坚实的基础。

# 2. requests库的深入理解和实践

requests库是Python中最流行的HTTP库之一,它提供了一种简单而直接的方式来处理HTTP请求。它的设计灵感来源于Python标准库urllib,但它更加人性化和易用。在本章节中,我们将深入探讨requests库的基本使用和高级功能,并介绍如何处理错误和记录日志。

## 2.1 requests库的基本使用

### 2.1.1 发起基本的HTTP请求

requests库的基本使用非常直观,我们可以通过简单的函数调用来发起各种HTTP请求。以下是发起GET请求的一个基本示例:

```python

import requests

url = '***'

response = requests.get(url)

print(response.text)

```

在这个示例中,我们首先导入了requests模块,然后定义了我们想要请求的URL。使用`requests.get()`函数发起一个GET请求,并将返回的响应对象存储在`response`变量中。最后,我们打印出了响应的文本内容。

### 2.1.2 请求头和请求参数的设置

除了基本的GET请求,我们还可以设置请求头和请求参数。以下是如何设置请求头和请求参数的示例:

```python

import requests

url = '***'

headers = {'User-Agent': 'Mozilla/5.0'}

params = {'key1': 'value1', 'key2': 'value2'}

response = requests.get(url, headers=headers, params=params)

print(response.text)

```

在这个示例中,我们通过`headers`参数传递了一个字典来设置请求头,通过`params`参数传递了一个字典来设置请求参数。这样,我们就可以在不改变URL结构的情况下,向服务器传递额外的信息。

#### 代码逻辑分析

在上面的代码中,我们使用了`requests.get()`函数来发送GET请求。函数的第一个参数是目标URL,第二个参数是可选的headers字典,用于设置HTTP请求头。第三个参数是params字典,用于添加URL查询字符串参数。

- `headers`参数允许我们模拟不同的浏览器或设备,这对于那些检查请求头来提供内容或服务的服务器非常有用。

- `params`参数用于将字典转换为URL的查询字符串,并添加到URL中。

### 2.2 requests库的高级功能

#### 2.2.1 会话维持和cookie处理

requests库提供了一个`Session`对象,它允许我们跨请求保持某些参数,比如cookies和headers。这对于处理需要登录认证的网站特别有用。

```python

import requests

# 创建一个Session对象

session = requests.Session()

# 发起登录请求

session.post('***', data={'username': 'user', 'password': 'pass'})

# 发起另一个请求,此时会自动携带登录后的cookies

response = session.get('***')

print(response.json())

```

在这个示例中,我们首先创建了一个Session对象,并使用它来发送一个POST请求进行登录。登录成功后,我们再次使用同一个Session对象发送一个GET请求,此时Session对象会自动携带之前登录请求中服务器设置的cookies。

#### 代码逻辑分析

在上面的代码中,我们首先创建了一个`Session`对象,然后使用`Session`对象的`post()`方法发送了一个POST请求进行登录。在这个请求中,我们将用户名和密码作为数据提交。接着,我们使用同一个`Session`对象的`get()`方法发送了一个GET请求。由于我们使用的是同一个`Session`对象,它会自动携带之前POST请求中服务器设置的cookies。

#### 2.2.2 异步请求和流式下载

requests库支持异步请求和流式下载,这可以显著提高处理大型文件或大量请求时的效率。

```python

import requests

from requests.adapters import HTTPAdapter

from requests.packages.urllib3.util.retry import Retry

# 创建一个Session对象,并设置重试策略

session = requests.Session()

retry = Retry(connect=3, backoff_factor=0.5)

adapter = HTTPAdapter(max_retries=retry)

session.mount('***', adapter)

session.mount('***', adapter)

# 发起异步请求

def fetch_url(url):

with session.get(url, stream=True) as response:

for chunk in response.iter_content(chunk_size=1024):

if chunk: # 过滤掉保持连接的chunk

process_chunk(chunk)

def process_chunk(chunk):

# 处理下载的内容块

pass

url = '***'

fetch_url(url)

```

在这个示例中,我们首先创建了一个Session对象,并设置了一个重试策略,这样如果请求失败,它会自动重试。然后我们定义了一个异步请求的函数`fetch_url`,它使用Session对象的`get()`方法以流式方式下载内容。在`process_chunk`函数中,我们可以处理每个内容块。

#### 代码逻辑分析

在上面的代码中,我们首先创建了一个`Session`对象,并配置了一个重试策略,这样如果请求失败,它会自动重试。然后我们定义了一个异步请求的函数`fetch_url`,它使用`Session`对象的`get()`方法以流式方式下载内容。在`process_chunk`函数中,我们可以处理每个内容块。

### 2.3 requests库的错误处理和日志记录

#### 2.3.1 错误处理机制

requests库提供了内置的错误处理机制,我们可以捕获特定的异常来处理HTTP请求中可能出现的错误。

```python

import requests

url = '***'

try:

response = requests.get(url)

response.raise_for_status() # 如果响应状态码不是2xx,将抛出异常

except requests.exceptions.HTTPError as errh:

print ("Http Error:",errh)

except requests.exceptions.ConnectionError as errc:

print ("Error Connecting:",errc)

except requests.exceptions.Timeout as errt:

print ("Timeout Error:",errt)

except requests.exceptions.Reques

```

0

0