OpenCV直方图聚类:图像分割与对象识别的创新思路

发布时间: 2024-08-13 00:03:02 阅读量: 43 订阅数: 34

毕设和企业适用springboot企业健康管理平台类及活动管理平台源码+论文+视频.zip

# 1. OpenCV直方图聚类的基本原理

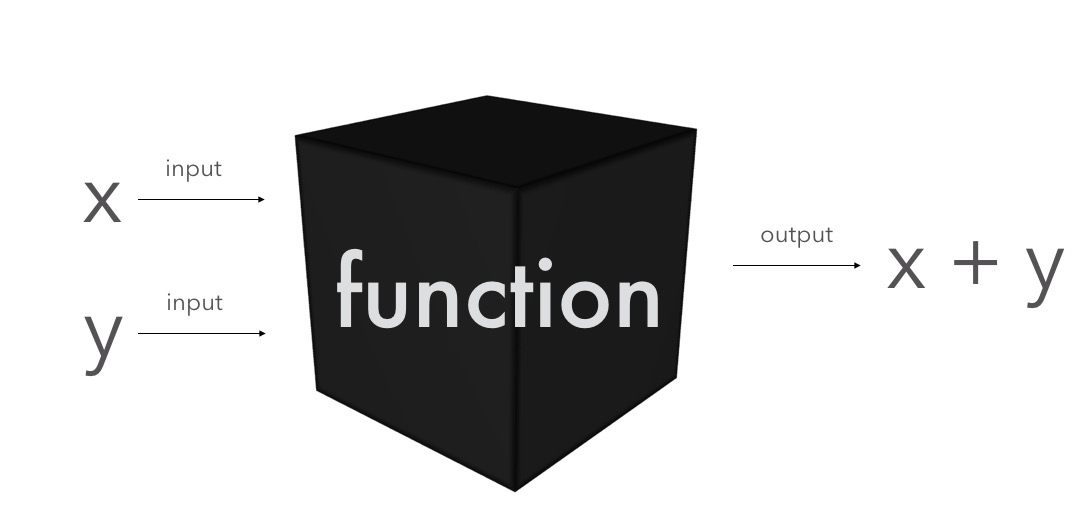

直方图聚类是一种无监督学习算法,它将数据点分组到称为簇的相似组中。在OpenCV中,直方图聚类通过`cv2.kmeans()`函数实现。

直方图聚类算法首先计算每个数据点的特征向量,然后使用k-means算法将数据点分配到k个簇中。k-means算法是一种迭代算法,它通过以下步骤进行:

1. 随机选择k个数据点作为初始簇中心。

2. 将每个数据点分配到距离其最近的簇中心。

3. 更新簇中心为分配到该簇的所有数据点的平均值。

4. 重复步骤2和3,直到簇中心不再变化。

# 2. OpenCV直方图聚类的实践应用

### 2.1 图像分割中的直方图聚类

#### 2.1.1 直方图聚类的图像分割流程

直方图聚类在图像分割中的应用流程一般包括以下步骤:

1. **图像预处理:**对输入图像进行预处理,如降噪、灰度化等。

2. **特征提取:**从图像中提取特征,如像素值、纹理特征等。

3. **直方图计算:**计算图像中每个像素点的直方图,表示其在不同特征值下的分布情况。

4. **聚类:**使用聚类算法(如K均值聚类)对直方图进行聚类,将像素点划分为不同的簇。

5. **分割:**根据聚类结果,将图像分割成不同的区域,每个区域对应一个聚类簇。

#### 2.1.2 直方图聚类在图像分割中的优势和局限

**优势:**

* **简单有效:**直方图聚类算法简单易懂,且在图像分割任务中表现良好。

* **鲁棒性强:**对图像噪声和光照变化具有较强的鲁棒性。

* **计算效率高:**直方图聚类算法计算效率高,适合处理大规模图像。

**局限:**

* **对聚类参数敏感:**聚类算法的性能受聚类参数(如聚类数)的影响较大。

* **分割精度有限:**直方图聚类只能根据像素点的特征分布进行分割,分割精度受图像特征的复杂程度影响。

* **难以处理复杂图像:**对于纹理复杂、边界模糊的图像,直方图聚类可能难以得到准确的分割结果。

### 2.2 对象识别中的直方图聚类

#### 2.2.1 基于直方图聚类的对象识别方法

基于直方图聚类的对象识别方法主要包括以下步骤:

1. **特征提取:**从待识别对象中提取特征,如颜色直方图、形状特征等。

2. **直方图聚类:**对提取的特征进行直方图聚类,将特征点划分为不同的簇。

3. **对象识别:**将待识别对象的特征直方图与训练集中已知对象的特征直方图进行比较,根据相似度进行识别。

#### 2.2.2 直方图聚类在对象识别中的性能评估

直方图聚类在对象识别中的性能评估指标主要包括:

* **准确率:**识别正确对象的比例。

* **召回率:**识别出所有正确对象的比例。

* **F1-score:**准确率和召回率的加权平均值。

**代码块:**

```python

import cv2

import numpy as np

# 加载图像

image = cv2.imread('image.jpg')

# 提取颜色直方图

hist = cv2.calcHist([image], [0, 1, 2], None, [8, 8, 8], [0, 256, 0, 256, 0, 256])

# 聚类

kmeans = cv2.kmeans(hist, 8)

# 识别对象

object_hist = cv2.calcHist([image], [0, 1, 2], None, [8, 8, 8], [0, 256, 0, 256, 0, 256])

distance = cv2.compareHist(object_hist, kmeans[0], cv2.CV_COMP_CHISQR)

if distance < 0.5:

print('识别成功')

else:

print('识别失败')

```

**逻辑分析:**

* `cv2.calcHist()`函数计算图像的直方图,其中`

0

0