半监督学习在图像识别中的奇迹:赋能计算机视觉

发布时间: 2024-08-22 13:27:16 阅读量: 32 订阅数: 34

# 1. 图像识别的基础

图像识别是计算机视觉中的一项基本任务,它涉及到从图像中识别和理解物体、场景和活动。图像识别技术在各种应用中都有广泛的应用,例如面部识别、医疗诊断和自动驾驶。

图像识别的过程通常涉及以下步骤:

- **图像预处理:**对图像进行预处理,例如调整大小、裁剪和归一化,以提高识别精度。

- **特征提取:**从图像中提取有意义的特征,这些特征可以用来区分不同的对象。

- **分类:**使用机器学习算法将提取的特征分类为预定义的类别。

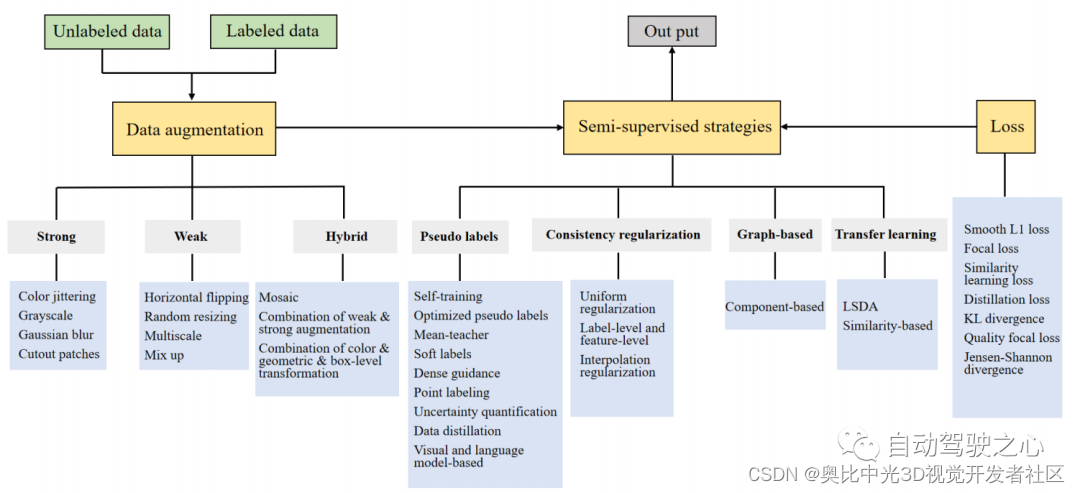

# 2.1 半监督学习的定义和原理

### 2.1.1 半监督学习的分类

半监督学习是一种介于监督学习和无监督学习之间的机器学习方法。与监督学习不同,半监督学习使用标记和未标记的数据来训练模型;与无监督学习不同,半监督学习使用标记数据来指导模型的学习过程。

半监督学习算法可以分为两类:

- **主动学习:**主动学习算法从未标记的数据中选择最具信息性的数据点进行标记,然后将这些标记的数据点添加到训练集中。

- **半主动学习:**半主动学习算法使用未标记的数据来增强模型的泛化能力,但不会主动选择数据点进行标记。

### 2.1.2 半监督学习的优势和局限

**优势:**

- 提高模型性能:半监督学习可以利用未标记的数据来增强模型的性能,尤其是在标记数据稀少的情况下。

- 降低标注成本:半监督学习可以减少标记数据的需求,从而降低标注成本。

- 提高鲁棒性:半监督学习可以提高模型对噪声和异常值的鲁棒性。

**局限:**

- 依赖于未标记数据的质量:半监督学习算法的性能高度依赖于未标记数据的质量。如果未标记数据包含噪声或异常值,可能会损害模型的性能。

- 算法选择困难:半监督学习算法种类繁多,选择合适的算法对于模型性能至关重要。

- 模型解释性差:半监督学习模型通常比监督学习模型更难解释,因为它们利用了未标记的数据。

# 3. 半监督学习在图像识别中的应用

半监督学习在图像识别领域展现出巨大的潜力,其优势在于能够利用大量未标记数据增强模型性能。本章将深入探讨半监督学习在图像分类和图像分割中的应用,分析其优势和局限。

### 3.1 图像分类

#### 3.1.1 半监督学习增强图像分类性能

在图像分类任务中,半监督学习通过利用未标记数据丰富训练集,增强模型的泛化能力和鲁棒性。例如,自训练算法可以迭代地将高置信度的预测结果作为伪标签添加到训练集中,从而扩大有标签数据集。图学习算法则利用未标记数据之间的结构信息,构建图结构并传播标签信息,提升模型的分类准确率。

#### 3.1.2 半监督学习处理小样本数据集

对于小样本数据集,半监督学习尤为重要。由于缺乏足够的有标签数据,传统监督学习模型容易出现过拟合问题。半监督学习通过引入未标记数据,为模型提供更多信息,帮助其学习更通用的特征表示,从而提高小样本数据集上的分类性能。

### 3.2 图像分割

#### 3.2.1 半监督学习提高图像分割精度

图像分割旨在将图像分解为具有不同语义含义的区域。半监督学习可以提高图像分割的精度,尤其是在处理复杂场景图像时。聚类算法通过将像素聚合为具有相似特征的簇,为未标记数据分配伪标签,从而辅助分割模型的训练。图学习算法则利用像素之间的空间关系,构建图结构并传播标签信息,提升分割结果的连贯性和准确性。

#### 3.2.2 半监督学习处理复杂场景图像

复杂场景图像通常包含丰富的纹理、遮挡和噪声,给图像分割带来挑战。半监督学习通过引入未标记数据,为模型提供更多上下文信息,帮助其学习更鲁棒的特征表示。例如,在处理包含遮挡对象的图像时,半监督学习模型可以利用未标记数据中未遮挡对象的特征,推断出被遮挡对象的形状和位置,从而提高分割精度。

**代码示例:**

```python

# 自训练算法示例

from sklearn.model_selection import train_test_split

from sklearn.svm import SVC

# 加载数据集

X, y = load_dataset()

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2)

# 初始化自训练模型

model = SVC()

# 迭代自训练

for i in range(10):

# 训练模型

model.fit(X_train, y_train)

# 预测未标记数据

y_pred = model.predict(X_test)

# 选择置信度高的预测结果作为伪标签

```

0

0