Hadoop在云环境下的演变:1.x到3.x的适应性与未来展望

发布时间: 2024-10-26 08:23:18 阅读量: 30 订阅数: 25

大数据管理系统的历史、现状与未来.pdf

# 1. Hadoop基础与云环境概述

Hadoop作为大数据领域的基石,为处理大规模数据集提供了有力的工具。随着云计算的兴起,Hadoop与云技术的融合成为数据处理行业的重要趋势。本章将从基础开始,介绍Hadoop的核心概念及其在云环境中的应用,为理解后续章节内容奠定基础。

## 1.1 Hadoop的起源和原理

Hadoop由Apache基金会开发,它的核心是Google发表的三篇论文,即GFS、MapReduce和Bigtable。这些论文奠定了Hadoop两个主要组件HDFS(Hadoop Distributed File System)和MapReduce编程模型的基础。HDFS用于存储大型数据集,并能够在廉价的硬件上提供高吞吐量的数据访问。MapReduce则是一个编程模型,用于处理和生成大数据集。

## 1.2 云计算的概念及其优势

云计算是一种基于Internet的计算方式,通过互联网提供按需的计算资源共享池(包括服务器、存储、应用和服务等)。云计算的主要优势包括按需自助服务、广泛的网络访问、资源池化、快速弹性和可度量的服务。这些优势使得云环境成为Hadoop运行的理想平台,尤其是对于需要弹性扩展和按需付费的企业用户。

## 1.3 Hadoop与云环境的结合

将Hadoop部署在云环境中,能够获得云服务的灵活性和可扩展性。用户可以快速扩展或缩减资源以适应数据处理需求的变化,而无需在本地物理硬件上进行大量投资。云Hadoop服务通常包括了底层的HDFS和MapReduce,以及更高层次的服务,如HBase和Hive,它们都经过优化,可以在云环境中高效运行。这种融合不仅提供了传统Hadoop的强大处理能力,还增加了云服务的便利性和成本效益。

# 2. Hadoop 1.x的架构与云适配性

## 2.1 Hadoop 1.x核心组件分析

### 2.1.1 HDFS的工作原理及其在云中的应用

Hadoop Distributed File System (HDFS) 是Hadoop 1.x版本的核心存储组件,它基于Google的GFS设计,能够在廉价的硬件上提供高吞吐量的文件访问功能。HDFS的设计目标是支持大数据集的存储,并提供高可靠性。其设计理念是通过数据的多副本存储来实现容错性,即每个数据块默认存储三份副本,分别放置在不同的数据节点上。

在云环境中,HDFS能够无缝适配,但需要对网络和存储资源进行合理规划。因为云环境提供的是虚拟的网络和存储资源,它们的性能和可靠性与物理环境有所差异。云存储的I/O性能会直接影响到HDFS的读写速度,而网络延迟也会对数据的复制和迁移造成影响。因此,在云环境中部署HDFS时,需要考虑如何平衡成本和性能,如何管理数据备份和恢复策略等问题。

云服务提供商通常提供优化过的存储解决方案,例如Amazon的EBS或Azure的托管磁盘,这些服务可以为HDFS提供更加稳定和高性能的存储后端。在设计HDFS架构时,可以考虑将HDFS的数据节点部署在高速网络上,并利用云服务的自动化能力进行扩展和备份。

```java

// 示例代码:HDFS 文件的读取操作

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path file = new Path("/user/hadoop/file.txt");

FSDataInputStream in = fs.open(file);

IOUtils.copyBytes(in, System.out, 4096, false);

in.close();

```

上面的代码块展示了在Java中如何使用Hadoop的API读取HDFS上的文件。在云环境中,读取操作的性能将依赖于网络I/O和数据节点的性能。

### 2.1.2 MapReduce编程模型及其优化策略

MapReduce是Hadoop 1.x提供的另一个核心组件,它是一种编程模型和处理大数据集的计算框架。MapReduce将计算任务分为两个阶段:Map阶段和Reduce阶段。Map阶段处理输入数据并生成中间键值对,Reduce阶段则对具有相同键的值进行合并处理。MapReduce的这种模式非常适合并行处理,能够高效地利用集群的计算资源。

在云环境中,MapReduce程序的执行可以借助弹性资源分配的优势,动态地增加或减少资源,以应对计算负载的变化。不过,MapReduce在云环境中的优化策略也需要特别注意,例如对数据本地化的优化,以减少数据传输开销。另外,云环境中节点的不确定性导致任务失败的可能性增大,因此需要设计更加健壮的任务容错机制。

```java

// 示例代码:一个简单的MapReduce程序

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable>{

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

```

在这段示例代码中,我们定义了一个简单的Map函数,它将文本行拆分成单词,并为每个单词输出一个键值对。在云环境中,我们需要确保Map任务尽可能在数据所在的节点上执行,以减少网络传输和提高效率。

## 2.2 Hadoop 1.x在云环境中的局限性

### 2.2.1 性能瓶颈与可扩展性问题

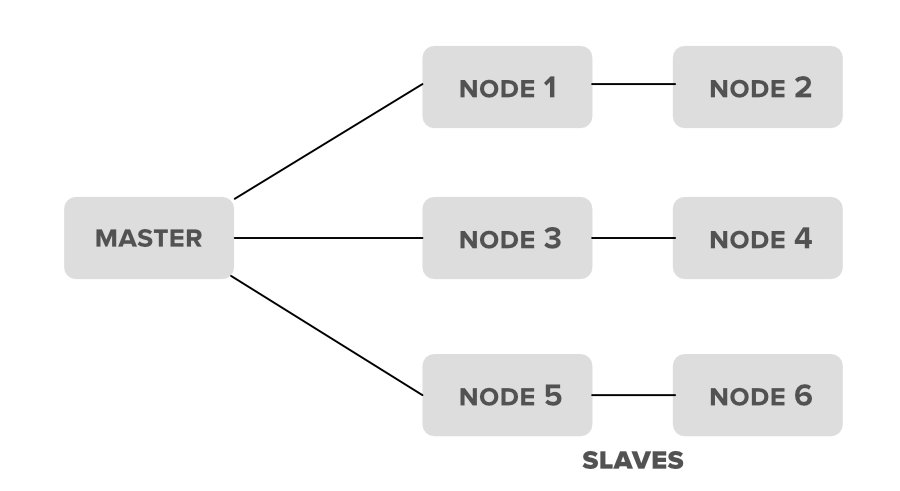

尽管Hadoop 1.x在处理大数据时表现出色,但在云环境中部署时存在一些性能瓶颈和可扩展性问题。由于Hadoop 1.x的设计是基于静态配置的集群,无法有效地利用动态扩展的云资源,如自动扩展的计算节点。此外,Hadoop 1.x的JobTracker和TaskTracker架构在面对大规模集群时,会遇到单点故障和性能瓶颈的问题,随着节点数量的增加,管理任务的复杂度和资源调度的开销也急剧增加。

在云环境中,资源是动态变化的,Hadoop需要更灵活的资源管理机制。为了克服这些局限性,Hadoop 2.x引入了YARN,它对资源管理和任务调度进行了优化,允许多个计算框架在同一个集群中运行,从而提高了集群的利用率和可扩展性。

### 2.2.2 云资源管理与调度挑战

云资源管理是Hadoop在云环境中面临的一个重要挑战。在云计算环境下,资源的动态分配和成本优化是云服务提供商和用户都非常关注的问题。Hadoop 1.x缺乏对这些方面的良好支持,而云平台提供了按需分配资源的能力,这对于Hadoop来说既是机遇也是挑战。

为了有效管理云资源,Hadoop需要集成云管理工具,利用云监控和自动化的资源分配策略来优化成本和性能。云服务提供商通常会提供API来与Hadoop集成,例如,Amazon Web Services提供了EC2和EMR服务,Azure提供了HDInsight服务,这些服务都能够简化Hadoop集群的部署和管理。此外,云原生的调度策略,如Kubernetes或Apache Mesos,也可以用来管理Hadoop集群资源,提供更高的弹性。

```mermaid

graph LR

A[客户端] -->|作业请求| B(YARN资源管理器)

B -->|资源分配| C(节点管理器)

C -.->|节点状态监控| D(资源管理器)

E[云资源API] -.-> D

F[其他计算框架] -->|任务请求| B

```

上图是一个简化的Hadoop YARN资源管理流程图。在云环境中,资源管理器可以与云服务提供商的API集成,实现资源的动态分配和优化。

在下一章节中,我们将详细介绍Hadoop 2.x版本中为解决这些挑战所做的改进和新增的特性。

# 3. Hadoop 2.x的云环境优化

## 3.1 Hadoop 2.x的新特性介绍

### 3.1.1 YARN的引入与资源管理

YARN(Yet Another Resource Negotiator),是Hadoop 2.x版本中引入的核心组件之一,旨在优化资源管理和作业调度。YARN的引入解决了Hadoop 1.x版本中JobTracker的单点故障问题,同时也提高了集群资源的利用率和系统的可扩展性。

在YARN中,资源管理的任务被分为两个主要组件:资源管理器(ResourceManager)和节点管理器(NodeManager)。ResourceManager负责全局资源分配和调度,而每个节点上的NodeManager负责本节点的资源监控和任务执行。通过这种方式,YARN能够更有效地调度各类作业,包括批处理任务、迭代计算任务以及交互式查询任务等。

#### 代码块示例与说明:

```shell

# 示例命令展示如何启动一个YARN集群

start-yarn.sh

```

该命令用于启动YARN集群的ResourceManager和NodeManager。在执行此命令之前,需要确保Hadoop的配置文件`yarn-site.xml`已正确设置,指定了ResourceManager的地址和资源管理策略等参数。

### 3.1.2 HDFS联邦与高可用性改进

HDFS联邦是Hadoop 2.x在文件系统层面的重要改进。它允许HDFS跨越多个命名空间扩展,每个命名空间由独立的NameNode管理。这种架构允许集群水平扩展,同时减少单点故障的可能性,提高系统的整体可用性和容错性。

此外,Hadoop 2.x的HDFS引入了高可用性(HA)配置,允许部署多个NameNode,且

0

0