【MATLAB神经网络入门指南】:从零开始构建你的第一个神经网络,解锁人工智能的神秘世界

发布时间: 2024-06-05 19:16:48 阅读量: 119 订阅数: 52

神经网络入门指导书,matlab

# 1. MATLAB神经网络简介

MATLAB神经网络工具箱是一个强大的平台,用于开发和部署神经网络模型。它提供了广泛的功能,包括:

* **神经网络创建和训练:**支持各种神经网络类型,如前馈网络、卷积神经网络和循环神经网络。

* **数据预处理和特征提取:**提供用于数据清理、归一化和特征提取的工具。

* **模型评估和可视化:**包括用于评估模型性能和可视化训练过程的工具。

* **模型部署和集成:**允许将训练好的模型部署到各种平台,包括云端和嵌入式设备。

# 2. 神经网络的基础理论

### 2.1 人工神经网络的结构和原理

人工神经网络(ANN)是一种受生物神经网络启发的计算模型。它由相互连接的节点组成,称为神经元。每个神经元接收一组输入,并产生一个输出,该输出由一个激活函数确定。

ANN通常分层组织,包括输入层、隐藏层和输出层。输入层接收原始数据,隐藏层执行特征提取和转换,输出层产生最终预测或分类。

神经元的数学模型如下:

```

y = f(Wx + b)

```

其中:

* `y` 是神经元的输出

* `x` 是神经元的输入

* `W` 是权重矩阵

* `b` 是偏置向量

* `f` 是激活函数

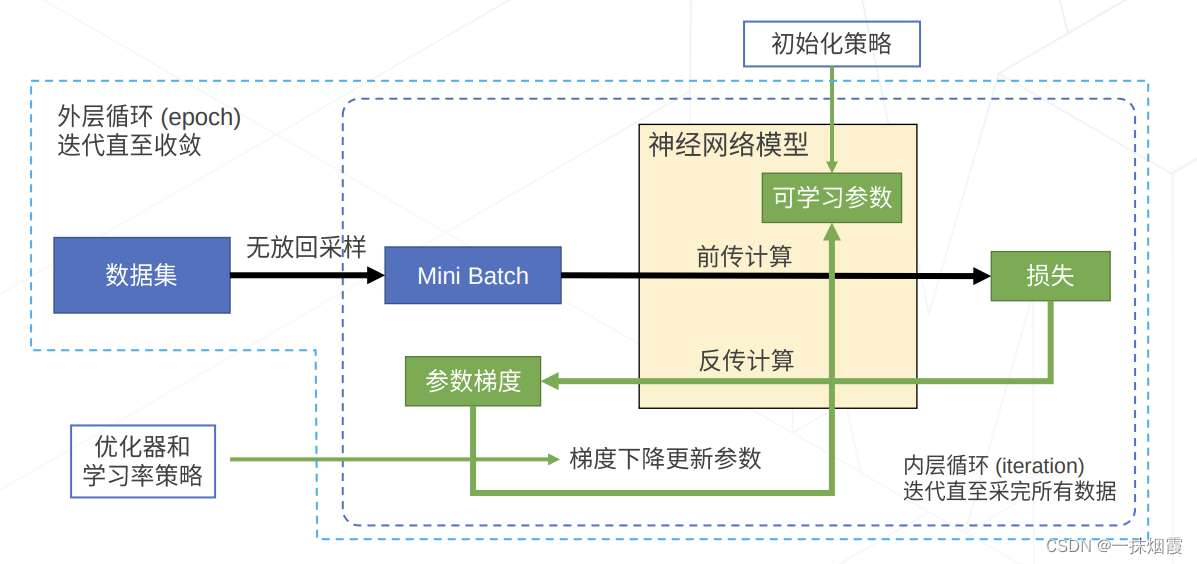

### 2.2 神经网络的学习算法

神经网络通过学习算法进行训练,以调整权重和偏置,使网络能够从数据中学习模式和特征。

#### 2.2.1 反向传播算法

反向传播算法是一种广泛使用的学习算法,它通过计算损失函数的梯度来更新权重和偏置。该算法通过以下步骤进行:

1. **前向传播:**将输入数据通过网络,计算每个神经元的输出。

2. **计算损失:**计算网络输出与预期输出之间的损失函数。

3. **反向传播:**使用链式法则计算损失函数相对于权重和偏置的梯度。

4. **更新权重和偏置:**使用梯度下降法更新权重和偏置,以最小化损失函数。

#### 2.2.2 梯度下降法

梯度下降法是一种优化算法,它通过沿梯度的负方向迭代更新参数,以最小化损失函数。梯度下降法的更新规则如下:

```

w = w - α * ∇L(w)

```

其中:

* `w` 是要更新的参数(权重或偏置)

* `α` 是学习率

* `∇L(w)` 是损失函数相对于参数的梯度

### 2.3 神经网络的评价指标

为了评估神经网络的性能,需要使用各种评价指标。这些指标包括:

#### 2.3.1 准确率

准确率是正确预测的样本数量与总样本数量之比。它衡量网络对已知数据的分类或预测能力。

#### 2.3.2 召回率

召回率是实际为正类且被正确预测为正类的样本数量与实际为正类的样本总数之比。它衡量网络识别所有正类样本的能力。

#### 2.3.3 F1值

F1值是准确率和召回率的调和平均值。它综合考虑了准确率和召回率,提供了一个更全面的性能评估。

# 3. MATLAB神经网络的实践应用

### 3.1 图像分类

图像分类是神经网络在计算机视觉领域的一项重要应用。MATLAB提供了丰富的工具和函数,可以轻松实现图像分类任务。

#### 3.1.1 数据预处理

图像分类的第一步是数据预处理。这包括以下步骤:

- **加载和预处理图像:**使用`imread`函数加载图像,并使用`imresize`函数调整图像大小。

- **转换图像格式:**将图像转换为神经网络可以识别的格式,例如`single`或`double`。

- **归一化图像:**将图像像素值归一化到[0, 1]范围内,以提高模型的鲁棒性。

#### 3.1.2 模型训练和评估

数据预处理完成后,就可以训练神经网络模型了。MATLAB提供了`trainNetwork`函数,可以轻松训练各种神经网络模型。

```

% 定义神经网络结构

layers = [

imageInputLayer([224 224 3])

convolution2dLayer(3, 32, 'Stride', 2, 'Padding', 'same')

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

convolution2dLayer(3, 64, 'Stride', 1, 'Padding', 'same')

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

convolution2dLayer(3, 128, 'Stride', 1, 'Padding', 'same')

reluLayer

fullyConnectedLayer(10)

softmaxLayer

classificationLayer

];

% 定义训练选项

options = trainingOptions('sgdm', ...

'InitialLearnRate', 0.01, ...

'MaxEpochs', 10, ...

'MiniBatchSize', 128, ...

'ValidationFrequency', 30, ...

'ValidationPatience', 6, ...

'Plots', 'training-progress');

% 训练神经网络

net = trainNetwork(trainData, layers, options);

% 评估模型

[~, scores] = classify(net, testData);

accuracy = mean(scores == testLabels);

```

**代码逻辑分析:**

- 定义神经网络结构:使用`imageInputLayer`定义输入层,`convolution2dLayer`定义卷积层,`reluLayer`定义ReLU激活函数,`maxPooling2dLayer`定义最大池化层,`fullyConnectedLayer`定义全连接层,`softmaxLayer`定义softmax层,`classificationLayer`定义分类层。

- 定义训练选项:使用`trainingOptions`定义训练选项,包括学习率、最大迭代次数、批量大小、验证频率、验证耐心和训练进度可视化。

- 训练神经网络:使用`trainNetwork`函数训练神经网络。

- 评估模型:使用`classify`函数对测试数据进行分类,并计算准确率。

### 3.2 自然语言处理

自然语言处理(NLP)是神经网络在语言处理领域的一项重要应用。MATLAB提供了`textAnalytics`工具箱,可以轻松实现各种NLP任务。

#### 3.2.1 文本表示

文本表示是NLP任务的基础。MATLAB提供了多种文本表示方法,包括:

- **词袋模型(BoW):**将文本表示为单词出现的次数。

- **TF-IDF:**考虑单词在文档和语料库中的频率,赋予重要单词更高的权重。

- **词嵌入:**将单词表示为低维向量,捕获单词之间的语义关系。

#### 3.2.2 情感分析

情感分析是NLP任务中的一项重要应用。MATLAB提供了`textAnalytics.Sentiment`类,可以轻松实现情感分析。

```

% 加载文本数据

data = readtable('text_data.csv');

% 创建情感分析器

analyzer = textAnalytics.SentimentAnalyzer('Sentiment', 'positive');

% 分析文本

scores = analyzer.predict(data.text);

% 可视化结果

figure;

histogram(scores);

title('情感分析结果');

xlabel('情感得分');

ylabel('频率');

```

**代码逻辑分析:**

- 加载文本数据:使用`readtable`函数加载文本数据。

- 创建情感分析器:使用`textAnalytics.SentimentAnalyzer`类创建情感分析器,指定情感类型为“positive”。

- 分析文本:使用`predict`方法对文本进行情感分析,得到情感得分。

- 可视化结果:使用`histogram`函数可视化情感分析结果。

### 3.3 时间序列预测

时间序列预测是神经网络在时序数据处理领域的一项重要应用。MATLAB提供了`timeseries`工具箱,可以轻松实现各种时间序列预测任务。

#### 3.3.1 数据预处理

时间序列预测的第一步是数据预处理。这包括以下步骤:

- **加载和预处理数据:**使用`load`函数加载时间序列数据,并使用`tsmovavg`函数平滑数据。

- **划分数据集:**将数据集划分为训练集和测试集。

- **归一化数据:**将数据归一化到[0, 1]范围内,以提高模型的鲁棒性。

#### 3.3.2 模型训练和评估

数据预处理完成后,就可以训练神经网络模型了。MATLAB提供了`trainNetwork`函数,可以轻松训练各种神经网络模型。

```

% 定义神经网络结构

layers = [

sequenceInputLayer(1)

lstmLayer(100, 'OutputMode', 'sequence')

fullyConnectedLayer(1)

regressionLayer

];

% 定义训练选项

options = trainingOptions('adam', ...

'InitialLearnRate', 0.01, ...

'MaxEpochs', 100, ...

'MiniBatchSize', 128, ...

'ValidationFrequency', 30, ...

'ValidationPatience', 6, ...

'Plots', 'training-progress');

% 训练神经网络

net = trainNetwork(trainData, layers, options);

% 评估模型

predictions = predict(net, testData);

rmse = sqrt(mean((predictions - testLabels).^2));

```

**代码逻辑分析:**

- 定义神经网络结构:使用`sequenceInputLayer`定义输入层,`lstmLayer`定义LSTM层,`fullyConnectedLayer`定义全连接层,`regressionLayer`定义回归层。

- 定义训练选项:使用`trainingOptions`定义训练选项,包括学习率、最大迭代次数、批量大小、验证频率、验证耐心和训练进度可视化。

- 训练神经网络:使用`trainNetwork`函数训练神经网络。

- 评估模型:使用`predict`函数对测试数据进行预测,并计算均方根误差(RMSE)。

# 4. MATLAB神经网络的进阶应用

### 4.1 深度学习

深度学习是机器学习的一个子领域,它使用具有多个隐藏层的复杂神经网络模型来学习数据中的复杂模式。深度学习模型能够处理大量数据,并从中学到抽象特征,从而实现卓越的性能。

#### 4.1.1 卷积神经网络(CNN)

CNN是一种深度学习模型,专门用于处理图像数据。它使用卷积层来提取图像中的特征,然后使用池化层来减少特征图的大小,从而降低计算复杂度。CNN在图像分类、目标检测和图像分割等任务中表现出色。

**代码块:**

```

% 加载图像数据

data = load('imageData.mat');

images = data.images;

labels = data.labels;

% 创建CNN模型

layers = [

imageInputLayer([28 28 1])

convolution2dLayer(5, 20)

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

convolution2dLayer(5, 50)

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

fullyConnectedLayer(10)

softmaxLayer

classificationLayer

];

options = trainingOptions('sgdm', ...

'InitialLearnRate', 0.01, ...

'MaxEpochs', 10, ...

'MiniBatchSize', 128, ...

'ValidationData', {images, labels}, ...

'ValidationFrequency', 30);

% 训练CNN模型

net = trainNetwork(images, labels, layers, options);

% 评估CNN模型

[YPred, scores] = classify(net, images);

accuracy = mean(YPred == labels);

```

**逻辑分析:**

* `imageInputLayer`:定义输入图像的大小和通道数。

* `convolution2dLayer`:使用卷积核提取图像特征。

* `reluLayer`:应用ReLU激活函数,引入非线性。

* `maxPooling2dLayer`:通过最大池化减少特征图的大小。

* `fullyConnectedLayer`:将特征图展平并连接到全连接层。

* `softmaxLayer`:计算每个类别的概率。

* `classificationLayer`:将概率转换为类别预测。

* `trainingOptions`:设置训练超参数,如学习率、迭代次数和批量大小。

* `trainNetwork`:训练CNN模型。

* `classify`:使用训练好的模型对新图像进行分类。

* `accuracy`:计算分类准确率。

#### 4.1.2 循环神经网络(RNN)

RNN是一种深度学习模型,专门用于处理序列数据,如文本和时间序列。RNN使用隐藏状态来记住序列中的先前信息,从而能够对序列数据进行建模和预测。

**代码块:**

```

% 加载文本数据

data = load('textData.mat');

text = data.text;

% 创建RNN模型

layers = [

textinputlayer

embeddingLayer(100, 128)

lstmLayer(128)

fullyConnectedLayer(10)

softmaxLayer

classificationLayer

];

options = trainingOptions('adam', ...

'InitialLearnRate', 0.001, ...

'MaxEpochs', 10, ...

'MiniBatchSize', 64, ...

'ValidationData', {text, labels}, ...

'ValidationFrequency', 30);

% 训练RNN模型

net = trainNetwork(text, labels, layers, options);

% 评估RNN模型

[YPred, scores] = classify(net, text);

accuracy = mean(YPred == labels);

```

**逻辑分析:**

* `textinputlayer`:定义输入文本数据。

* `embeddingLayer`:将文本数据转换为数字向量。

* `lstmLayer`:使用LSTM单元处理序列数据。

* `fullyConnectedLayer`:将LSTM输出连接到全连接层。

* `softmaxLayer`:计算每个类别的概率。

* `classificationLayer`:将概率转换为类别预测。

* `trainingOptions`:设置训练超参数,如学习率、迭代次数和批量大小。

* `trainNetwork`:训练RNN模型。

* `classify`:使用训练好的模型对新文本数据进行分类。

* `accuracy`:计算分类准确率。

### 4.2 生成式对抗网络(GAN)

GAN是一种深度学习模型,它可以生成逼真的数据,如图像、文本和音乐。GAN由两个神经网络组成:生成器和判别器。生成器生成数据,而判别器则区分生成的数据和真实的数据。

#### 4.2.1 GAN的原理和结构

GAN的原理是通过对抗训练来优化生成器和判别器。生成器尝试生成逼真的数据来欺骗判别器,而判别器则尝试区分生成的数据和真实的数据。通过这种对抗训练,生成器可以逐渐学习生成高质量的数据。

**Mermaid流程图:**

```mermaid

graph LR

subgraph Generator

A[Generate data] --> B[Output data]

end

subgraph Discriminator

C[Input data] --> D[Output: real/fake]

end

A --> D

B --> D

```

**逻辑分析:**

* 生成器:生成数据并输出。

* 判别器:输入数据并输出真/假标签。

* 生成器和判别器通过对抗训练进行优化。

#### 4.2.2 GAN的训练和应用

GAN的训练需要大量的真实数据和精心设计的损失函数。GAN的应用包括图像生成、文本生成和数据增强。

**代码块:**

```

% 加载图像数据

data = load('imageData.mat');

images = data.images;

% 创建GAN模型

generator = dcganGenerator(64, 100, 'relu');

discriminator = dcganDiscriminator(64, 'relu');

% 训练GAN模型

options = trainingOptions('adam', ...

'InitialLearnRate', 0.0002, ...

'MaxEpochs', 10, ...

'MiniBatchSize', 128);

[generator, discriminator] = trainGAN(generator, discriminator, images, options);

% 生成图像

generatedImages = predict(generator, randn(100, 100));

```

**逻辑分析:**

* `dcganGenerator`:定义生成器模型。

* `dcganDiscriminator`:定义判别器模型。

* `trainGAN`:训练GAN模型。

* `predict`:使用训练好的生成器生成图像。

### 4.3 强化学习

强化学习是一种机器学习方法,它通过与环境交互并获得奖励或惩罚来学习最优行为。强化学习算法旨在最大化累积奖励,从而找到最优策略。

#### 4.3.1 强化学习的原理和算法

强化学习算法使用价值函数来估计状态和动作的价值。价值函数表示在给定状态下执行特定动作的预期长期奖励。强化学习算法通过更新价值函数来学习最优策略,从而最大化累积奖励。

**表格:**

| 强化学习算法 | 描述 |

|---|---|

| Q学习 | 基于价值函数的算法,使用更新规则来估计状态-动作值。 |

| SARSA | 基于策略的算法,使用更新规则来估计状态-动作-奖励-状态-动作序列的值。 |

| 深度强化学习 | 使用深度神经网络来估计价值函数或策略的算法。 |

#### 4.3.2 强化学习在MATLAB中的应用

MATLAB提供了用于强化学习的工具箱,包括`rl`和`rl.agents`包。这些工具箱提供了各种强化学习算法和环境,使研究人员和工程师能够轻松开发和评估强化学习模型。

**代码块:**

```

% 创建强化学习环境

env = rl.env.CartPoleEnv;

% 创建强化学习算法

agent = rl.agent.DQNAgent;

% 训练强化学习算法

trainOpts = rl.option.TrainingOptions;

trainOpts.MaxEpisodes = 1000;

trainOpts.MaxStepsPerEpisode = 200;

trainingResults = train(agent, env, trainOpts);

% 使用强化学习算法

states = env.reset();

totalReward = 0;

for t = 1:1000

actions = agent.getAction(states);

[states, rewards, isDone, ~] = env.step(actions);

totalReward = totalReward + rewards;

if isDone

break;

end

end

```

**逻辑分析:**

* `rl.env.CartPoleEnv`:创建强化学习环境。

* `rl.agent.DQNAgent`:创建强化学习算法。

* `train`:训练强化学习算法。

* `getAction`:使用强化学习算法获取动作。

* `step`:执行动作并获取奖励、状态和是否完成标志。

# 5.1 模型优化

在训练神经网络模型时,模型优化至关重要。通过优化,我们可以提高模型的性能,减少训练时间,并防止过拟合和欠拟合等问题。MATLAB提供了多种模型优化技术,包括:

### 5.1.1 超参数调优

超参数是神经网络模型训练过程中的可调参数,例如学习率、批次大小和正则化参数。超参数调优是通过调整这些参数来找到模型的最佳配置,从而提高模型的性能。

在MATLAB中,可以使用`trainNetwork`函数进行超参数调优。该函数提供了一个`'hyperparameters'`选项,允许用户指定要调整的超参数及其范围。例如,以下代码演示了如何使用`trainNetwork`函数调整学习率:

```

% 定义神经网络模型

net = feedforwardnet([10 10 1]);

% 定义超参数调优选项

options = trainingOptions('sgdm', ...

'InitialLearnRate', [0.01 0.05 0.1], ...

'MaxEpochs', 100);

% 训练神经网络

net = trainNetwork(trainData, trainLabels, net, options);

```

### 5.1.2 正则化

正则化是一种技术,用于防止神经网络模型过拟合。过拟合是指模型在训练数据上表现良好,但在新数据上表现不佳。正则化通过惩罚模型的复杂性来实现,从而迫使模型学习更通用的特征。

MATLAB提供了多种正则化技术,包括:

* **权重衰减:** 权重衰减通过向损失函数添加权重大小的惩罚项来惩罚模型的复杂性。

* **Dropout:** Dropout是一种随机丢弃神经网络中某些神经元的技术。这有助于防止神经元之间过度拟合。

* **数据增强:** 数据增强通过对训练数据应用随机变换(例如旋转、裁剪和翻转)来增加训练数据的有效大小。这有助于模型学习更鲁棒的特征。

以下代码演示了如何使用MATLAB中的`weightDecay`函数进行权重衰减:

```

% 定义神经网络模型

net = feedforwardnet([10 10 1]);

% 定义正则化选项

options = trainingOptions('sgdm', ...

'WeightDecay', 0.001, ...

'MaxEpochs', 100);

% 训练神经网络

net = trainNetwork(trainData, trainLabels, net, options);

```

# 6. MATLAB神经网络的未来发展和应用前景

MATLAB神经网络技术在不断发展,未来有广阔的应用前景。

### 6.1 神经网络架构的创新

随着计算能力的提高,神经网络的架构变得越来越复杂。近年来,涌现出许多新的神经网络架构,如Transformer、ResNet和EfficientNet。这些架构可以处理更复杂的数据,并获得更好的性能。

### 6.2 自动机器学习(AutoML)

AutoML是人工智能的一个分支,它使用机器学习技术来自动化机器学习模型的构建和优化过程。AutoML可以使非机器学习专家更容易地使用神经网络来解决问题。

### 6.3 边缘计算

边缘计算是一种分布式计算范式,它将计算和存储从云端转移到靠近数据源的边缘设备。神经网络可以部署在边缘设备上,以实现实时决策和低延迟。

### 6.4 量子计算

量子计算是一种新型的计算范式,它利用量子力学原理来解决传统计算机无法解决的问题。量子计算有望极大地加速神经网络的训练和推理过程。

### 6.5 应用前景

MATLAB神经网络技术在未来将有广泛的应用前景,包括:

- **图像和视频分析:**神经网络可以用于图像和视频的分类、检测和分割。

- **自然语言处理:**神经网络可以用于文本分类、情感分析和机器翻译。

- **时间序列预测:**神经网络可以用于预测时间序列数据,如股票价格和天气预报。

- **医疗保健:**神经网络可以用于疾病诊断、药物发现和个性化治疗。

- **金融:**神经网络可以用于欺诈检测、风险管理和投资决策。

0

0