特征选择技术在社交网络分析中的应用:原理与实战解析

发布时间: 2024-08-21 19:57:48 阅读量: 35 订阅数: 50

Webbots、Spiders和Screen Scrapers:技术解析与应用实践

# 1. 社交网络分析概述**

社交网络分析是一种研究社交网络结构和动态的研究方法。它旨在理解个人、组织和社区之间的关系模式,以及这些模式如何影响社会行为和结果。社交网络分析广泛应用于各种领域,包括社会学、心理学、计算机科学和市场营销。

社交网络由节点(代表个人或组织)和连接它们的关系(例如友谊、合作或信息流)组成。通过分析这些网络,我们可以识别社区、中心人物和信息流模式。这些见解可用于了解社会影响力、传播过程和群体行为。

# 2. 特征选择理论基础

### 2.1 特征选择概念与分类

特征选择,也称为变量选择,是从原始数据集的特征集合中选择一个最优子集的过程,该子集能够最大化目标函数(例如分类或回归模型的性能)。特征选择的主要目标是:

- **提高模型性能:**减少冗余和无关特征可以提高模型的泛化能力,从而提高其在未见过数据的预测性能。

- **减少计算成本:**较小的特征子集可以减少训练和预测模型所需的时间和资源。

- **增强可解释性:**通过选择最相关的特征,可以更好地理解模型的决策过程,提高其可解释性。

特征选择算法通常分为三类:

- **基于过滤的特征选择:**根据特征的统计属性(例如方差、信息增益)对特征进行评分,然后选择得分最高的特征。

- **基于包装的特征选择:**使用机器学习模型作为评估标准,迭代地添加或删除特征,直到找到最佳特征子集。

- **基于嵌入的特征选择:**将特征选择过程集成到机器学习模型的训练过程中,例如正则化技术(例如 L1 正则化)可以自动执行特征选择。

### 2.2 特征选择评价准则

评估特征选择算法的性能需要使用合适的评价准则。常见的评价准则包括:

- **分类准确率:**对于分类任务,特征子集的分类准确率可以衡量其预测能力。

- **回归误差:**对于回归任务,特征子集的回归误差(例如均方误差)可以衡量其拟合数据的准确性。

- **信息增益:**信息增益衡量特征对目标变量的不确定性的减少程度,是基于过滤的特征选择算法常用的评价准则。

- **卡方统计量:**卡方统计量衡量特征与目标变量之间的关联强度,也是基于过滤的特征选择算法常用的评价准则。

### 2.3 特征选择算法

有多种特征选择算法可用于不同类型的任务和数据集。以下是一些常用的算法:

- **基于过滤的特征选择:**

- 方差阈值法

- 卡方检验

- 信息增益

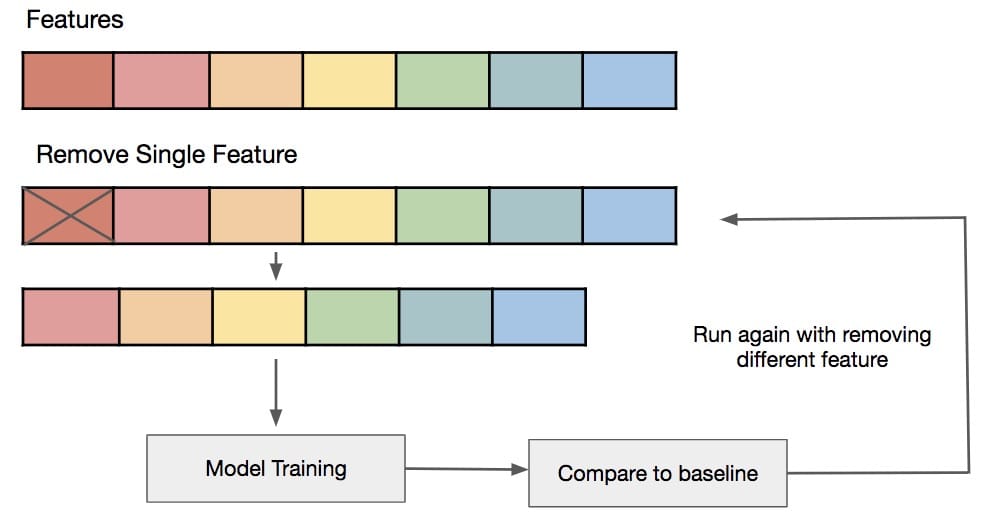

- **基于包装的特征选择:**

- 顺序向前选择

- 顺序向后选择

- 递归特征消除

- **基于嵌入的特征选择:**

- L1 正则化(LASSO)

- L2 正则化(岭回归)

- 树模型(例如决策树、随机森林)

# 3. 社交网络特征选择实践

### 3.1 社交网络数据预处理

社交网络数据通常包含大量噪声和冗余信息,因此在进行特征选择之前,需要对其进行预处理。数据预处理的主要步骤包括:

- **数据清洗:**删除缺失值、异常值和重复数据。

- **数据归一化:**将不同特征的值缩放到相同的范围,以消除量纲差异的影响。

- **数据降维:**通过主成分分析(PCA)或奇异值分解(SVD)等技术减少特征的数量,同时保留数据中的主要信息。

### 3.2 基于过滤的特征选择

基于过滤的特征选择方法根据特征的统计特性(如信息增益、卡方统计量或互信息)对特征进行评分,然后选择得分最高的特征。这些方法简单高效,但可能无法捕捉到特征之间的交互作用。

**代码示例:**

```python

import pandas as pd

from sklearn.feature_selection import SelectKBest, chi2

# 加载社交网络数据

data = pd.read_csv('social_network_data.csv')

# 计算特征的信息增益

selector = SelectKBest(chi2, k=10)

selector.fit(data.drop('target', axis=1), data['target'])

# 选择得分最高的特征

selected_features = selector.get_support(indices=True)

```

**参数说明:**

- `k`: 要选择的特征数量。

- `score_func`: 用于计算特征得分的函数,如信息增益或卡方统计量。

**逻辑分析:**

该代码使用卡方统计量作为特征评分函数,选择得分最高的 10 个特征。卡方统计量衡量特征值与目标变量之间的关联性,得分较高的特征表示与目标变量有更强的相关性。

### 3.3 基于包装的特征选择

基于包装的特征选择方法将特征选择过程与机器学习模型训练结合起来。它通过迭代地添加或删除特征,并评估模型的性能来选择最佳特征子集。这些方法可以捕捉到特征之间的交互作用,但计算成本较高。

**代码示例:**

```python

import n

```

0

0