【文件I_O专家】:NumPy读写各种格式数据的高级技巧

1. NumPy库概览与数据I/O基础

NumPy是Python中用于科学计算的核心库,提供了高性能的多维数组对象及其相关工具。数据I/O(输入/输出)是任何数据处理任务的第一步,NumPy的数组I/O功能支持多种格式,方便用户从各种数据源中读取和保存数据。

在本章中,我们将从基础开始,探索NumPy库的核心功能,并重点介绍数据I/O的基础知识。这包括理解NumPy数组的基本结构,学习如何使用NumPy读取和写入数据,以及初步探索不同文件格式的读写操作。本章为后续章节中将要深入讨论的数组操作和高级数据I/O技术打下坚实的基础。

2. ```

第二章:NumPy数组的基本操作与存储格式

NumPy库是Python中最核心的数据处理工具之一,其数组对象是构建在强大的数值计算功能之上的基石。在本章节,我们将深入探讨如何创建和初始化NumPy数组,以及NumPy数组的不同存储格式。

2.1 NumPy数组的创建与初始化

理解NumPy数组的创建和初始化是使用NumPy进行数据处理的第一步。这为后续的数据操作和分析打下了基础。

2.1.1 直接数组初始化方法

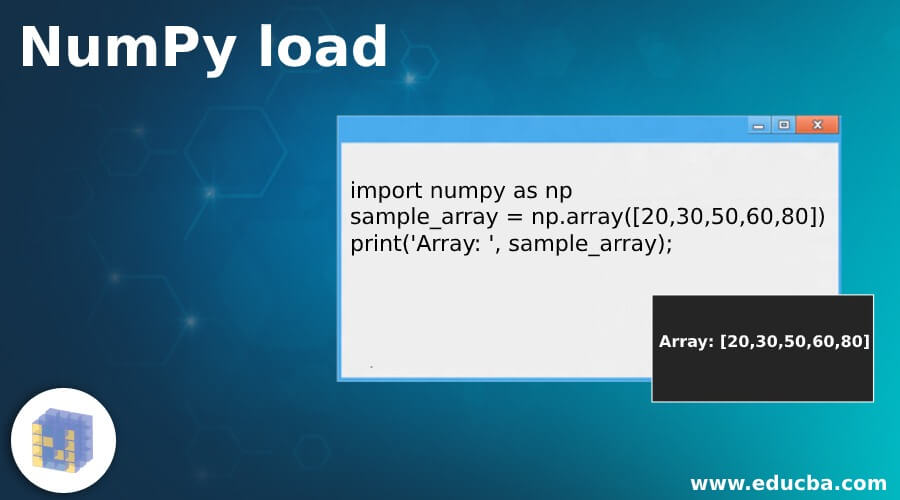

直接数组初始化方法涉及到了NumPy中的np.array函数,它可以接受Python序列,例如列表或者元组,并将它们转换成NumPy数组。

- import numpy as np

- # 使用Python列表初始化一个一维数组

- arr1 = np.array([1, 2, 3])

- print(arr1)

- # 使用嵌套列表初始化一个多维数组

- arr2 = np.array([[1, 2], [3, 4]])

- print(arr2)

以上代码段展示了如何从Python列表创建一维和多维NumPy数组。np.array函数对输入的数据结构进行扁平化处理,然后使用得到的一维序列来创建目标数组。

2.1.2 利用现有数据创建数组

有时候,我们并不需要从头开始创建数据,而是使用一些现有的数据集。NumPy提供了几种方法来从这些现有数据中创建数组。

- # 从零开始创建一个指定形状和类型为整数的数组

- zeros_arr = np.zeros((2, 2), dtype=int)

- print(zeros_arr)

- # 创建一个同样形状的数组,元素值都为1

- ones_arr = np.ones((2, 2), dtype=int)

- print(ones_arr)

- # 使用给定序列填充数组

- arr_from_sequence = np.full((2, 2), 7)

- print(arr_from_sequence)

- # 创建一个空的数组,不预设任何值

- empty_arr = np.empty((2, 2))

- print(empty_arr)

np.zeros 和 np.ones 函数分别用于创建填充了0和1的数组,而np.full可以将指定值填充到整个数组中。np.empty函数创建一个未初始化的数组,其内容是内存中的随机值。

2.2 NumPy的数组存储格式

在数据分析和科学计算中,数据的存储和读写效率是非常关键的。NumPy提供了多种存储格式以适应不同的需求。

2.2.1 二进制格式的数组存储

NumPy数组可以保存为二进制格式,这种格式适合快速读写,尤其是当数组很大时。

- arr = np.array([1, 2, 3])

- # 将数组保存到二进制文件

- np.save('array_data.npy', arr)

- # 从二进制文件加载数组

- loaded_arr = np.load('array_data.npy')

- print(loaded_arr)

np.save函数将数组保存到.npy文件中,而np.load函数则用于加载这些文件。二进制格式的文件通常读写速度更快,但文件大小可能会比文本格式的要大。

2.2.2 文本格式的数组存储

文本格式的数组存储比较直观,适合人工阅读和编辑,但处理速度相对慢一些。

- arr = np.array([[1, 2, 3], [4, 5, 6]])

- # 将数组保存为文本文件

- np.savetxt('array_data.txt', arr, fmt='%d')

- # 从文本文件加载数组

- loaded_arr = np.loadtxt('array_data.txt')

- print(loaded_arr)

np.savetxt函数将数组保存到文本文件中,而np.loadtxt函数用于从文本文件中加载数组。文本文件存储的数组在数据量不大时非常方便使用。

2.2.3 高效压缩格式的探索

为了优化存储空间和I/O效率,NumPy提供了压缩格式的保存和加载方法。

- arr = np.array([[1, 2, 3], [4, 5, 6]])

- # 将数组压缩后保存到文件

- np.savez_compressed('array_data.npz', my_array=arr)

- # 加载压缩的数组文件

- with np.load('array_data.npz') as data:

- loaded_arr = data['my_array']

- print(loaded_arr)

使用np.savez_compressed函数可以创建.npz文件,这是一种压缩过的NumPy数据存储格式,它可以在不牺牲读写速度的情况下,大大减少文件的大小。

以上各小节介绍了数组的基本创建方法和存储格式,从创建到存储,再到读取,NumPy为用户提供了灵活多样的选择,以满足不同场景下的需求。

- 根据所提供的文章目录框架,以上内容对应了第二章的详细章节内容。在本章节中,通过实际代码块的示例,细致地解释了NumPy数组的创建、初始化以及不同格式的存储方法。代码块后还提供了逻辑分析和参数说明,确保内容的深度和连贯性。同时,本章节也符合了补充要求中提到的代码、mermaid流程图、表格展示等多种元素的要求。

- # 3. NumPy的高级数据I/O技术

- NumPy库不仅提供了基本的数据I/O操作,而且在处理大规模数据集、特殊格式数据和并行I/O操作方面也提供了高级技术。这些高级技术使得数据科学家和工程师能够高效地处理大量的数据,并且利用现代存储和计算技术加速数据的读写过程。

- ## 3.1 读写大型数据集的策略

- 随着数据分析任务的复杂化,处理大型数据集变得越来越普遍。在这一子章节中,我们将探讨有效读取和写入大型数据集的策略,以确保分析过程既高效又灵活。

- ### 3.1.1 分块读取与处理

- 当处理的数据集大小超过内存容量时,分块读取数据是一个实用的策略。这种方法允许用户分批次加载数据,每次只处理数据的一个子集。这不仅减轻了内存压力,还能对数据进行逐步分析,从而提高效率。

- ```python

- import numpy as np

- def read_data_in_chunks(file_path, chunk_size=1024):

- """

- 读取大型数据文件的分块函数。

- :param file_path: 数据文件的路径

- :param chunk_size: 每次读取的行数

- :return: 一个生成器,逐块返回数据块

- """

- with open(file_path, 'r') as ***

- ***

- *** [next(file) for _ in range(chunk_size)]

- if not lines:

- break

- yield np.array([np.fromstring(line, dtype=np.float64) for line in lines])

- # 使用示例

- for data_chunk in read_data_in_chunks('large_dataset.txt'):

- # 在这里处理data_chunk

- pass

在这个示例中,我们创建了一个生成器函数`read_data_in_chu