交易数据价值提取:关联规则挖掘的实战经验分享

发布时间: 2024-09-07 14:24:22 阅读量: 91 订阅数: 60

# 1. 关联规则挖掘概述

## 1.1 关联规则挖掘简介

关联规则挖掘是数据挖掘领域中的一种重要技术,主要用于发现大量数据中变量间的有趣关系,尤其是变量间共同出现的频率。这类技术在零售、医疗、生物信息学等多个领域都有广泛的应用。简单来说,关联规则挖掘是通过分析数据中物品的频繁出现模式,发现商品间的关联性,从而为决策提供依据。

## 1.2 关联规则挖掘的应用场景

在零售业中,关联规则挖掘可以帮助商家发现哪些商品常常一起被购买,从而做出库存、货架摆放和促销策略的调整。例如,面包和牛奶经常被一起购买,店家就可以将它们放置在同一区域,或者在牛奶打折时同时对面包进行促销。这种分析方法提升了商品销售效率,并优化了客户的购物体验。

## 1.3 关联规则挖掘的现实意义

关联规则挖掘不仅有助于商品销售和库存管理,还能应用于网络安全领域,比如检测异常的访问模式、欺诈行为识别等。在医疗领域,关联规则可以分析病人特征与疾病之间的关系,为疾病预防和个性化治疗提供数据支持。因此,掌握关联规则挖掘技术对于提升数据驱动的决策质量具有重大意义。

# 2. 关联规则挖掘理论基础

### 2.1 关联规则挖掘的定义与重要性

#### 2.1.1 什么是关联规则挖掘

关联规则挖掘是一种从大规模数据集中发现变量之间有趣关系的方法,这些关系通常表示为“如果-那么”的规则。它的主要目的是从大量数据中识别物品间、事件间或属性间发生的频繁模式、关联、相关性或因果结构。

在商业智能领域,关联规则挖掘广泛应用于零售业的购物篮分析,帮助零售商了解哪些商品经常一起被购买,从而优化库存管理和销售策略。此外,它也在网络安全、生物信息学、医疗诊断等领域中扮演着重要的角色。

#### 2.1.2 关联规则挖掘在交易数据分析中的作用

在交易数据分析中,关联规则挖掘可以揭示交易数据中隐含的、潜在的有用信息,这对于商家来说有着重要的商业价值。例如,通过分析购物篮数据,零售商可以:

1. 制定交叉销售策略,将经常一起被购买的商品放置在相邻位置,以刺激消费者的购买欲望。

2. 进行商品捆绑销售,提高单个交易的金额。

3. 调整库存水平,保证热门商品的充足供应,同时减少滞销商品的库存积压。

4. 进行个性化推荐,通过分析顾客的购买历史,为其推荐可能感兴趣的商品。

### 2.2 关联规则挖掘的关键算法

#### 2.2.1 Apriori算法原理

Apriori算法是关联规则挖掘中应用最为广泛的算法之一。其核心思想是基于频繁项集的反单调性,也就是说一个项集频繁,则其所有子集也频繁。Apriori算法通过迭代的方式,逐层产生频繁项集:

1. 首先找出所有的单个商品项作为1-项集。

2. 然后通过连接步和剪枝步,从1-项集构造2-项集,再对2-项集进行相同的处理,生成3-项集,以此类推。

3. 当无法再构造出更高阶的频繁项集时,算法停止迭代。

Apriori算法的效率在很大程度上依赖于合理的剪枝操作和频繁项集的支持度计数。

#### 2.2.2 FP-Growth算法原理

FP-Growth(Frequent Pattern Growth)算法是一种无需候选生成的频繁模式挖掘方法,它克服了Apriori算法在生成频繁项集时多次扫描数据库的缺点,提高了算法的效率。FP-Growth算法主要包括两个步骤:

1. 构建FP树(Frequent Pattern Tree)。FP树是一种压缩的数据结构,能够有效地存储频繁项集信息。

2. 基于FP树,采用分治策略挖掘频繁项集。

FP-Growth算法通过利用数据库中事务的内在结构,大幅减少了数据库的扫描次数,从而提高了频繁项集挖掘的效率。

#### 2.2.3 算法性能比较

在实际应用中,Apriori和FP-Growth算法各有优势。Apriori算法易于理解和实现,适用于数据集较小且项集不多的情况。而FP-Growth算法在处理大规模数据集时表现出更高的效率和更强的扩展性。

| 算法特性 | Apriori | FP-Growth |

|----------|---------|-----------|

| 实现复杂度 | 低 | 高 |

| 数据集大小 | 适用于小数据集 | 适用于大数据集 |

| 性能 | 较慢,因为需要多次扫描数据库 | 较快,仅需两次数据库扫描 |

| 处理复杂性 | 低,但效率低下 | 高,但效率较高 |

### 2.3 关联规则评价指标

#### 2.3.1 支持度、置信度与提升度

关联规则挖掘常用的评价指标包括支持度(Support)、置信度(Confidence)和提升度(Lift)。它们对于评估规则的有效性和强度至关重要。

- **支持度** 衡量一个规则在整个数据集中出现的频率,计算公式为 `support(A->B) = P(A ∩ B)`。

- **置信度** 表示在前项A发生的条件下,后项B发生的条件概率,计算公式为 `confidence(A->B) = P(B|A)`。

- **提升度** 是一个规则的置信度与后项B在数据集中独立出现的概率之间的比值,计算公式为 `lift(A->B) = confidence(A->B) / P(B)`。

#### 2.3.2 规则兴趣度的度量与评估

除了上述三个基本指标,还有其它的指标可以帮助评估规则的兴趣度,例如杠杆率(Leverage)、杠杆率和卷标(Conviction)等。这些指标为我们提供了不同视角来衡量规则的可靠性及其在业务上的应用潜力。

兴趣度指标的计算和运用,需基于具体业务场景和数据特性进行选择。如选择不当,可能导致结果的误导。因此,正确选择和解释这些指标是实施关联规则挖掘成功的关键。

> 在本章节中,我们从理论基础出发,逐步深入了解了关联规则挖掘的定义、关键算法原理以及评价指标。这为进一步的实战应用奠定了坚实的理论基础。在接下来的章节中,我们将深入实战项目,通过真实案例分析来掌握如何应用这些理论知识。

# 3. 实战项目准备与数据预处理

在进行关联规则挖掘的实战项目之前,进行充分的准备与数据预处理是至关重要的。这能够帮助我们确保后续分析的准确性和有效性,同时也是数据分析流程中的关键步骤。本章将详细介绍如何选择实战项目和数据集,以及如何进行数据清洗、转换和探索性分析。

## 3.1 实战项目选择与数据集准备

### 3.1.1 项目背景与目标

在选择一个关联规则挖掘的实战项目时,我们首先需要明确项目的背景和目标。这不仅能够帮助我们理解数据可能展现的模式,还能够让我们更明确地设定挖掘任务的目标。项目背景可能包括商业目标、市场研究、产品改进等,而项目目标可能是识别顾客购买行为模式、优化存货、提升销售策略等。

### 3.1.2 数据集的获取与选择标准

数据集的获取需要根据项目目标和背景进行。可以通过公开数据集、企业内部数据库或者通过网络爬虫等方式获取数据。选择数据集时应考虑以下标准:

- **相关性**:数据集必须与项目目标紧密相关,能够反映关键的业务问题。

- **完整性**:数据集应尽可能全面,包含多个相关的属性,以便从中挖掘出有价值的规则。

- **可获取性**:数据的获取需要在合法合规的前提下进行,同时要考虑到数据的质量和一致性。

- **大小**:数据集的大小应该适中,过大则可能需要更多的计算资源和时间,过小则可能无法挖掘到有价值的信息。

## 3.2 数据清洗与转换

### 3.2.1 缺失值与异常值处理

在对数据进行分析之前,必须处理缺失值和异常值。缺失值可能是因为数据收集不完全或者记录错误造成的。异常值则可能是数据录入错误或者实际中的极端情况。

- **缺失值处理**:对于缺失值,可以使用删除含有缺失值的记录、填充缺失值(如使用均值、中位数、众数或者通过模型预测等方式)或者使用算法自动处理。

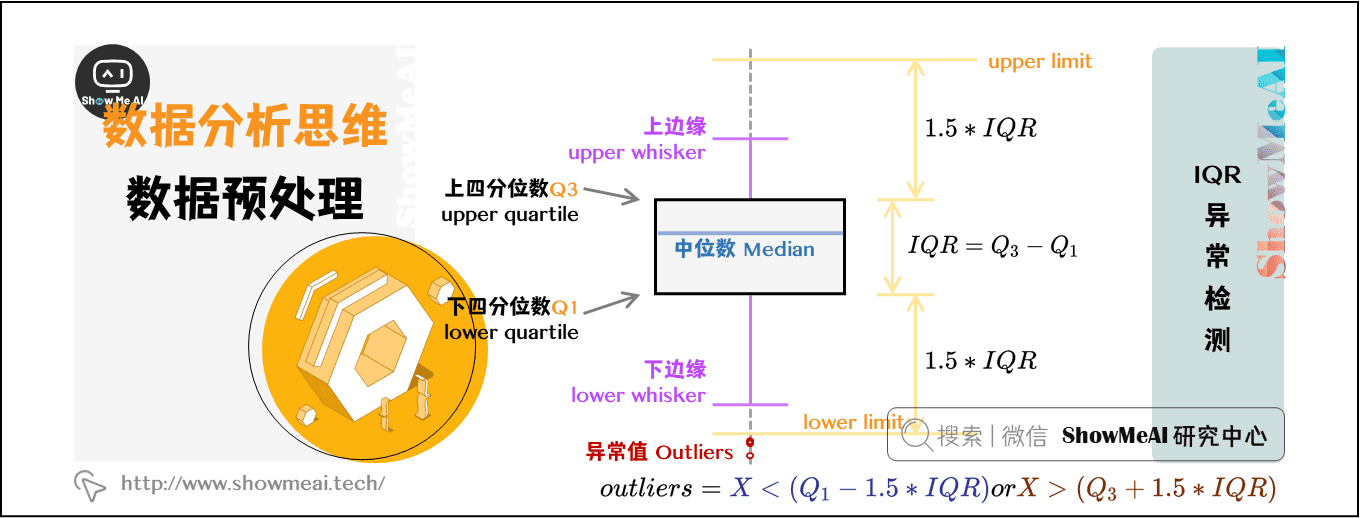

- **异常值处理**:异常值的处理方法包括删除异常值、对异常值进行变换(如对数变换、归一化处理等)、或者使用模型方法忽略异常值。

### 3.2.2 数据类型转换与编码

数据类型转换与编码是数据预处理的关键步骤。不同类型的特征可能需要不同的转换方法。

- **离散化**:将

0

0