OpenCV特征提取与机器人视觉:实战案例,探索机器人视觉技术

发布时间: 2024-08-10 22:27:10 阅读量: 54 订阅数: 28

机器人视觉系统:技术原理与实践应用

# 1. OpenCV简介和图像处理基础

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉库,提供广泛的图像处理和计算机视觉算法。它广泛用于各种应用,包括机器人视觉、医疗成像和自动驾驶。

图像处理是计算机视觉的基础,涉及对图像进行各种操作,以增强其质量或提取有用信息。常见的图像处理操作包括:

- 图像增强:调整图像的对比度、亮度和饱和度,以提高其可视性。

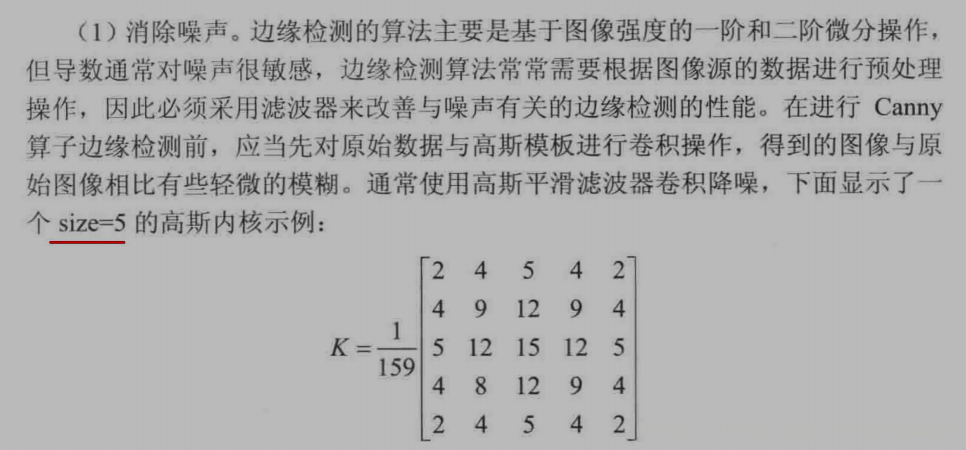

- 图像滤波:使用卷积核或其他滤波器平滑图像、锐化图像或去除噪声。

- 图像分割:将图像分割成不同的区域或对象,以便进一步分析。

# 2. 图像特征提取理论与算法

### 2.1 图像特征的类型和应用

图像特征是描述图像中显著信息的关键元素,用于识别、匹配和分类图像。图像特征可以分为以下几类:

- **全局特征:**描述整个图像的特征,如直方图、颜色矩和纹理特征。

- **局部特征:**描述图像局部区域的特征,如关键点、边缘和角点。

- **形状特征:**描述图像形状的特征,如轮廓、凸包和形状描述符。

图像特征在计算机视觉和机器人视觉中有着广泛的应用,包括:

- **目标检测:**识别图像中的特定对象。

- **目标跟踪:**跟踪图像序列中的移动对象。

- **图像分类:**将图像归类到不同的类别。

- **图像检索:**从图像数据库中查找相似的图像。

### 2.2 特征提取算法:SIFT、SURF、ORB

**SIFT(尺度不变特征变换)**是一种局部特征提取算法,用于检测和描述图像中的关键点。SIFT算法通过以下步骤提取特征:

- 1. 检测图像中的关键点,即图像中显著变化的点。

- 2. 计算关键点周围的梯度方向和幅度。

- 3. 将梯度方向和幅度信息转换为一个描述符向量。

- 4. 对描述符向量进行归一化和降维。

**SURF(加速稳健特征)**是一种与SIFT类似的局部特征提取算法,但计算速度更快。SURF算法使用Hessian矩阵来检测关键点,并使用Haar小波来计算梯度方向和幅度。

**ORB(定向快速二进制模式)**是一种快速高效的局部特征提取算法,用于移动机器人和实时应用。ORB算法使用二进制模式来描述关键点周围的像素,并通过哈明距离进行匹配。

### 2.3 特征匹配算法:FLANN、Brute-Force

特征匹配算法用于比较和匹配不同图像中的特征。常见的特征匹配算法包括:

**FLANN(快速近似最近邻)**是一种快速高效的特征匹配算法,使用近似最近邻搜索来匹配特征。FLANN算法使用KD树或其他数据结构来加速搜索过程。

**Brute-Force**是一种简单的特征匹配算法,通过逐个比较所有特征来匹配特征。Brute-Force算法计算量大,但对于小规模特征集来说效率较高。

**代码块:**

```python

import cv2

import numpy as np

# SIFT特征提取

sift = cv2.SIFT_create()

keypoints, descriptors = sift.detectAndCompute(image, None)

# SURF特征提取

surf = cv2.SURF_create()

keypoints, descriptors = surf.detectAndCompute(image, None)

# ORB特征提取

orb = cv2.ORB_create()

keypoints, descriptors = orb.detectAndCompute(image, None)

# FLANN特征匹配

flann = cv2.FlannBasedMatcher()

matches = flann.knnMatch(descriptors1, descriptors2, k=2)

# Brute-Force特征匹配

bf = cv2.BFMatcher()

matches = bf.knnMatch(descriptors1, descriptors2, k=2)

```

**逻辑分析:**

上述代码展示了如何使用SIFT、SURF和ORB算法提取图像特征,以及如何使用FLANN和Brute-Force算法进行特征匹配。

**参数说明:**

- `image`:输入图像。

- `keypoints`:检测到的关键点。

- `descriptors`:关键点的描述符。

- `descriptors1`和`descriptors2`:要匹配的两个描述符集。

- `k`:返回的匹配数。

# 3.1 机器人视觉系统的组成和功能

### 机器人视觉系统的组成

机器人视觉系统通常由以下主要组件组成:

- **视觉传感器:**负责采集图像或视频数据,包括摄像头、激光雷达、深度传感器等。

- **图像处理单元:**对采集的图像或视频数据进行预处理、增强和分析,提取有价值的信息。

- **特征提取模块:**从图像或视频数据中提取特征,这些特征可以描述对象的形状、纹理、颜色等属性。

- **匹配和识别模块:**将提取的特征与已知的模型或数据库进行匹配,识别对象或场景。

- **决策模块:**基于识别结果,做出决策或采取行动,例如导航、避障、抓取物体等。

### 机器人视觉系统的功能

机器人视觉系统的主要功能包括:

- **环境感知:**感知周围环境,识别物体、障碍物、边界等。

- **目标检测和跟踪:**检测和跟踪感兴趣的目标,例如特定物体或人员。

- **导航和定位:**通过识别地标或环境特征,帮助机器人进行导航和定位。

- **抓取和操作:**引导机器人抓取和操作物体,实现精确的抓取和放置。

- **质量检测和分类:**通过图像分析,检测产品缺陷或对物体进行分类。

## 3.2 视觉传感器选择和安装

### 视觉传感器选择

视觉传感器的选择取决于机器人视觉系统的具体应用和要求。常见的视觉传感器类型包括:

| 传感器类型 | 优点 |

0

0