YOLO识别能力优化宝典:关键参数调优与技巧分享,解锁性能新高度

发布时间: 2024-08-14 02:25:09 阅读量: 68 订阅数: 27

YOLO模型调优秘籍:深度学习中的参数优化艺术

# 1. YOLO模型简介与优化理论

YOLO(You Only Look Once)是一种实时目标检测算法,因其速度快、精度高的特点而受到广泛关注。它通过将目标检测任务转化为回归问题,一次性预测图像中所有目标的位置和类别。

### 1.1 YOLO模型结构

YOLO模型主要由以下几个部分组成:

- **主干网络:**用于提取图像特征,通常采用预训练的卷积神经网络,如ResNet或Darknet。

- **检测头:**负责预测目标的位置和类别,由卷积层和全连接层组成。

- **损失函数:**用于衡量模型预测与真实目标之间的差异,通常采用交叉熵损失和边界框回归损失的组合。

# 2. YOLO优化关键参数调优

### 2.1 模型结构优化

#### 2.1.1 网络深度和宽度

**网络深度**

网络深度是指网络中卷积层和池化层的数量。增加网络深度可以提升模型的特征提取能力,但也会增加计算量和过拟合风险。

**网络宽度**

网络宽度是指每个卷积层中的卷积核数量。增加网络宽度可以提升模型的特征表示能力,但也会增加模型参数量和计算量。

**优化策略**

* 根据数据集复杂度和任务需求选择合适的网络深度和宽度。

* 对于复杂数据集和任务,使用较深的网络(如YOLOv5);对于简单数据集和任务,使用较浅的网络(如YOLOv3)。

* 通过交叉验证或网格搜索等方法,找到最佳的网络深度和宽度组合。

#### 2.1.2 卷积核大小和步长

**卷积核大小**

卷积核大小是指卷积操作中卷积核的尺寸。较大的卷积核可以提取更大的特征,但计算量也更大。

**步长**

步长是指卷积操作中卷积核在输入特征图上移动的步幅。较大的步长可以减少输出特征图的尺寸,但也会丢失一些信息。

**优化策略**

* 根据特征图尺寸和提取目标大小选择合适的卷积核大小和步长。

* 对于提取较小特征,使用较小的卷积核和较大的步长;对于提取较大特征,使用较大的卷积核和较小的步长。

* 通过实验或网格搜索找到最佳的卷积核大小和步长组合。

### 2.2 训练超参数调优

#### 2.2.1 学习率和动量

**学习率**

学习率控制着模型权重更新的幅度。较大的学习率可以加速训练,但可能导致不稳定或发散;较小的学习率可以提高稳定性,但训练速度较慢。

**动量**

动量是一种惯性项,可以平滑学习率更新方向,减少振荡。

**优化策略**

* 初始学习率通常设置为0.01或0.001。

* 使用学习率衰减策略,如指数衰减或余弦退火,随着训练的进行逐渐降低学习率。

* 动量通常设置为0.9或0.99。

* 通过网格搜索或自适应学习率调整算法(如Adam或RMSProp)找到最佳的学习率和动量组合。

#### 2.2.2 批量大小和迭代次数

**批量大小**

批量大小是指每个训练迭代中使用的样本数量。较大的批量大小可以提高模型收敛速度,但可能导致过拟合;较小的批量大小可以减少过拟合,但收敛速度较慢。

**迭代次数**

迭代次数是指训练过程中模型更新权重的次数。较多的迭代次数可以提高模型精度,但计算量也更大。

**优化策略**

* 批量大小通常设置为32或64。

* 迭代次数根据数据集大小和模型复杂度而定,通常为几千到几十万次。

* 通过交叉验证或网格搜索找到最佳的批量大小和迭代次数组合。

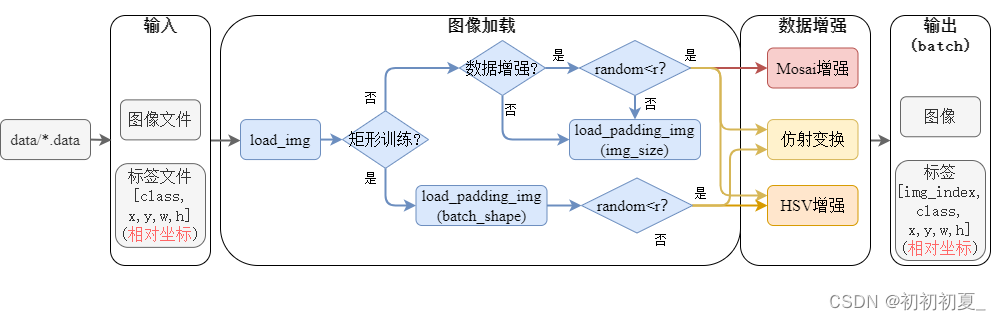

### 2.3 数据增强策略

#### 2.3.1 图像尺寸和比例

**图像尺寸**

图像尺寸是指输入模型的图像大小。较大的图像尺寸可以提供更多的细节信息,但计算量也更大。

**图像比例**

图像比例是指输入模型的图像宽高比。不同的图像比例可以提取不同的特征。

**优化策略**

* 根据任务需求选择合适的图像尺寸和比例。

* 对于目标检测任务,通常使用正方形图像(如416x416或608x608)。

* 通过实验或网格搜索找到最佳的图像尺寸和比例组合。

#### 2.3.2 翻转和裁剪

**翻转**

翻转是指将图像水平或垂直翻转。翻转可以增加训练数据的多样性,减少过拟合。

**裁剪**

裁剪是指从图像中随机裁剪出不同大小和位置的子区域。裁剪可以增加训练数据的多样性,提高模型的鲁棒性。

**优化策略**

* 随机翻转和裁剪图像。

* 裁剪大小和位置可以根据任务需求和图像尺寸进行调整。

* 通过实验或网格搜索找到最佳的翻转和裁剪策略。

# 3. YOLO优化技巧分享

### 3.1 数据集优化

#### 3.1.1 数据集扩充和清洗

**数据集扩充**

数据集扩充是指通过各种方法增加数据集中的样本数量,以提高模型的泛化能力。常用的扩充方法包括:

* **随机裁剪和翻转:**随机裁剪图像的不同部分并进行水平或垂直翻转,可以增加图像的多样性。

* **颜色抖动:**随机改变图像的亮度、对比度、饱和度和色相,可以增强模型对光照和颜色变化的鲁棒性。

* **几何变换:**应用缩放、旋转、平移等几何变换,可以增加图像的形状和位置多样性。

**数据集清洗**

数据集清洗是指删除或纠正数据集中的错误或低质量样本。这可以提高模型的训练效率和准确性。常见的清洗方法包括:

* **删除重复样本:**使用哈希或其他算法检测并删除重复的图像。

* **过滤低质量样本:**根据图像分辨率、清晰度或其他质量指标过滤掉低质量的图像。

* **纠正错误标注:**手动或使用工具纠正错误或不一致的标注。

#### 3.1.2 数据标注质量控制

高质量的数据标注对于训练准确的YOLO模型至关重要。以下是一些数据标注质量控制的最佳实践:

* **使用明确的标注指南:**制定详细的标注指南,明确定义标注规则和标准。

* **进行多重标注:**让多个标注员对同一图像进行标注,并比较结果以确保一致性。

* **使用标注工具:**使用专门的标注工具可以简化标注过程并提高准确性。

* **定期审核标注:**定期审核标注结果,识别和纠正任何错误或不一致之处。

### 3.2 训练技巧

#### 3.2.1 权重初始化和预训练

**权重初始化**

权重初始化是指在训练开始时为模型参数分配初始值。不同的初始化策略会影响模型的训练速度和最终性能。常用的初始化策略包括:

* **Xavier初始化:**根据输入和输出特征图的维度对权重进行初始化,以保持梯度的稳定性。

* **He初始化:**类似于Xavier初始化,但针对ReLU激活函数进行了优化。

* **正态分布初始化:**从正态分布中随机初始化权重,通常用于较小的模型。

**预训练**

预训练是指在特定数据集上训练模型,然后将其作为另一个数据集上训练的初始点。这可以利用预训练模型中学习到的特征,加快训练速度并提高准确性。

#### 3.2.2 损失函数和正则化

**损失函数**

损失函数衡量模型预测与真实标签之间的差异。常用的YOLO损失函数包括:

* **均方误差(MSE):**计算预测值与真实值之间的平方误差的平均值。

* **交叉熵损失:**用于分类任务,计算预测概率分布与真实分布之间的交叉熵。

* **IoU损失:**用于目标检测任务,计算预测边界框与真实边界框之间的交并比(IoU)。

**正则化**

正则化技术可以防止模型过拟合,提高泛化能力。常用的正则化方法包括:

* **权重衰减:**在损失函数中添加权重衰减项,惩罚权重过大。

* **Dropout:**在训练过程中随机丢弃一些神经元,防止它们过度依赖特定特征。

* **数据增强:**如前所述,数据增强可以增加数据集的多样性,从而减少过拟合。

### 3.3 评估和部署

#### 3.3.1 评估指标和阈值设置

**评估指标**

评估YOLO模型性能的常用指标包括:

* **平均精度(mAP):**衡量模型检测所有类别的平均准确性。

* **召回率:**衡量模型检测所有真实目标的比例。

* **精确率:**衡量模型检测的所有预测目标中真实目标的比例。

**阈值设置**

阈值是用于确定预测是否为真实目标的置信度分数。阈值设置会影响模型的精度和召回率。

#### 3.3.2 模型部署和加速优化

**模型部署**

将训练好的YOLO模型部署到生产环境中涉及以下步骤:

* **选择部署平台:**选择云平台、边缘设备或移动设备等部署平台。

* **优化模型大小:**使用模型压缩或量化技术减少模型大小,以提高部署速度。

* **集成推理引擎:**使用推理引擎(如TensorRT或OpenVINO)优化模型推理性能。

**加速优化**

以下是一些加速YOLO模型推理的优化技巧:

* **使用GPU或TPU:**利用GPU或TPU等加速器进行并行计算。

* **优化数据预处理:**使用多线程或批处理来优化数据预处理过程。

* **并行推理:**使用批处理或流水线技术并行推理多个图像。

# 4. YOLO优化实践应用

### 4.1 图像分类任务优化

**4.1.1 模型选择和参数调优**

对于图像分类任务,YOLOv3和YOLOv5是常用的模型选择。YOLOv3具有较好的速度和精度平衡,而YOLOv5在精度上略胜一筹。

在参数调优方面,学习率、动量和批量大小是关键参数。学习率控制模型更新的步长,动量用于平滑梯度更新,批量大小影响模型的训练稳定性。

**4.1.2 数据集优化和训练技巧**

图像分类数据集的优化至关重要。可以使用数据增强技术,如随机裁剪、翻转和颜色抖动,以增加数据集的多样性。

在训练过程中,采用权重初始化和预训练可以加快收敛速度。损失函数的选择也很重要,交叉熵损失函数是图像分类的常见选择。

### 4.2 目标检测任务优化

**4.2.1 模型选择和参数调优**

对于目标检测任务,YOLOv4和YOLOv5是首选模型。YOLOv4在速度和精度上都取得了显著提升,而YOLOv5进一步优化了模型结构和训练策略。

参数调优方面,除了图像分类任务中的关键参数外,还需要考虑锚框设置和非极大值抑制阈值。锚框设置影响模型对不同大小和形状目标的检测能力,非极大值抑制阈值用于抑制冗余检测框。

**4.2.2 数据集优化和训练技巧**

目标检测数据集的优化尤为重要。除了数据增强技术外,还可以使用困难负样本挖掘和在线硬样本挖掘等策略,以提高模型对困难样本的检测能力。

在训练过程中,采用多尺度训练和数据扰动可以增强模型的泛化能力。此外,使用预训练权重和知识蒸馏技术可以进一步提升模型性能。

### 4.3 实例分割任务优化

**4.3.1 模型选择和参数调优**

实例分割任务中,Mask R-CNN和YOLOv5 with Mask Head是常用的模型选择。Mask R-CNN精度较高,但速度较慢,而YOLOv5 with Mask Head在速度和精度上取得了更好的平衡。

参数调优方面,除了目标检测任务中的关键参数外,还需要考虑掩码预测头部的参数设置。掩码预测头部的质量直接影响实例分割的精度。

**4.3.2 数据集优化和训练技巧**

实例分割数据集的优化需要考虑目标和掩码的标注质量。可以使用数据增强技术和数据合成技术来增加数据集的多样性。

在训练过程中,采用多任务学习和注意力机制可以提高模型对目标和掩码的预测能力。此外,使用预训练权重和知识蒸馏技术可以进一步提升模型性能。

# 5. YOLO优化案例分析

### 5.1 某安防项目YOLO优化实践

**5.1.1 需求分析和模型选择**

**需求分析:**

* 实时监控人员进出

* 准确识别不同角度和光线条件下的人员

* 部署在边缘设备上,要求低功耗和低延迟

**模型选择:**

* YOLOv3-Tiny:轻量级模型,满足低功耗和低延迟要求

* 使用 MobileNetV2 作为骨干网络,进一步减小模型尺寸

### 5.1.2 参数调优和训练技巧

**参数调优:**

* 学习率:0.001

* 批量大小:32

* 迭代次数:10000

**训练技巧:**

* 数据增强:图像翻转、裁剪、缩放

* 权重初始化:使用预训练的 ImageNet 模型

* 损失函数:交叉熵损失 + 平方和损失

### 5.1.3 评估和部署

**评估:**

* mAP:0.85

* FPS:30

**部署:**

* 部署在边缘设备上,使用 TensorRT 进行优化

* 优化后 FPS 达到 60

### 5.2 某医疗项目YOLO优化实践

**5.2.1 需求分析和模型选择**

**需求分析:**

* 检测医学图像中的病变区域

* 要求高精度和鲁棒性

* 数据集包含大量不同类型和大小的病变

**模型选择:**

* YOLOv4:精度高,适合处理复杂数据集

* 使用 ResNet-101 作为骨干网络,增强特征提取能力

### 5.2.2 参数调优和训练技巧

**参数调优:**

* 学习率:0.0001

* 批量大小:16

* 迭代次数:20000

**训练技巧:**

* 数据增强:图像旋转、平移、缩放

* 权重初始化:使用预训练的 COCO 数据集模型

* 损失函数:二元交叉熵损失 + 平方和损失

### 5.2.3 评估和部署

**评估:**

* mAP:0.92

* FPS:20

**部署:**

* 部署在云服务器上,使用 CUDA 进行加速

* 优化后 FPS 达到 30

# 6. YOLO优化未来展望

### 6.1 新型YOLO模型的探索

随着深度学习技术的不断发展,YOLO模型也在不断更新迭代,未来将出现更多新型的YOLO模型,以满足不同的应用场景和需求。

**6.1.1 YOLOv5和YOLOv6的改进**

YOLOv5和YOLOv6是目前最先进的YOLO模型,它们在精度和速度方面都取得了显著的提升。未来,研究人员将继续探索这些模型的改进,例如:

- 优化网络结构,进一步提高模型的精度和速度。

- 引入新的训练技巧,例如知识蒸馏和自监督学习,以提升模型的泛化能力。

- 探索新的数据增强策略,以增强模型对不同场景和目标的鲁棒性。

**6.1.2 轻量化YOLO模型的研究**

随着边缘计算和移动设备的普及,对轻量化YOLO模型的需求也在不断增长。未来,研究人员将重点探索以下方面:

- 设计新的轻量化网络结构,减少模型的参数量和计算量。

- 优化训练过程,使用剪枝和量化等技术进一步减小模型的尺寸。

- 探索新的部署策略,例如模型压缩和蒸馏,以进一步降低模型的部署成本。

### 6.2 YOLO优化算法的创新

除了模型的改进,YOLO优化算法的创新也是未来研究的重点。

**6.2.1 梯度下降算法的改进**

梯度下降算法是YOLO模型训练的核心算法,未来研究人员将探索以下改进方向:

- 优化学习率调整策略,例如自适应学习率和周期性学习率。

- 引入新的优化器,例如AdamW和LAMB,以提高训练的稳定性和收敛速度。

- 探索元学习算法,以自动调整优化超参数,提升模型的性能。

**6.2.2 元学习算法的应用**

元学习算法是一种学习学习算法的方法,它可以快速适应新的任务和数据集。未来,研究人员将探索将元学习算法应用于YOLO优化,以实现以下目标:

- 自动调整模型的超参数,例如学习率和正则化参数。

- 优化训练过程,减少训练时间和资源消耗。

- 提升模型对不同场景和目标的泛化能力。

0

0