【大数据处理】:Java字符串到数组转换技巧,加速数据处理

发布时间: 2024-09-22 19:31:26 阅读量: 112 订阅数: 37

# 1. 大数据处理中的Java字符串到数组转换基础

## 1.1 字符串与数组转换的重要性

在大数据处理的背景下,数据经常以字符串形式存储,但很多算法和数据结构操作则需要数组。Java作为一种常用的编程语言,提供了丰富的字符串与数组之间的转换方法。掌握这些方法对于提高数据处理效率至关重要。

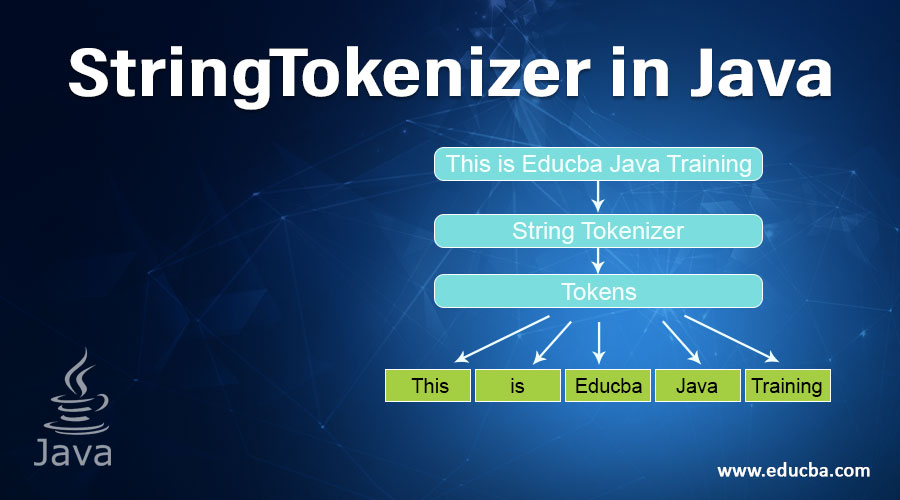

## 1.2 转换的基本概念

字符串到数组的转换通常涉及到将字符串中的字符分割或提取到一个新的数组中,而数组到字符串的转换则可能是将数组元素拼接回字符串形式。这些操作在数据处理、算法实现等方面有着广泛的应用。

## 1.3 常见应用场景

例如,在处理日志文件时,将一行行的文本日志转换为数组方便后续的分析处理;在文件系统中,将文件名的字符串分解成目录和文件名的部分;在数据库操作中,将字符串形式的查询结果转换为数组以便程序逻辑处理。

通过本章的介绍,我们为理解后续章节中的字符串与数组转换技术及其优化打下基础。接下来,我们将深入探讨字符串和数组在Java中的数据结构特性。

# 2. 理论探讨:字符串与数组的数据结构

### 2.1 字符串的数据结构和特性

#### 2.1.1 Java中的String类

在Java中,字符串是由String类表示的。String类是一个不可变的对象,即一旦创建,其内容无法改变。这意味着每次对字符串进行修改的操作,如拼接、替换等,实际上都是创建了一个新的String对象,而原对象保持不变。

String类内部是通过字符数组实现的,但这种表示对于开发者来说是透明的。String类提供了多种方法来处理字符串,包括但不限于比较、连接、裁剪、替换和分割等。这些方法是面向对象设计的典范,通过方法调用,可以以一种易于理解和维护的方式操作字符串。

当涉及到大数据处理时,字符串类的不可变性可以带来性能上的问题,因为每次修改操作都会产生新的字符串对象。在大数据场景下,频繁的字符串操作可能导致大量的内存分配和垃圾回收活动,从而影响性能。

```java

// 示例代码:创建字符串和基本操作

String str = "Hello World!";

String newStr = str.replace('l', 'r');

System.out.println(str); // 输出 "Hello World!"

System.out.println(newStr); // 输出 "Hero Worrd!"

```

#### 2.1.2 字符串的存储机制

Java虚拟机(JVM)采用两种主要的方式存储字符串:字符串常量池和堆内存。

- 字符串常量池:JVM维护一个特殊的内存区域,用于存储字符串常量。当创建一个字符串常量时,JVM首先检查字符串常量池中是否存在相同的字符串对象,如果存在,则返回引用,否则在常量池中创建新的对象,并返回引用。这称为字符串驻留(interning)。

- 堆内存:非常量字符串或字符串变量的实例则存储在堆内存中。在堆中创建的字符串对象是通过new关键字显式分配的,不经过字符串常量池的检查。

```java

// 示例代码:字符串常量池与堆内存的区别

String str1 = "Hello";

String str2 = "Hello";

String str3 = new String("Hello");

System.out.println(str1 == str2); // true,因为str1和str2指向常量池中的同一个对象

System.out.println(str1 == str3); // false,因为str3指向堆内存中一个新创建的对象

```

### 2.2 数组的数据结构和特性

#### 2.2.1 数组的基本概念和用途

数组是存储固定大小且类型相同的数据集合的线性数据结构。数组中每个元素都可以通过索引来访问,索引通常从0开始。数组的大小在创建时必须指定,并且在整个生命周期内保持不变。

数组在Java中是对象,存储在堆内存中,其长度一旦确定便不能更改。数组的索引访问非常快速,因为它们直接映射到内存地址,访问时间复杂度为O(1)。这些特性使得数组非常适合用于快速且固定大小的数据访问场景。

在大数据处理中,数组可以用于存储大量数据,并且因为数组的访问效率,可以实现快速的数据处理和转换操作。

```java

// 示例代码:数组的创建和访问

int[] numbers = new int[5]; // 创建一个长度为5的整型数组

numbers[0] = 1;

numbers[1] = 2;

// ... 初始化其他元素

System.out.println(numbers[0]); // 输出数组第一个元素的值,即1

```

#### 2.2.2 多维数组的特点和使用

多维数组可以看作是数组的数组,即数组中的元素本身也是数组。最常见的多维数组是二维数组,可以理解为一个表格或矩阵。

在Java中,多维数组的每个维度可以有不同的长度,但是数组的初始化必须遵循声明时的维度。多维数组的访问同样非常高效,因为它本质上是一系列内存地址的连续存储。但是,多维数组的索引访问时间会随着维度的增加而增加。

在处理多维数据集时,比如图像处理或者表格数据分析,多维数组提供了一种自然的数据结构。例如,在进行大数据分析时,二维数组可以用来存储和处理矩阵形式的数据集。

```java

// 示例代码:二维数组的创建和访问

int[][] matrix = new int[3][4];

matrix[0][0] = 1;

// ... 初始化其他元素

System.out.println(matrix[0][0]); // 输出二维数组第一个元素的值,即1

```

### 2.3 字符串和数组的转换关系

#### 2.3.1 转换的必要性和应用场景

在很多情况下,需要将字符串转换为数组,或者相反。这主要是因为字符串和数组在某些场景下有各自的优势。

将字符串转换为数组在进行数据解析和分割时特别有用,例如处理CSV或JSON格式的数据。数组允许程序以一种更为灵活和高效的方式处理各个独立的数据项,可以对数组元素进行快速访问和操作。

而将数组转换为字符串在输出或存储数据时非常有用。比如,当你需要将一组数据打包成一个字符串进行网络传输或者保存到文件中,使用数组到字符串的转换就显得十分便利。

```java

// 示例代码:字符串转换为数组和数组转换为字符串

String str = "Hello,World!";

String[] strArray = str.split(","); // 将字符串按逗号分割成字符串数组

System.out.println(Arrays.toString(strArray)); // 输出转换后的字符串数组

String combined = String.join(",", strArray); // 将字符串数组元素连接成一个字符串

System.out.println(combined); // 输出 "Hello,World!"

```

#### 2.3.2 转换过程中的常见问题

在字符串与数组之间的转换过程中,一个常见问题是编码不一致导致的数据不匹配。例如,当字符串使用UTF-8编码,而在转换为数组时使用ASCII编码,会导致非ASCII字符丢失或错误。

此外,对于包含特殊分隔符或复杂结构的字符串,简单的split方法可能无法正确分割,需要更复杂的解析策略。这通常涉及到正则表达式,它允许更精确的字符串分析和转换。

在大数据处理中,错误的数据格式或不一致的数据编码可能引起大规模的数据错误,导致分析结果不准确或程序崩溃。因此,在转换过程中采取适当的检查和验证措施是必要的。

```java

// 示例代码:处理字符串编码和特殊分隔

```

0

0