【MySQL查询语句优化秘籍】:揭秘从解析到优化的执行机制

发布时间: 2024-07-26 17:56:55 阅读量: 34 订阅数: 39

java+sql server项目之科帮网计算机配件报价系统源代码.zip

# 1. MySQL查询语句优化概述**

MySQL查询语句优化是提高数据库性能的关键技术,通过对查询语句进行分析和优化,可以显著提升查询效率。优化查询语句可以从以下几个方面入手:

* 索引优化:创建和使用适当的索引可以极大地提高查询速度。

* 表结构优化:优化表结构可以减少数据冗余,提高查询效率。

* 查询语句重写:通过重写查询语句,可以优化查询条件,提高查询效率。

* 查询缓存利用:利用查询缓存可以避免重复执行相同的查询语句,提高查询效率。

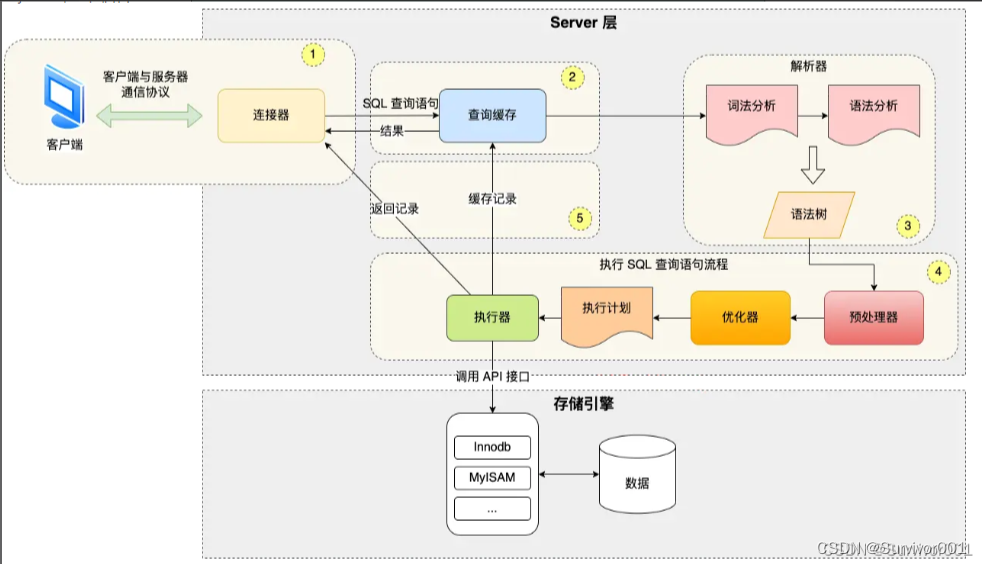

# 2. MySQL查询语句执行机制

### 2.1 查询语句的解析过程

当客户端向MySQL服务器发送一条查询语句时,服务器会对该语句进行解析,将语句转换为内部数据结构,以便后续执行。解析过程主要包括以下步骤:

- **词法分析:**将查询语句分解为一个个的单词(token),并识别出关键字、标识符、操作符等。

- **语法分析:**根据词法分析的结果,构建语法树,验证查询语句的语法是否正确。

- **语义分析:**检查语法树中的元素是否语义上正确,例如,表名和列名是否存在,数据类型是否匹配。

### 2.2 查询计划的生成和优化

解析完成后,MySQL服务器会生成一个查询计划,描述如何执行查询语句。查询计划的生成过程主要包括以下步骤:

- **选择访问路径:**根据查询语句中指定的表和条件,选择最优的访问路径,例如,使用索引扫描或全表扫描。

- **确定连接顺序:**确定表之间的连接顺序,以最小化数据读取量。

- **优化器优化:**使用基于成本的优化器对查询计划进行优化,例如,使用索引、重写查询语句等。

### 2.3 查询执行的具体流程

查询计划生成完成后,MySQL服务器会根据查询计划执行查询语句。执行过程主要包括以下步骤:

- **打开表:**打开查询语句中涉及的表,并获取表锁。

- **读取数据:**根据访问路径读取数据,例如,使用索引扫描或全表扫描。

- **连接数据:**根据查询计划连接来自不同表的查询结果。

- **过滤数据:**根据查询语句中的条件过滤数据。

- **排序数据:**根据查询语句中的排序条件对数据进行排序。

- **返回结果:**将查询结果返回给客户端。

```mermaid

sequenceDiagram

participant Client

participant MySQL Server

Client->>MySQL Server: Send query statement

MySQL Server->>Client: Parse query statement

MySQL Server->>Client: Generate query plan

MySQL Server->>Client: Optimize query plan

MySQL Server->>Client: Execute query plan

MySQL Server->>Client: Return query result

```

**代码块逻辑分析:**

该代码块展示了MySQL查询语句执行的具体流程。流程图中的每个步骤都对应着执行过程中的一个阶段,例如,打开表、读取数据、连接数据等。

**参数说明:**

- **Client:**发送查询语句的客户端。

- **MySQL Server:**执行查询语句的MySQL服务器。

# 3.1 索引的创建和使用

#### 3.1.1 索引的类型和选择

索引是存储在数据库中的数据结构,用于快速查找和检索数据。MySQL支持多种类型的索引,每种类型都有其自身的优缺点。

- **B-Tree 索引:**B-Tree 索引是一种平衡树结构,它将数据按顺序存储在叶子节点中。B-Tree 索引具有快速查找和范围查询的能力,是 MySQL 中最常用的索引类型。

- **Hash 索引:**Hash 索引使用哈希函数将数据映射到哈希表中。Hash 索引具有快速查找单个值的优点,但不能用于范围查询。

- **全文索引:**全文索引用于在文本列中搜索关键字。全文索引可以快速查找包含特定关键字的行,常用于搜索引擎和文本处理应用程序。

索引的选择取决于表的结构、查询模式和性能要求。一般来说,对于经常进行范围查询或排序的列,使用 B-Tree 索引;对于经常进行精确匹配查询的列,使用 Hash 索引;对于需要在文本列中搜索关键字的列,使用全文索引。

#### 3.1.2 索引的使用技巧

使用索引时,应注意以下技巧:

- **选择合适的列:**为经常参与查询条件或排序的列创建索引。

- **创建复合索引:**对于经常同时使用多个列进行查询的场景,创建复合索引可以提高性能。

- **避免创建不必要的索引:**不必要的索引会占用存储空间并降低查询性能。只有在确实需要时才创建索引。

- **维护索引:**随着数据更新,索引需要定期维护以保持其有效性。MySQL 提供了 `OPTIMIZE TABLE` 命令来维护索引。

### 3.2 表结构的优化

#### 3.2.1 表结构设计原则

表结构设计对查询性能有很大影响。遵循以下原则可以优化表结构:

- **使用合适的字段类型:**选择与数据类型相匹配的字段类型,例如使用 `INT` 存储整数,使用 `VARCHAR` 存储可变长度字符串。

- **避免使用 `NULL` 值:**`NULL` 值会降低查询性能,应尽可能使用默认值或非空约束。

- **规范化数据:**将数据分解到多个表中,以避免冗余和数据不一致。

- **使用外键约束:**使用外键约束来维护表之间的关系,确保数据完整性和查询性能。

#### 3.2.2 表结构调整的注意事项

在某些情况下,需要调整表结构以优化查询性能。以下是一些注意事项:

- **拆分大表:**如果表变得太大,可以将其拆分成多个较小的表。

- **添加或删除列:**根据查询模式,添加或删除列可以提高性能。

- **更改字段类型:**在某些情况下,更改字段类型可以优化查询性能,例如将 `VARCHAR` 更改为 `ENUM`。

- **使用分区:**分区可以将表中的数据分成更小的块,从而提高查询性能。

# 4. MySQL查询语句高级优化

### 4.1 查询语句的重写

#### 4.1.1 查询语句的拆分和组合

查询语句的拆分和组合是一种优化查询性能的有效方法。通过将一个复杂的查询语句拆分成多个简单的查询语句,可以减少数据库的计算量,从而提高查询效率。

**拆分查询语句的原则:**

- 将查询语句中的不同操作(如查询、更新、删除)拆分成独立的语句。

- 将查询语句中的不同表拆分成独立的语句。

- 将查询语句中的不同条件拆分成独立的语句。

**组合查询语句的原则:**

- 将拆分的查询语句重新组合成一个新的查询语句。

- 使用 UNION、UNION ALL、INTERSECT 或 EXCEPT 等操作符将拆分的查询语句组合起来。

**示例:**

```sql

SELECT * FROM table1 WHERE id IN (SELECT id FROM table2 WHERE name = 'John');

```

这个查询语句可以拆分成两个独立的查询语句:

```sql

SELECT id FROM table2 WHERE name = 'John';

SELECT * FROM table1 WHERE id IN (SELECT id FROM table2 WHERE name = 'John');

```

然后,这两个查询语句可以重新组合成一个新的查询语句:

```sql

SELECT * FROM table1 WHERE id IN (SELECT id FROM table2 WHERE name = 'John') UNION SELECT * FROM table1 WHERE id NOT IN (SELECT id FROM table2 WHERE name = 'John');

```

通过拆分和组合查询语句,可以减少数据库的计算量,从而提高查询效率。

#### 4.1.2 查询语句的条件优化

查询语句的条件优化是指对查询语句中的条件进行优化,以提高查询效率。常用的条件优化方法包括:

- **使用索引:**为查询语句中涉及的字段创建索引,可以显著提高查询效率。

- **使用等值条件:**使用等值条件(=、<>)代替范围条件(>、<、>=、<=),可以提高查询效率。

- **使用 OR 条件:**将多个 OR 条件拆分成多个独立的查询语句,然后使用 UNION 或 UNION ALL 操作符组合起来,可以提高查询效率。

- **使用 NOT IN 条件:**将 NOT IN 条件拆分成一个子查询,然后使用 NOT EXISTS 操作符组合起来,可以提高查询效率。

**示例:**

```sql

SELECT * FROM table1 WHERE name = 'John' OR name = 'Mary';

```

这个查询语句可以优化为:

```sql

SELECT * FROM table1 WHERE name = 'John' UNION SELECT * FROM table1 WHERE name = 'Mary';

```

通过对查询语句中的条件进行优化,可以提高查询效率。

### 4.2 查询缓存的利用

#### 4.2.1 查询缓存的原理和配置

查询缓存是一种将查询语句及其结果存储在内存中的机制,当相同的查询语句再次执行时,直接从缓存中读取结果,从而提高查询效率。

查询缓存的配置可以通过以下参数进行:

- **query_cache_type:**控制查询缓存是否开启,取值为 0(关闭)、1(开启)、2(只读)。

- **query_cache_size:**控制查询缓存的大小,单位为字节。

- **query_cache_limit:**控制单个查询语句的结果大小,超过这个大小的查询语句不会被缓存。

**示例:**

```

[mysqld]

query_cache_type = 1

query_cache_size = 16M

query_cache_limit = 1M

```

#### 4.2.2 查询缓存的优缺点

查询缓存的优点包括:

- 提高查询效率,减少数据库的计算量。

- 减少服务器的负载,提高系统的整体性能。

查询缓存的缺点包括:

- 可能导致数据不一致,因为缓存中的数据可能与数据库中的实际数据不一致。

- 占用内存空间,可能影响其他应用程序的性能。

- 对于复杂的查询语句,查询缓存可能无法命中,导致查询效率降低。

因此,在使用查询缓存时,需要权衡其优缺点,根据实际情况决定是否开启查询缓存。

# 5. MySQL查询语句性能监控

**5.1 慢查询日志的分析**

**5.1.1 慢查询日志的配置和使用**

慢查询日志是 MySQL 中一项重要的性能监控工具,它可以记录执行时间超过一定阈值的查询语句。通过分析慢查询日志,可以识别出执行效率低下的查询语句,并进行针对性的优化。

要启用慢查询日志,需要在 MySQL 配置文件中添加以下配置项:

```

slow_query_log = ON

slow_query_log_file = /var/log/mysql/mysql-slow.log

long_query_time = 1

```

* `slow_query_log`:启用慢查询日志。

* `slow_query_log_file`:指定慢查询日志文件路径。

* `long_query_time`:设置慢查询的执行时间阈值,单位为秒。

配置完成后,重启 MySQL 服务,慢查询日志功能即可生效。

**5.1.2 慢查询日志的分析方法**

慢查询日志文件是一个文本文件,记录了所有执行时间超过阈值的查询语句。分析慢查询日志时,可以关注以下几个关键字段:

* `Time`:查询语句的执行时间。

* `Query_time`:查询语句中 SQL 语句的执行时间。

* `Lock_time`:查询语句中锁等待时间。

* `Rows_sent`:查询语句返回的行数。

* `Rows_examined`:查询语句扫描的行数。

通过分析这些字段,可以判断查询语句的执行效率,并找出导致执行时间过长的原因。例如,如果 `Lock_time` 较高,则表明查询语句存在锁竞争问题;如果 `Rows_examined` 远大于 `Rows_sent`,则表明查询语句使用了不合适的索引。

**5.2 性能指标的监控**

除了慢查询日志之外,还可以通过监控 MySQL 的性能指标来了解数据库的运行状况。常见的性能指标包括:

* **QPS(Queries Per Second)**:每秒查询数。

* **TPS(Transactions Per Second)**:每秒事务数。

* **并发连接数**:当前连接到数据库的连接数。

* **CPU 使用率**:MySQL 进程占用的 CPU 资源百分比。

* **内存使用率**:MySQL 进程占用的内存资源百分比。

监控这些性能指标可以帮助识别数据库的性能瓶颈,并及时采取措施进行优化。

**5.2.1 常见的性能指标**

| 指标 | 描述 |

|---|---|

| QPS | 每秒处理的查询数量 |

| TPS | 每秒处理的事务数量 |

| 并发连接数 | 当前连接到数据库的连接数量 |

| CPU 使用率 | MySQL 进程占用的 CPU 资源百分比 |

| 内存使用率 | MySQL 进程占用的内存资源百分比 |

**5.2.2 性能指标的监控工具**

监控 MySQL 性能指标可以使用以下工具:

* **MySQL Enterprise Monitor**:MySQL 官方提供的商业监控工具。

* **Percona Toolkit**:开源的 MySQL 性能监控工具集。

* **Zabbix**:开源的企业级监控系统。

* **Prometheus**:开源的监控和告警系统。

# 6. MySQL查询语句优化最佳实践

### 6.1 优化原则和方法论

#### 6.1.1 查询语句优化的原则

* **最少原则:**仅查询必要的字段和行,避免不必要的资源消耗。

* **索引优先:**尽可能使用索引,以减少表扫描和数据读取量。

* **缓存利用:**利用查询缓存和表缓存,减少重复查询和数据读取。

* **查询重写:**通过拆分、组合、条件优化等方式,重写查询语句以提高效率。

* **性能监控:**定期监控查询语句的性能,及时发现和解决问题。

#### 6.1.2 查询语句优化的方法论

* **分析慢查询日志:**找出执行缓慢的查询语句,并进行分析和优化。

* **使用性能指标监控:**监控CPU使用率、内存使用率、查询时间等指标,以识别性能瓶颈。

* **优化索引:**创建合适的索引,并定期检查和调整索引以提高查询效率。

* **重写查询语句:**拆分复杂查询,优化条件,使用子查询或视图等方法重写查询语句。

* **利用缓存:**配置查询缓存和表缓存,并定期检查缓存命中率和失效率。

### 6.2 常见优化案例

#### 6.2.1 索引优化案例

**问题:**查询表中所有用户的信息,但没有使用索引。

```sql

SELECT * FROM users;

```

**优化:**在 `users` 表上创建主键索引或唯一索引。

```sql

CREATE INDEX idx_users_id ON users(id);

```

**效果:**索引可以快速定位特定用户,避免全表扫描,显著提高查询效率。

#### 6.2.2 查询重写优化案例

**问题:**查询表中所有订单,但条件是订单状态为已完成。

```sql

SELECT * FROM orders WHERE status = 'completed';

```

**优化:**使用索引扫描代替全表扫描。

```sql

SELECT * FROM orders USE INDEX (idx_orders_status) WHERE status = 'completed';

```

**效果:**索引扫描可以快速定位符合条件的订单,避免全表扫描,提高查询效率。

0

0