【云环境数据一致性】:数据标准化在云计算中的关键角色

发布时间: 2024-11-19 22:23:09 阅读量: 22 订阅数: 35

【java毕业设计】智慧社区在线教育平台(源代码+论文+PPT模板).zip

# 1. 数据一致性在云计算中的重要性

在云计算环境下,数据一致性是保障业务连续性和数据准确性的重要前提。随着企业对云服务依赖程度的加深,数据分布在不同云平台和数据中心,其一致性问题变得更加复杂。数据一致性不仅影响单个云服务的性能,更是多云和混合云架构中数据交互、整合与分析的核心挑战。维护数据一致性能够确保从简单的查询到复杂的数据处理过程中数据的准确无误,为业务决策提供可靠的支撑。本章将探讨数据一致性在云计算中的重要性,分析其在保障业务连续性和数据准确性方面的关键作用,并阐述其在多云环境中应对数据一致性挑战的策略。

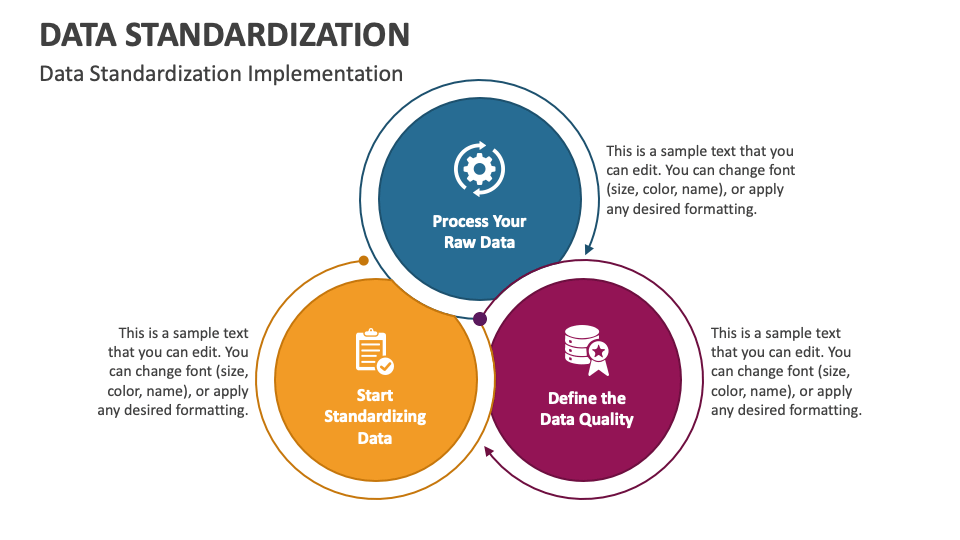

# 2. 数据标准化的基本概念和原理

## 2.1 数据标准化的定义和目的

### 2.1.1 数据标准化的必要性

在信息时代,数据是组织的重要资产,但未经处理的数据就如同一片混乱的市场,缺乏统一的语言和规范,难以进行有效的交流和分析。数据标准化是将数据转换为统一格式的过程,它解决了不同系统和应用程序之间的互操作性问题。这对于云计算来说尤为重要,因为在云环境中,数据经常在不同的租户和平台间流动。

数据标准化的必要性体现在以下几个方面:

- **提高数据质量**:标准化的过程往往伴随着数据清洗,这有助于去除数据中的重复和不一致性,确保数据的准确性。

- **加强数据互操作性**:通过统一的数据格式,不同的应用程序和系统能够更顺畅地交换数据。

- **促进数据整合**:来自多个来源的数据可以通过标准化得到整合,便于进行复杂的数据分析和挖掘。

- **降低运营成本**:标准化可以减少系统之间的数据转换需求,降低维护多个数据模型和接口的开销。

### 2.1.2 数据标准化的目标和意义

数据标准化的目标不仅仅是使数据格式统一,更是要为数据治理提供坚实的基础。它涉及到数据的结构化、规范化以及建立数据元素之间的关联性。标准化的过程对于实现数据的长期价值至关重要,有助于:

- **实现数据的统一视图**:用户可以从一致的视角查看数据,这对于跨部门或跨区域的大型组织来说尤为重要。

- **支持决策制定**:高质量、统一格式的数据能够为管理层提供准确的洞察,从而做出更加明智的业务决策。

- **优化数据资产**:标准化可以提升数据资产的透明度和可管理性,使数据更易于保护和合规。

## 2.2 数据标准化的方法和过程

### 2.2.1 数据清洗和预处理

数据清洗是数据标准化流程中的初步步骤,目的是从数据集中识别并修正错误和不一致性。该过程包括:

- **识别错误**:通过统计方法或算法识别数据集中的异常值。

- **纠正错误**:对数据值进行校正或将其标记为缺失。

- **去除重复**:通过比较数据元素,删除多余的记录。

清洗流程的代码示例:

```python

import pandas as pd

# 假设有一个包含错误和重复的数据集

data = pd.read_csv("dirty_data.csv")

# 检查并删除重复值

data.drop_duplicates(inplace=True)

# 识别和处理缺失值

data.fillna(method='ffill', inplace=True)

# 识别异常值并处理

data = data[data['age'] < 120] # 假设年龄不应超过120岁

# 保存清洗后的数据集

data.to_csv("clean_data.csv", index=False)

```

在上述代码中,我们使用了Pandas库来处理数据集,这在数据科学和数据工程中是一种常见的实践。数据清洗的过程需要对数据集有深入的理解,以便于正确地应用上述方法。

### 2.2.2 数据映射和转换

数据映射是将数据从一个格式转换为另一个格式的过程。例如,将日期从“日/月/年”格式映射为“年-月-日”。数据转换可以是简单的,比如单位的转换(如从英寸到厘米),也可以是复杂的,比如对数据进行编码或转换为更适合分析的形式。

数据映射和转换的步骤包括:

- **定义映射规则**:创建一个映射表,定义如何将一个值转换为另一个值。

- **应用映射规则**:使用定义好的规则对数据集进行转换。

- **转换验证**:确保转换后的数据仍然保持原有的意义。

### 2.2.3 数据集成和存储

数据集成是将来自不同来源的数据合并到一起的过程。这通常发生在数据仓库的构建过程中,当各种数据源的数据需要聚合以便进行更深入的分析时。

数据集成面临的一个主要挑战是如何处理不同数据源中的数据冲突。解决这一问题的方法通常包括:

- **数据合并**:使用ETL(抽取、转换、加载)工具将数据从各个源头导入到数据仓库。

- **数据融合**:采用数据融合技术将来自多个来源的信息结合,解决命名、数据类型和结构等方面的不一致性问题。

## 2.3 数据标准化在云计算中的应用

### 2.3.1 云数据仓库的数据标准化实践

云数据仓库提供了在云端存储、管理和分析大数据的平台。在云数据仓库中,数据标准化是基础工作之一,它涉及到以下实践:

- **使用云服务提供商的工具**:例如Amazon Redshift、Google BigQuery等云服务通常都提供了数据转换和映射的工具。

- **维护数据模型的一致性**:确保数据仓库中的所有数据都遵循统一的模式,如星型模式或雪花模式。

- **自动化数据流程**:使用数据流自动化工具,如Apache NiFi在云上执行数据转换和加载。

### 2.3.2 多云环境下的数据一致性挑战

多云环境指的是组织使用多个云服务提供商的服务。数据标准化在多云环境中变得更加复杂,因为每个云服务都可能有自己的数据格式和规范。在多云环境下确保数据一致性面临的挑战包括:

- **数据格式差异**:不同云服务之间可能存在数据格式的不兼容问题。

- **数据同步的复杂性**:在多个云服务之间同步数据,需要考虑延时、冲突解决和数据完整性。

- **管理成本增加**:每个云服务都可能有独特的管理工具和接口,这增加了数据标准化的工作量。

在多云环境中,组织必须采取策略来解决这些挑战。例如,可以使用中间件或集成平台作为数据标准化和同步的枢纽,统一管理不同云服务之间的数据流。

通过本章节的介绍,我们深入探讨了数据标准化的基本概念和原理。下一章将聚焦于数据标准化的技术实现,探讨如何使用具体的技术框架、工具和平台来落实数据标准化。

# 3. 数据标准化的技术实现

数据标准化是确保数据质量和一致性的关键步骤,而技术实现则是这一过程的核心。在本章中,我们将深入探讨数据标准化的技术框架、工具和平台以及最佳实践。

## 3.1 数据标准化的技术框架

技术框架是实现数据标准化的基础,它包括数据模型、架构、治理和元数据管理。

### 3.1.1 数据模型和架构

数据模型定义了数据的结构、类型、关系等,是实现数据标准化的基础。在云计算环境中,数据模型应当具有高度的灵活性以适应快速变化的业务需求。

**示例代码:**

```sql

CREATE TABLE customers (

customer_id INT PRIMARY KEY,

first_name VARCHAR(50),

last_name VARCHAR(50),

email VARCHAR(100)

);

```

**逻辑分析:** 以上SQL示例创建了一个名为`customers`的表,其中包含四个字段:`customer_id`作为主键,`first_name`和`last_name`用来存储客户名,`email`用来存储客户的电子邮件地址。这是构建数据模型的简单例子,实际应用中需要根据具体业务逻辑和需求来设计更加复杂和详细的模型。

### 3.1.2 数据治理和元数据管理

数据治理涉及数据的定义、使用、维护、安全和质量等方面。元数据管理则是数据治理的关键组成部分,它记录了数据元素的详细信息,帮助跟踪数据的来源、格式、关系等。

**表格:元数据管理的关键元素**

| 元素 | 描述 | 作用 |

| ------------- | ------------------------------------------------------------ | ------------------------------------------------------------ |

| 数据定义 | 数据的字段名称、数据类型、长度等 | 提供

0

0