R语言数据包深度案例分析:专家带你揭秘实战技巧

发布时间: 2024-11-11 02:49:28 阅读量: 22 订阅数: 44

量化分析-R语言工具数据包:part 1

# 1. R语言数据包概览

在数据分析和统计计算领域,R语言以其强大的功能和灵活性成为了一种不可或缺的工具。本章节将带您走进R语言的生态系统,对其中的数据包进行一次全面的概览。

## 1.1 R语言数据包的重要性

R语言之所以能广泛应用于学术研究、工业生产和金融分析等众多领域,其中一个主要原因便是其背后丰富多样的数据包。这些数据包通常由社区成员和专业研究人员开发,它们能够帮助用户更加快速、准确地完成特定的数据分析任务。

## 1.2 数据包的安装与更新

为了在R环境中使用这些数据包,用户需要首先进行安装。可以通过`install.packages()`函数来安装所需的R包。例如,安装名为`dplyr`的包,只需输入`install.packages("dplyr")`。同时,R语言提供`update.packages()`函数用于更新已安装的数据包,确保使用的是最新版本。

## 1.3 数据包的管理与加载

安装完数据包后,需要加载这些包以便使用其中的功能。使用`library()`函数可以加载数据包。例如,加载`dplyr`包需要运行`library(dplyr)`。此外,RStudio等集成开发环境提供了图形界面的包管理器,可以让用户以图形化方式轻松管理数据包。

通过对数据包的概览,我们为后续章节中将详细介绍的R语言在数据处理、统计分析、数据可视化以及特定领域应用等内容打下坚实的基础。在接下来的章节中,我们将深入探讨如何利用R语言提供的各种数据包来处理和分析数据。

# 2. ```

# 第二章:R语言数据处理基础

## 2.1 数据结构的理解与应用

### 2.1.1 向量、矩阵和数组的使用

在R语言中,向量(vector)是最基本的数据结构,它是同一类型元素的有序集合。向量的创建可以使用`c()`函数或者向量赋值运算符`<-`。例如,创建一个包含数字1到5的向量:

```r

vec <- c(1, 2, 3, 4, 5) # 使用c()函数创建向量

vec <- 1:5 # 使用冒号运算符创建连续的整数序列

vec <- seq(1, 5, by=1) # 使用seq()函数创建序列

```

矩阵(matrix)是具有二维结构的数据结构,可以看作是一个向量的特殊形式。矩阵中的元素必须是同质的。创建矩阵可以使用`matrix()`函数:

```r

mat <- matrix(1:6, nrow=2, ncol=3)

```

数组(array)是类似于矩阵的多维数据结构。与矩阵不同的是,数组可以具有更多的维度。创建数组可以使用`array()`函数:

```r

arr <- array(1:24, dim=c(2, 3, 4))

```

向量、矩阵和数组在R中是通过数组结构实现的,其中向量是1维数组,矩阵是2维数组。了解这些基础结构对于数据处理至关重要,它们在数据的初步处理和存储中扮演着重要角色。

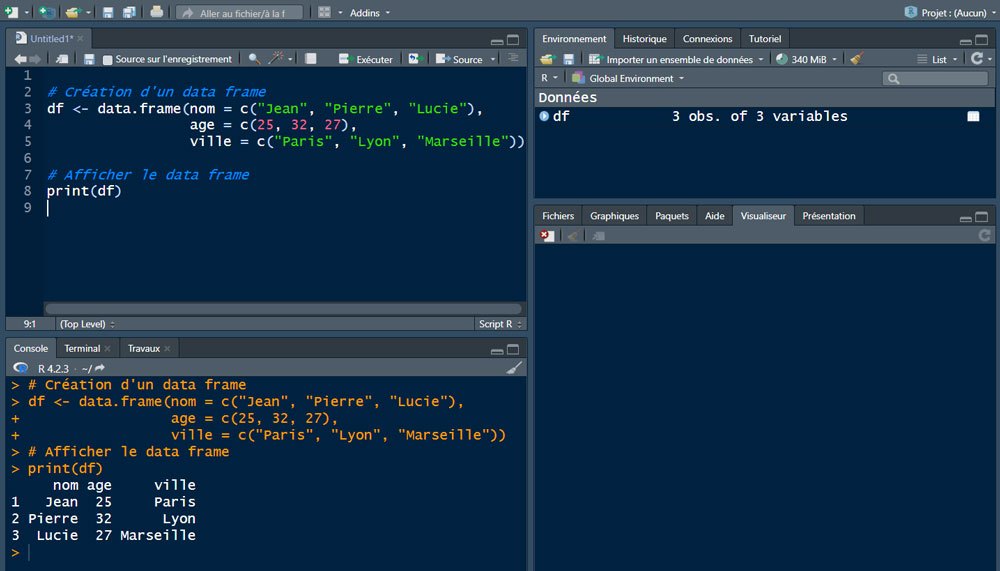

### 2.1.2 数据框与列表的区别及转换

数据框(data frame)是一种特殊的列表(list),它能够存储不同类型的列(相当于数据库中的列),每一列可以是不同模式(数值、字符、因子等)的数据。创建数据框可以使用`data.frame()`函数:

```r

df <- data.frame(

id = 1:4,

name = c("Alice", "Bob", "Charlie", "David"),

score = c(95, 85, 75, 65)

)

```

列表(list)是R中的一种复合数据结构,可以存储不同类型和不同长度的对象。列表是递归的数据结构,其元素可以包含向量、矩阵、数组、数据框等。创建列表可以使用`list()`函数:

```r

lst <- list(

vec = c(1, 2, 3),

mat = matrix(1:4, nrow=2),

df = data.frame(x = c(1, 2), y = c(3, 4))

)

```

在实际数据处理中,经常需要在数据框和列表之间进行转换。这可以通过`as.data.frame()`和`as.list()`函数实现。了解两者的区别和转换方法,有助于根据需要选择合适的数据结构进行数据处理。

## 2.2 数据导入与导出技巧

### 2.2.1 常用数据导入方法

R语言支持多种数据导入方法,其中包括文本文件、Excel文件、数据库、网络资源等。常用的导入函数有`read.table()`、`read.csv()`、`readxl`包的`read_excel()`、`haven`包的`read_sas()`等。

以读取CSV文件为例,可以使用以下代码:

```r

# 读取CSV文件

data <- read.csv("path/to/your/data.csv", header = TRUE, sep = ",")

```

参数解释:

- `path/to/your/data.csv` 是CSV文件的路径。

- `header = TRUE` 表示文件的第一行是列名。

- `sep = ","` 指定列之间的分隔符,对于CSV文件来说通常是逗号。

对于Excel文件,R中没有内置的函数,但是`readxl`包提供了一个非常方便的`read_excel()`函数:

```r

# 安装并加载readxl包

install.packages("readxl")

library(readxl)

# 读取Excel文件

data <- read_excel("path/to/your/data.xlsx")

```

### 2.2.2 数据导出为不同格式

数据处理完成后,经常需要将数据导出为不同的格式。R语言支持导出为CSV、Excel、JSON、数据库等多种格式。常用的导出函数有`write.csv()`、`write.table()`、`writexl`包的`write_xlsx()`等。

将数据导出为CSV格式可以使用:

```r

# 导出为CSV文件

write.csv(data, file = "path/to/your/data.csv", row.names = FALSE)

```

参数解释:

- `data` 是要导出的数据框。

- `file = "path/to/your/data.csv"` 指定导出文件的路径和名称。

- `row.names = FALSE` 防止行名被写入CSV文件。

对于Excel格式,使用`writexl`包的`write_xlsx()`函数:

```r

# 安装并加载writexl包

install.packages("writexl")

library(writexl)

# 导出为Excel文件

write_xlsx(data, "path/to/your/data.xlsx")

```

这些方法可以根据需要灵活使用,以便高效地处理数据的输入和输出。

## 2.3 数据清洗与预处理

### 2.3.1 缺失值与异常值处理

数据清洗是数据分析前的重要步骤。在R中,我们可以使用一系列函数和方法来处理缺失值(missing values)和异常值(outliers)。

检查和处理缺失值可以使用以下函数:

```r

# 检查数据中的缺失值

missing_values <- is.na(data)

# 删除含有缺失值的行

cleaned_data <- na.omit(data)

# 替换缺失值为均值

data[is.na(data)] <- mean(data, na.rm = TRUE)

```

异常值的检测可以使用不同的方法,例如箱线图、标准差等。异常值处理的方法包括删除、替换或使用鲁棒统计方法来减少它们的影响。

```r

# 使用箱线图识别异常值

boxplot(data)

# 删除超出1.5倍四分位距的异常值

Q1 <- quantile(data, 0.25)

Q3 <- quantile(data, 0.75)

IQR <- Q3 - Q1

data <- data[data >= (Q1 - 1.5 * IQR) & data <= (Q3 + 1.5 * IQR)]

```

### 2.3.2 数据标准化与归一化

数据标准化和归一化是预处理步骤,目的是使数据具有统一的尺度,以便于后续分析。标准化(Standardization)通常指的是减去均值后除以标准差,而归一化(Normalization)则是将数值缩放到特定的范围,如[0,1]。

```r

# 标准化数据

data_standardized <- (data - mean(data)) / sd(data)

# 归一化数据到[0,1]范围

data_normalized <- (data - min(data)) / (max(data) - min(data))

```

这些预处理步骤对于确保分析模型的准确性和高效性至关重要。

以上内容仅为第二章的部分内容,为保证文章的连贯性和深度,每个章节都应包含丰富的代码实例、逻辑分析以及深入浅出的解释。每个

```

0

0