【零售行业智能分析】:决策树在库存管理和销售预测中的应用

发布时间: 2024-09-05 07:28:53 阅读量: 91 订阅数: 35

# 1. 零售行业智能分析概览

零售行业作为商品流通的关键环节,一直以来都处于激烈的市场竞争之中。随着数据科学和机器学习技术的快速发展,越来越多的零售企业开始采用智能分析技术以获得竞争优势。智能分析不仅能帮助零售商提高运营效率,还能增强客户体验,实现精准营销和库存管理。

在智能分析的众多方法中,决策树因其直观、易于理解和解释的特性,成为零售行业分析中不可或缺的工具。本章我们将概览决策树在零售行业中的应用,并探讨其在未来智能零售中的潜力和挑战。接下来的章节会深入分析决策树的理论基础、应用案例以及实施过程中涉及的关键技术。

随着智能分析在零售业中的普及,零售商需要重视如何有效利用数据来驱动业务决策。本章内容将为读者提供一个全面的视角,理解决策树在零售领域的应用背景和未来趋势。

# 2. 决策树理论基础

## 2.1 决策树的定义和分类

### 2.1.1 了解决策树模型

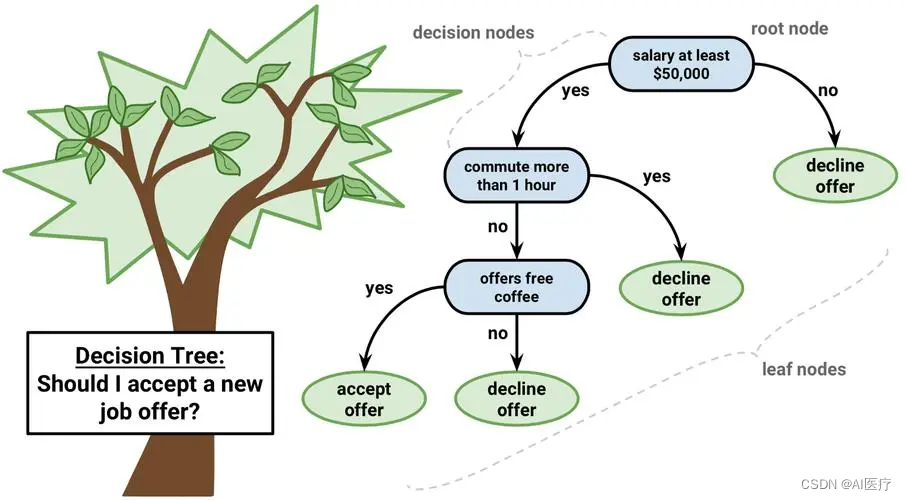

决策树是一种常用的机器学习方法,尤其在分类和回归任务中表现突出。它通过一系列的规则对数据进行划分,这些规则通过树状结构来表示,每个内部节点表示对某个属性的测试,每个分支代表测试结果的输出,而每个叶节点代表一种类别或一个具体的数值。

对于零售行业,决策树能够帮助解析顾客的购买行为、产品销售趋势、以及优化库存管理等。例如,通过决策树模型可以分析哪些因素对销售额有显著影响,从而指导企业制定有效的营销策略。

### 2.1.2 决策树的主要类型和特点

决策树的主要类型包括分类树和回归树。分类树用于处理分类数据,即目标变量是离散值的情况,而回归树则用于预测连续值,例如价格或需求量。

分类树的特点包括:

- 易于理解和解释

- 对于缺失值和非数值数据具有较好的处理能力

- 能够处理数值型和标称型数据

回归树的特点包括:

- 预测连续数值目标变量的能力

- 能够对非线性关系进行建模

- 适用于目标变量变化范围较大的问题

## 2.2 决策树的学习算法

### 2.2.1 ID3算法原理

ID3(Iterative Dichotomiser 3)算法是一种用于决策树学习的算法,它的核心思想是通过信息增益来选择测试属性,创建决策树的每个节点。信息增益是基于熵的概念,熵是一个度量数据混乱程度的指标,ID3试图最小化决策树的熵值,以达到最佳的分类效果。

ID3算法的基本步骤包括:

1. 计算数据集的总熵。

2. 对每个属性计算信息增益。

3. 选择信息增益最大的属性进行分裂。

4. 创建节点,并对不同的属性值创建分支。

5. 递归地对子数据集重复上述步骤,创建决策树的其他节点。

### 2.2.2 C4.5和CART算法对比

C4.5算法是ID3的改进版,它克服了ID3在处理连续属性和属性值数量可变时的局限。而CART(Classification and Regression Trees)算法既可以构建分类树也可以构建回归树。

C4.5与CART算法的主要差异点:

- C4.5使用信息增益率来选择属性,而CART使用基尼不纯度(Gini impurity)。

- C4.5在建树过程中允许剪枝,而CART采用一种更加严格的剪枝策略。

- C4.5可以处理连续型属性,而CART构建回归树时使用分割法来处理连续型属性。

下面是一个简单的代码示例,展示如何使用Python的scikit-learn库来构建一个决策树模型。这个例子使用的是CART算法:

```python

from sklearn.datasets import load_iris

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载iris数据集

iris = load_iris()

X = iris.data

y = iris.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建决策树分类器

clf = DecisionTreeClassifier(criterion='gini')

# 训练模型

clf.fit(X_train, y_train)

# 预测测试集结果

y_pred = clf.predict(X_test)

# 评估模型准确率

print(f"Accuracy: {accuracy_score(y_test, y_pred)}")

```

在上述代码中,我们首先加载了`iris`数据集,然后划分了训练集和测试集。接着创建了一个`DecisionTreeClassifier`的实例,并用训练集数据拟合模型。最后,我们对测试集数据进行了预测,并输出了模型的准确率。

## 2.3 决策树模型的评估和优化

### 2.3.1 剪枝技术

剪枝是决策树模型优化中的一项重要技术,其目的是防止模型过拟合。剪枝可以分为预剪枝和后剪枝。预剪枝是在构建树的过程中限制树的增长,而后剪枝则是在树构建完成后去掉一些不必要的节点。

剪枝技术的关键点在于如何确定剪枝的时机和程度,常用的方法包括:

- 惩罚复杂度的剪枝(Cost complexity pruning)

- 最小错误剪枝(Error complexity pruning)

- 验证集剪枝(Validation set pruning)

### 2.3.2 模型的准确性和泛化能力

模型的准确性是指模型在训练集上的预测性能,而泛化能力则是指模型在未知数据上的表现。理想情况下,我们希望模型具有高准确性和强泛化能力。

为了评估决策树模型,常见的评估指标包括:

- 准确率(Accuracy)

- 召回率(Recall)

- 精确率(Precision)

- F1分数(F1-score)

在评估过程中,可以通过混淆矩阵(Confusion Matrix)来展示模型的分类性能。混淆矩阵是一种表格布局,能清晰显示正确分类和错误分类的情况。

这里用一个简单的表格来展示一个决策树模型在测试集上的表现:

| 真实值 \ 预测值 | Positive | Negative |

|-----------------|----------|----------|

| Positive | TP | FN |

| Negative | FP | TN |

在这个表格中,TP代表真正例(True Positives),TN代表真负例(True Negatives),FP代表假正例(False Positives),FN代表假负例(False Negatives)。

通过这些指标和混淆矩阵,我们可以对决策树模型进行深入的分析和评估,进一步调整和优化模型参数,提高模型的泛化能力。

# 3. 决策树在库存管理中的应用

在零售行业中,库存管理是保证业务正常运营的基石。有效地管

0

0