提升大数据处理能力:HDFS列式存储与Spark深度集成策略

发布时间: 2024-10-28 12:34:01 阅读量: 27 订阅数: 30

java+sql server项目之科帮网计算机配件报价系统源代码.zip

# 1. 大数据背景下的存储挑战

随着数据量的爆炸性增长,大数据存储已经成为企业IT基础设施面临的首要挑战。本章将深入探讨在大数据背景下,存储系统所需应对的挑战,以及对现有技术的挑战。

## 1.1 数据量的增长趋势

数据每时每刻都在激增,尤其是随着物联网(IoT)设备的普及和社交媒体的蓬勃发展,数据的规模和复杂度都达到了前所未有的水平。传统的存储解决方案无法满足如此庞大的数据处理需求,因此必须寻求新的技术和架构来应对这些挑战。

## 1.2 存储面临的挑战

在大数据的背景下,存储系统面临着多方面的挑战,包括但不限于数据的高并发访问、数据的快速处理和分析、以及数据的高效压缩和管理。此外,存储系统还需要具备良好的扩展性和容错性,保证数据的可靠性和业务的连续性。

## 1.3 对存储技术的影响

大数据对存储技术的要求不仅限于容量的提升,更重要的是性能和效率的优化。这推动了分布式存储系统的发展,其中Hadoop分布式文件系统(HDFS)已成为大数据存储的主流选择之一。接下来的章节将会对HDFS进行深入探讨,分析其如何应对这些存储挑战。

# 2. HDFS列式存储基础

## 2.1 HDFS分布式文件系统的原理

### 2.1.1 HDFS架构和组件

Hadoop分布式文件系统(HDFS)是为了解决大数据存储和处理而设计的,它具有高容错性、适合于大规模数据集的存储和处理。HDFS架构包括了NameNode和DataNode两个主要的组件:

- **NameNode**:是HDFS的主节点,负责管理和存储文件系统的元数据,例如文件目录树、文件属性、文件块的位置信息等。NameNode是整个文件系统的核心,它不存储实际的数据文件,而是记录数据块的位置信息,使得数据可以分布在集群的多个DataNode上。

- **DataNode**:位于集群的每一个数据节点上,负责实际的数据存储。每个DataNode管理一部分磁盘空间,它将大文件分割成数据块(block),并存储在本地文件系统上。

HDFS还支持Secondary NameNode和其他辅助工具,用于帮助NameNode保持系统稳定性和元数据的更新。

### 2.1.2 HDFS的读写机制

HDFS提供了高效的数据读写机制来支持大数据的处理。在写入文件时,HDFS的工作流程如下:

1. **客户端联系NameNode**:客户端首先向NameNode发起写文件的请求。

2. **NameNode分配数据块**:NameNode会为文件分配一些数据块,并返回一个数据块列表给客户端。

3. **客户端上传数据块**:客户端会向DataNode列表中的DataNode顺序上传数据块。为了避免单点故障,数据通常会被复制多个副本(默认为3个)。

4. **DataNode存储数据块**:每个DataNode将接收到的数据块存储在本地文件系统上。

读取文件时,流程相对简单:

1. **客户端联系NameNode**:客户端首先向NameNode请求文件的元数据,获取文件的数据块所在的位置。

2. **NameNode返回数据块位置**:NameNode将数据块的位置信息返回给客户端。

3. **客户端读取数据块**:客户端直接从相关的DataNode读取数据块。

这种读写机制保证了HDFS能够提供高吞吐量的数据访问,这对于批处理型的大型分布式应用是十分重要的。

## 2.2 列式存储的优势与原理

### 2.2.1 列式存储与行式存储的对比

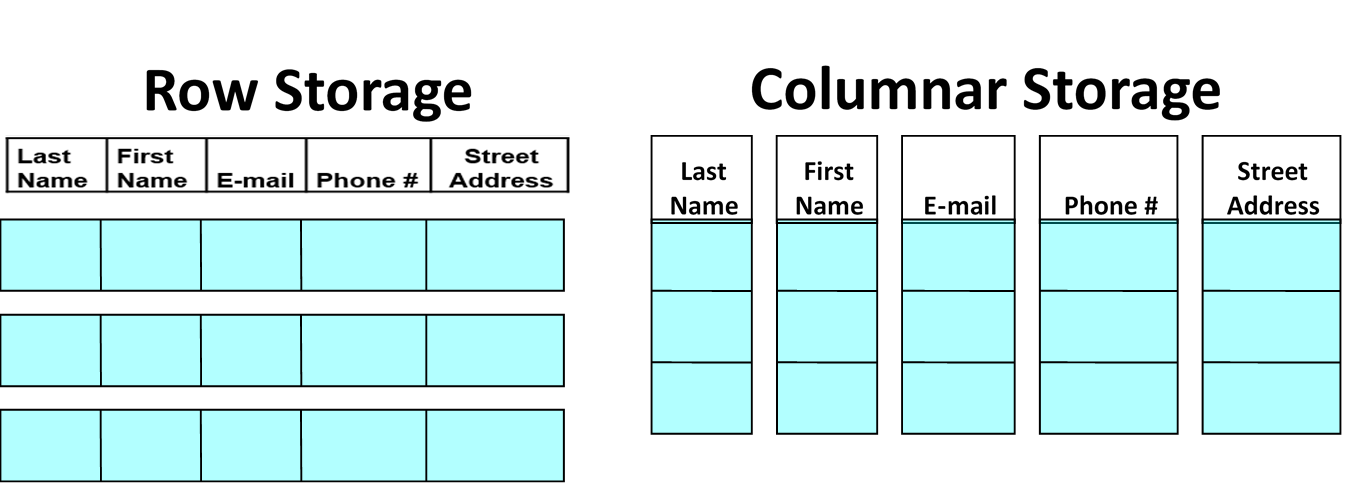

在列式存储中,数据是按列而非按行存储的。这与传统的行式存储(如关系型数据库)存在本质区别。列式存储的对比优势如下:

- **读写性能**:当查询涉及特定列时,列式存储只需读取和写入所涉及的列,而不需要整行数据,这大大减少了I/O操作,提升了性能。

- **数据压缩**:列式存储的数据由于具有较高的相似性,使得压缩效率更高。

- **数据访问模式**:在数据仓库和大数据分析场景下,经常需要访问数据的某一列或几列,列式存储可以更好地适应这类访问模式。

行式存储则在需要频繁插入和更新单条记录的场景下表现更好,例如在线事务处理(OLTP)系统。

### 2.2.2 列式存储的数据压缩技术

列式存储的另一个显著优势是数据压缩。以下是几种常见的列式存储数据压缩技术:

- **位图索引(Bitmap Index)**:适用于低基数的列数据,如性别或状态等。

- **字典编码(Dictionary Encoding)**:适用于有限的、重复度高的数据集。

- **游程长度编码(Run-Length Encoding)**:适用于连续重复数据,将连续的重复值仅存储一次。

- **块压缩(Block Compression)**:如Parquet使用了块压缩技术,可以高效压缩存储空间并提高I/O吞吐量。

## 2.3 HDFS列式存储的实现方式

### 2.3.1 Hadoop ORCFile和Parquet格式

Hadoop ORCFile和Parquet是Hadoop生态中广泛使用的两种列式存储文件格式:

- **ORCFile(Optimized Row Columnar Format)**:

- ORCFile是Hadoop团队开发的一种列式存储文件格式,它将数据优化为列存储,使用字典编码、位图索引和游程长度编码等技术进行压缩,从而减小了存储空间,提高了查询效率。

- **Parquet**:

- Parquet是另一种列式存储格式,支持多种编程语言和生态系统。它采用嵌套数据结构来优化存储,使用了与ORCFile类似的数据压缩技术,并且具有强类型数据支持的优势。

这两种文件格式都支持向量化处理,可以利用现代CPU的SIMD指令集进一步提高查询性能。

### 2.3.2 列式存储在HDFS中的应用案例

在实践中,列式存储在HDFS中的应用非常广泛,尤其是在数据仓库和大数据分析的场景。以下是一个典型的应用案例:

- **数据仓库的优化**:某大型电商平台利用Parquet格式存储其数据仓库中的数据。通过列式存储,他们显著减少了I/O操作,提高了查询速度。同时,由于数据压缩技术的应用,存储空间得到了有效的节约。系统能够在有限的硬件资源下,处理更多的数据,并提供更快速的分析结果。

列式

0

0