Python sys模块的高级内存管理:监控与优化内存使用

发布时间: 2024-10-07 03:45:19 阅读量: 29 订阅数: 30

Python标准库之Sys模块使用详解

# 1. Python sys模块概述与内存管理基础

## 1.1 Python sys模块简介

Python的sys模块为解释器提供了与Python解释器紧密相关的变量和函数。通过这个模块,我们可以访问解释器的内部细节,包括内存管理、变量访问以及模块和函数的控制等。对于系统级编程和内存管理,sys模块是不可或缺的。

## 1.2 内存管理的重要性

在Python中,内存管理是由解释器自动完成的,包括对象的创建、访问、修改和销毁。正确地理解内存管理机制对于提高程序性能、防止内存泄漏等问题至关重要。

## 1.3 sys模块在内存管理中的作用

sys模块提供了一些有用的工具和接口,用于监控和优化程序的内存使用。例如,`sys.getsizeof()`可以用来查询对象占用的内存大小,`sys.setrecursionlimit()`允许程序定义递归的最大深度,这对于控制程序内存使用有直接的影响。

接下来,我们将更深入地探讨sys模块的内存监控技术,以及如何利用这些工具来提升内存管理能力。

# 2. sys模块与内存监控技术

## 2.1 内存使用基础概念

### 2.1.1 内存分配与回收机制

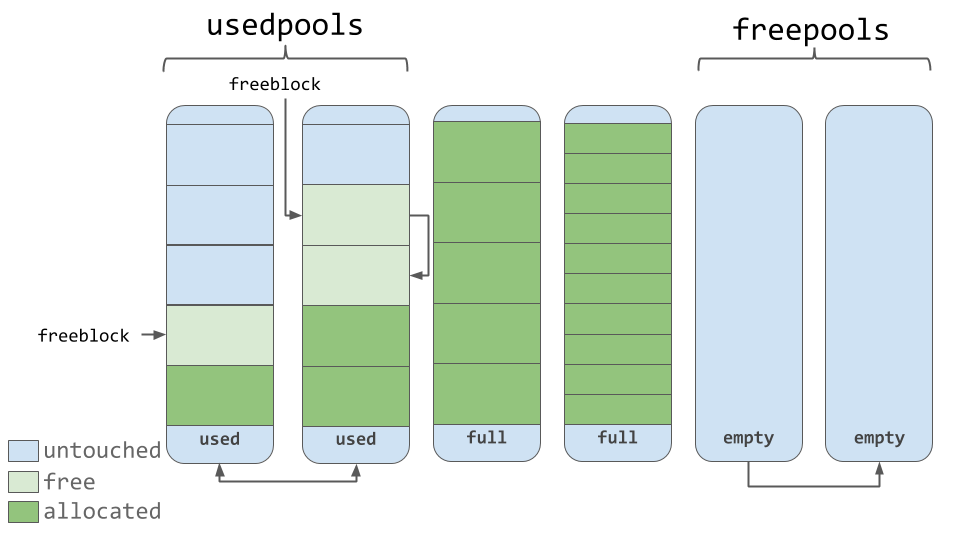

在Python中,内存分配和回收机制是自动进行的,这是由Python的垃圾回收机制所负责。该机制主要分为引用计数和垃圾回收器两部分。引用计数是跟踪对象被引用的次数,每当有新的引用指向对象时,计数器加1;当引用消失时,计数器减1。当对象的引用计数降到0时,意味着没有任何变量指向该对象,因此该对象可被回收。

垃圾回收器则是一种在对象引用计数的基础上,周期性运行的循环检测器,它旨在解决引用计数无法处理的循环引用问题。在Python中,垃圾回收器默认在对象的引用计数减少到一定程度后才会被触发。

### 2.1.2 内存使用的度量标准

在Python中,内存使用的度量标准通常包括以下几个方面:

- 内存分配:指的是程序运行过程中,操作系统为程序分配的内存总量。

- 内存占用:指的是程序在某一时刻占用的物理内存总量。

- 内存泄漏:指程序在申请内存后,未能释放已不再使用的内存,导致内存使用量持续增长。

- 内存碎片:指内存中存在大量不连续的小块可用空间,这会降低内存分配的效率。

通过这些度量标准,可以更准确地把握程序的内存使用情况,进而进行有效的监控和优化。

## 2.2 sys模块的内存监控工具

### 2.2.1 getsizeof方法

Python的sys模块提供了一个非常有用的函数`getsizeof()`,它可以返回一个对象所占用的内存大小。此方法可以帮助开发者了解各种数据类型和对象在内存中的大小,从而更好地监控和管理内存使用情况。

```python

import sys

# 获取数据类型的内存大小

size_of_list = sys.getsizeof([])

print(f"An empty list takes up {size_of_list} bytes of memory")

# 获取实例的内存大小

class MyClass:

pass

instance = MyClass()

size_of_instance = sys.getsizeof(instance)

print(f"A new instance of MyClass takes up {size_of_instance} bytes of memory")

```

在实际应用中,`getsizeof()`可以与其他Python内置函数组合使用,以获得更详细的信息。

### 2.2.2 tracemalloc模块

`tracemalloc`模块是Python 3.4之后引入的,它提供了一个更高级的接口来跟踪Python内存分配情况。该模块可以帮助我们监控内存的使用,以及查找内存泄漏的源头。

```python

import tracemalloc

# 开始追踪内存分配

tracemalloc.start()

# 执行一些操作,例如创建对象

a = [1, 2, 3]

b = [4, 5, 6]

# 输出当前内存使用情况

current, peak = tracemalloc.get_traced_memory()

print(f"Current memory usage is {current}KB, peak was {peak}KB")

# 停止追踪,并打印追踪的快照

snapshot = tracemalloc.take_snapshot()

for stat in snapshot.statistics('lineno'):

print(stat)

```

在使用`tracemalloc`时,我们可以通过`take_snapshot`方法得到一个内存分配的快照,并通过不同的统计数据来查看内存分配的详情。

## 2.3 实践内存监控

### 2.3.1 创建内存监控脚本

创建一个内存监控脚本通常包括以下几个步骤:

1. 使用`sys.getsizeof()`或`tracemalloc`模块。

2. 定义监控的时间点,例如在程序的不同执行阶段。

3. 将监控的数据记录下来,用于分析。

4. 对记录的数据进行分析,找出内存使用高峰,以及可能存在内存泄漏的模块或对象。

### 2.3.2 解读内存监控数据

解读内存监控数据时,关键是要了解内存使用的模式和异常值。可以利用图表来直观地展示内存使用的变化趋势。分析时,重点关注以下几点:

- 确认内存使用是否符合预期。

- 寻找内存使用突然增加或异常波动的时段。

- 识别出大对象或创建过多实例导致的内存压力。

- 结合代码逻辑,分析导致内存使用异常的具体原因。

通过实践内存监控,可以有效地预防内存问题,保持程序的健康运行状态。

# 3. 内存使用优化策略

## 3.1 Python内存使用的优化原则

### 3.1.1 对象引用与回收

Python 使用一种称为引用计数(reference counting)的机制来管理内存中的对象。每个对象维护一个计数器,记录有多少引用指向该对象。当引用计数降为零时,对象占用的内存空间将被回收。然而,存在循环引用时,即使没有外部引用,对象仍可能无法被回收,导致内存泄漏。为了优化内存使用,开发者需确保循环引用被正确处理。

在实践中,可以使用`weakref`模块创建弱引用,从而避免增加对象的引用计数。弱引用不计入对象的引用计数,因此它们不会阻止对象被回收。这在构建缓存或需要避免循环引用的情况下非常有用。

### 3.1.2 缓存机制的运用

缓存是优化内存使用的常见策略之一,它允许存储已经计算过的结果,以便在需要时快速获取。在Python中,`functools`模块中的`lru_cache`装饰器可以用来创建缓存,它可以记住最近使用的函数调用结果。这是以牺牲部分内存为代价提高程序性能的典型范例。

使用`lru_cache`可以极大地提升那些有重复计算需求的函数性能。需要注意的是,缓存管理也需要消耗一定的内存。开发者需要权衡缓存带来的性能提升与内存消耗之间的关系,合理配置缓存大小。

## 3.2 使用sys模块进行内存优化

### 3.2

0

0